Knowledge Distillationとは?予算内でGPT-4のパフォーマンスを得る方法

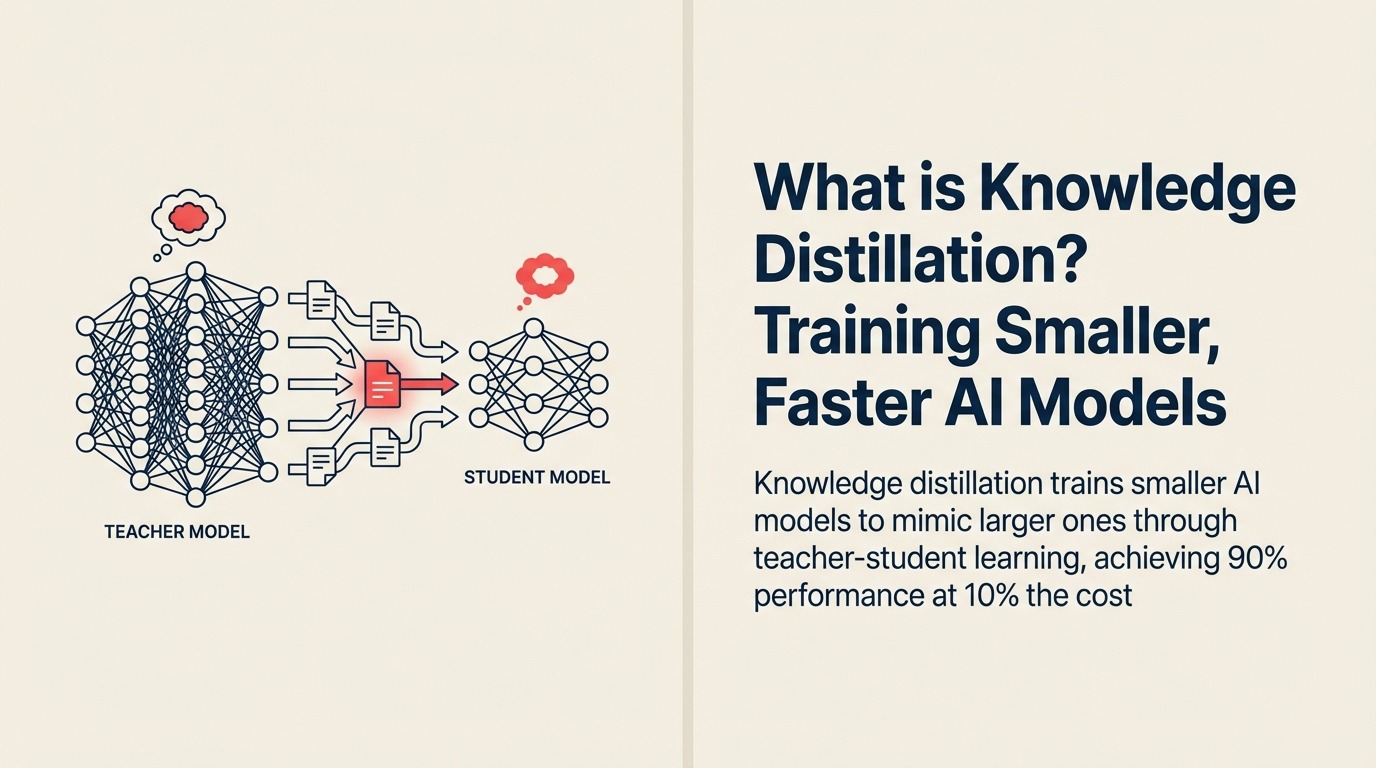

GPT-4は優秀ですが、100万トークンあたり20ドルかかります。小型の専用モデルは同じ作業を0.20ドルで行えますが、GPT-4の機能に匹敵できません。本当にできないのでしょうか?Knowledge Distillationは、大規模な大規模言語モデルのインテリジェンスをコンパクトで高速で手頃な価格のバージョンに転送できる技術として登場しました。特定のユースケースでコストの10%でパフォーマンスの90%を提供します。

GPT-4は優秀ですが、100万トークンあたり20ドルかかります。小型の専用モデルは同じ作業を0.20ドルで行えますが、GPT-4の機能に匹敵できません。本当にできないのでしょうか?Knowledge Distillationは、大規模な大規模言語モデルのインテリジェンスをコンパクトで高速で手頃な価格のバージョンに転送できる技術として登場しました。特定のユースケースでコストの10%でパフォーマンスの90%を提供します。

大型モデルの独占から効率的なインテリジェンスへ

Knowledge Distillationは、2015年に研究者が小型のニューラルネットワークが生データから再学習するのではなく、大型モデルの動作を研究することで大型モデルを模倣できることを発見したときに、画期的な技術として登場しました。学術的な好奇心として始まったものが、本番環境の必要性になりました。

Google Researchは、Knowledge Distillationを「大型で複雑な教師モデルから小型でより効率的な生徒モデルへ知識を転送するプロセスで、生徒が教師の出力と内部表現を再現するようにトレーニングすることで行われる」と定義しています。

この分野が爆発的に成長したのは、企業が特定のタスクに対してGPT-3のパフォーマンスに匹敵する専用モデルを作成できることに気付いたときです。ローカルハードウェアで100倍高速に実行され、高価なクラウドAPIが手頃なエッジデプロイメントに変わりました。

ビジネスリーダーにとっての意味

ビジネスリーダーにとって、Knowledge Distillationは最先端のAIモデルのインテリジェンスを、特定のユースケースに最適化された小型で高速で低コストのバージョンでキャプチャできることを意味します。ビジネスにとって重要なタスクの品質を維持しながら、コストを80〜95%削減できます。

シニアエキスパートを雇って専門チームをトレーニングするようなものと考えてください。チームはエキスパートが知っていることをすべて知っているわけではありませんが、必要な特定のタスクで優れた成績を収めます。そして、1人のエキスパートのコストで10人のチームを雇うことができます。

実際には、Knowledge Distillationにより、スマートフォンでGPT-4クラスのインテリジェンスを実行し、ドルではなくペニーで顧客クエリを処理し、ユースケースの精度を犠牲にすることなくオフラインで動作するAIを展開できます。

Knowledge Distillationの主要要素

Knowledge Distillationは、これらの重要なコンポーネントで構成されています。

• 教師モデル: 最先端のパフォーマンスを達成するが、本番環境のデプロイメントには高価すぎる、または遅すぎる大型で強力なモデル(GPT-4やClaudeなど)

• 生徒モデル: 生のトレーニングデータからではなく、教師の知識から学習するように設計された小型で高速なモデルで、効率性のために最適化されています

• ソフトターゲット: 教師の可能な答えに対する確率分布(最終的な答えだけでなく)で、不確実性とニュアンスに関するより豊富な学習信号を提供します

• 蒸留トレーニング: 生徒は教師の最終的な答えと推論パターンの両方に一致することを学習し、教師の意思決定アプローチをキャプチャします

• タスク特化: 生徒モデルは、一般的なインテリジェンスを試みるのではなく、教師に近いパフォーマンスを達成できる特定のユースケースに焦点を当てます

Knowledge Distillationのプロセス

Knowledge Distillationの実装は次のステップに従います。

教師と生徒を選択: ドメインに強力な教師モデルを選択し、環境で効率的に実行できる小型の生徒アーキテクチャ(パラメータが10〜100分の1)を設計します

トレーニングデータを生成: トレーニング例を教師モデルに通し、その出力、確率分布、中間活性化を収集して、意思決定パターンをキャプチャします

生徒を模倣するようにトレーニング: 生徒モデルをトレーニングして教師の出力と推論を再現し、正しい答えと教師の信頼レベルの両方を使用して、ニュアンスのある理解を転送します

このプロセスにより、実行に時間あたり50ドルかかる1750億パラメータのモデルが、時間あたり0.50ドルでパフォーマンスの95%を達成する10億パラメータのモデルに変換されます。

Knowledge Distillationのタイプ

Knowledge Distillationにはいくつかのアプローチがあります。

タイプ1:レスポンスベース蒸留 最適な用途:迅速な実装とシンプルなタスク 主な特徴:生徒が教師の最終出力から学習 例:一般的な質問に対するGPT-4の答えに一致するようにカスタマーサービスチャットボットをトレーニング

タイプ2:フィーチャーベース蒸留 最適な用途:より深い理解をキャプチャ 主な特徴:生徒が教師の内部表現から学習 例:大型ビジョンモデルの特徴抽出を模倣する専用画像分類器を作成

タイプ3:リレーションベース蒸留 最適な用途:複雑な推論タスク 主な特徴:生徒が概念間の関係を学習 例:大型モデルの法的条項の相互作用の理解をキャプチャする契約分析モデルを構築

タイプ4:マルチ教師蒸留 最適な用途:複数の機能を組み合わせる 主な特徴:生徒が複数の専門教師から学習 例:財務、運用、販売の個別エキスパートによってトレーニングされたビジネスインテリジェンスアシスタントを作成

Knowledge Distillationの実践例

企業が実際にKnowledge Distillationをどのように使用しているかを見てみましょう。

カスタマーサポートの例: Intercomは、製品の質問に答えるために、GPT-3.5の知識を1億2500万パラメータのモデルに蒸留しました。蒸留されたモデルは、GPT-3.5の精度の92%を達成し、40倍高速に実行され、95%低コストで、エッジサーバーでのリアルタイム応答を可能にします。

リーガルテックの例: LawGeexは、5万件の法的文書にわたってGPT-4から知識を蒸留することで、専門的な契約レビューモデルを作成しました。結果のモデルは、契約分析でGPT-4の精度に一致し、オンプレミスで実行され、コストの10%でクライアントの機密性を保護します。

Eコマースの例: Amazonは、Knowledge Distillationを使用して、大規模なディープラーニングシステムのインテリジェンスをキャプチャする製品推奨モデルを作成し、モバイルアプリで効率的に実行します。2秒ではなく50msでパーソナライズされた推奨を提供します。

Knowledge Distillation習得への道

効率的で専門的なAIモデルを作成する準備はできていますか?

詳細情報

関連するAI概念の理解を深めましょう。

- Model Compression - 小型モデルのための他の技術

- Fine-tuning - 事前トレーニング済みモデルのカスタマイズ

- Pruning - 不要なモデルコンポーネントの削除

- Neural Architecture Search - 効率的なモデル構造の設計

外部リソース

- Google Research on Model Compression - 蒸留技術に関する学術論文

- Hugging Face Distillation Tutorials - Knowledge Distillationの実装のための実践的ガイド

- OpenAI Model Efficiency Research - コスト効率の高いAIデプロイメント戦略

FAQ

Knowledge Distillationに関するよくある質問

Knowledge Distillationとは何ですか?

Knowledge Distillationは、より大型で強力な教師モデルの動作と知識を模倣するように、小型で高速な生徒モデルをトレーニングするプロセスで、計算コストのほんの一部で同様のパフォーマンスを達成します。

生徒モデルはどの程度小さくできますか?

生徒モデルは通常、教師の10〜100分の1のサイズです。一般的なアプローチは、GPT-3(1750億パラメータ)を、特定のタスクでパフォーマンスに一致する10〜70億パラメータの専用モデルに蒸留し、50〜100倍高速に実行することです。

Knowledge Distillationとファインチューニングの違いは何ですか?

ファインチューニングは、同じモデルアーキテクチャを使用して事前トレーニング済みモデルを新しいデータに適応させます。Knowledge Distillationは、大型モデルから小型の異なるアーキテクチャへ知識を転送し、デプロイメント用に最適化されたより効率的なモデルを作成します。

生徒モデルは教師のパフォーマンスに一致しますか?

狭く明確に定義されたタスクの場合、生徒モデルは通常、教師のパフォーマンスの85〜95%を達成します。トレードオフは幅です:生徒は特定のタスクで優れていますが、教師の一般的な機能を欠いています。

いつKnowledge Distillationを使用すべきですか?

推論コストが高い場合、高速なレスポンスタイムが必要な場合、エッジデバイスにデプロイしたい場合、または一般的なモデル機能なしに特定のタスクパフォーマンスが必要な場合にKnowledge Distillationを使用します。AIアプリケーションを収益性高くスケールするために不可欠です。

AI用語集の一部。最終更新:2026-02-09