Multimodal AIとは?すべてのコンテンツのための1つのモデル

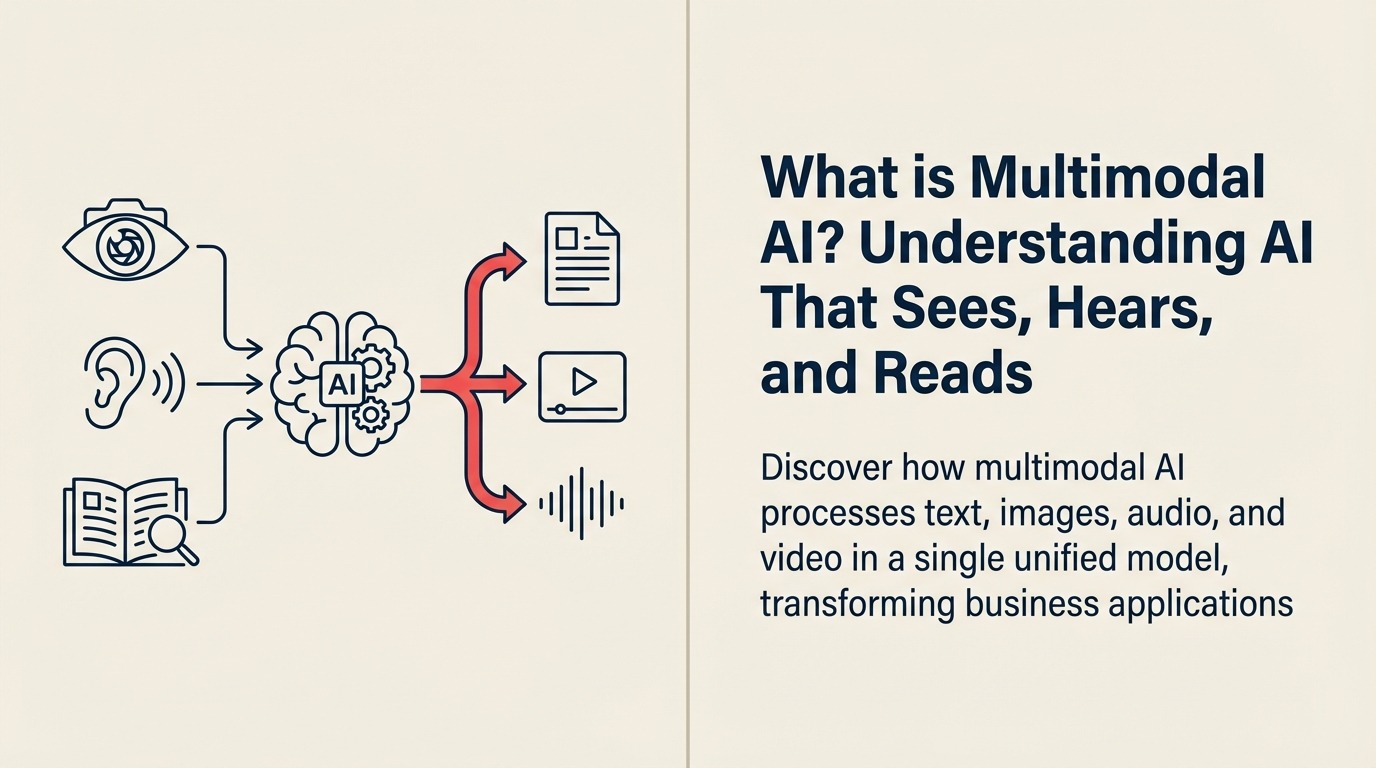

メールを読み、添付されたスプレッドシートを分析し、デモビデオを見て、3つすべてからの洞察で応答できるAIを想像してください。ツール間の切り替えなし。手動での要約なし。あなたが投げかけるすべてを理解する1つのインテリジェントシステム。それがMultimodal AIです。

メールを読み、添付されたスプレッドシートを分析し、デモビデオを見て、3つすべてからの洞察で応答できるAIを想像してください。ツール間の切り替えなし。手動での要約なし。あなたが投げかけるすべてを理解する1つのインテリジェントシステム。それがMultimodal AIです。

統一されたAI革命

Multimodal AIは、研究者が単一入力システムの限界に気づいたときに登場しました。初期のAIモデルは、テキストのみまたは画像のみを処理できました。2023年までに、GPT-4VやGoogleのGeminiのような画期的なモデルがすべてを変えました。

Google Researchによると、Multimodal AIは「テキスト、画像、オーディオ、ビデオを含む複数のタイプの入力データを処理し、推論できるモデルを表し、人間が自然に世界を知覚し理解する方法を反映する単一の統一されたアーキテクチャ」を意味します。

画期的な出来事は、OpenAIが2023年9月にVision機能を備えたGPT-4をリリースし、次いで2023年12月にGoogleのGemini、2024年3月にAnthropicのClaude 3がリリースされ、それぞれがAIが最終的に混合メディアで作業する人間の能力に匹敵できることを実証したときに起こりました。

ビジネスリーダーのためのMultimodal AI

ビジネスリーダーにとって、Multimodal AIは、文書を読み、グラフを解釈し、ビデオを見て、通話を聞くことができる専門家を雇うようなものです。すべて同時に、ビジネスが生み出すすべての形式にわたって洞察を統合します。

テキスト、画像、オーディオの別々のスペシャリストがいる場合と、3つすべてを一緒に理解する1人の専門家がいる場合の違いを考えてください。Multimodal専門家は、孤立して作業するスペシャリストが見逃すパターン、つながり、洞察を見ます。

実用的な観点から、Multimodal AIは顧客の通話(オーディオ)を分析し、製品画像をレビューし、サポートチケット(テキスト)を読み、すべてのチャネルで同時にトレンドを特定できます。これは、テキストのみを扱う従来のLarge Language Modelsを大きく超える飛躍を表します。

Multimodal AIの中核コンポーネント

Multimodal AIシステムは、これらの本質的な要素で構成されています:

• 統一エンコーダー(Unified Encoder): テキスト、画像、オーディオ、ビデオなどの異なるデータタイプを、モデルが一緒に処理できる共通の表現に変換します。情報形式の万能翻訳者のようなものです

• Cross-Modal Attention: モデルが異なるタイプの入力間の関係を理解できるようにするメカニズム。オーディオの話し言葉を画像のオブジェクトに接続するようなものです

• 共有推論レイヤー(Shared Reasoning Layer): すべての入力タイプを一緒に考える共通の処理エンジンで、別々の分析ではなく真の統合を可能にします

• モーダルアダプター(Modal Adapters): 各入力タイプの固有の特性を処理しながら、統一されたシステムに入力する専用コンポーネント

• 出力生成(Output Generation): ユースケースに最適なものに応じて、テキストから画像、構造化データまで、複数の形式で応答する能力

Multimodal AIの動作方法

Multimodal AIは、この運用サイクルに従います:

同時取り込み(Simultaneous Ingestion): モデルは、複数の形式にわたる入力を受け取ります。たとえば、製品画像、顧客レビューテキスト、デモビデオをすべて同時に受け取ります

統一処理(Unified Processing): すべての入力を共通の内部表現に変換し、モデルがモダリティ間の関係を理解できるようにします。画像が書かれた説明にどのように関連するかなど

Cross-Modal推論: 複数のタイプのデータにわたるパターンと洞察を分析します。たとえば、肯定的なオーディオセンチメントが特定の視覚的製品機能と相関していることに気づくなど

このサイクルは、モデルがすべてのモダリティにわたるフィードバックから学習し、異なるタイプの情報がどのように接続するかを理解することに熟練していくことで続きます。

Multimodal AIシステムのタイプ

Multimodal AIは異なるビジネス機能に役立ちます:

タイプ1:Vision-Languageモデル 最適な用途:文書理解と視覚分析 主な特徴:テキストと画像をシームレスに組み合わせる 例:チャートとレポートを分析するGPT-4V

タイプ2:Audio-Visualモデル 最適な用途:ビデオ分析と会議インテリジェンス 主な特徴:視覚コンテンツのコンテキストで音声を理解 例:スピーカー識別を伴う自動会議サマリー

タイプ3:Text-Image-Audioシステム 最適な用途:包括的なコンテンツ分析 主な特徴:Generative AIを使用してすべての主要なメディアタイプを一緒に処理 例:混合形式のクエリを処理するGoogle Gemini

タイプ4:Sensor-Fusionモデル 最適な用途:IoTと現実世界のアプリケーション 主な特徴:構造化されたセンサーデータとメディアを組み合わせる 例:カメラと測定を使用した製造品質管理

Multimodal AIが結果を提供

ビジネスがMultimodal AIをデプロイする方法は次のとおりです:

医療の例: Siemens Healthineersは、Multimodal AIを使用して医療画像、検査結果、臨床ノートを一緒に分析し、診断時間を40%削減しながら、単一モダリティシステムが見逃した問題を捕捉しています。

小売の例: Amazonの商品検索は、「この写真のような靴を青で見せて」のようなクエリを理解するためにMultimodal AIを使用し、画像認識とテキスト理解を組み合わせて35%より正確な結果を提供します。

金融サービスの例: JPMorganは、話し言葉、プレゼンテーションスライド、財務文書を同時に処理するMultimodal AIを使用して決算説明会を分析し、アナリストチームより50%速く投資洞察を特定しています。

Multimodal AIの実装

AIの機能を統一する準備はできていますか?

- Large Language Modelsの基礎から始める

- Computer Visionの基本を理解する

- Natural Language Processingについて学ぶ

- 複雑なワークフローのためのAI Orchestrationを検討する

FAQセクション

Multimodal AIについてよくある質問

Multimodal AIとは何ですか?

Multimodal AIとは、人間が自然に世界を理解する方法と同様に、単一の統一されたアーキテクチャでテキスト、画像、オーディオ、ビデオを含む複数のタイプの入力データを処理し、推論できるモデルを指します。

Multimodal AIと従来のAIの違いは何ですか?

従来のAIモデルは1つのタイプのデータ(テキストのみまたは画像のみ)を処理します。Multimodal AIは複数のデータタイプを同時に処理し、それらの間の関係を理解し、形式にわたる洞察を生成します。

Multimodal AIシステムの主なタイプは何ですか?

Vision-Languageモデル(テキストと画像)、Audio-Visualモデル(音声とビデオ)、Text-Image-Audioシステム(すべての主要なメディアタイプ)、Sensor-Fusionモデル(構造化データとメディア)。

Multimodal AIモデルの例は何ですか?

GPT-4V(OpenAI)、Gemini(Google)、Claude 3(Anthropic)、およびCLIP(画像-テキスト)、Whisper(オーディオ)、ImageBind(すべてのモダリティ)のような専門モデル。

関連リソース

Multimodal AIの理解を深めるために、これらの関連概念を探ります:

- Computer Vision - AIが画像を処理し理解する方法

- Neural Networks - Multimodal Systemsを支える基礎アーキテクチャ

- Transformer Architecture - 最新のMultimodalモデルの背後にある技術的基礎

- Embeddings - 異なるデータタイプが共通の表現に変換される方法

外部リソース

- Google Research - Multimodal AI - 統一されたAIモデルの最新の進歩

- Meta AI - Vision and Language - Cross-Modal理解に関する研究

- Microsoft Research - Multimodal Systems - エンタープライズMultimodalアプリケーション

AI Terms Collectionの一部。最終更新:2026-02-09