Apakah Knowledge Distillation? Mendapat Prestasi GPT-4 dengan Bajet

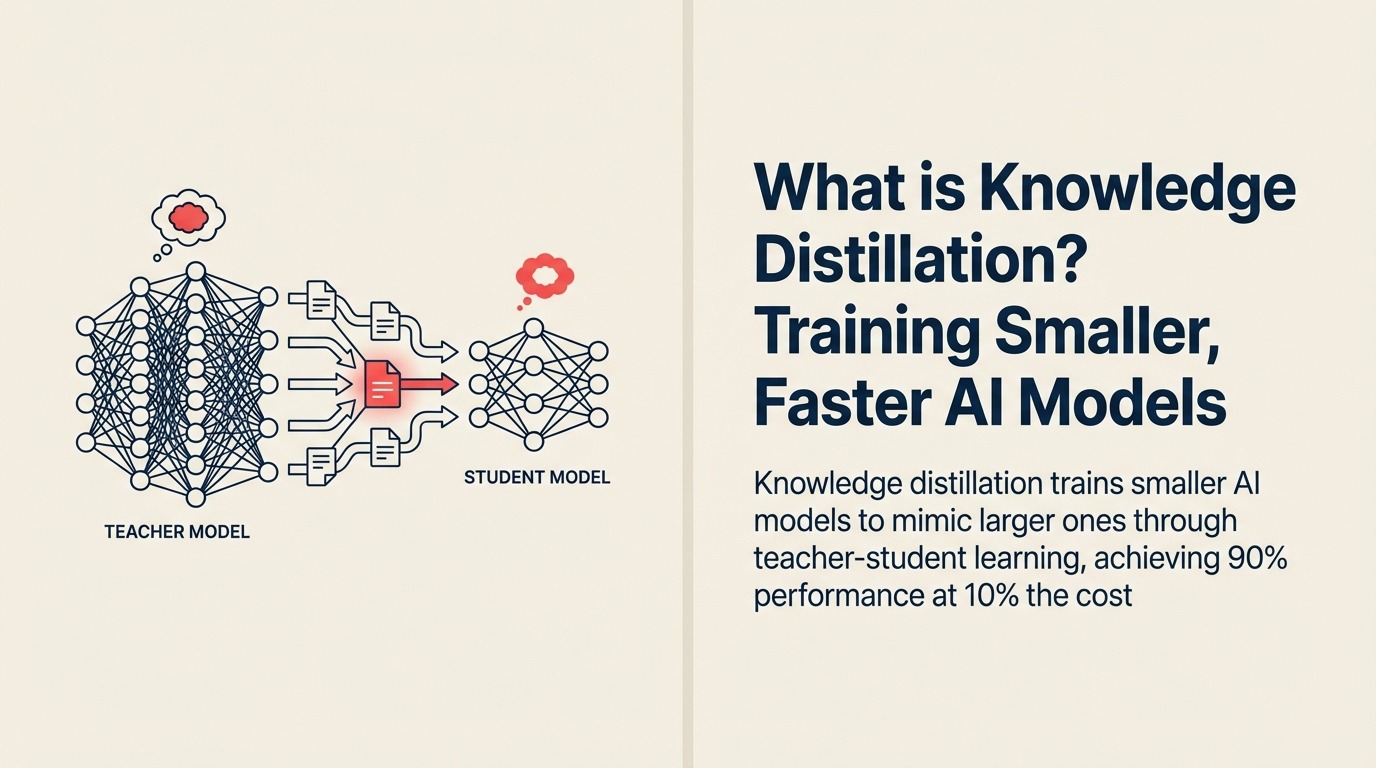

GPT-4 cemerlang tetapi berharga $20 sejuta token. Model khusus kecil berharga $0.20 untuk kerja yang sama tetapi tidak dapat menandingi keupayaan GPT-4. Atau bolehkah? Knowledge distillation telah muncul sebagai teknik yang membolehkan anda memindahkan kecerdasan large language models besar-besaran ke dalam versi padat, pantas, mampu milik—menyampaikan 90% prestasi pada 10% kos untuk kes penggunaan khusus.

GPT-4 cemerlang tetapi berharga $20 sejuta token. Model khusus kecil berharga $0.20 untuk kerja yang sama tetapi tidak dapat menandingi keupayaan GPT-4. Atau bolehkah? Knowledge distillation telah muncul sebagai teknik yang membolehkan anda memindahkan kecerdasan large language models besar-besaran ke dalam versi padat, pantas, mampu milik—menyampaikan 90% prestasi pada 10% kos untuk kes penggunaan khusus.

Dari Monopoli Model Besar kepada Kecerdasan Cekap

Knowledge distillation muncul sebagai teknik terobosan pada 2015 apabila penyelidik mendapati bahawa neural network kecil boleh belajar meniru yang besar dengan mengkaji tingkah laku mereka dan bukannya belajar semula daripada data mentah. Apa yang bermula sebagai rasa ingin tahu akademik menjadi keperluan pengeluaran.

Google Research mentakrifkan knowledge distillation sebagai "proses memindahkan pengetahuan daripada model guru yang besar dan kompleks kepada model pelajar yang lebih kecil dan cekap dengan melatih pelajar untuk menghasilkan semula output dan representasi dalaman guru."

Bidang ini meletup apabila syarikat menyedari mereka boleh mencipta model khusus yang sepadan prestasi GPT-3 untuk tugas khusus sambil berjalan 100x lebih pantas pada perkakasan tempatan—mengubah API cloud mahal kepada deployment edge mampu milik.

Membuat Masuk Akal untuk Pemimpin Perniagaan

Untuk pemimpin perniagaan, knowledge distillation bermakna menangkap kecerdasan model AI terkini dalam versi lebih kecil, pantas, murah yang dioptimumkan untuk kes penggunaan khusus anda—mengurangkan kos sebanyak 80-95% sambil mengekalkan kualiti untuk tugas yang penting kepada perniagaan anda.

Fikirkannya seperti mengupah pakar kanan untuk melatih pasukan pakar. Pasukan tidak akan tahu semua yang pakar tahu, tetapi mereka akan cemerlang dalam tugas khusus yang anda perlukan—dan anda boleh menanggung 10 daripada mereka dengan kos seorang pakar.

Secara praktikalnya, knowledge distillation membolehkan anda menjalankan kecerdasan kelas GPT-4 pada telefon pintar, memproses pertanyaan pelanggan untuk beberapa sen dan bukan dolar, dan menggunakan AI yang berfungsi offline tanpa mengorbankan ketepatan untuk kes penggunaan anda.

Elemen Utama Knowledge Distillation

Knowledge distillation terdiri daripada komponen penting ini:

• Teacher Model: Model besar dan berkuasa (seperti GPT-4 atau Claude) yang mencapai prestasi terkini tetapi terlalu mahal atau perlahan untuk deployment pengeluaran

• Student Model: Model lebih kecil dan pantas direka untuk belajar daripada pengetahuan guru dan bukannya daripada data latihan mentah, dioptimumkan untuk kecekapan

• Soft Targets: Taburan kebarangkalian guru ke atas jawapan yang mungkin (bukan sahaja jawapan akhir), menyediakan isyarat pembelajaran lebih kaya tentang ketidakpastian dan nuansa

• Distillation Training: Pelajar belajar sepadan kedua-dua jawapan akhir guru dan corak penaakulannya, menangkap pendekatan membuat keputusan guru

• Task Specialization: Model pelajar memberi tumpuan kepada kes penggunaan khusus di mana ia boleh mencapai prestasi hampir-guru dan bukannya cuba kecerdasan umum

Proses Knowledge Distillation

Melaksanakan knowledge distillation mengikuti langkah-langkah ini:

Pilih Guru dan Pelajar: Pilih model guru berkuasa untuk domain anda dan reka bentuk seni bina pelajar yang lebih kecil (10-100x parameter lebih sedikit) yang boleh berjalan dengan cekap dalam persekitaran anda

Jana Data Latihan: Jalankan contoh latihan anda melalui model guru, mengumpul outputnya, taburan kebarangkalian, dan pengaktifan perantaraan untuk menangkap corak membuat keputusannya

Latih Pelajar untuk Meniru: Latih model pelajar untuk menghasilkan semula output dan penaakulan guru, menggunakan kedua-dua jawapan betul dan tahap keyakinan guru untuk memindahkan pemahaman bernuansa

Proses ini mengubah model 175 bilion parameter yang berharga $50/jam untuk berjalan menjadi model 1 bilion parameter yang mencapai 95% prestasi pada $0.50/jam.

Jenis Knowledge Distillation

Knowledge distillation datang dalam beberapa pendekatan:

Jenis 1: Response-Based Distillation Terbaik untuk: Pelaksanaan pantas dan tugas mudah Ciri utama: Pelajar belajar daripada output akhir guru Contoh: Melatih chatbot perkhidmatan pelanggan untuk sepadan jawapan GPT-4 untuk soalan biasa

Jenis 2: Feature-Based Distillation Terbaik untuk: Menangkap pemahaman lebih mendalam Ciri utama: Pelajar belajar daripada representasi dalaman guru Contoh: Mencipta pengelas imej khusus yang meniru pengekstrakan ciri model penglihatan besar

Jenis 3: Relation-Based Distillation Terbaik untuk: Tugas penaakulan kompleks Ciri utama: Pelajar belajar hubungan antara konsep Contoh: Membina model analisis kontrak yang menangkap pemahaman model besar tentang interaksi klausa undang-undang

Jenis 4: Multi-Teacher Distillation Terbaik untuk: Menggabungkan berbilang keupayaan Ciri utama: Pelajar belajar daripada beberapa guru khusus Contoh: Mencipta pembantu kecerdasan perniagaan dilatih oleh pakar berasingan dalam kewangan, operasi, dan jualan

Knowledge Distillation dalam Tindakan

Begini cara perniagaan sebenarnya menggunakan knowledge distillation:

Contoh Customer Support: Intercom menyuling pengetahuan GPT-3.5 ke dalam model 125 juta parameter untuk menjawab soalan produk. Model yang disuling mencapai 92% ketepatan GPT-3.5 sambil berjalan 40x lebih pantas dan berharga 95% lebih murah—membolehkan respons masa nyata pada server edge.

Contoh Legal Tech: LawGeex mencipta model semakan kontrak khusus dengan menyuling pengetahuan daripada GPT-4 merentas 50,000 dokumen undang-undang. Model yang terhasil sepadan ketepatan GPT-4 untuk analisis kontrak sambil berjalan on-premise, melindungi kerahsiaan klien pada 10% kos.

Contoh E-commerce: Amazon menggunakan knowledge distillation untuk mencipta model cadangan produk yang menangkap kecerdasan sistem deep learning besar mereka sambil berjalan dengan cekap pada aplikasi mudah alih—menyampaikan cadangan diperibadikan dalam 50ms dan bukan 2 saat.

Laluan Anda kepada Penguasaan Knowledge Distillation

Bersedia untuk mencipta model AI cekap dan khusus?

- Fahami kecekapan model dengan Quantization

- Terokai pengoptimuman pengeluaran melalui Inference Optimization

- Ketahui tentang latihan model dengan Transfer Learning

Ketahui Lebih Lanjut

Kembangkan pemahaman anda tentang konsep AI berkaitan:

- Model Compression - Teknik lain untuk model lebih kecil

- Fine-tuning - Menyesuaikan model pra-latih

- Pruning - Membuang komponen model tidak diperlukan

- Neural Architecture Search - Mereka bentuk struktur model cekap

Sumber Luar

- Google Research on Model Compression - Kertas akademik tentang teknik distillation

- Hugging Face Distillation Tutorials - Panduan praktikal untuk melaksanakan knowledge distillation

- OpenAI Model Efficiency Research - Strategi deployment AI kos efektif

Bahagian FAQ

Soalan Lazim tentang Knowledge Distillation

Apakah Knowledge Distillation?

Knowledge distillation adalah proses melatih model pelajar lebih kecil dan pantas untuk meniru tingkah laku dan pengetahuan model guru yang lebih besar dan berkuasa, mencapai prestasi serupa pada sebahagian kecil kos pengiraan.

Berapa kecilkah model pelajar boleh jadi?

Model pelajar biasanya 10-100x lebih kecil daripada guru. Pendekatan biasa ialah menyuling GPT-3 (175B parameter) ke dalam model khusus 1-7B parameter yang sepadan prestasi untuk tugas khusus sambil berjalan 50-100x lebih pantas.

Apakah perbezaan antara knowledge distillation dan fine-tuning?

Fine-tuning menyesuaikan model pra-latih kepada data baru menggunakan seni bina model yang sama. Knowledge distillation memindahkan pengetahuan daripada model besar kepada seni bina lebih kecil dan berbeza—mencipta model lebih cekap dioptimumkan untuk deployment.

Adakah model pelajar sepadan prestasi guru?

Untuk tugas sempit dan jelas, model pelajar biasanya mencapai 85-95% prestasi guru. Pertukaran adalah keluasan: pelajar cemerlang dalam tugas khusus tetapi kekurangan keupayaan umum guru.

Bila saya patut guna knowledge distillation?

Gunakan knowledge distillation bila anda ada kos inference tinggi, perlukan masa tindak balas pantas, nak deploy pada peranti edge, atau perlukan prestasi tugas khusus tanpa keupayaan model umum. Ia penting untuk menskalakan aplikasi AI dengan menguntungkan.

Sebahagian daripada AI Terms Collection. Kemaskini terakhir: 2026-02-09

Founder & CEO

On this page

- Dari Monopoli Model Besar kepada Kecerdasan Cekap

- Membuat Masuk Akal untuk Pemimpin Perniagaan

- Elemen Utama Knowledge Distillation

- Proses Knowledge Distillation

- Jenis Knowledge Distillation

- Knowledge Distillation dalam Tindakan

- Laluan Anda kepada Penguasaan Knowledge Distillation

- Ketahui Lebih Lanjut

- Sumber Luar

- Bahagian FAQ