Embeddingsとは?AIに単語の背後にある意味を教える

AIはどのようにして「car」と「automobile」が同じ意味であることを知るのでしょうか?あるいは、「king」が「queen」に関係するのは、「man」が「woman」に関係するのと同じであることを理解するのでしょうか?その答えがembeddings(埋め込み)です - 単語を意味を捉えた数値に変換する数学的魔法により、AIは人間のように言語を理解できるようになります。

AIはどのようにして「car」と「automobile」が同じ意味であることを知るのでしょうか?あるいは、「king」が「queen」に関係するのは、「man」が「woman」に関係するのと同じであることを理解するのでしょうか?その答えがembeddings(埋め込み)です - 単語を意味を捉えた数値に変換する数学的魔法により、AIは人間のように言語を理解できるようになります。

技術的定義

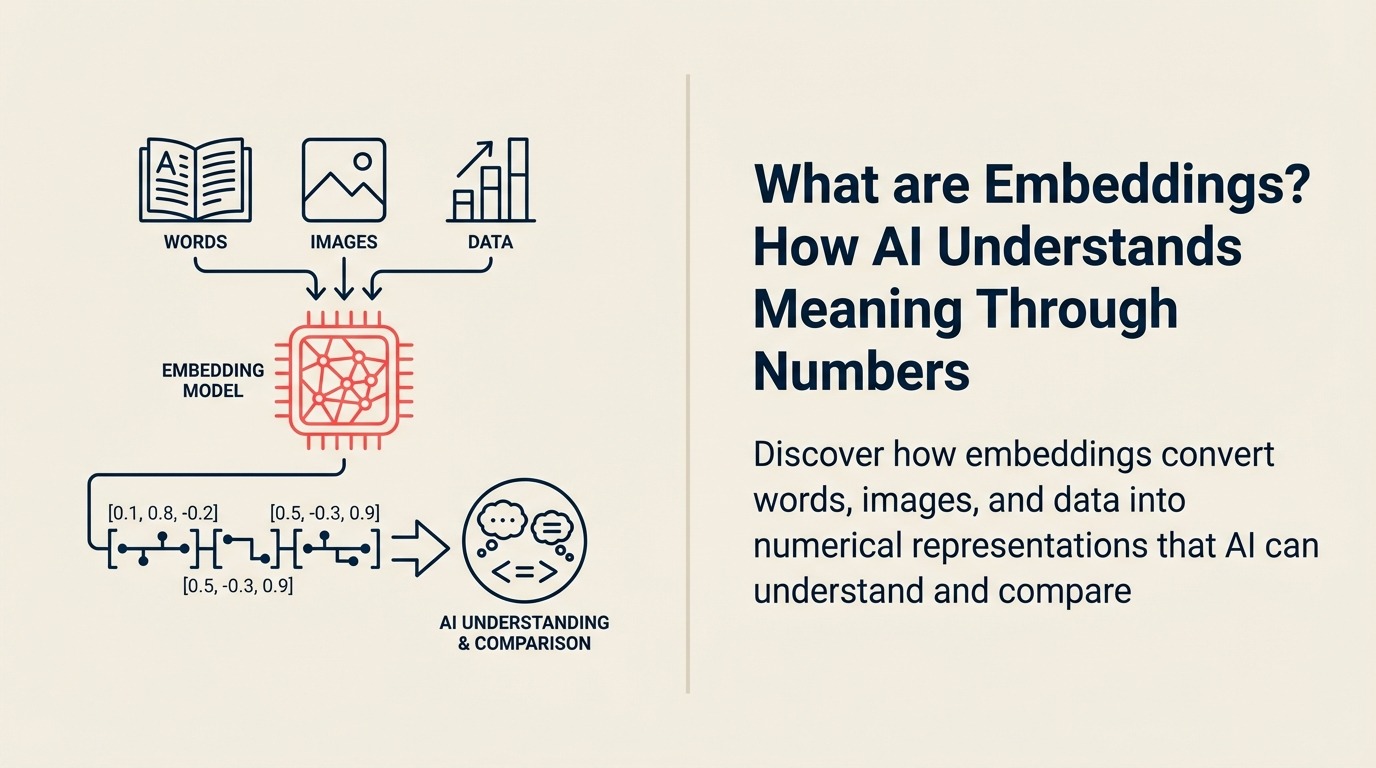

Embeddingsは、離散的なオブジェクト(単語、文、画像など)を連続的なベクトル空間における密な数値表現であり、類似したアイテムが近くの点にマッピングされます。これらの高次元ベクトル(通常256~1536個の数値)は、意味的意味と関係性をエンコードします。

Google Researchによると、「Embeddingsは現代の自然言語処理における最も重要な概念の一つであり、単語に数学的ツールを使用し、それらの関係性を理解することを可能にします。」画期的な発見は、意味的関係がベクトル演算を通じて捉えられることを研究者が発見した時でした。

有名な例:vector("King") - vector("Man") + vector("Woman") ≈ vector("Queen") は、embeddingsがどのように概念的関係を数学的に捉えるかを示しています。

ビジネスでの意味

ビジネスリーダーにとって、embeddingsは意味のGPS座標のようなもので、概念がどれだけ近いか遠いかをAIに伝え、セマンティック検索、パーソナライズされたレコメンデーション、大規模なインテリジェントな分類を可能にします。

製品カタログをアルファベット順ではなく、実際の類似性で整理することを想像してください。Embeddingsはこれを自動的に行い、「laptop」が「notebook paper」よりも「notebook computer」に近いことを明示的なプログラミングなしで理解します。

実用的には、embeddingsは類似した顧客サポートチケットを見つけ、関連製品を推奨し、重複コンテンツを検出し、「affordable attorneys」の検索が「cheap lawyers」も表示すべきであることを理解するAIを支えています。

Embeddingsの仕組み

埋め込みプロセス:

• 入力処理: テキスト、画像、その他のデータが標準形式(テキストの場合はトークンなど)に変換される

• ニューラルネットワークエンコーディング: ディープラーニングモデルが、大規模なデータセットからパターンを学習し、入力を密なベクトルに変換

• ベクトル表現: 各入力が数値のリスト(例:[0.2, -0.5, 0.8...])となり、「意味空間」における位置を表現

• 類似度計算: ベクトル間の数学的距離が意味的類似性を示す - 近いベクトルはより類似した概念を意味

• 下流アプリケーション: これらのベクトルが検索、分類、クラスタリング、その他のAIタスクに供給される

Embeddingsの種類

さまざまなデータに対応するさまざまなembeddings:

タイプ1:Word Embeddings(単語埋め込み) 例:Word2Vec、GloVe 用途:個々の単語の理解 応用:スペルチェック、オートコンプリート

タイプ2:Sentence/Document Embeddings(文/文書埋め込み) 例:BERT、Sentence-BERT 用途:完全なコンテキストの捉え 応用:文書検索、要約

タイプ3:Image Embeddings(画像埋め込み) 例:ResNet、CLIP 用途:コンピュータビジョン理解 応用:画像検索、製品マッチング

タイプ4:Multimodal Embeddings(マルチモーダル埋め込み) 例:CLIP、ALIGN 用途:クロスメディア理解 応用:テキストから画像への検索

ビジネスアプリケーション

実際のソリューションを支えるembeddings:

Eコマースの例: Amazonの製品embeddingsは、「running shoes」を検索する顧客が「athletic socks」や「fitness trackers」も欲しがる可能性があることを理解し、embeddings基盤のレコメンデーションを通じて購入の35%を促進しています。

カスタマーサービスの例: Zendeskはembeddingsを使用してチケットを適切な部門に自動ルーティングし、「can't log in」と「password not working」が類似した問題であることを理解し、応答時間を40%短縮しています。

コンテンツ管理の例: Netflixのembeddingsは、ジャンルを超えて視聴嗜好を理解し、「Stranger Things」のファンがテーマ的類似性に基づいて「Dark」を楽しむかもしれないことを認識し、エンゲージメントを25%向上させています。

セマンティック検索の力

Embeddingsは検索を革命化します:

従来の検索:

- 完全なキーワードにマッチ

- 同義語とコンテキストを見逃す

- マッチする単語を含む無関係な結果を返す

Embeddingsベースの検索:

- 意味と意図を理解

- 概念的に類似したコンテンツを見つける

- 言語をまたいで自然に機能

例:「budget hotel Paris」の検索が、キーワードマッチングなしで「affordable accommodation in French capital」も見つけます。

Embeddingデータベース

大規模でembeddingsを保存・検索する:

• ベクトルデータベース: 数百万のembeddings全体での類似検索に最適化された専用システム(Pinecone、Weaviate、Qdrant)

• インデックス方法: HNSWやIVFなどの技術が数十億のベクトルを通じてほぼ即座の検索を可能に

• ハイブリッド検索: Embeddingsと従来の検索を組み合わせて両方の長所を実現

• リアルタイム更新: 現代のシステムは新しいコンテンツが到着するとembeddingsを更新

実装上の考慮事項

成功のための重要な要素:

品質要因:

- Embeddingモデルの選択

- ドメイン固有のファインチューニング

- Embedding次元のトレードオフ

- 更新頻度のニーズ

技術要件:

- 高次元ベクトルのストレージ

- エンコーディングのための計算リソース

- 高速類似検索インフラ

- 既存システムとの統合

ビジネスメトリクス:

- 検索関連性の改善

- レコメンデーションクリック率

- サポートチケットルーティング精度

- 顧客満足度スコア

一般的なEmbeddingの課題

落とし穴と解決策:

• ドメインミスマッチ: 汎用的なembeddingsが専門コンテンツで失敗 → 解決策:業界データでファインチューニング

• 言語障壁: 英語で訓練されたembeddingsが他の言語で苦戦 → 解決策:多言語モデル

• 概念のドリフト: 意味が時間とともに変化 → 解決策:定期的な再訓練と監視

• スケールの問題: 数十億のembeddingsが検索を遅くする → 解決策:近似最近傍アルゴリズム

Embeddingsの活用

セマンティックAIへの道:

- トークン化から始めて入力を理解

- ストレージのためのベクトルデータベースを探索

- セマンティック検索アプリケーションについて学ぶ

- Retrieval-Augmented Generation (RAG)がembeddingsをどのように使用するかを理解

- 大規模言語モデルがembeddingsをどのように活用するかを見る

外部リソース

- OpenAI Embeddingsガイド - テキストembeddingsの作成と使用

- Hugging Face Sentence Transformers - 事前訓練されたembeddingモデル

- Pinecone Vector Database - 本番環境でのembedding検索インフラ

よくある質問

Embeddingsに関するよくある質問

Embeddingsとは何ですか?

Embeddingsは、単語や画像などのデータの数値表現(ベクトル)で、意味的意味を捉え、類似したアイテムが数学空間で類似したベクトルを持つようにします。

Embeddingsと従来のエンコーディングの違いは何ですか?

従来のエンコーディングは意味関係のない任意の数値を使用します。Embeddingsは類似した概念をベクトル空間で近くに配置し、類似検索などの意味的操作を可能にします。

Embeddingsの主な種類は何ですか?

Word Embeddings(個々の単語)、Sentence/Document Embeddings(完全なコンテキスト)、Image Embeddings(視覚的理解)、Multimodal Embeddings(テキスト-画像などのクロスメディア)です。

ベクトルデータベースとは何ですか?

ベクトルデータベースは、embeddingsの保存と検索に最適化された専用システムで、数百万または数十億の高次元ベクトル全体での高速類似検索を可能にします。

AI用語集の一部。最終更新:2026-01-11