Bias in AI(AIにおけるバイアス)とは?アルゴリズムが人間の偏見を受け継ぐとき

あなたのAIシステムが地域全体からのローン申請を拒否したばかりです。または、リーダーシップの役割に男性候補者のみを推奨しました。これらはプログラミングエラーではありません。実際のBias in AIであり、ブランドの評判を破壊しながら法的責任を生み出す可能性があります。

あなたのAIシステムが地域全体からのローン申請を拒否したばかりです。または、リーダーシップの役割に男性候補者のみを推奨しました。これらはプログラミングエラーではありません。実際のBias in AIであり、ブランドの評判を破壊しながら法的責任を生み出す可能性があります。

AI Biasの理解

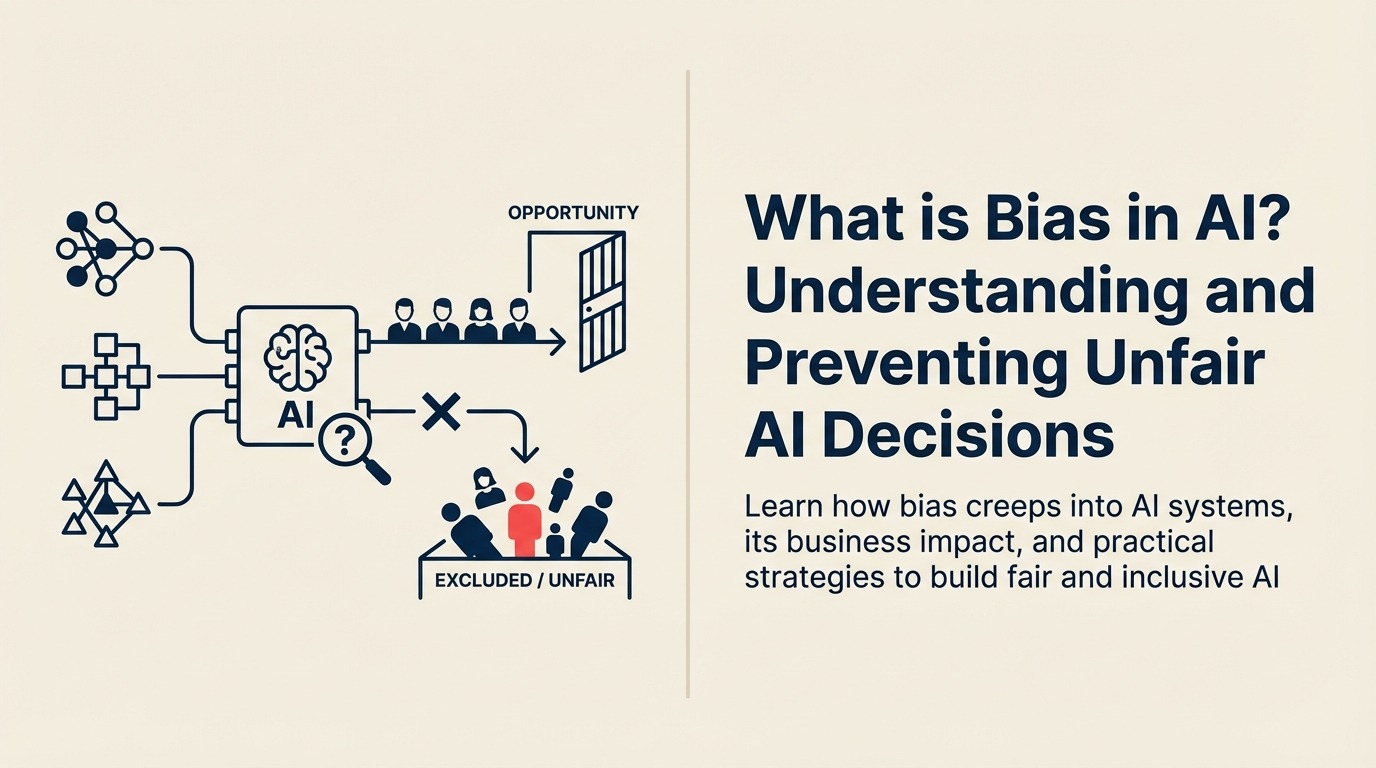

AI BiasはAIシステムが人種、性別、年齢、場所などの無関係な特性に基づいて特定のグループや個人を体系的に不利にする決定を下すときに発生します。これは、AIが本質的に偏見を持っているからではなく、バイアスのあるデータや欠陥のある設計選択から学習するためです。

MITの研究者によると、「AI Biasはトレーニングデータ、アルゴリズム設計、デプロイコンテキストに存在する人間のバイアスを反映し増幅します」。研究は、顔認識などのComputer Visionシステムが肌の色が濃い個人に対して最大35%高いエラー率を持つことを示し、履歴書スクリーニングAIが男性候補者への好みを示しています。

課題は、AI Biasがしばしば数学的客観性の背後に隠れ、人間の偏見よりも検出が困難になることです。

ビジネスインパクト

ビジネスリーダーにとって、AI Biasは三重の脅威を表します:差別的慣行からの法的責任、世論の反発からのブランド損傷、価値ある顧客や人材を排除することによる逸失機会です。

AIを、会社の過去の決定からすべてを学習した新しい従業員として想像してください。それらの決定にバイアスが含まれていた場合(意図的でなくても)、AIはそれらのバイアスを永続化し、行うすべての決定にスケールします。

実際には、バイアスのあるAIは差別訴訟、規制罰金、顧客ボイコット、資格のある個人や収益性の高いセグメントを誤って排除することによる市場機会の損失につながる可能性があります。

AI Biasの原因

Biasは複数の経路を通じてAIシステムに入ります:

• Historical Bias(歴史的バイアス): トレーニングデータが過去の差別を反映 - 技術職における女性が少ない時代からの雇用データが性別の不均衡を強化

• Representation Bias(表現バイアス): 特定のグループを過小評価するデータセット - 主に白人の顔でトレーニングされた顔認識が他の人には失敗。適切なData Curationがこれに対処するために不可欠

• Measurement Bias(測定バイアス): 保護された属性と相関するプロキシの使用 - 融資決定における人種のプロキシとしてのZIPコード

• Aggregation Bias(集約バイアス): 平均的には良く機能するが特定のサブグループには失敗する万能モデル

• Evaluation Bias(評価バイアス): 排除されたグループに影響するバイアスを見逃す非代表的なデータでのテスト

Biasの現れ方

AI Biasはさまざまな形で現れます:

Allocation Bias(配分バイアス): AIが求人面接、ローン、医療リソースなどの機会やリソースを不公平に配分

Quality-of-Service Bias(サービス品質バイアス): AIが特定のグループに対してより悪いパフォーマンスを示す、アクセントで苦戦するConversational AI音声アシスタントなど

Stereotyping Bias(ステレオタイプバイアス): AIが有害なステレオタイプを強化、医師が男性であると仮定する翻訳システムなど

Representation Bias(表現バイアス): AIが特定のグループを認識または含めることに失敗、より暗い肌のトーンを識別しない画像タガーなど

各形式は、バイアスのある決定がより多くのバイアスのあるトレーニングデータを作成するため、時間とともに複合する可能性があります。

有害なBiasのタイプ

監視すべき重要なBias:

タイプ1:Demographic Bias(人口統計バイアス) 影響:保護された特性(人種、性別、年齢) 例:少数民族の痛みを過小治療する医療AI インパクト:法的責任、医療格差

タイプ2:Socioeconomic Bias(社会経済的バイアス) 影響:所得レベル、教育、場所 例:低所得地域に過剰請求する保険AI インパクト:市場排除、評判損傷

タイプ3:Behavioral Bias(行動バイアス) 影響:個人の選択と好み 例:雇用ギャップにペナルティを課す採用AI インパクト:人材損失、差別クレーム

タイプ4:Technological Bias(技術的バイアス) 影響:デバイスまたはプラットフォームユーザー 例:高価な携帯電話でのみ機能するAI機能 インパクト:デジタルディバイド、顧客損失

実際の結果

困難な方法でBiasの教訓を学んでいる企業:

テクノロジー大手の例: Amazonは、2018年に10年間の男性優位な雇用データから学習したバイアスを発見した後、「女性」を含む履歴書(「女性のチェスクラブキャプテン」など)にペナルティを課していたAI採用ツールを廃棄しました。

金融サービスの例: Apple CardはAIを活用したクレジット決定が同一の財務状況を持つ女性よりも男性に20倍高いクレジット限度額を与えたときに調査に直面し、規制の精査とブランド損傷をもたらしました。

医療の例: 大手医療システムのAIは、(アクセス格差の影響を受ける)医療コストを健康ニーズのプロキシとして使用することで、より病気の黒人患者よりも健康な白人患者にケア管理を割り当てました。

AI Biasの検出

隠されたBiasを明らかにする方法:

統計的テスト:

- 異なる影響分析

- グループ間の公平性指標

- 複数の属性の交差テスト

監査アプローチ:

- 多様なチームによるRed Teamテスト

- エッジケースのための敵対的テスト

- 本番環境での継続的なModel Monitoring

透明性ツール:

- モデル解釈可能性技術

- 決定のドキュメンテーション

- Biasスコアカード

Biasの防止と緩和

公正なAIのための戦略:

データレベル:

- 多様で代表的なデータセット

- Biasを認識したデータ収集

- バランスのための合成データ

アルゴリズムレベル:

- トレーニングにおける公平性制約

- Debiasing技術

- 複数モデルアプローチ

人間レベル:

- 多様な開発チーム

- 倫理審査委員会

- Human-in-the-loopステークホルダーの関与

プロセスレベル:

- 定期的なBias監査

- 明確な説明責任

- 透明なドキュメンテーション

公正なAIの構築

倫理的なAIへのロードマップ:

- AI Ethicsの原則から始める

- 透明性のためにExplainable AIを実装

- AI Governanceフレームワークを確立

- Predictive Analyticsを責任を持って活用

関連コンセプト

理解を深めるために、これらの関連するAI用語を探索してください:

- Supervised Learning - ラベル付けされたトレーニングデータがAI動作をどのように形成するかを理解

- Deep Learning - Neural Networkアーキテクチャとその潜在的なBiasについて学習

- Neural Networks - これらのシステムがデータからパターンを学習する方法を発見

外部リソース

- AI Fairness 360 - IBMの公平性ツールキット

- What-If Tool - GoogleのBias検出ツール

- Partnership on AI - 責任あるAIに関する業界協力

FAQ

Bias in AIに関するよくある質問

Bias in AIとは何ですか?

Bias in AIは、Machine Learningシステムが人種、性別、年齢などの無関係な特性に基づいて特定のグループを体系的に不利にする決定を下すときに発生し、多くの場合バイアスのあるトレーニングデータや欠陥のある設計選択から学習します。

AI BiasとHuman Biasの違いは何ですか?

Human Biasは個々の決定に影響します。AI Biasは人間の偏見を数百万の決定に自動的にスケールし、数学的客観性として現れながら、より体系的で検出が困難になります。

AI Biasの5つの主な原因は何ですか?

Historical Bias(トレーニングデータが過去の差別を反映)、Representation Bias(データセットで過小評価されたグループ)、Measurement Bias(保護された属性のプロキシを使用)、Aggregation Bias(万能モデル)、Evaluation Bias(非代表的なデータでのテスト)です。

AIにおける有害なBiasの4つのタイプは何ですか?

Demographic Bias(保護された特性に影響)、Socioeconomic Bias(所得/教育レベルに影響)、Behavioral Bias(個人の選択に影響)、Technological Bias(デバイス/プラットフォームユーザーに影響)です。

企業はどのようにAI Biasを防止できますか?

Dataレベル(多様なデータセット)、Algorithmレベル(公平性制約)、Humanレベル(多様なチームと倫理委員会)、Processレベル(定期的な監査と明確な説明責任)を通じて。

[AI Terms Collection]の一部。最終更新: 2026-01-11