O Que é Knowledge Distillation? Obtendo Desempenho GPT-4 com Orçamento Limitado

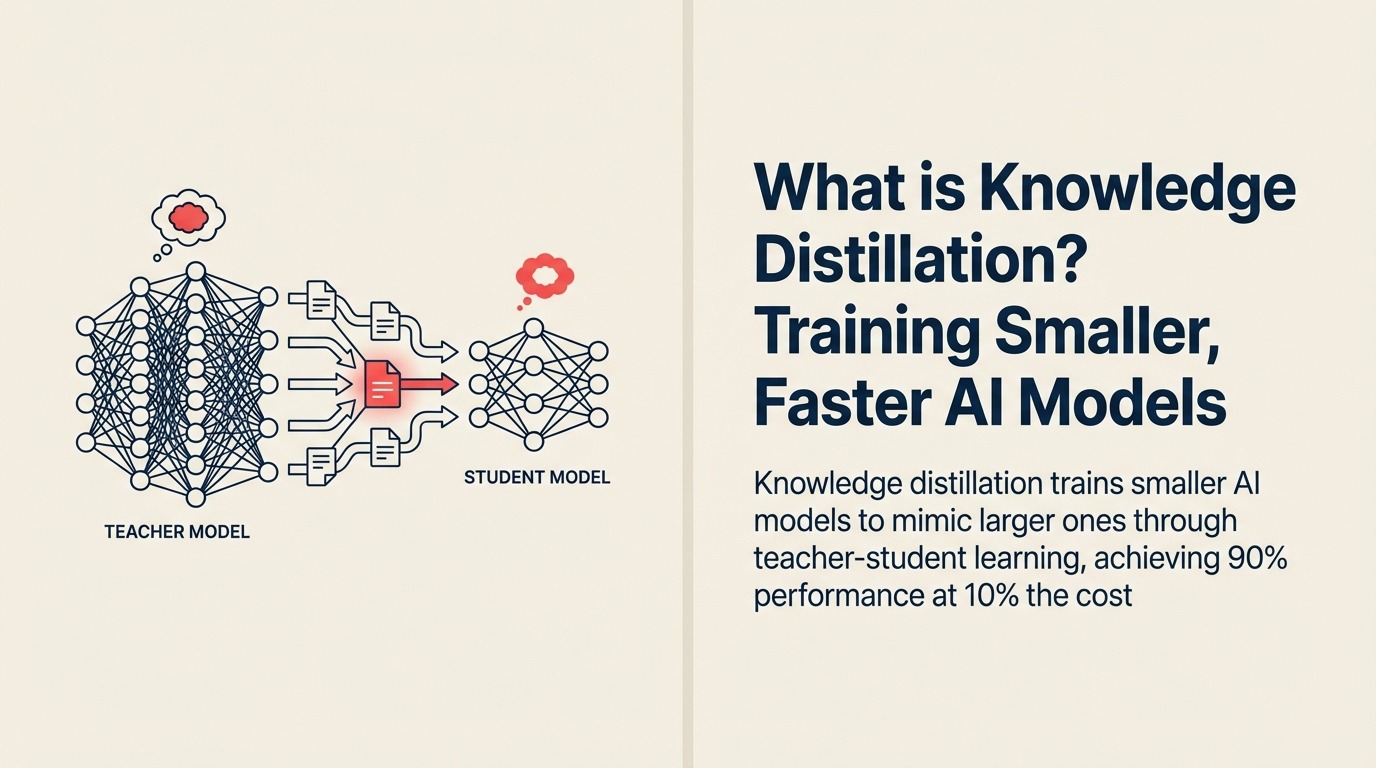

GPT-4 é brilhante mas custa $20 por milhão de tokens. Um modelo especializado minúsculo custa $0.20 para o mesmo trabalho, mas não pode igualar as capacidades do GPT-4. Ou pode? Knowledge distillation emergiu como a técnica que permite transferir a inteligência de large language models massivos para versões compactas, rápidas e acessíveis—entregando 90% do desempenho a 10% do custo para casos de uso específicos.

GPT-4 é brilhante mas custa $20 por milhão de tokens. Um modelo especializado minúsculo custa $0.20 para o mesmo trabalho, mas não pode igualar as capacidades do GPT-4. Ou pode? Knowledge distillation emergiu como a técnica que permite transferir a inteligência de large language models massivos para versões compactas, rápidas e acessíveis—entregando 90% do desempenho a 10% do custo para casos de uso específicos.

De Monopólio de Modelos Grandes a Inteligência Eficiente

Knowledge distillation emergiu como uma técnica revolucionária em 2015 quando pesquisadores descobriram que pequenas redes neurais poderiam aprender a imitar grandes estudando seu comportamento ao invés de reaprender a partir de dados brutos. O que começou como curiosidade acadêmica se tornou necessidade de produção.

Google Research define knowledge distillation como "o processo de transferir conhecimento de um modelo professor grande e complexo para um modelo aluno menor e mais eficiente, treinando o aluno para reproduzir as saídas e representações internas do professor."

O campo explodiu quando empresas perceberam que podiam criar modelos especializados que igualavam desempenho do GPT-3 para tarefas específicas enquanto rodavam 100x mais rápido em hardware local—transformando APIs de nuvem caras em implantações edge acessíveis.

Fazendo Sentido para Líderes Empresariais

Para líderes empresariais, knowledge distillation significa capturar a inteligência de modelos de IA de ponta em versões menores, mais rápidas e baratas otimizadas para seu caso de uso específico—reduzindo custos em 80-95% enquanto mantém qualidade para as tarefas que importam para seu negócio.

Pense nisso como contratar um especialista sênior para treinar uma equipe especialista. A equipe não saberá tudo que o especialista sabe, mas se destacará nas tarefas específicas que você precisa—e você pode contratar 10 deles pelo custo de um especialista.

Em termos práticos, knowledge distillation permite que você rode inteligência classe GPT-4 em smartphones, processe consultas de clientes por centavos em vez de dólares e implante IA que funciona offline sem sacrificar precisão para seu caso de uso.

Elementos-Chave do Knowledge Distillation

Knowledge distillation consiste nestes componentes essenciais:

• Modelo Professor: Um modelo grande e poderoso (como GPT-4 ou Claude) que alcança desempenho de ponta, mas é muito caro ou lento para implantação em produção

• Modelo Aluno: Um modelo menor e mais rápido projetado para aprender do conhecimento do professor ao invés de dados brutos de treinamento, otimizado para eficiência

• Soft Targets: Distribuições de probabilidade do professor sobre respostas possíveis (não apenas a resposta final), fornecendo sinais de aprendizado mais ricos sobre incerteza e nuance

• Treinamento de Destilação: O aluno aprende a combinar tanto as respostas finais do professor quanto seus padrões de raciocínio, capturando a abordagem de tomada de decisão do professor

• Especialização de Tarefa: O modelo aluno foca em casos de uso específicos onde pode alcançar desempenho próximo ao do professor ao invés de tentar inteligência geral

O Processo de Knowledge Distillation

Implementar knowledge distillation segue estes passos:

Selecionar Professor e Aluno: Escolha um modelo professor poderoso para seu domínio e projete uma arquitetura aluno menor (10-100x menos parâmetros) que possa rodar eficientemente em seu ambiente

Gerar Dados de Treinamento: Execute seus exemplos de treinamento através do modelo professor, coletando suas saídas, distribuições de probabilidade e ativações intermediárias para capturar seus padrões de tomada de decisão

Treinar Aluno para Imitar: Treine o modelo aluno para reproduzir as saídas e raciocínio do professor, usando tanto respostas corretas quanto níveis de confiança do professor para transferir compreensão nuançada

Este processo transforma um modelo de 175 bilhões de parâmetros que custa $50/hora para rodar em um modelo de 1 bilhão de parâmetros que alcança 95% do desempenho a $0.50/hora.

Tipos de Knowledge Distillation

Knowledge distillation vem em várias abordagens:

Tipo 1: Destilação Baseada em Resposta Melhor para: Implementação rápida e tarefas simples Característica principal: Aluno aprende das saídas finais do professor Exemplo: Treinar chatbot de atendimento ao cliente para combinar respostas do GPT-4 para perguntas comuns

Tipo 2: Destilação Baseada em Características Melhor para: Capturar compreensão mais profunda Característica principal: Aluno aprende das representações internas do professor Exemplo: Criar classificador de imagem especializado que imita extração de características de um modelo de visão grande

Tipo 3: Destilação Baseada em Relação Melhor para: Tarefas de raciocínio complexo Característica principal: Aluno aprende relações entre conceitos Exemplo: Construir modelo de análise de contratos que captura compreensão de um modelo grande sobre interações de cláusulas legais

Tipo 4: Destilação Multi-Professor Melhor para: Combinar múltiplas capacidades Característica principal: Aluno aprende de vários professores especializados Exemplo: Criar assistente de business intelligence treinado por especialistas separados em finanças, operações e vendas

Knowledge Distillation em Ação

Veja como empresas realmente usam knowledge distillation:

Exemplo Suporte ao Cliente: Intercom destilou conhecimento do GPT-3.5 em um modelo de 125 milhões de parâmetros para responder perguntas sobre produtos. O modelo destilado alcança 92% da precisão do GPT-3.5 enquanto roda 40x mais rápido e custa 95% menos—possibilitando respostas em tempo real em servidores edge.

Exemplo Legal Tech: LawGeex criou um modelo especializado de revisão de contratos destilando conhecimento do GPT-4 através de 50.000 documentos legais. O modelo resultante iguala precisão do GPT-4 para análise de contratos enquanto roda on-premise, protegendo confidencialidade do cliente a 10% do custo.

Exemplo E-commerce: Amazon usa knowledge distillation para criar modelos de recomendação de produtos que capturam a inteligência de seus sistemas massivos de deep learning enquanto rodam eficientemente em apps mobile—entregando recomendações personalizadas em 50ms em vez de 2 segundos.

Seu Caminho para Maestria em Knowledge Distillation

Pronto para criar modelos de IA eficientes e especializados?

- Entenda eficiência de modelo com Quantização

- Explore otimização de produção via Otimização de Inferência

- Aprenda sobre treinamento de modelo com Transfer Learning

Saiba Mais

Expanda sua compreensão de conceitos relacionados de IA:

- Model Compression - Outras técnicas para modelos menores

- Fine-tuning - Personalizando modelos pré-treinados

- Pruning - Removendo componentes desnecessários do modelo

- Neural Architecture Search - Projetando estruturas de modelo eficientes

Recursos Externos

- Google Research on Model Compression - Papers acadêmicos sobre técnicas de destilação

- Hugging Face Distillation Tutorials - Guias práticos para implementar knowledge distillation

- OpenAI Model Efficiency Research - Estratégias de implantação de IA econômica

Seção de Perguntas Frequentes

Perguntas Frequentes sobre Knowledge Distillation

O que é Knowledge Distillation?

Knowledge distillation é o processo de treinar um modelo aluno menor e mais rápido para imitar o comportamento e conhecimento de um modelo professor maior e mais poderoso, alcançando desempenho similar a uma fração do custo computacional.

Quanto menor o modelo aluno pode ser?

Modelos alunos são tipicamente 10-100x menores que professores. Uma abordagem comum é destilar GPT-3 (175B parâmetros) em modelos especializados de 1-7B parâmetros que igualam desempenho para tarefas específicas enquanto rodam 50-100x mais rápido.

Qual é a diferença entre knowledge distillation e fine-tuning?

Fine-tuning adapta um modelo pré-treinado a novos dados usando a mesma arquitetura de modelo. Knowledge distillation transfere conhecimento de um modelo grande para uma arquitetura menor e diferente—criando um modelo mais eficiente otimizado para implantação.

O modelo aluno iguala desempenho do professor?

Para tarefas estreitas e bem definidas, modelos alunos tipicamente alcançam 85-95% do desempenho do professor. O trade-off é amplitude: alunos se destacam em tarefas específicas mas carecem das capacidades gerais do professor.

Quando devo usar knowledge distillation?

Use knowledge distillation quando você tem custos altos de inferência, precisa de tempos de resposta rápidos, quer implantar em dispositivos edge ou precisa de desempenho de tarefa específica sem capacidades gerais do modelo. É essencial para escalar aplicações de IA lucrativamente.

Parte da Coleção de Termos de IA. Última atualização: 2026-02-09

Founder & CEO

On this page

- De Monopólio de Modelos Grandes a Inteligência Eficiente

- Fazendo Sentido para Líderes Empresariais

- Elementos-Chave do Knowledge Distillation

- O Processo de Knowledge Distillation

- Tipos de Knowledge Distillation

- Knowledge Distillation em Ação

- Seu Caminho para Maestria em Knowledge Distillation

- Saiba Mais

- Recursos Externos

- Seção de Perguntas Frequentes