Bahasa Indonesia

Apa Itu Knowledge Distillation? Mendapatkan Performa GPT-4 dengan Anggaran Terbatas

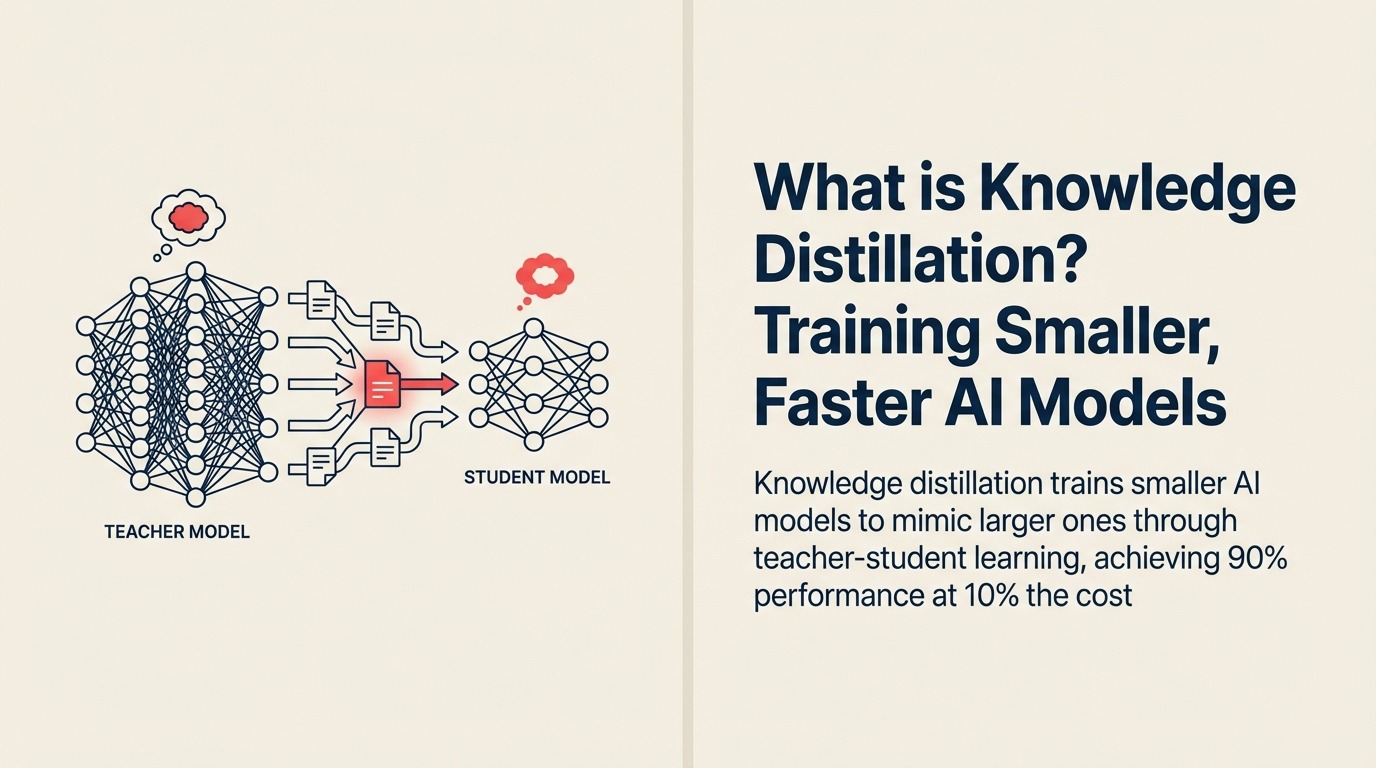

GPT-4 brilian tetapi menghabiskan $20 per juta token. Model khusus kecil menghabiskan $0,20 untuk pekerjaan yang sama tetapi tidak dapat menyamai kemampuan GPT-4. Atau bisakah? Knowledge distillation telah muncul sebagai teknik yang memungkinkan Anda mentransfer kecerdasan large language models besar ke versi yang kompak, cepat, dan terjangkau—memberikan 90% performa dengan 10% biaya untuk use case spesifik.

GPT-4 brilian tetapi menghabiskan $20 per juta token. Model khusus kecil menghabiskan $0,20 untuk pekerjaan yang sama tetapi tidak dapat menyamai kemampuan GPT-4. Atau bisakah? Knowledge distillation telah muncul sebagai teknik yang memungkinkan Anda mentransfer kecerdasan large language models besar ke versi yang kompak, cepat, dan terjangkau—memberikan 90% performa dengan 10% biaya untuk use case spesifik.

Dari Monopoli Model Besar ke Intelligence Efisien

Knowledge distillation muncul sebagai teknik terobosan pada tahun 2015 ketika peneliti menemukan bahwa neural network kecil dapat belajar meniru yang besar dengan mempelajari perilaku mereka daripada belajar ulang dari data mentah. Yang dimulai sebagai keingintahuan akademis menjadi kebutuhan produksi.

Google Research mendefinisikan knowledge distillation sebagai "proses mentransfer pengetahuan dari model teacher besar dan kompleks ke model student yang lebih kecil dan lebih efisien dengan melatih student untuk mereproduksi output dan representasi internal teacher."

Bidang ini meledak ketika perusahaan menyadari mereka dapat menciptakan model khusus yang menyamai performa GPT-3 untuk tugas spesifik sambil berjalan 100x lebih cepat pada hardware lokal—mengubah API cloud mahal menjadi deployment edge terjangkau.

Memahami untuk Pemimpin Bisnis

Bagi pemimpin bisnis, knowledge distillation berarti menangkap kecerdasan model AI state-of-the-art dalam versi yang lebih kecil, lebih cepat, lebih murah yang dioptimalkan untuk use case spesifik Anda—mengurangi biaya sebesar 80-95% sambil mempertahankan kualitas untuk tugas yang penting bagi bisnis Anda.

Anggap seperti mempekerjakan ahli senior untuk melatih tim spesialis. Tim tidak akan tahu semua yang ahli ketahui, tetapi mereka akan unggul dalam tugas spesifik yang Anda butuhkan—dan Anda dapat memiliki 10 dari mereka dengan biaya satu ahli.

Dalam istilah praktis, knowledge distillation memungkinkan Anda menjalankan intelligence kelas GPT-4 pada smartphone, memproses query pelanggan dengan biaya sen alih-alih dolar, dan mendeploy AI yang bekerja offline tanpa mengorbankan akurasi untuk use case Anda.

Elemen Kunci Knowledge Distillation

Knowledge distillation terdiri dari komponen penting ini:

• Teacher Model: Model besar dan kuat (seperti GPT-4 atau Claude) yang mencapai performa state-of-the-art tetapi terlalu mahal atau lambat untuk deployment produksi

• Student Model: Model yang lebih kecil dan cepat yang dirancang untuk belajar dari pengetahuan teacher daripada dari data pelatihan mentah, dioptimalkan untuk efisiensi

• Soft Targets: Distribusi probabilitas teacher atas jawaban yang mungkin (bukan hanya jawaban akhir), memberikan sinyal pembelajaran yang lebih kaya tentang ketidakpastian dan nuansa

• Distillation Training: Student belajar mencocokkan jawaban akhir teacher dan pola penalarannya, menangkap pendekatan pengambilan keputusan teacher

• Task Specialization: Model student fokus pada use case spesifik di mana ia dapat mencapai performa mendekati teacher daripada mencoba intelligence umum

Proses Knowledge Distillation

Mengimplementasikan knowledge distillation mengikuti langkah-langkah ini:

Select Teacher and Student: Pilih model teacher yang kuat untuk domain Anda dan rancang arsitektur student yang lebih kecil (10-100x lebih sedikit parameter) yang dapat berjalan efisien di lingkungan Anda

Generate Training Data: Jalankan contoh pelatihan Anda melalui model teacher, mengumpulkan output, distribusi probabilitas, dan aktivasi intermediate untuk menangkap pola pengambilan keputusannya

Train Student to Mimic: Latih model student untuk mereproduksi output dan penalaran teacher, menggunakan jawaban benar dan tingkat kepercayaan teacher untuk mentransfer pemahaman bernuansa

Proses ini mengubah model 175-miliar parameter yang menghabiskan $50/jam untuk dijalankan menjadi model 1-miliar parameter yang mencapai 95% performa dengan $0,50/jam.

Jenis Knowledge Distillation

Knowledge distillation hadir dalam beberapa pendekatan:

Tipe 1: Response-Based Distillation Terbaik untuk: Implementasi cepat dan tugas sederhana Fitur utama: Student belajar dari output akhir teacher Contoh: Melatih chatbot customer service untuk mencocokkan jawaban GPT-4 untuk pertanyaan umum

Tipe 2: Feature-Based Distillation Terbaik untuk: Menangkap pemahaman lebih dalam Fitur utama: Student belajar dari representasi internal teacher Contoh: Menciptakan classifier gambar khusus yang meniru ekstraksi fitur model vision besar

Tipe 3: Relation-Based Distillation Terbaik untuk: Tugas penalaran kompleks Fitur utama: Student belajar hubungan antara konsep Contoh: Membangun model analisis kontrak yang menangkap pemahaman model besar tentang interaksi klausa hukum

Tipe 4: Multi-Teacher Distillation Terbaik untuk: Menggabungkan beberapa kemampuan Fitur utama: Student belajar dari beberapa teacher khusus Contoh: Menciptakan asisten business intelligence yang dilatih oleh ahli terpisah dalam finance, operasi, dan penjualan

Knowledge Distillation dalam Aksi

Begini cara bisnis benar-benar menggunakan knowledge distillation:

Contoh Customer Support: Intercom mendistilasi pengetahuan GPT-3.5 ke dalam model 125-juta parameter untuk menjawab pertanyaan produk. Model yang didistilasi mencapai 92% akurasi GPT-3.5 sambil berjalan 40x lebih cepat dan menghabiskan biaya 95% lebih sedikit—memungkinkan respons real-time pada edge server.

Contoh Legal Tech: LawGeex menciptakan model tinjauan kontrak khusus dengan mendistilasi pengetahuan dari GPT-4 di 50.000 dokumen hukum. Model yang dihasilkan menyamai akurasi GPT-4 untuk analisis kontrak sambil berjalan on-premise, melindungi kerahasiaan klien dengan 10% biaya.

Contoh E-commerce: Amazon menggunakan knowledge distillation untuk menciptakan model rekomendasi produk yang menangkap intelligence sistem deep learning besar mereka sambil berjalan efisien pada aplikasi mobile—memberikan rekomendasi yang dipersonalisasi dalam 50ms alih-alih 2 detik.

Jalur Anda Menuju Penguasaan Knowledge Distillation

Siap menciptakan model AI yang efisien dan khusus?

- Pahami efisiensi model dengan Quantization

- Jelajahi optimasi produksi via Inference Optimization

- Pelajari tentang pelatihan model dengan Transfer Learning

Pelajari Lebih Lanjut

Perluas pemahaman Anda tentang konsep AI terkait:

- Model Compression - Teknik lain untuk model yang lebih kecil

- Fine-tuning - Menyesuaikan model pre-trained

- Pruning - Menghapus komponen model yang tidak perlu

- Neural Architecture Search - Merancang struktur model efisien

Sumber Eksternal

- Google Research on Model Compression - Paper akademis tentang teknik distillation

- Hugging Face Distillation Tutorials - Panduan praktis untuk mengimplementasikan knowledge distillation

- OpenAI Model Efficiency Research - Strategi deployment AI yang cost-effective

FAQ Section

Pertanyaan yang Sering Diajukan tentang Knowledge Distillation

Apa itu Knowledge Distillation?

Knowledge distillation adalah proses melatih model student yang lebih kecil dan cepat untuk meniru perilaku dan pengetahuan model teacher yang lebih besar dan kuat, mencapai performa serupa dengan sebagian kecil biaya komputasi.

Seberapa kecil model student bisa?

Model student biasanya 10-100x lebih kecil dari teacher. Pendekatan umum adalah mendistilasi GPT-3 (175B parameter) ke dalam model khusus 1-7B parameter yang menyamai performa untuk tugas spesifik sambil berjalan 50-100x lebih cepat.

Apa perbedaan antara knowledge distillation dan fine-tuning?

Fine-tuning mengadaptasi model pre-trained ke data baru menggunakan arsitektur model yang sama. Knowledge distillation mentransfer pengetahuan dari model besar ke arsitektur yang lebih kecil dan berbeda—menciptakan model yang lebih efisien yang dioptimalkan untuk deployment.

Apakah model student menyamai performa teacher?

Untuk tugas yang sempit dan terdefinisi dengan baik, model student biasanya mencapai 85-95% performa teacher. Trade-off adalah breadth: student unggul dalam tugas spesifik tetapi tidak memiliki kemampuan umum teacher.

Kapan saya harus menggunakan knowledge distillation?

Gunakan knowledge distillation ketika Anda memiliki biaya inference tinggi, memerlukan waktu respons cepat, ingin mendeploy pada edge device, atau memerlukan performa tugas spesifik tanpa kemampuan model umum. Ini penting untuk menskalakan aplikasi AI secara menguntungkan.

Bagian dari AI Terms Collection. Terakhir diperbarui: 2026-02-09

Founder & CEO

On this page

- Dari Monopoli Model Besar ke Intelligence Efisien

- Memahami untuk Pemimpin Bisnis

- Elemen Kunci Knowledge Distillation

- Proses Knowledge Distillation

- Jenis Knowledge Distillation

- Knowledge Distillation dalam Aksi

- Jalur Anda Menuju Penguasaan Knowledge Distillation

- Pelajari Lebih Lanjut

- Sumber Eksternal

- FAQ Section