Was ist Knowledge Distillation? GPT-4-Performance mit Budget erreichen

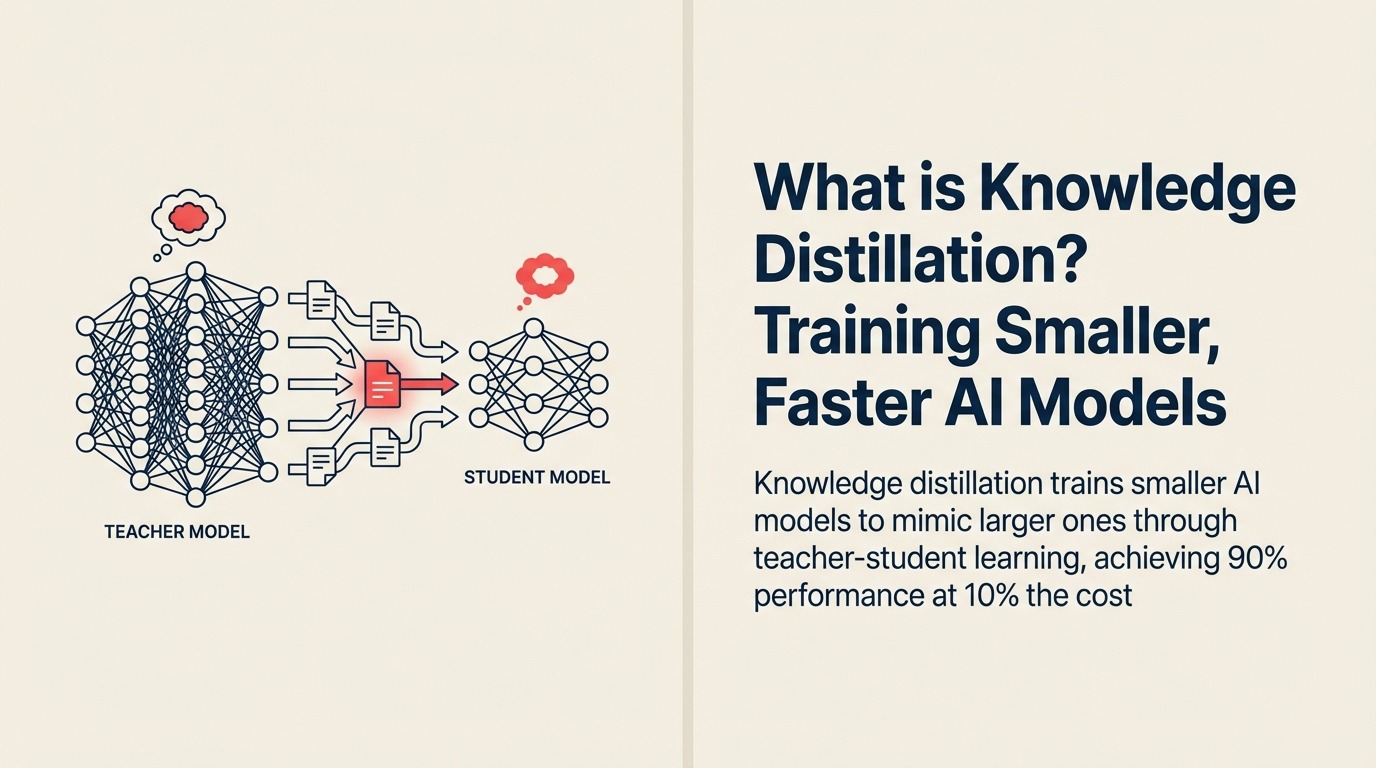

GPT-4 ist brillant, kostet aber 20$ pro Million Tokens. Ein winziges spezialisiertes Modell kostet 0,20$ für die gleiche Arbeit, kann aber GPT-4s Fähigkeiten nicht erreichen. Oder doch? Knowledge Distillation hat sich als die Technik etabliert, die es Ihnen ermöglicht, die Intelligenz massiver Large Language Models in kompakte, schnelle, bezahlbare Versionen zu übertragen – und 90% der Performance bei 10% der Kosten für spezifische Anwendungsfälle zu liefern.

GPT-4 ist brillant, kostet aber 20$ pro Million Tokens. Ein winziges spezialisiertes Modell kostet 0,20$ für die gleiche Arbeit, kann aber GPT-4s Fähigkeiten nicht erreichen. Oder doch? Knowledge Distillation hat sich als die Technik etabliert, die es Ihnen ermöglicht, die Intelligenz massiver Large Language Models in kompakte, schnelle, bezahlbare Versionen zu übertragen – und 90% der Performance bei 10% der Kosten für spezifische Anwendungsfälle zu liefern.

Vom Big-Model-Monopol zur effizienten Intelligenz

Knowledge Distillation entstand 2015 als Durchbruchtechnik, als Forscher entdeckten, dass kleine neuronale Netze große nachahmen können, indem sie deren Verhalten studieren, anstatt aus Rohdaten neu zu lernen. Was als akademische Kuriosität begann, wurde zur Produktionsnotwendigkeit.

Google Research definiert Knowledge Distillation als "den Prozess der Wissensübertragung von einem großen, komplexen Teacher-Modell zu einem kleineren, effizienteren Student-Modell, indem der Student trainiert wird, die Ausgaben und internen Repräsentationen des Teachers zu reproduzieren."

Das Feld explodierte, als Unternehmen erkannten, dass sie spezialisierte Modelle erstellen konnten, die GPT-3-Performance für spezifische Aufgaben erreichen, während sie 100x schneller auf lokaler Hardware laufen – und teure Cloud-APIs in bezahlbare Edge-Deployments verwandeln.

Verständlich für Führungskräfte

Für Führungskräfte bedeutet Knowledge Distillation, die Intelligenz modernster KI-Modelle in kleineren, schnelleren, günstigeren Versionen zu erfassen, die für Ihren spezifischen Anwendungsfall optimiert sind – und Kosten um 80-95% zu reduzieren, während Qualität für die Aufgaben, die Ihrem Unternehmen wichtig sind, erhalten bleibt.

Denken Sie daran, als würden Sie einen Senior-Experten einstellen, um ein Spezialistenteam zu trainieren. Das Team wird nicht alles wissen, was der Experte weiß, aber sie werden bei den spezifischen Aufgaben, die Sie benötigen, glänzen – und Sie können sich 10 von ihnen für die Kosten eines Experten leisten.

Praktisch ermöglicht Ihnen Knowledge Distillation, GPT-4-Klasse-Intelligenz auf Smartphones auszuführen, Kundenanfragen für Pennies statt Dollars zu verarbeiten und KI zu deployen, die offline funktioniert, ohne Genauigkeit für Ihren Anwendungsfall zu opfern.

Schlüsselelemente der Knowledge Distillation

Knowledge Distillation besteht aus diesen wesentlichen Komponenten:

• Teacher Model: Ein großes, leistungsstarkes Modell (wie GPT-4 oder Claude), das State-of-the-Art-Performance erreicht, aber zu teuer oder langsam für Produktions-Deployment ist

• Student Model: Ein kleineres, schnelleres Modell, das darauf ausgelegt ist, vom Wissen des Teachers zu lernen, anstatt aus Rohdaten, optimiert für Effizienz

• Soft Targets: Die Wahrscheinlichkeitsverteilungen des Teachers über mögliche Antworten (nicht nur die endgültige Antwort), die reichere Lernsignale über Unsicherheit und Nuancen liefern

• Distillation Training: Der Student lernt, sowohl die endgültigen Antworten des Teachers als auch dessen Argumentationsmuster zu reproduzieren und den Entscheidungsansatz des Teachers zu erfassen

• Task Specialization: Das Student-Modell konzentriert sich auf spezifische Anwendungsfälle, bei denen es Teacher-nahe Performance erreichen kann, anstatt allgemeine Intelligenz anzustreben

Der Knowledge-Distillation-Prozess

Implementierung von Knowledge Distillation folgt diesen Schritten:

Teacher und Student auswählen: Wählen Sie ein leistungsstarkes Teacher-Modell für Ihre Domäne und entwerfen Sie eine kleinere Student-Architektur (10-100x weniger Parameter), die effizient in Ihrer Umgebung laufen kann

Trainingsdaten generieren: Führen Sie Ihre Trainingsbeispiele durch das Teacher-Modell aus und sammeln Sie dessen Ausgaben, Wahrscheinlichkeitsverteilungen und Zwischenaktivierungen, um dessen Entscheidungsmuster zu erfassen

Student zum Nachahmen trainieren: Trainieren Sie das Student-Modell, die Ausgaben und Argumentation des Teachers zu reproduzieren, wobei sowohl korrekte Antworten als auch die Konfidenzniveaus des Teachers verwendet werden, um nuanciertes Verständnis zu übertragen

Dieser Prozess transformiert ein 175-Milliarden-Parameter-Modell, das 50$/Stunde zum Betrieb kostet, in ein 1-Milliarden-Parameter-Modell, das 95% der Performance bei 0,50$/Stunde erreicht.

Arten der Knowledge Distillation

Knowledge Distillation kommt in mehreren Ansätzen:

Typ 1: Response-Based Distillation Am besten für: Schnelle Implementierung und einfache Aufgaben Hauptmerkmal: Student lernt von den endgültigen Ausgaben des Teachers Beispiel: Training eines Kundenservice-Chatbots, um GPT-4s Antworten für häufige Fragen zu erreichen

Typ 2: Feature-Based Distillation Am besten für: Erfassung tieferen Verständnisses Hauptmerkmal: Student lernt von den internen Repräsentationen des Teachers Beispiel: Erstellung eines spezialisierten Bildklassifizierers, der die Feature-Extraktion eines großen Vision-Modells nachahmt

Typ 3: Relation-Based Distillation Am besten für: Komplexe Argumentationsaufgaben Hauptmerkmal: Student lernt Beziehungen zwischen Konzepten Beispiel: Aufbau eines Vertragsanalyse-Modells, das das Verständnis eines großen Modells für rechtliche Klausel-Interaktionen erfasst

Typ 4: Multi-Teacher Distillation Am besten für: Kombination mehrerer Fähigkeiten Hauptmerkmal: Student lernt von mehreren spezialisierten Teachers Beispiel: Erstellung eines Business-Intelligence-Assistenten, trainiert von separaten Experten in Finanzen, Operations und Vertrieb

Knowledge Distillation in Aktion

So nutzen Unternehmen tatsächlich Knowledge Distillation:

Kundenservice-Beispiel: Intercom destillierte GPT-3.5-Wissen in ein 125-Millionen-Parameter-Modell für die Beantwortung von Produktfragen. Das destillierte Modell erreicht 92% von GPT-3.5s Genauigkeit, während es 40x schneller läuft und 95% weniger kostet – was Echtzeit-Antworten auf Edge-Servern ermöglicht.

Legal-Tech-Beispiel: LawGeex erstellte ein spezialisiertes Vertragsprüfungsmodell durch Destillation von Wissen aus GPT-4 über 50.000 Rechtsdokumente. Das resultierende Modell erreicht GPT-4s Genauigkeit für Vertragsanalyse, während es On-Premise läuft, Mandantenvertraulichkeit schützt und 10% der Kosten hat.

E-Commerce-Beispiel: Amazon nutzt Knowledge Distillation, um Produktempfehlungsmodelle zu erstellen, die die Intelligenz ihrer massiven Deep-Learning-Systeme erfassen, während sie effizient auf mobilen Apps laufen – und personalisierte Empfehlungen in 50ms statt 2 Sekunden liefern.

Ihr Weg zur Knowledge-Distillation-Meisterschaft

Bereit, effiziente, spezialisierte KI-Modelle zu erstellen?

- Verstehen Sie Modelleffizienz mit Quantization

- Erkunden Sie Produktionsoptimierung über Inference Optimization

- Lernen Sie über Modelltraining mit Transfer Learning

Mehr erfahren

Erweitern Sie Ihr Verständnis verwandter KI-Konzepte:

- Model Compression - Andere Techniken für kleinere Modelle

- Fine-tuning - Anpassung vortrainierter Modelle

- Pruning - Entfernung unnötiger Modellkomponenten

- Neural Architecture Search - Design effizienter Modellstrukturen

Externe Ressourcen

- Google Research on Model Compression - Akademische Papers zu Distillationstechniken

- Hugging Face Distillation Tutorials - Praktische Anleitungen zur Implementierung von Knowledge Distillation

- OpenAI Model Efficiency Research - Kosteneffektive KI-Deployment-Strategien

FAQ-Bereich

Häufig gestellte Fragen zu Knowledge Distillation

Was ist Knowledge Distillation?

Knowledge Distillation ist der Prozess, ein kleineres, schnelleres Student-Modell zu trainieren, das Verhalten und Wissen eines größeren, leistungsstärkeren Teacher-Modells nachzuahmen und ähnliche Performance bei einem Bruchteil der Rechenkosten zu erreichen.

Wie viel kleiner kann das Student-Modell sein?

Student-Modelle sind typischerweise 10-100x kleiner als Teachers. Ein gängiger Ansatz ist die Destillation von GPT-3 (175B Parameter) in spezialisierte Modelle von 1-7B Parametern, die Performance für spezifische Aufgaben erreichen, während sie 50-100x schneller laufen.

Was ist der Unterschied zwischen Knowledge Distillation und Fine-tuning?

Fine-tuning passt ein vortrainiertes Modell an neue Daten an, wobei die gleiche Modellarchitektur verwendet wird. Knowledge Distillation überträgt Wissen von einem großen Modell zu einem kleineren mit anderer Architektur – und erstellt ein effizienteres Modell, das für Deployment optimiert ist.

Erreicht das Student-Modell Teacher-Performance?

Für eng definierte, gut abgegrenzte Aufgaben erreichen Student-Modelle typischerweise 85-95% der Teacher-Performance. Der Trade-off ist Breite: Students glänzen bei spezifischen Aufgaben, fehlt aber die allgemeine Fähigkeit des Teachers.

Wann sollte ich Knowledge Distillation verwenden?

Verwenden Sie Knowledge Distillation, wenn Sie hohe Inferenzkosten haben, schnelle Antwortzeiten benötigen, auf Edge-Geräten deployen möchten oder spezifische Task-Performance ohne allgemeine Modellfähigkeiten benötigen. Es ist essenziell für profitables Skalieren von KI-Anwendungen.

Teil der AI Terms Collection. Zuletzt aktualisiert: 2026-02-09

Founder & CEO

On this page

- Vom Big-Model-Monopol zur effizienten Intelligenz

- Verständlich für Führungskräfte

- Schlüsselelemente der Knowledge Distillation

- Der Knowledge-Distillation-Prozess

- Arten der Knowledge Distillation

- Knowledge Distillation in Aktion

- Ihr Weg zur Knowledge-Distillation-Meisterschaft

- Mehr erfahren

- Externe Ressourcen

- FAQ-Bereich