Diffusion Modelsとは?ノイズから数秒でアートへ

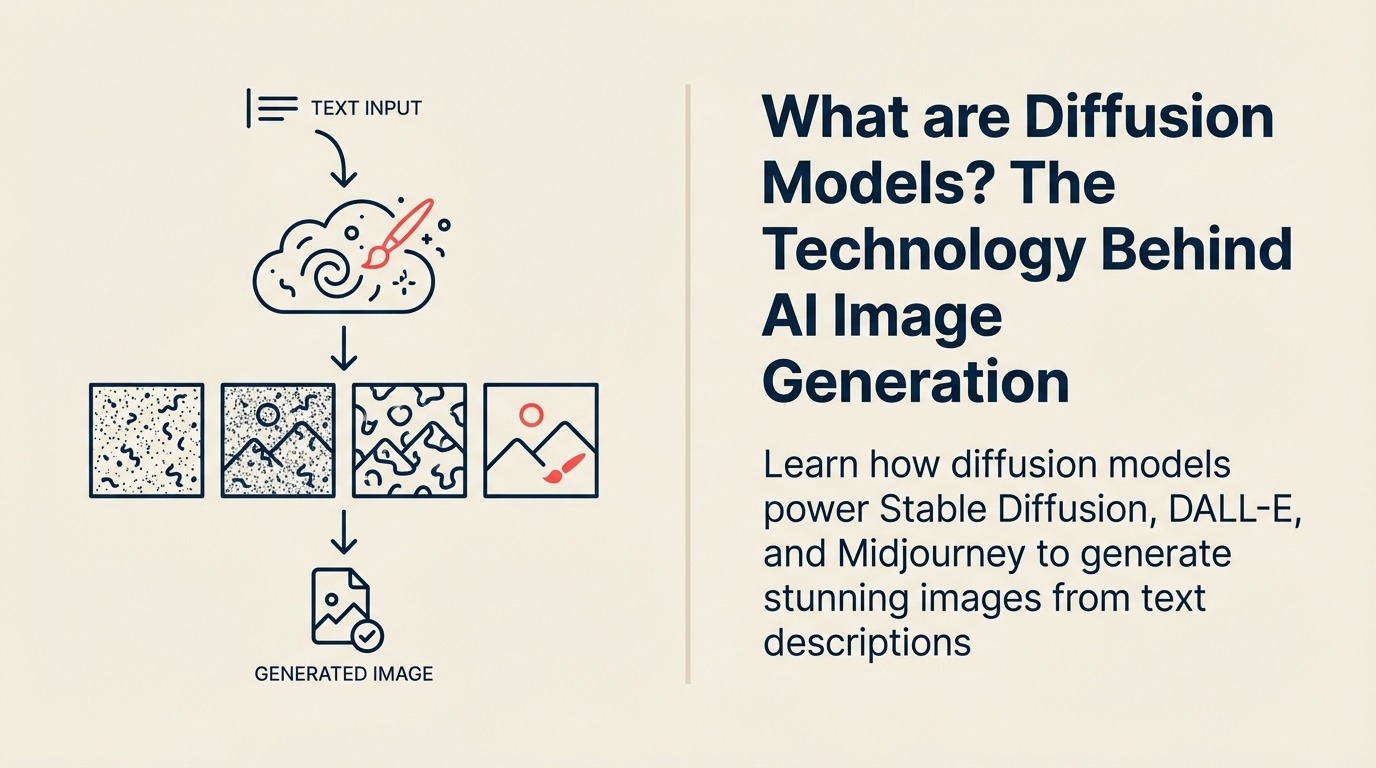

「自然光のあるプロフェッショナルなオフィス」と入力すると、AIが数秒でその正確な画像を作成する様子を見てください。この魔法の背後にあるのはDiffusion Models、AI創造性に革命をもたらしたブレークスルー技術です。ピクセルを1つずつ描くのではありません。純粋なノイズから始めて、徐々に完璧な画像に洗練していきます。

「自然光のあるプロフェッショナルなオフィス」と入力すると、AIが数秒でその正確な画像を作成する様子を見てください。この魔法の背後にあるのはDiffusion Models、AI創造性に革命をもたらしたブレークスルー技術です。ピクセルを1つずつ描くのではありません。純粋なノイズから始めて、徐々に完璧な画像に洗練していきます。

創造的革命を開始したイノベーション

Diffusion Modelsは2015年のStanford研究から生まれましたが、Stable Diffusion、DALL-E 2、Midjourneyがフォトリアリスティックな画像生成を実証した2022年に主流の認識に爆発的に広がりました。この技術は画像作成への従来のアプローチを逆転させました。

OpenAIの研究チームによると、Diffusion Modelsは「段階的なノイズ付加プロセスを逆転させることで画像を作成することを学習する生成モデルで、ランダムノイズから始まり、トレーニングデータから学習したパターンによってガイドされた一貫した出力に反復的に洗練します」と定義されています。

研究者がAIに画像のノイズ除去(ランダムノイズの認識と除去)を教えることが、強力な画像作成ツールに反転できることを実現した時にブレークスルーが来ました。この同じ原理が現在、ビデオ、オーディオ、3Dモデル生成を支えています。

ビジネスリーダーのためのDiffusion Models

ビジネスリーダーにとって、Diffusion Modelsとは、テキスト記述からプロフェッショナル品質の画像、ビデオ、デザインを生成するAIシステムで、写真家、デザイナー、ストック写真サブスクリプションなしに即座にクリエイティブ制作を可能にします。

欲しいものをデザイナーに説明することと、即座に表示されることの違いを考えてください。Diffusion Modelsは、思考の速度で働き、指定した通りに正確に生成する無限のクリエイティブチームを持つようなものです。

実際には、Diffusion Modelsは数秒で製品モックアップ、マーケティングビジュアル、建築レンダリング、デザインバリエーションを作成でき、クリエイティブワークフローを数週間から数分に変換します。これは、ビジュアルコンテンツのためのGenerative AIへのビジネスアプローチの根本的な転換を表します。

Diffusion Modelsの核心コンポーネント

Diffusion Modelsは以下の必須要素で構成されています:

• 順方向プロセス(ノイズ付加): 多くのステップにわたってトレーニング画像にランダムノイズを徐々に追加し、純粋な静的になるまで、構造の破壊がどのように見えるかをモデルに教えます

• 逆方向プロセス(ノイズ除去): ノイズ付加プロセスを逆転させることを学習し、純粋なノイズから元の画像を回復するためにステップごとにランダム性を除去します

• U-Netアーキテクチャ: 各ステップでノイズを予測して除去するニューラルネットワークで、細かいディテールと広い構成の両方を同時に理解します

• テキストエンコーダー: テキスト記述を、意図した画像に向けてノイズ除去プロセスをガイドする数学的表現に変換します

• 潜在空間: 拡散プロセスが実際に発生する圧縮表現で、生のピクセルでの作業よりも生成を高速かつ制御可能にします

Diffusion Modelsの動作方法

Diffusion Modelsは以下の創造的プロセスに従います:

開始点: 純粋なランダムノイズのキャンバスから始めます。構造や意味が全くないビジュアルスタティックのようなものです

ガイド付きノイズ除去: 20-50ステップにわたって、モデルはテキスト記述によってガイドされながら段階的にノイズを除去し、ゆっくりと構造とディテールを明らかにします

洗練: 各ステップでより多くのランダム性を除去し、プロンプトに沿ったより一貫性のあるディテールを追加します。初期ステップは構成を定義し、後のステップは細かいディテールを追加します

このプロセスは数秒で発生し、モデルは本質的に、あなたの記述に一致するノイズの下に存在できる画像を「想像」します。

Diffusion Modelsのタイプ

Diffusion Modelsは異なるクリエイティブニーズに対応します:

タイプ1:テキスト→画像モデル 最適用途:記述から画像を作成 主要機能:テキストプロンプトから元の画像を生成 例:DALL-E 3、Midjourney、Stable Diffusion

タイプ2:画像→画像モデル 最適用途:既存の画像を変換 主要機能:構造を保持しながら画像を変更 例:ガイド付き生成のためのControlNet

タイプ3:ビデオDiffusion Models 最適用途:動画の作成 主要機能:一貫したビデオシーケンスを生成 例:Runway Gen-2、Stable Video Diffusion

タイプ4:専門Diffusion Models 最適用途:ドメイン固有のアプリケーション 主要機能:特定のコンテンツタイプ用に最適化 例:医療画像、3Dオブジェクト、オーディオ生成

結果を提供するDiffusion Models

ビジネスがDiffusion Modelsを活用する方法:

Eコマースの例: ShopifyマーチャントはDiffusion Modelsを使用して、複数の設定と角度で製品画像を生成し、より多様な製品視覚化を通じてコンバージョン率を25%向上させながら、写真撮影コストを80%削減しています。

マーケティングの例: HeinzはDALL-Eを使用して数百の広告バリエーションを生成し、迅速な反復を通じて、特定のビジュアルスタイルが40%高いエンゲージメントを促進することを発見しました。以前は数か月かかったテストが数日で完了します。

建築の例: Foster + PartnersはDiffusion Modelsを使用して数十の建物デザインバリエーションを生成し、概念設計を10倍加速し、手動レンダリングでは実用的でなかったオプションを探索しています。

Diffusion Modelsの実装

ビジュアルコンテンツを生成する準備はできていますか?

- Generative AIの基礎を理解する

- Neural Networksの基本について学ぶ

- より良い結果のためのPrompt Engineeringを探索する

- ブランド固有のスタイルのためのFine-Tuningを検討する

FAQ

Diffusion Modelsに関するよくある質問

Diffusion Modelsとは何ですか?

Diffusion Modelsは、段階的なノイズ付加プロセスを逆転させることで画像を作成する生成AIシステムで、ランダムノイズから始まり、テキスト記述または他の入力によってガイドされた一貫した出力に反復的に洗練します。

Diffusion ModelsとGANの違いは何ですか?

GAN(敵対的生成ネットワーク)は競合するニューラルネットワークを使用します。Diffusion Modelsは反復的なノイズ除去を使用し、より多様な出力、より良いトレーニング安定性、テキストプロンプトを通じたより簡単な制御を生成します。

Diffusion Modelsの主なタイプは何ですか?

テキスト→画像モデル(記述から作成)、画像→画像モデル(既存の画像を変換)、ビデオDiffusion Models(動きを生成)、専門Diffusion Models(ドメイン固有のアプリケーション)です。

Diffusion Modelアプリケーションの例は何ですか?

DALL-E 3とMidjourney(画像生成)、Stable Diffusion(オープンソース画像作成)、Runway Gen-2(ビデオ生成)、医療画像、3Dモデル、オーディオ合成のための専門モデルです。

関連リソース

Diffusion Modelsの理解を深めるために、これらの関連概念を探索してください:

- Generative AI - コンテンツを作成するAIのより広いカテゴリ

- Neural Networks - Diffusion Modelsを支える基礎アーキテクチャ

- Prompt Engineering - 効果的な画像生成のための技術

- Computer Vision - AIがビジュアル情報を処理する方法を理解

外部リソース

- Stability AI Research - オープンソースDiffusion Model開発

- OpenAI DALL-E Documentation - 画像生成の技術詳細

- Hugging Face Diffusers - Diffusion Modelsの実践ガイド

AI用語集の一部。最終更新:2026-02-09