Quantizationとは?AIモデルを軽量・高速にする技術

強力なAIモデルを実行するには、1時間あたり数千ドルのコストとデータセンター級のGPUが必要です。しかし、同じモデルを75%圧縮し、ノートパソコンで実行しながら95%のパフォーマンスを維持できるとしたらどうでしょうか?Quantizationは、大規模言語モデルを大規模に展開するための秘密兵器となり、AIを高価なクラウド専用技術から、エッジデバイスやコンシューマーハードウェアで効率的に動作するものへと変革しました。

強力なAIモデルを実行するには、1時間あたり数千ドルのコストとデータセンター級のGPUが必要です。しかし、同じモデルを75%圧縮し、ノートパソコンで実行しながら95%のパフォーマンスを維持できるとしたらどうでしょうか?Quantizationは、大規模言語モデルを大規模に展開するための秘密兵器となり、AIを高価なクラウド専用技術から、エッジデバイスやコンシューマーハードウェアで効率的に動作するものへと変革しました。

研究の贅沢品から本番環境の必需品へ

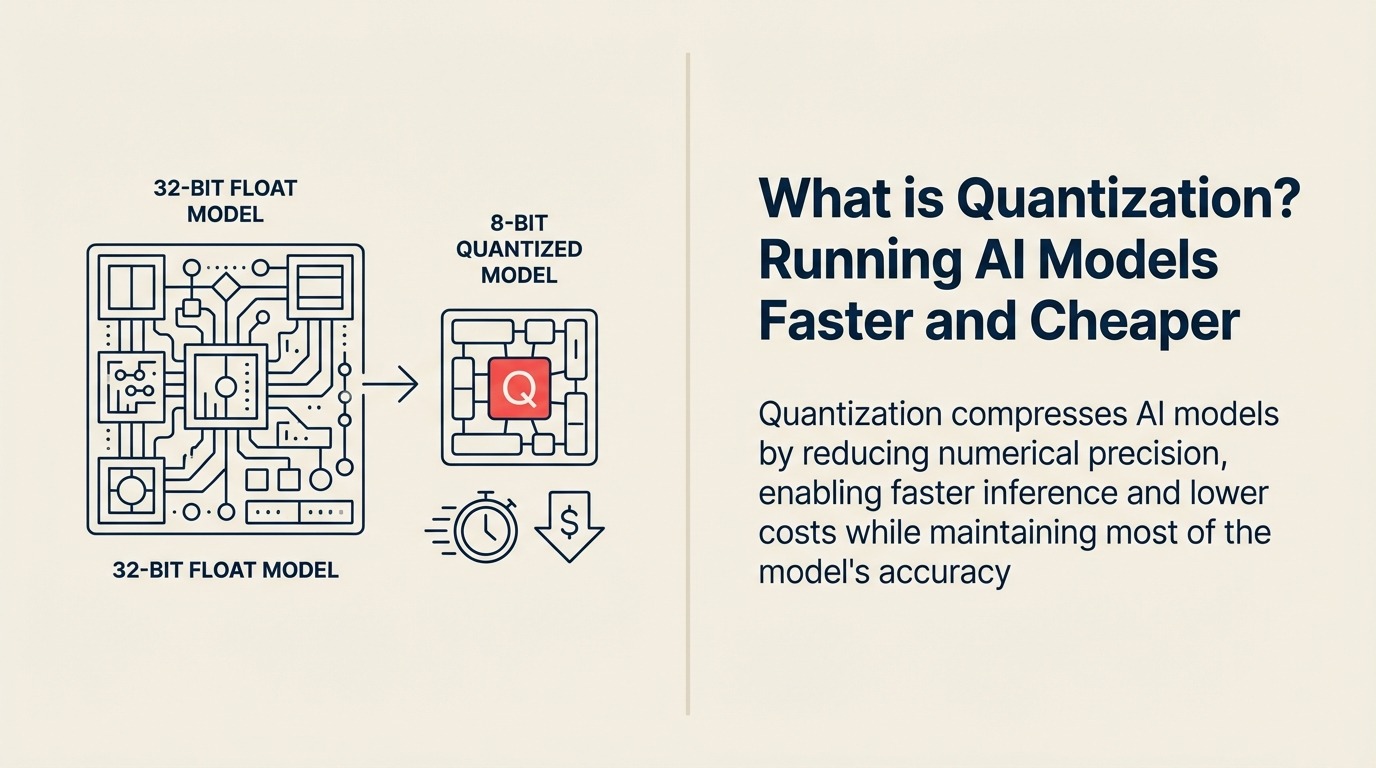

Quantizationは、2017年頃に重要な技術として登場しました。研究者たちは、高精度の数値(32ビット浮動小数点)でトレーニングされたAIモデルが、トレーニング完了後ははるかに低い精度(8ビットまたは4ビット整数)で効果的に動作できることに気づきました。

NVIDIAは、Quantizationを「モデルの重みとアクティベーションを表現するために使用されるビット数を削減し、推論タスクにおいて許容可能な精度レベルを維持しながら、モデルサイズと計算要件を削減するプロセス」と定義しています。

企業がQuantizationされたモデルが4倍高速に動作し、メモリ使用量を75%削減し、運用コストがわずかで済むことを発見した時、この分野は爆発的に成長しました。しかも、ほとんどのビジネスアプリケーションでほぼ同一の結果を提供できるのです。

ビジネスリーダーにとっての意味

ビジネスリーダーにとって、Quantizationは同じAI機能をコストとレイテンシのわずかな割合で実行できることを意味します。これにより、モバイルデバイスでのリアルタイムAI、クラウド費用の70%削減、ネットワーク接続が制限されているか高価な場所での強力なモデルの展開が可能になります。

高解像度RAW画像の配送と圧縮JPEGの違いを考えてみてください。ほとんどの閲覧者には違いがわかりませんが、JPEGは10倍小さく、瞬時に読み込まれます。Quantizationは、ほとんどのユースケースで目立った品質低下なくAIモデルに同じことをします。

実用的には、Quantizationにより、スマートフォンでChatGPTクラスのモデルを実行し、顧客クエリを秒単位ではなくミリ秒単位で処理し、AIインフラストラクチャコストを60~80%削減できます。

Quantizationの主要要素

Quantizationは以下の重要なコンポーネントで構成されています:

• 精度削減: 高精度の数値(32ビット浮動小数点)を低精度(16ビット、8ビット、または4ビット整数)に変換し、メモリ要件を劇的に削減

• キャリブレーション: モデルの重みとアクティベーションを分析し、変換中の精度損失を最小化する最適なスケーリング係数を決定

• ハードウェア最適化: 整数演算を浮動小数点演算よりもはるかに高速に実行する専用プロセッサを活用し、推論速度を加速

• 精度保持: 重要なタスクでモデルパフォーマンスを維持するために、どのレイヤーと操作をQuantizationするかを慎重に選択

• 動的vs静的: パフォーマンスニーズに基づいて、重みのみをQuantization(静的)するか、実行時にアクティベーションをQuantization(動的)するかを選択

Quantizationプロセス

Quantizationの実装は以下のステップに従います:

フル精度トレーニング: 32ビット浮動小数点数を使用してトレーニングされた標準モデルから始め、モデルがデータ内のすべてのパターンとニュアンスを学習できるようにします

感度分析: どのモデルレイヤーが精度削減に最も敏感で、どれが精度損失なく積極的に圧縮できるかを判断

Quantization適用: 重みと場合によってはアクティベーションを低精度に変換し、キャリブレーションデータを使用して変換プロセスを最適化し、情報損失を最小化

この変換により、7GBのモデルを2GBに圧縮しながら、元のパフォーマンスの95%以上を維持します。

Quantizationの種類

Quantizationにはいくつかのアプローチがあります:

タイプ1:Post-Training Quantization (PTQ) 最適な用途:再トレーニングなしの迅速な展開 主な特徴:トレーニング完了後にQuantization 例:より高速な推論のために事前トレーニング済みGPTモデルを8ビットに変換

タイプ2:Quantization-Aware Training (QAT) 最適な用途:精度の最大保持 主な特徴:モデルがトレーニング中にQuantizationに対応するように学習 例:4ビット展開を想定してトレーニングされたビジョンモデル

タイプ3:Dynamic Quantization 最適な用途:入力サイズが変化するモデル 主な特徴:重みがQuantizationされ、アクティベーションが実行時に変換 例:異なるテキスト長を処理する言語モデル

タイプ4:Mixed-Precision Quantization 最適な用途:速度と精度のバランス 主な特徴:異なるレイヤーに異なる精度レベル 例:ほとんどのレイヤーに4ビット、アテンションヘッドに8ビット

Quantizationの実践例

企業が実際にQuantizationを使用している方法は次のとおりです:

モバイルAIの例: MetaのLlama 2モデルは4ビット精度にQuantizationされ、iPhoneとAndroidデバイスで動作し、データをクラウドに送信せずにデバイス上のAIアシスタントを実現しています。応答時間は2秒から200ミリ秒に短縮されました。

クラウドコスト削減の例: AnthropicはClaudeモデルを特定のユースケース向けにQuantizationし、元の品質スコアの96%を維持しながら推論コストを70%削減しました。これにより、APIカスタマー向けの低価格化が可能になりました。

エッジコンピューティングの例: TeslaはQuantizationされたニューラルネットワークを自動運転に使用し、車載ハードウェアで複雑なビジョンモデルを36フレーム/秒で実行しています。これはフル精度モデルでは不可能でした。

Quantization習得への道

AIモデルを軽量・高速化する準備はできましたか?

- Inference Optimizationでモデル最適化を理解

- Knowledge Distillationで小型モデルを探索

- Transfer Learningで効率的なトレーニングを学習

外部リソース

Quantizationに関する権威ある研究とドキュメントを探索:

- NVIDIA Deep Learning Inference Guide - Quantization技術と最適化に関する包括的なドキュメント

- Hugging Face Quantization Guide - モデルQuantizationの実践的な実装ガイドとツール

- PyTorch Quantization Documentation - Quantizationフレームワークと手法の技術リファレンス

さらに学ぶ

関連するAI概念の理解を深める:

- Model Compression - モデルサイズ削減のための他の技術

- Edge AI - クラウドではなくデバイスでAIを実行

- Inference - AI予測プロセスの理解

- Neural Architecture Search - 効率的なモデル構造の設計

FAQ

Quantizationに関するよくある質問

AIにおけるQuantizationとは何ですか?

QuantizationはAIモデルの重みとアクティベーションの数値精度を削減し、高精度フォーマット(32ビット浮動小数点)から低精度フォーマット(8ビットまたは4ビット整数)に変換して、モデルサイズを削減し推論速度を向上させるプロセスです。

Quantizationはモデルの精度を損ないますか?

適切に実装されたQuantizationは、通常、元の精度の95~99%を維持します。鍵となるのは、キャリブレーションと異なるモデルコンポーネントに適切な精度レベルを選択することです。

8ビットQuantizationと4ビットQuantizationの違いは何ですか?

8ビットQuantizationは圧縮(4倍小型化)と精度保持の良いバランスを提供します。4ビットQuantizationは極端な圧縮(8倍小型化)を提供しますが、許容可能な精度を維持するためにはより慎重な実装が必要です。

Quantizationはいつ使用すべきですか?

Quantizationは、リソースが制限されたエッジデバイスへのモデル展開、クラウド推論コストの削減、低レイテンシ要件の達成、または帯域幅制約のある環境でのモデル実行時に価値があります。

すべてのAIモデルをQuantizationできますか?

ほとんどのニューラルネットワークは効果的にQuantizationできます。大規模言語モデル、コンピュータビジョンモデル、推薦システムはすべてQuantizationの恩恵を受けます。一部の特殊なモデルや極端な精度を必要とするタスクでは、慎重な検証が必要な場合があります。

AIターム集の一部。最終更新:2026-02-09