Inference Optimizationとは?予算内でAIをスケールする方法

AIモデルを一度トレーニングするコストは数百万ドルかかります。しかし、そのモデルを数十億回実行するコストはさらに大きくなります。1つの大規模言語モデルが10万人の日次ユーザーにサービスを提供する場合、月額5万ドルの計算コストが発生する可能性があります。Inference Optimizationは、AIパイロットプロジェクトから収益性の高いAI製品を分ける重要な分野となっており、企業は同じ品質の結果を10分の1のコストで5倍の速度で提供できるようになりました。

AIモデルを一度トレーニングするコストは数百万ドルかかります。しかし、そのモデルを数十億回実行するコストはさらに大きくなります。1つの大規模言語モデルが10万人の日次ユーザーにサービスを提供する場合、月額5万ドルの計算コストが発生する可能性があります。Inference Optimizationは、AIパイロットプロジェクトから収益性の高いAI製品を分ける重要な分野となっており、企業は同じ品質の結果を10分の1のコストで5倍の速度で提供できるようになりました。

プロトタイプから本番環境への現実

Inference Optimizationは、2019年頃に独立した分野として登場しました。企業がモデルの精度だけでは不十分であること、本番環境のAIシステムは高速で、低コストで、スケーラブルである必要があることに気付いたためです。アドホックなパフォーマンスチューニングとして始まったものが、体系的なエンジニアリング分野へと進化しました。

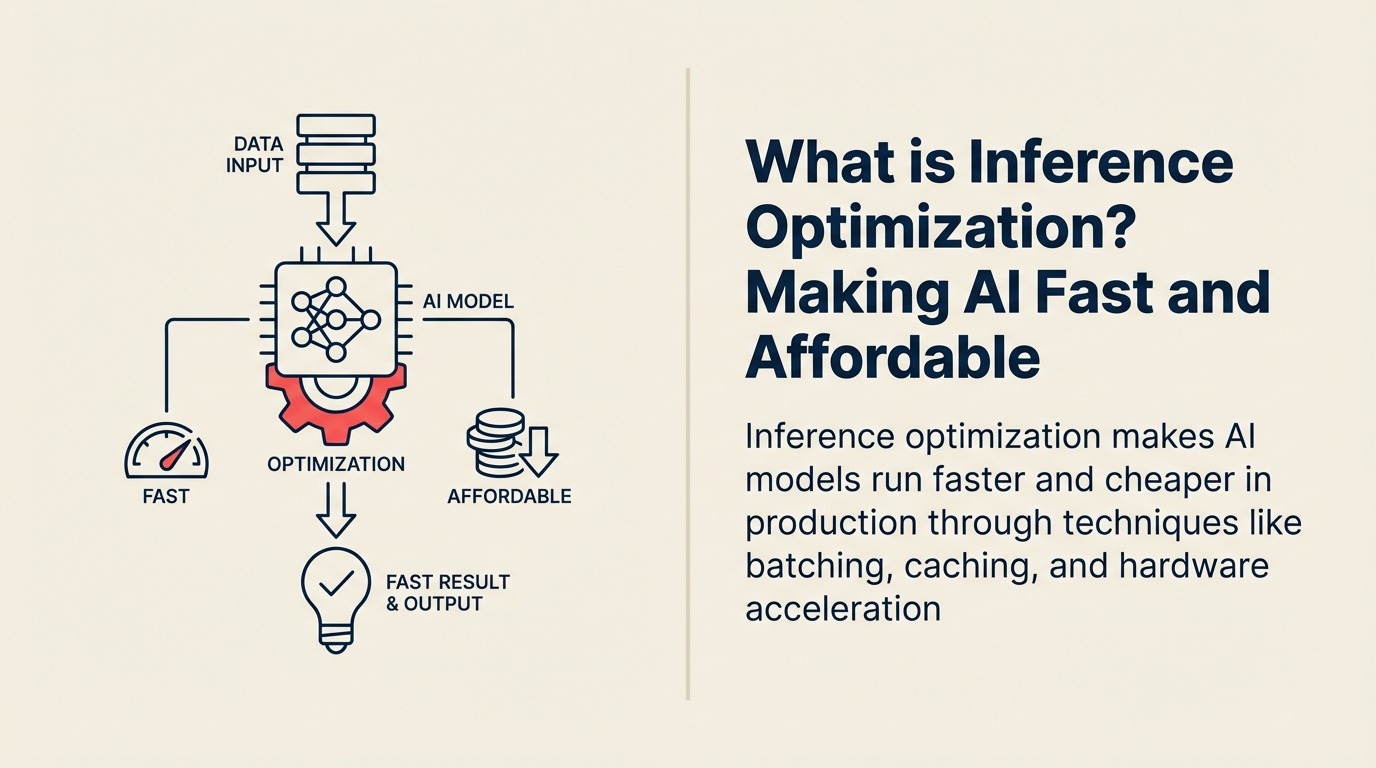

NVIDIAはInference Optimizationを「ソフトウェア最適化、ハードウェアアクセラレーション、アーキテクチャ改善を通じて、本番環境でのAIモデル予測のスループットを最大化し、レイテンシを最小化し、計算コストを削減するプロセス」と定義しています。

この分野が爆発的に成長したのは、企業がシンプルな最適化技術でコストを70〜90%削減し、レスポンスタイムを数秒からミリ秒に改善できることを発見したためです。これにより、AIアプリケーションが瞬時に動作し、経済的に実現可能になりました。

ビジネスリーダーにとっての意味

ビジネスリーダーにとって、Inference Optimizationは同じAI機能をコストとレイテンシの一部で提供できることを意味します。これにより、リアルタイムアプリケーションを可能にし、インフラストラクチャコストを60〜80%削減し、使用量が指数関数的に増加してもAIサービスを収益性高くスケールできます。

レストランを例に考えてみましょう。各注文を個別に調理するのと、事前に材料を準備し、類似の注文をバッチ処理し、専用機器を使用するのとの違いです。どちらも同じ料理の品質を提供しますが、一方は10倍効率的です。

実際には、Inference Optimizationにより、クラウド料金を圧迫することなく数千人のユーザーに同時にサービスを提供し、顧客の問い合わせに数秒ではなくミリ秒で応答し、パイロットから本番環境へとコストの線形増加なしにスケールできます。

Inference Optimizationの主要要素

Inference Optimizationには以下の重要な技術が含まれます。

• バッチング: 1つずつではなく複数のリクエストをまとめて処理することで、GPUの並列処理機能を活用してスループットを劇的に向上させます

• キャッシング: 一般的なクエリと応答を保存して冗長な計算を回避し、よくある質問に対してレイテンシを数秒からミリ秒に削減します

• ハードウェアアクセラレーション: AI推論用に最適化された専用プロセッサ(GPU、TPU、カスタムASIC)を使用して、汎用CPUと比較して10〜100倍の高速化を実現します

• モデル圧縮: 量子化とプルーニングを通じてモデルサイズを削減し、精度を維持しながら、より高速なロードと実行を可能にします

• リクエストルーティング: さまざまなクエリタイプを適切なモデルに振り分け(シンプルなクエリは小型モデル、複雑なクエリは大型モデル)、コストと精度のトレードオフを最適化します

Inference Optimizationのプロセス

Inference Optimizationの実装は次のステップに従います。

ベースライン測定: 現在の推論パフォーマンスをプロファイリングし、前処理、モデル実行、後処理のボトルネックを特定して、最適化努力が最大の効果を発揮する場所を理解します

最適化の適用: スループット向上のためのバッチング、一般的なリクエストのキャッシング、サイズ削減のためのモデル圧縮、速度向上のためのハードウェアアクセラレーションを実装します。多くの場合、複数の技術を組み合わせます

ベンチマークと反復: 本番環境の負荷下で最適化されたシステムをテストし、レイテンシ、スループット、コストを測定して、品質を犠牲にすることなくビジネス要件を満たしているかを確認します

このプロセスにより、1秒あたり10リクエストを処理する概念実証が、より低い総コストで1秒あたり1万リクエストを処理する本番システムに変換されます。

Inference Optimizationのタイプ

Inference Optimizationにはいくつかのアプローチがあります。

タイプ1:ソフトウェア最適化 最適な用途:インフラストラクチャの変更なしに迅速な成果 主な特徴:コードレベルの改善とアルゴリズムチューニング 例:リクエストバッチングを実装して、50個のクエリを順次ではなく同時に処理

タイプ2:ハードウェアアクセラレーション 最適な用途:最大のパフォーマンス改善 主な特徴:専用推論プロセッサ 例:CPUからNVIDIA T4 GPUへの移行により20倍の高速化

タイプ3:モデル最適化 最適な用途:計算要件の削減 主な特徴:同じ機能を持つより小型で高速なモデル 例:知識蒸留を使用して、元の精度の95%を持つ4分の1のサイズのモデルを作成

タイプ4:アーキテクチャ最適化 最適な用途:大規模本番システム 主な特徴:分散処理と負荷分散 例:インテリジェントなリクエストルーティングを備えたマルチリージョン展開

Inference Optimizationの実践例

企業が実際にInference Optimizationをどのように使用しているかを見てみましょう。

Eコマースの例: Shopifyは、バッチング、キャッシング、モデル量子化を実装することで製品推奨エンジンを最適化しました。レスポンスタイムは800msから50msに低下し、インフラストラクチャコストは73%減少し、10倍のリクエストを処理できるようになりました。

カスタマーサービスの例: ZendeskのAIチケットルーティングシステムは、Inference Optimizationを使用して1日10万件のチケットを処理します。一般的な質問パターンのキャッシングと、80%のクエリに対する小型の専用モデルの使用により、年間20万ドルのコストを削減しました。

金融サービスの例: Stripeは、不正検知推論を最適化してトランザクションを100ms未満(2秒から)で分析できるようにし、GPUアクセラレーション、リクエストバッチング、モデル圧縮を組み合わせました。これにより、顧客体験に影響を与えることなくリアルタイムの不正防止が可能になりました。

Inference Optimization習得への道

AIシステムを高速かつ手頃な価格にする準備はできていますか?

詳細情報

関連するAI概念の理解を深めましょう。

- Model Serving - モデルを本番環境にデプロイする

- Edge AI - デバイス上で推論を実行する

- Model Compression - モデルのサイズと複雑さを削減する

- Latency - レスポンスタイム要因を理解する

外部リソース

- NVIDIA AI Inference Platform - ハードウェアアクセラレーションと最適化技術

- Hugging Face Optimization Guide - モデル最適化の実践的チュートリアル

- Google Cloud AI Performance - スケーラブルな推論アーキテクチャパターン

FAQ

Inference Optimizationに関するよくある質問

Inference Optimizationとは何ですか?

Inference Optimizationは、バッチング、キャッシング、ハードウェアアクセラレーション、モデル圧縮などの技術を通じて、本番環境でのAIモデル予測をより高速、低コスト、スケーラブルにするプロセスです。

トレーニング最適化と推論最適化の違いは何ですか?

トレーニング最適化は、モデルの学習をより高速かつ低コストにすることに焦点を当てます(1回実行)。推論最適化は、予測をより高速かつ低コストにすることに焦点を当てます(本番環境で数百万回実行)。推論最適化は、すべてのユーザーリクエストに影響するため、ビジネスへの影響が大きくなります。

Inference Optimizationはどの程度コストを削減できますか?

適切に実装されたInference Optimizationは、通常、コストを60〜90%削減し、速度を5〜50倍改善します。正確な削減量は、現在のベースライン、適用される最適化技術、ワークロードの特性によって異なります。

主な推論最適化技術は何ですか?

コア技術は、バッチング(複数のリクエストをまとめて処理)、キャッシング(一般的な結果を保存)、ハードウェアアクセラレーション(専用プロセッサを使用)、モデル圧縮(モデルサイズを削減)、リクエストルーティング(クエリを適切なモデルに一致)です。

いつ推論を最適化すべきですか?

プロトタイプから本番環境に移行するとき、コストが使用量に応じて線形に増加するとき、レイテンシがユーザーエクスペリエンスに影響するとき、または1日に数千のリクエストを処理するときに最適化を開始します。早期の最適化により、高価なインフラストラクチャのスケーリングを防ぐことができます。

AI用語集の一部。最終更新:2026-02-09