¿Qué es Knowledge Distillation? Obteniendo Rendimiento de GPT-4 con Presupuesto Limitado

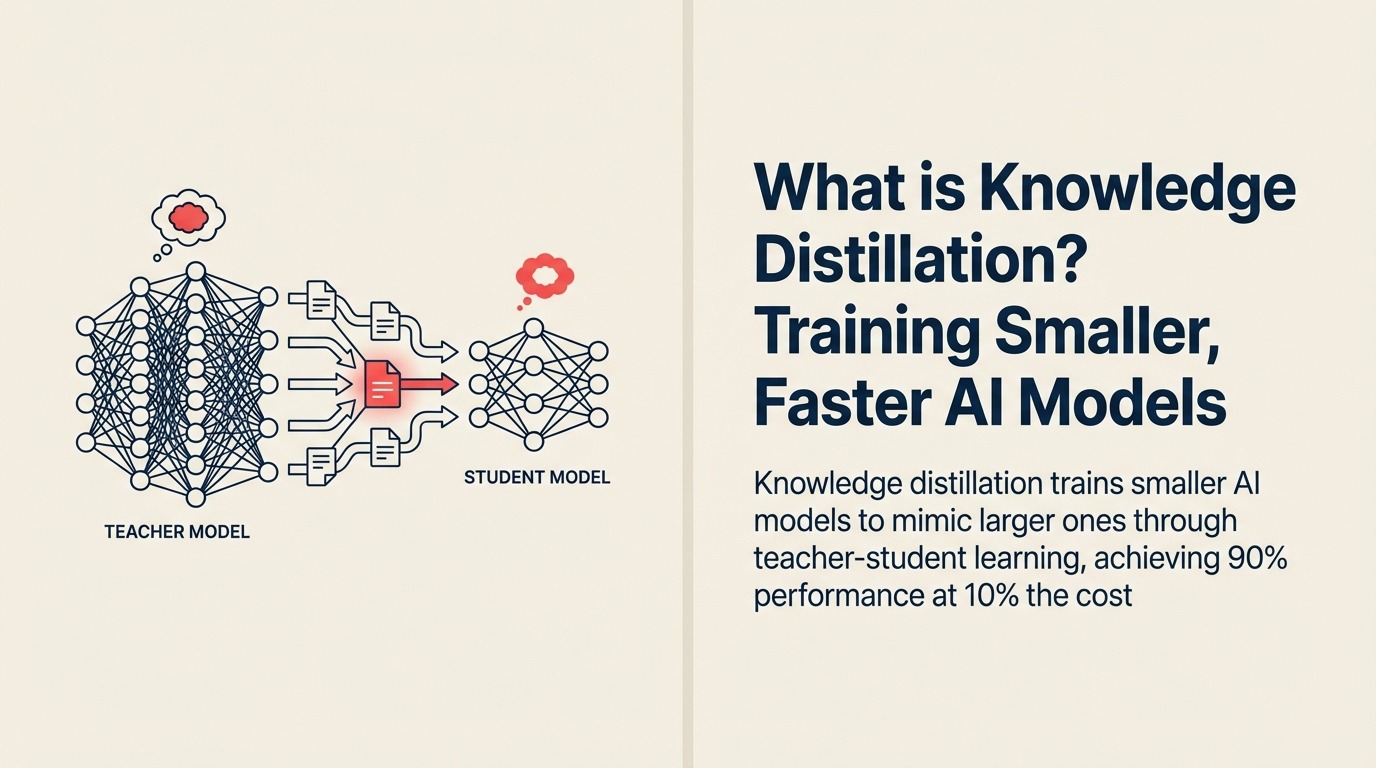

GPT-4 es brillante pero cuesta $20 por millón de tokens. Un modelo especializado pequeño cuesta $0.20 por el mismo trabajo pero no puede igualar las capacidades de GPT-4. ¿O sí puede? Knowledge distillation ha surgido como la técnica que le permite transferir la inteligencia de modelos de lenguaje grandes masivos en versiones compactas, rápidas y económicas, entregando 90% del rendimiento a 10% del costo para casos de uso específicos.

GPT-4 es brillante pero cuesta $20 por millón de tokens. Un modelo especializado pequeño cuesta $0.20 por el mismo trabajo pero no puede igualar las capacidades de GPT-4. ¿O sí puede? Knowledge distillation ha surgido como la técnica que le permite transferir la inteligencia de modelos de lenguaje grandes masivos en versiones compactas, rápidas y económicas, entregando 90% del rendimiento a 10% del costo para casos de uso específicos.

Del Monopolio de Modelos Grandes a Inteligencia Eficiente

Knowledge distillation surgió como una técnica revolucionaria en 2015 cuando los investigadores descubrieron que las redes neuronales pequeñas podían aprender a imitar a las grandes estudiando su comportamiento en lugar de reaprender desde datos crudos. Lo que comenzó como una curiosidad académica se convirtió en una necesidad de producción.

Google Research define knowledge distillation como "el proceso de transferir conocimiento de un modelo maestro grande y complejo a un modelo estudiante más pequeño y eficiente entrenando al estudiante para reproducir las salidas y representaciones internas del maestro".

El campo explotó cuando las empresas se dieron cuenta de que podían crear modelos especializados que igualaban el rendimiento de GPT-3 para tareas específicas mientras se ejecutaban 100x más rápido en hardware local, convirtiendo APIs de nube costosas en despliegues edge económicos.

Entendiendo para Líderes de Negocio

Para líderes de negocio, knowledge distillation significa capturar la inteligencia de modelos de IA de vanguardia en versiones más pequeñas, rápidas y económicas optimizadas para su caso de uso específico, reduciendo costos en 80-95% mientras se mantiene calidad para las tareas que importan a su negocio.

Piénselo como contratar a un experto senior para entrenar a un equipo especialista. El equipo no sabrá todo lo que el experto sabe, pero sobresaldrán en las tareas específicas que necesita, y puede permitirse 10 de ellos por el costo de un experto.

En términos prácticos, knowledge distillation le permite ejecutar inteligencia clase GPT-4 en smartphones, procesar consultas de clientes por centavos en lugar de dólares, y desplegar IA que funciona offline sin sacrificar precisión para su caso de uso.

Elementos Clave de Knowledge Distillation

Knowledge distillation consiste en estos componentes esenciales:

• Modelo Maestro: Un modelo grande y poderoso (como GPT-4 o Claude) que logra rendimiento de vanguardia pero es demasiado costoso o lento para despliegue en producción

• Modelo Estudiante: Un modelo más pequeño y rápido diseñado para aprender del conocimiento del maestro en lugar de datos de entrenamiento crudos, optimizado para eficiencia

• Soft Targets: Las distribuciones de probabilidad del maestro sobre posibles respuestas (no solo la respuesta final), proporcionando señales de aprendizaje más ricas sobre incertidumbre y matiz

• Entrenamiento de Destilación: El estudiante aprende a igualar tanto las respuestas finales del maestro como sus patrones de razonamiento, capturando el enfoque de toma de decisiones del maestro

• Especialización de Tareas: El modelo estudiante se enfoca en casos de uso específicos donde puede lograr rendimiento cercano al maestro en lugar de intentar inteligencia general

El Proceso de Knowledge Distillation

Implementar knowledge distillation sigue estos pasos:

Seleccionar Maestro y Estudiante: Elegir un modelo maestro poderoso para su dominio y diseñar una arquitectura de estudiante más pequeña (10-100x menos parámetros) que pueda ejecutarse eficientemente en su entorno

Generar Datos de Entrenamiento: Ejecutar sus ejemplos de entrenamiento a través del modelo maestro, recolectando sus salidas, distribuciones de probabilidad y activaciones intermedias para capturar sus patrones de toma de decisiones

Entrenar al Estudiante para Imitar: Entrenar al modelo estudiante para reproducir las salidas y razonamiento del maestro, usando tanto respuestas correctas como niveles de confianza del maestro para transferir comprensión matizada

Este proceso transforma un modelo de 175 mil millones de parámetros que cuesta $50/hora ejecutar en un modelo de 1 mil millones de parámetros que logra 95% del rendimiento a $0.50/hora.

Tipos de Knowledge Distillation

Knowledge distillation viene en varios enfoques:

Tipo 1: Response-Based Distillation Mejor para: Implementación rápida y tareas simples Característica clave: El estudiante aprende de las salidas finales del maestro Ejemplo: Entrenar un chatbot de servicio al cliente para igualar las respuestas de GPT-4 para preguntas comunes

Tipo 2: Feature-Based Distillation Mejor para: Capturar comprensión más profunda Característica clave: El estudiante aprende de las representaciones internas del maestro Ejemplo: Crear un clasificador de imágenes especializado que imita la extracción de características de un modelo de visión grande

Tipo 3: Relation-Based Distillation Mejor para: Tareas de razonamiento complejas Característica clave: El estudiante aprende relaciones entre conceptos Ejemplo: Construir un modelo de análisis de contratos que captura la comprensión de un modelo grande sobre interacciones de cláusulas legales

Tipo 4: Multi-Teacher Distillation Mejor para: Combinar múltiples capacidades Característica clave: El estudiante aprende de varios maestros especializados Ejemplo: Crear un asistente de business intelligence entrenado por expertos separados en finanzas, operaciones y ventas

Knowledge Distillation en Acción

Así es como las empresas realmente usan knowledge distillation:

Ejemplo Soporte al Cliente: Intercom destiló conocimiento de GPT-3.5 en un modelo de 125 millones de parámetros para responder preguntas de productos. El modelo destilado logra 92% de la precisión de GPT-3.5 mientras se ejecuta 40x más rápido y cuesta 95% menos, habilitando respuestas en tiempo real en servidores edge.

Ejemplo Legal Tech: LawGeex creó un modelo especializado de revisión de contratos destilando conocimiento de GPT-4 a través de 50,000 documentos legales. El modelo resultante iguala la precisión de GPT-4 para análisis de contratos mientras se ejecuta on-premise, protegiendo confidencialidad del cliente a 10% del costo.

Ejemplo E-commerce: Amazon usa knowledge distillation para crear modelos de recomendación de productos que capturan la inteligencia de sus sistemas masivos de deep learning mientras se ejecutan eficientemente en apps móviles, entregando recomendaciones personalizadas en 50ms en lugar de 2 segundos.

Su Camino hacia la Maestría en Knowledge Distillation

¿Listo para crear modelos de IA eficientes y especializados?

- Entienda eficiencia de modelos con Quantization

- Explore optimización de producción vía Inference Optimization

- Aprenda sobre entrenamiento de modelos con Transfer Learning

Aprenda Más

Expanda su comprensión de conceptos de IA relacionados:

- Model Compression - Otras técnicas para modelos más pequeños

- Fine-tuning - Personalizando modelos pre-entrenados

- Pruning - Removiendo componentes innecesarios del modelo

- Neural Architecture Search - Diseñando estructuras de modelo eficientes

Recursos Externos

- Google Research on Model Compression - Artículos académicos sobre técnicas de destilación

- Hugging Face Distillation Tutorials - Guías prácticas para implementar knowledge distillation

- OpenAI Model Efficiency Research - Estrategias de despliegue de IA rentables

Sección de Preguntas Frecuentes

Preguntas Frecuentes sobre Knowledge Distillation

¿Qué es Knowledge Distillation?

Knowledge distillation es el proceso de entrenar un modelo estudiante más pequeño y rápido para imitar el comportamiento y conocimiento de un modelo maestro más grande y poderoso, logrando rendimiento similar a una fracción del costo computacional.

¿Qué tan pequeño puede ser el modelo estudiante?

Los modelos estudiante son típicamente 10-100x más pequeños que los maestros. Un enfoque común es destilar GPT-3 (175B parámetros) en modelos especializados de 1-7B parámetros que igualan rendimiento para tareas específicas mientras se ejecutan 50-100x más rápido.

¿Cuál es la diferencia entre knowledge distillation y fine-tuning?

Fine-tuning adapta un modelo pre-entrenado a nuevos datos usando la misma arquitectura de modelo. Knowledge distillation transfiere conocimiento de un modelo grande a una arquitectura más pequeña y diferente, creando un modelo más eficiente optimizado para despliegue.

¿El modelo estudiante iguala el rendimiento del maestro?

Para tareas estrechas y bien definidas, los modelos estudiante típicamente logran 85-95% del rendimiento del maestro. La compensación es amplitud: los estudiantes sobresalen en tareas específicas pero carecen de las capacidades generales del maestro.

¿Cuándo debo usar knowledge distillation?

Use knowledge distillation cuando tenga costos altos de inferencia, necesite tiempos de respuesta rápidos, quiera desplegar en dispositivos edge, o necesite rendimiento de tarea específico sin capacidades generales del modelo. Es esencial para escalar aplicaciones de IA rentablemente.

Parte de la Colección de Términos de IA. Última actualización: 2026-02-09

Founder & CEO

On this page

- Del Monopolio de Modelos Grandes a Inteligencia Eficiente

- Entendiendo para Líderes de Negocio

- Elementos Clave de Knowledge Distillation

- El Proceso de Knowledge Distillation

- Tipos de Knowledge Distillation

- Knowledge Distillation en Acción

- Su Camino hacia la Maestría en Knowledge Distillation

- Aprenda Más

- Recursos Externos

- Sección de Preguntas Frecuentes