Bahasa Indonesia

Apa itu Quantization? Membuat Model AI Ramping dan Cepat

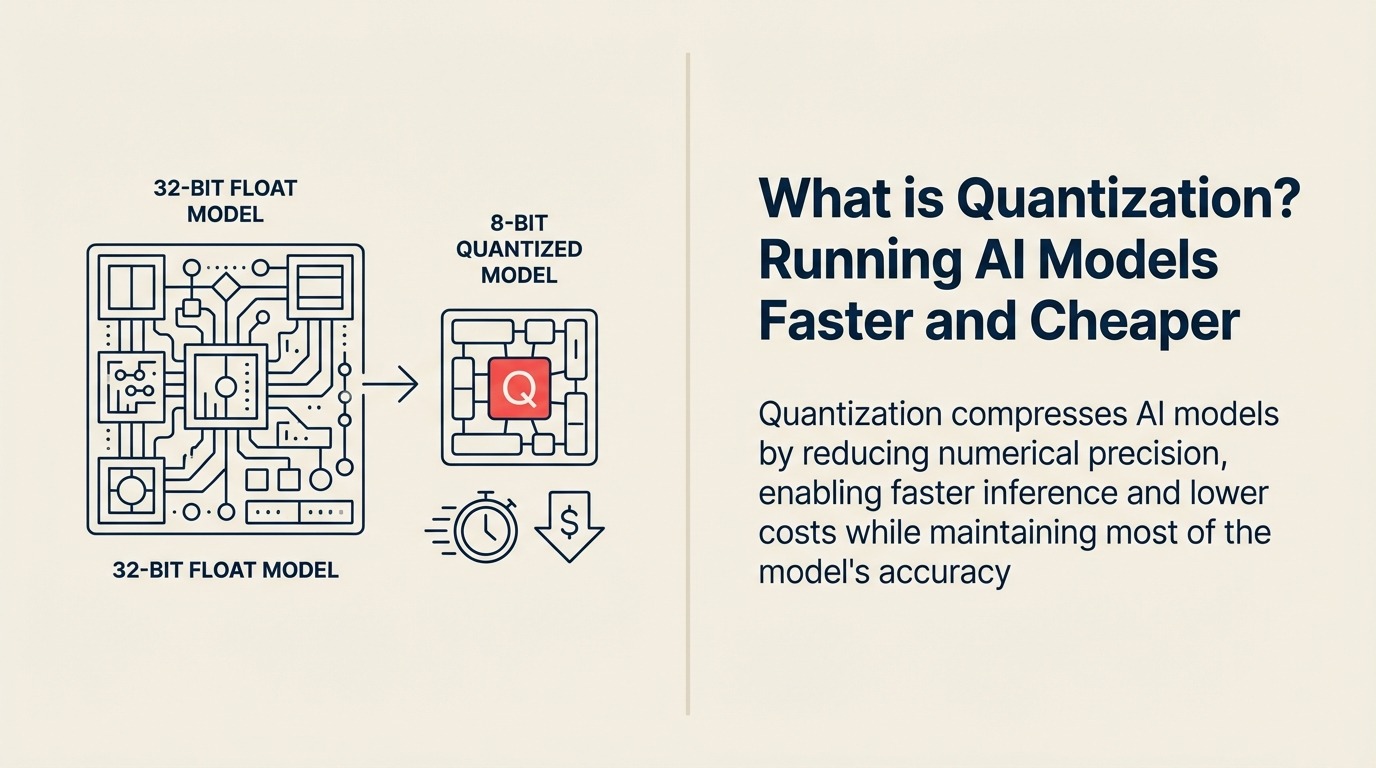

Menjalankan model AI yang kuat menghabiskan ribuan dolar per jam dan memerlukan GPU data center. Tapi bagaimana jika Anda bisa mengecilkan model yang sama hingga 75%, menjalankannya di laptop, dan masih mendapatkan 95% kinerja? Quantization telah menjadi senjata rahasia untuk deploy large language models dalam skala besar, mengubah AI dari teknologi cloud-only yang mahal menjadi sesuatu yang berjalan efisien di edge devices dan hardware konsumen.

Menjalankan model AI yang kuat menghabiskan ribuan dolar per jam dan memerlukan GPU data center. Tapi bagaimana jika Anda bisa mengecilkan model yang sama hingga 75%, menjalankannya di laptop, dan masih mendapatkan 95% kinerja? Quantization telah menjadi senjata rahasia untuk deploy large language models dalam skala besar, mengubah AI dari teknologi cloud-only yang mahal menjadi sesuatu yang berjalan efisien di edge devices dan hardware konsumen.

Dari Kemewahan Riset ke Kebutuhan Production

Quantization muncul sebagai teknik kritis sekitar tahun 2017 ketika peneliti menyadari bahwa model AI yang dilatih dengan angka presisi tinggi (32-bit floating point) dapat berjalan secara efektif dengan presisi yang jauh lebih rendah (integer 8-bit atau bahkan 4-bit) setelah pelatihan selesai.

NVIDIA mendefinisikan quantization sebagai "proses mengurangi jumlah bit yang digunakan untuk merepresentasikan weight dan activation model, mengurangi ukuran model dan persyaratan komputasi sambil mempertahankan level akurasi yang dapat diterima untuk tugas inference."

Bidang ini meledak ketika perusahaan menemukan bahwa model yang di-quantize dapat berjalan 4x lebih cepat, menggunakan memori 75% lebih sedikit, dan menghabiskan biaya sebagian kecil untuk beroperasi—sambil memberikan hasil yang hampir identik untuk sebagian besar aplikasi bisnis.

Pemahaman untuk Pemimpin Bisnis

Bagi pemimpin bisnis, quantization berarti menjalankan kemampuan AI yang sama dengan sebagian kecil biaya dan latensi—memungkinkan AI real-time di perangkat mobile, mengurangi tagihan cloud hingga 70%, dan deploy model yang kuat di mana konektivitas jaringan terbatas atau mahal.

Bayangkan sebagai perbedaan antara mengirim gambar RAW resolusi tinggi versus JPEG terkompresi. Sebagian besar penonton tidak dapat membedakannya, tetapi JPEG 10x lebih kecil dan memuat secara instan. Quantization melakukan hal yang sama untuk model AI, mengompresnya tanpa kehilangan kualitas yang terlihat untuk sebagian besar kasus penggunaan.

Secara praktis, quantization memungkinkan Anda menjalankan model kelas ChatGPT di smartphone, memproses query pelanggan dalam milidetik alih-alih detik, dan memotong biaya infrastruktur AI Anda hingga 60-80%.

Elemen Kunci Quantization

Quantization terdiri dari komponen-komponen esensial berikut:

• Precision Reduction: Mengonversi angka presisi tinggi (32-bit floating point) ke presisi lebih rendah (integer 16-bit, 8-bit, atau bahkan 4-bit), secara dramatis mengurangi persyaratan memori

• Calibration: Menganalisis weight dan activation model untuk menentukan faktor penskalaan optimal yang meminimalkan kehilangan akurasi selama konversi

• Hardware Optimization: Memanfaatkan prosesor khusus yang menjalankan aritmatika integer jauh lebih cepat daripada operasi floating-point, mempercepat kecepatan inference

• Accuracy Preservation: Memilih dengan hati-hati layer dan operasi mana yang akan di-quantize untuk mempertahankan kinerja model pada tugas kritis

• Dynamic vs Static: Memilih antara meng-quantize weight saja (static) atau meng-quantize activation selama runtime (dynamic) berdasarkan kebutuhan kinerja

Proses Quantization

Menerapkan quantization mengikuti langkah-langkah berikut:

Train Full Precision: Mulai dengan model standar yang dilatih menggunakan angka floating-point 32-bit, memastikan model mempelajari semua pola dan nuansa dalam data Anda

Analyze Sensitivity: Tentukan layer model mana yang paling sensitif terhadap pengurangan presisi dan mana yang dapat dikompresi secara agresif tanpa kehilangan akurasi

Apply Quantization: Konversi weight dan potensial activation ke presisi lebih rendah, menggunakan data kalibrasi untuk mengoptimalkan proses konversi dan meminimalkan kehilangan informasi

Transformasi ini mengambil model 7GB dan mengompresnya menjadi 2GB sambil mempertahankan 95%+ kinerja asli.

Jenis Quantization

Quantization hadir dalam beberapa pendekatan:

Tipe 1: Post-Training Quantization (PTQ) Terbaik untuk: Deployment cepat tanpa retraining Fitur kunci: Quantize setelah pelatihan selesai Contoh: Mengonversi model GPT pre-trained ke 8-bit untuk inference lebih cepat

Tipe 2: Quantization-Aware Training (QAT) Terbaik untuk: Preservasi akurasi maksimum Fitur kunci: Model belajar selama pelatihan untuk ramah quantization Contoh: Melatih model vision yang mengantisipasi deployment 4-bit

Tipe 3: Dynamic Quantization Terbaik untuk: Model dengan ukuran input yang bervariasi Fitur kunci: Weight di-quantize, activation dikonversi saat runtime Contoh: Model bahasa yang memproses panjang teks berbeda

Tipe 4: Mixed-Precision Quantization Terbaik untuk: Menyeimbangkan kecepatan dan akurasi Fitur kunci: Level presisi berbeda untuk layer berbeda Contoh: 4-bit untuk sebagian besar layer, 8-bit untuk attention heads

Quantization dalam Praktik

Berikut cara bisnis benar-benar menggunakan quantization:

Contoh Mobile AI: Model Llama 2 dari Meta yang di-quantize ke presisi 4-bit berjalan di perangkat iPhone dan Android, memungkinkan asisten AI on-device tanpa mengirim data ke cloud. Waktu respons turun dari 2 detik menjadi 200 milidetik.

Contoh Pengurangan Biaya Cloud: Anthropic meng-quantize model Claude untuk kasus penggunaan tertentu, mengurangi biaya inference hingga 70% sambil mempertahankan 96% skor kualitas asli. Ini memungkinkan harga lebih rendah untuk pelanggan API.

Contoh Edge Computing: Tesla menggunakan neural network yang di-quantize untuk autonomous driving, menjalankan model vision kompleks di hardware mobil pada 36 frame per detik—tidak mungkin dengan model presisi penuh.

Jalur Anda Menuju Penguasaan Quantization

Siap membuat model AI Anda ramping dan cepat?

- Pahami optimisasi model dengan Inference Optimization

- Jelajahi model lebih kecil melalui Knowledge Distillation

- Pelajari tentang pelatihan efisien dengan Transfer Learning

External Resources

Jelajahi penelitian dan dokumentasi otoritatif tentang quantization:

- NVIDIA Deep Learning Inference Guide - Dokumentasi komprehensif tentang teknik quantization dan optimisasi

- Hugging Face Quantization Guide - Panduan implementasi praktis dan alat untuk quantization model

- PyTorch Quantization Documentation - Referensi teknis untuk framework dan metode quantization

Learn More

Perluas pemahaman Anda tentang konsep AI terkait:

- Model Compression - Teknik lain untuk mengurangi ukuran model

- Edge AI - Menjalankan AI di perangkat alih-alih cloud

- Inference - Memahami proses prediksi AI

- Neural Architecture Search - Merancang struktur model yang efisien

FAQ Section

Frequently Asked Questions about Quantization

Apa itu Quantization dalam AI?

Quantization adalah proses mengurangi presisi numerik weight dan activation model AI, mengonversinya dari format presisi tinggi (32-bit float) ke format presisi lebih rendah (integer 8-bit atau 4-bit) untuk mengurangi ukuran model dan meningkatkan kecepatan inference.

Apakah quantization merusak akurasi model?

Quantization yang diterapkan dengan benar biasanya mempertahankan 95-99% akurasi asli. Kuncinya adalah kalibrasi dan memilih level presisi yang sesuai untuk komponen model yang berbeda.

Apa perbedaan antara quantization 8-bit dan 4-bit?

Quantization 8-bit memberikan keseimbangan yang baik antara kompresi (4x lebih kecil) dan preservasi akurasi. Quantization 4-bit menawarkan kompresi ekstrem (8x lebih kecil) tetapi memerlukan implementasi yang lebih hati-hati untuk mempertahankan akurasi yang dapat diterima.

Kapan saya harus menggunakan quantization?

Quantization berharga ketika deploy model ke edge devices dengan sumber daya terbatas, mengurangi biaya inference cloud, mencapai persyaratan latensi lebih rendah, atau menjalankan model di lingkungan dengan bandwidth terbatas.

Apakah semua model AI dapat di-quantize?

Sebagian besar neural network dapat di-quantize secara efektif. Large language models, model computer vision, dan sistem rekomendasi semuanya mendapat manfaat dari quantization. Beberapa model khusus atau tugas yang memerlukan presisi ekstrem mungkin memerlukan validasi yang hati-hati.

Bagian dari AI Terms Collection. Terakhir diperbarui: 2026-02-09