O que é Quantization? Tornando Modelos de IA Leves e Rápidos

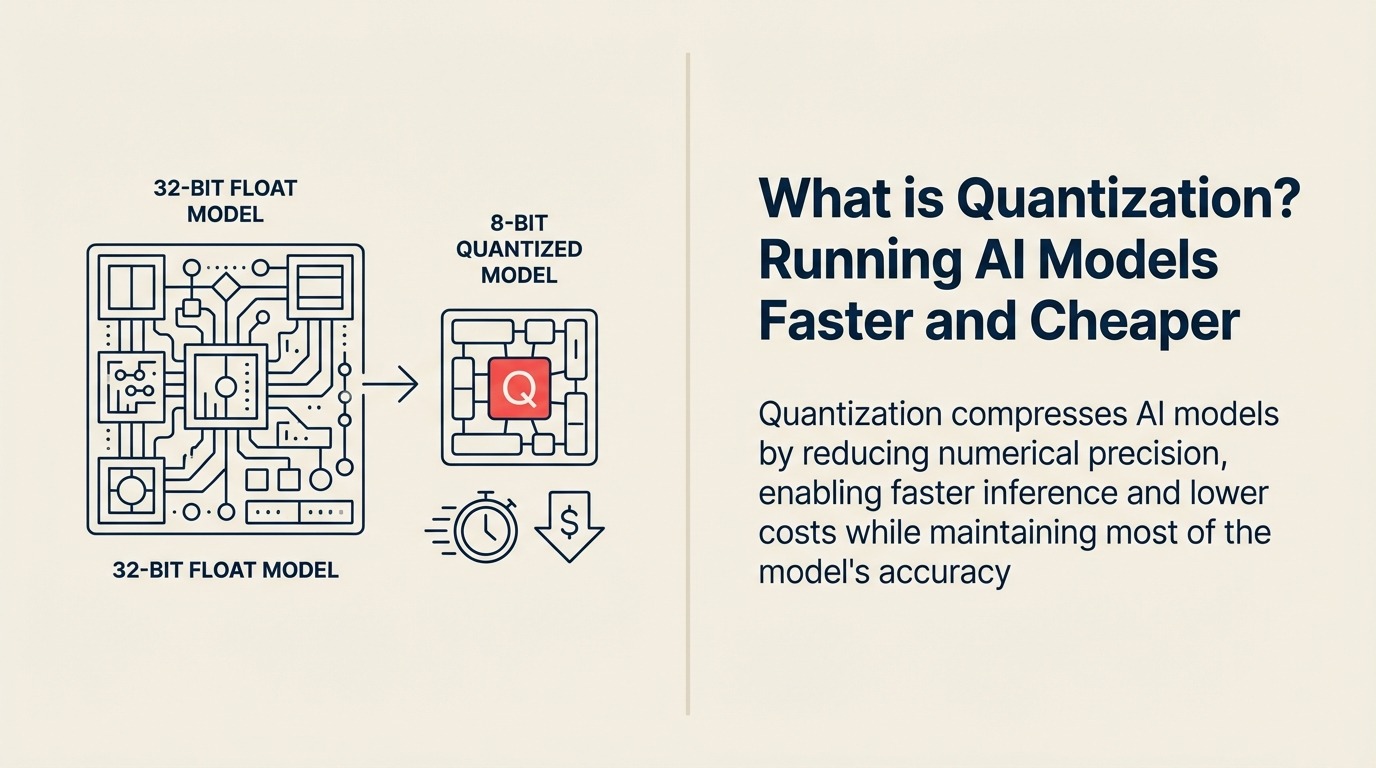

Executar um modelo de IA poderoso custa milhares de dólares por hora e requer GPUs de data center. Mas e se você pudesse reduzir esse mesmo modelo em 75%, executá-lo em um laptop e ainda obter 95% do desempenho? Quantization tornou-se a arma secreta para implantar large language models em escala, transformando IA de uma tecnologia cara apenas em nuvem em algo que funciona eficientemente em dispositivos edge e hardware de consumidor.

Executar um modelo de IA poderoso custa milhares de dólares por hora e requer GPUs de data center. Mas e se você pudesse reduzir esse mesmo modelo em 75%, executá-lo em um laptop e ainda obter 95% do desempenho? Quantization tornou-se a arma secreta para implantar large language models em escala, transformando IA de uma tecnologia cara apenas em nuvem em algo que funciona eficientemente em dispositivos edge e hardware de consumidor.

De Luxo de Pesquisa a Necessidade de Produção

Quantization surgiu como uma técnica crítica por volta de 2017, quando pesquisadores perceberam que modelos de IA treinados com números de alta precisão (ponto flutuante de 32 bits) podiam funcionar efetivamente com precisão muito menor (inteiros de 8 bits ou até 4 bits) após o treinamento estar completo.

A NVIDIA define quantization como "o processo de reduzir o número de bits usados para representar pesos e ativações do modelo, diminuindo o tamanho do modelo e os requisitos computacionais, mantendo níveis de precisão aceitáveis para tarefas de inferência."

O campo explodiu quando empresas descobriram que modelos quantizados podiam executar 4x mais rápido, usar 75% menos memória e custar uma fração para operar—entregando resultados quase idênticos para a maioria das aplicações empresariais.

Fazendo Sentido para Líderes de Negócios

Para líderes de negócios, quantization significa executar as mesmas capacidades de IA a uma fração do custo e latência—permitindo IA em tempo real em dispositivos móveis, reduzindo contas de nuvem em 70% e implantando modelos poderosos onde a conectividade de rede é limitada ou cara.

Pense nisso como a diferença entre enviar imagens RAW de alta resolução versus JPEGs comprimidos. A maioria dos espectadores não consegue notar a diferença, mas o JPEG é 10x menor e carrega instantaneamente. Quantization faz o mesmo para modelos de IA, comprimindo-os sem perda de qualidade perceptível para a maioria dos casos de uso.

Em termos práticos, quantization permite executar modelos classe ChatGPT em smartphones, processar consultas de clientes em milissegundos em vez de segundos e cortar seus custos de infraestrutura de IA em 60-80%.

Elementos-Chave de Quantization

Quantization consiste nestes componentes essenciais:

• Redução de Precisão: Converter números de alta precisão (ponto flutuante de 32 bits) para precisão menor (inteiros de 16 bits, 8 bits ou até 4 bits), reduzindo drasticamente os requisitos de memória

• Calibração: Analisar pesos e ativações do modelo para determinar fatores de escala ideais que minimizem a perda de precisão durante a conversão

• Otimização de Hardware: Aproveitar processadores especializados que executam aritmética de inteiros muito mais rápido que operações de ponto flutuante, acelerando a velocidade de inferência

• Preservação de Precisão: Selecionar cuidadosamente quais camadas e operações quantizar para manter o desempenho do modelo em tarefas críticas

• Dinâmica vs Estática: Escolher entre quantizar apenas pesos (estática) ou quantizar ativações durante runtime (dinâmica) com base nas necessidades de desempenho

O Processo de Quantization

Implementar quantization segue estas etapas:

Treinar em Precisão Total: Começar com um modelo padrão treinado usando números de ponto flutuante de 32 bits, garantindo que o modelo aprenda todos os padrões e nuances em seus dados

Analisar Sensibilidade: Determinar quais camadas do modelo são mais sensíveis à redução de precisão e quais podem ser comprimidas agressivamente sem perda de precisão

Aplicar Quantization: Converter pesos e potencialmente ativações para precisão menor, usando dados de calibração para otimizar o processo de conversão e minimizar a perda de informação

Esta transformação pega um modelo de 7GB e o comprime para 2GB, mantendo 95%+ do desempenho original.

Tipos de Quantization

Quantization vem em várias abordagens:

Tipo 1: Post-Training Quantization (PTQ) Melhor para: Implantação rápida sem retreinamento Característica principal: Quantizar após o treinamento estar completo Exemplo: Converter um modelo GPT pré-treinado para 8 bits para inferência mais rápida

Tipo 2: Quantization-Aware Training (QAT) Melhor para: Preservação máxima de precisão Característica principal: Modelo aprende durante o treinamento a ser amigável à quantização Exemplo: Treinar um modelo de visão que antecipa implantação de 4 bits

Tipo 3: Dynamic Quantization Melhor para: Modelos com tamanhos de entrada variáveis Característica principal: Pesos quantizados, ativações convertidas em runtime Exemplo: Language models que processam diferentes comprimentos de texto

Tipo 4: Mixed-Precision Quantization Melhor para: Equilibrar velocidade e precisão Característica principal: Diferentes níveis de precisão para diferentes camadas Exemplo: 4 bits para a maioria das camadas, 8 bits para attention heads

Quantization em Ação

Veja como empresas realmente usam quantization:

Exemplo de IA Móvel: Os modelos Llama 2 da Meta quantizados para precisão de 4 bits rodam em dispositivos iPhone e Android, permitindo assistentes de IA no dispositivo sem enviar dados para a nuvem. Os tempos de resposta caíram de 2 segundos para 200 milissegundos.

Exemplo de Redução de Custos em Nuvem: A Anthropic quantizou modelos Claude para certos casos de uso, reduzindo os custos de inferência em 70%, mantendo 96% dos scores de qualidade originais. Isso permitiu preços mais baixos para clientes de API.

Exemplo de Edge Computing: A Tesla usa redes neurais quantizadas para direção autônoma, executando modelos de visão complexos em hardware de carro a 36 quadros por segundo—impossível com modelos de precisão total.

Seu Caminho para Dominar Quantization

Pronto para tornar seus modelos de IA leves e rápidos?

- Entenda otimização de modelos com Inference Optimization

- Explore modelos menores via Knowledge Distillation

- Aprenda sobre treinamento eficiente com Transfer Learning

Recursos Externos

Explore pesquisas e documentação oficiais sobre quantization:

- NVIDIA Deep Learning Inference Guide - Documentação abrangente sobre técnicas de quantização e otimização

- Hugging Face Quantization Guide - Guias práticos de implementação e ferramentas para quantização de modelos

- PyTorch Quantization Documentation - Referência técnica para frameworks e métodos de quantização

Saiba Mais

Expanda seu entendimento de conceitos relacionados de IA:

- Model Compression - Outras técnicas para reduzir tamanho de modelo

- Edge AI - Executando IA em dispositivos em vez de nuvem

- Inference - Entendendo processo de predição de IA

- Neural Architecture Search - Projetando estruturas de modelo eficientes

FAQ Section

Perguntas Frequentes sobre Quantization

O que é Quantization em IA?

Quantization é o processo de reduzir a precisão numérica de pesos e ativações de modelos de IA, convertendo-os de formatos de alta precisão (float de 32 bits) para formatos de precisão menor (inteiros de 8 bits ou 4 bits) para reduzir o tamanho do modelo e aumentar a velocidade de inferência.

Quantization prejudica a precisão do modelo?

Quantization adequadamente implementada tipicamente mantém 95-99% da precisão original. A chave é calibração e escolher níveis de precisão apropriados para diferentes componentes do modelo.

Qual é a diferença entre quantização de 8 bits e 4 bits?

Quantização de 8 bits fornece um bom equilíbrio de compressão (4x menor) e preservação de precisão. Quantização de 4 bits oferece compressão extrema (8x menor), mas requer implementação mais cuidadosa para manter precisão aceitável.

Quando devo usar quantization?

Quantization é valiosa ao implantar modelos em dispositivos edge com recursos limitados, reduzir custos de inferência em nuvem, alcançar requisitos de latência mais baixos ou executar modelos em ambientes com largura de banda restrita.

Todos os modelos de IA podem ser quantizados?

A maioria das redes neurais pode ser quantizada efetivamente. Large language models, modelos de visão computacional e sistemas de recomendação todos se beneficiam de quantization. Alguns modelos especializados ou tarefas que requerem precisão extrema podem precisar de validação cuidadosa.

Parte da AI Terms Collection. Última atualização: 2026-02-09