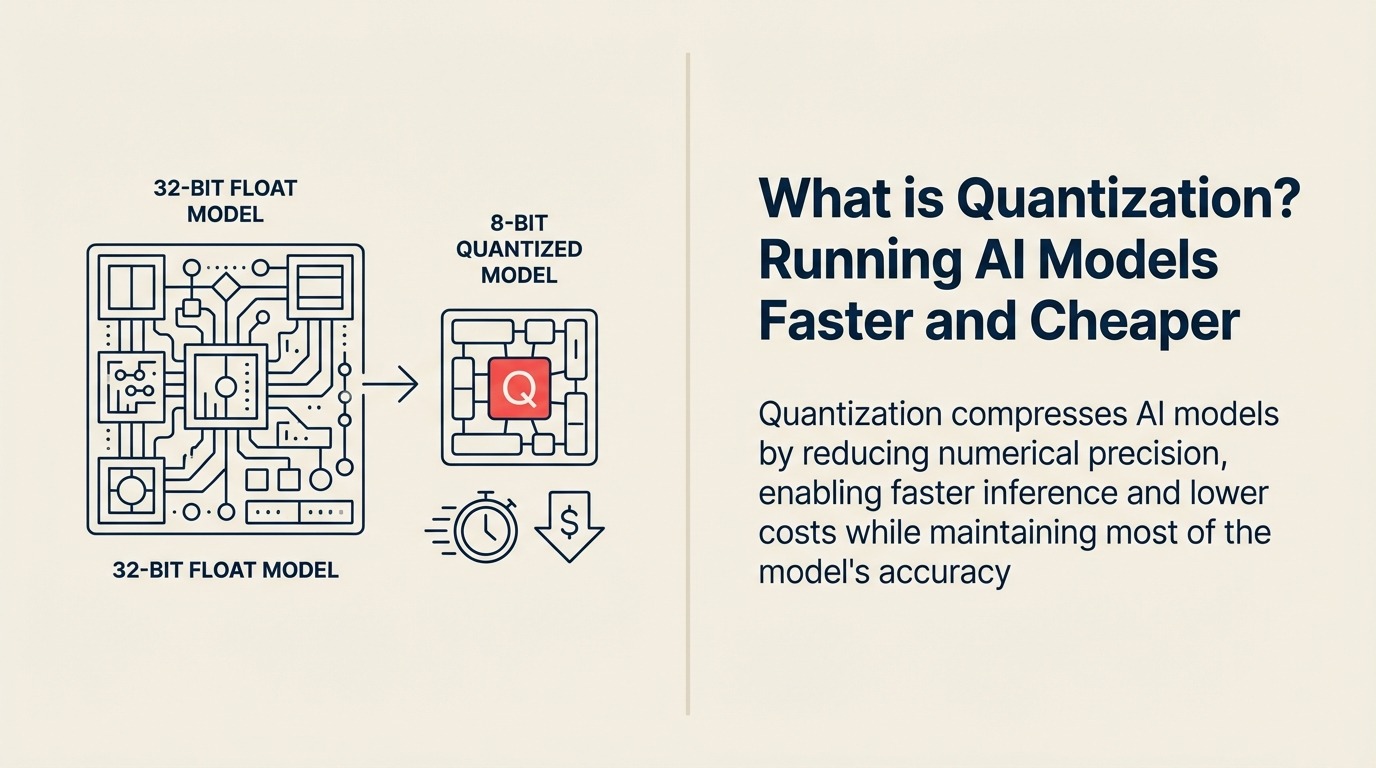

¿Qué es Quantization? Haciendo Modelos de IA Eficientes y Rápidos

Ejecutar un modelo de IA poderoso cuesta miles de dólares por hora y requiere GPUs de centro de datos. ¿Pero qué pasaría si pudiera reducir ese mismo modelo en un 75%, ejecutarlo en una laptop, y aún así obtener el 95% del rendimiento? Quantization se ha convertido en el arma secreta para implementar large language models a escala, transformando la IA de una tecnología costosa solo en la nube a algo que se ejecuta eficientemente en dispositivos edge y hardware de consumidor.

Ejecutar un modelo de IA poderoso cuesta miles de dólares por hora y requiere GPUs de centro de datos. ¿Pero qué pasaría si pudiera reducir ese mismo modelo en un 75%, ejecutarlo en una laptop, y aún así obtener el 95% del rendimiento? Quantization se ha convertido en el arma secreta para implementar large language models a escala, transformando la IA de una tecnología costosa solo en la nube a algo que se ejecuta eficientemente en dispositivos edge y hardware de consumidor.

De Lujo de Investigación a Necesidad de Producción

Quantization surgió como técnica crítica alrededor de 2017 cuando los investigadores se dieron cuenta de que los modelos de IA entrenados con números de alta precisión (punto flotante de 32 bits) podían ejecutarse efectivamente con precisión mucho menor (enteros de 8 bits o incluso 4 bits) después de que el entrenamiento estaba completo.

NVIDIA define quantization como "el proceso de reducir el número de bits utilizados para representar pesos y activaciones del modelo, disminuyendo el tamaño del modelo y los requisitos computacionales mientras se mantienen niveles de precisión aceptables para tareas de inferencia."

El campo explotó cuando las empresas descubrieron que los modelos cuantizados podían ejecutarse 4 veces más rápido, usar 75% menos memoria, y costar una fracción para operar—mientras entregan resultados casi idénticos para la mayoría de aplicaciones empresariales.

Dando Sentido para Líderes Empresariales

Para los líderes empresariales, quantization significa ejecutar las mismas capacidades de IA a una fracción del costo y latencia—permitiendo IA en tiempo real en dispositivos móviles, reduciendo facturas de nube en 70%, y implementando modelos poderosos donde la conectividad de red es limitada o costosa.

Piense en ello como la diferencia entre enviar imágenes RAW de alta resolución versus JPEGs comprimidos. La mayoría de los espectadores no pueden notar la diferencia, pero el JPEG es 10 veces más pequeño y carga instantáneamente. Quantization hace lo mismo para modelos de IA, comprimiéndolos sin pérdida de calidad notable para la mayoría de casos de uso.

En términos prácticos, quantization le permite ejecutar modelos clase ChatGPT en smartphones, procesar consultas de clientes en milisegundos en lugar de segundos, y reducir sus costos de infraestructura de IA en 60-80%.

Elementos Clave de Quantization

Quantization consiste en estos componentes esenciales:

• Reducción de Precisión: Convertir números de alta precisión (punto flotante de 32 bits) a menor precisión (enteros de 16 bits, 8 bits o incluso 4 bits), reduciendo dramáticamente los requisitos de memoria

• Calibración: Analizar pesos y activaciones del modelo para determinar factores de escala óptimos que minimicen la pérdida de precisión durante la conversión

• Optimización de Hardware: Aprovechar procesadores especializados que ejecutan aritmética de enteros mucho más rápido que operaciones de punto flotante, acelerando la velocidad de inferencia

• Preservación de Precisión: Seleccionar cuidadosamente qué capas y operaciones cuantizar para mantener el rendimiento del modelo en tareas críticas

• Dinámica vs Estática: Elegir entre cuantizar solo pesos (estática) o cuantizar activaciones durante el tiempo de ejecución (dinámica) basado en necesidades de rendimiento

El Proceso de Quantization

Implementar quantization sigue estos pasos:

Entrenar Precisión Completa: Comenzar con un modelo estándar entrenado usando números de punto flotante de 32 bits, asegurando que el modelo aprenda todos los patrones y matices en sus datos

Analizar Sensibilidad: Determinar qué capas del modelo son más sensibles a la reducción de precisión y cuáles pueden ser agresivamente comprimidas sin pérdida de precisión

Aplicar Quantization: Convertir pesos y potencialmente activaciones a menor precisión, usando datos de calibración para optimizar el proceso de conversión y minimizar pérdida de información

Esta transformación toma un modelo de 7GB y lo comprime a 2GB mientras mantiene 95%+ del rendimiento original.

Tipos de Quantization

Quantization viene en varios enfoques:

Tipo 1: Post-Training Quantization (PTQ) Mejor para: Implementación rápida sin reentrenamiento Característica clave: Cuantizar después de que el entrenamiento está completo Ejemplo: Convertir un modelo GPT pre-entrenado a 8 bits para inferencia más rápida

Tipo 2: Quantization-Aware Training (QAT) Mejor para: Máxima preservación de precisión Característica clave: El modelo aprende durante el entrenamiento a ser amigable con quantization Ejemplo: Entrenar un modelo de visión que anticipa implementación de 4 bits

Tipo 3: Dynamic Quantization Mejor para: Modelos con tamaños de entrada variables Característica clave: Pesos cuantizados, activaciones convertidas en tiempo de ejecución Ejemplo: Modelos de lenguaje que procesan diferentes longitudes de texto

Tipo 4: Mixed-Precision Quantization Mejor para: Equilibrar velocidad y precisión Característica clave: Diferentes niveles de precisión para diferentes capas Ejemplo: 4 bits para la mayoría de capas, 8 bits para cabezales de atención

Quantization en Acción

Así es como las empresas realmente usan quantization:

Ejemplo de IA Móvil: Los modelos Llama 2 de Meta cuantizados a precisión de 4 bits se ejecutan en dispositivos iPhone y Android, permitiendo asistentes de IA en el dispositivo sin enviar datos a la nube. Los tiempos de respuesta bajaron de 2 segundos a 200 milisegundos.

Ejemplo de Reducción de Costos en la Nube: Anthropic cuantizó modelos Claude para ciertos casos de uso, reduciendo costos de inferencia en 70% mientras mantenían el 96% de puntuaciones de calidad original. Esto permitió precios más bajos para clientes de API.

Ejemplo de Edge Computing: Tesla usa redes neuronales cuantizadas para conducción autónoma, ejecutando modelos de visión complejos en hardware de automóvil a 36 cuadros por segundo—imposible con modelos de precisión completa.

Su Camino a la Maestría de Quantization

¿Listo para hacer sus modelos de IA eficientes y rápidos?

- Entienda la optimización de modelos con Inference Optimization

- Explore modelos más pequeños vía Knowledge Distillation

- Aprenda sobre entrenamiento eficiente con Transfer Learning

External Resources

Explore investigación y documentación autorizada sobre quantization:

- NVIDIA Deep Learning Inference Guide - Documentación completa sobre técnicas de quantization y optimización

- Hugging Face Quantization Guide - Guías de implementación práctica y herramientas para quantization de modelos

- PyTorch Quantization Documentation - Referencia técnica para frameworks y métodos de quantization

Aprenda Más

Amplíe su comprensión de conceptos relacionados de IA:

- Model Compression - Otras técnicas para reducir tamaño de modelo

- Edge AI - Ejecutar IA en dispositivos en lugar de la nube

- Inference - Entender el proceso de predicción de IA

- Neural Architecture Search - Diseñar estructuras de modelo eficientes

FAQ Section

Preguntas Frecuentes sobre Quantization

¿Qué es Quantization en IA?

Quantization es el proceso de reducir la precisión numérica de pesos y activaciones de modelos de IA, convirtiéndolos de formatos de alta precisión (float de 32 bits) a formatos de menor precisión (enteros de 8 bits o 4 bits) para reducir el tamaño del modelo y aumentar la velocidad de inferencia.

¿Quantization daña la precisión del modelo?

Quantization implementada correctamente típicamente mantiene 95-99% de la precisión original. La clave es la calibración y elegir niveles de precisión apropiados para diferentes componentes del modelo.

¿Cuál es la diferencia entre quantization de 8 bits y 4 bits?

Quantization de 8 bits proporciona un buen balance de compresión (4 veces más pequeño) y preservación de precisión. Quantization de 4 bits ofrece compresión extrema (8 veces más pequeño) pero requiere implementación más cuidadosa para mantener precisión aceptable.

¿Cuándo debo usar quantization?

Quantization es valiosa al implementar modelos en dispositivos edge con recursos limitados, reducir costos de inferencia en la nube, lograr requisitos de menor latencia, o ejecutar modelos en entornos con ancho de banda limitado.

¿Todos los modelos de IA pueden ser cuantizados?

La mayoría de las redes neuronales pueden ser cuantizadas efectivamente. Large language models, modelos de computer vision y sistemas de recomendación todos se benefician de quantization. Algunos modelos especializados o tareas que requieren precisión extrema pueden necesitar validación cuidadosa.

Parte de la AI Terms Collection. Última actualización: 2026-02-09

Founder & CEO