Apakah Multimodal AI? Satu Model untuk Semua Kandungan Anda

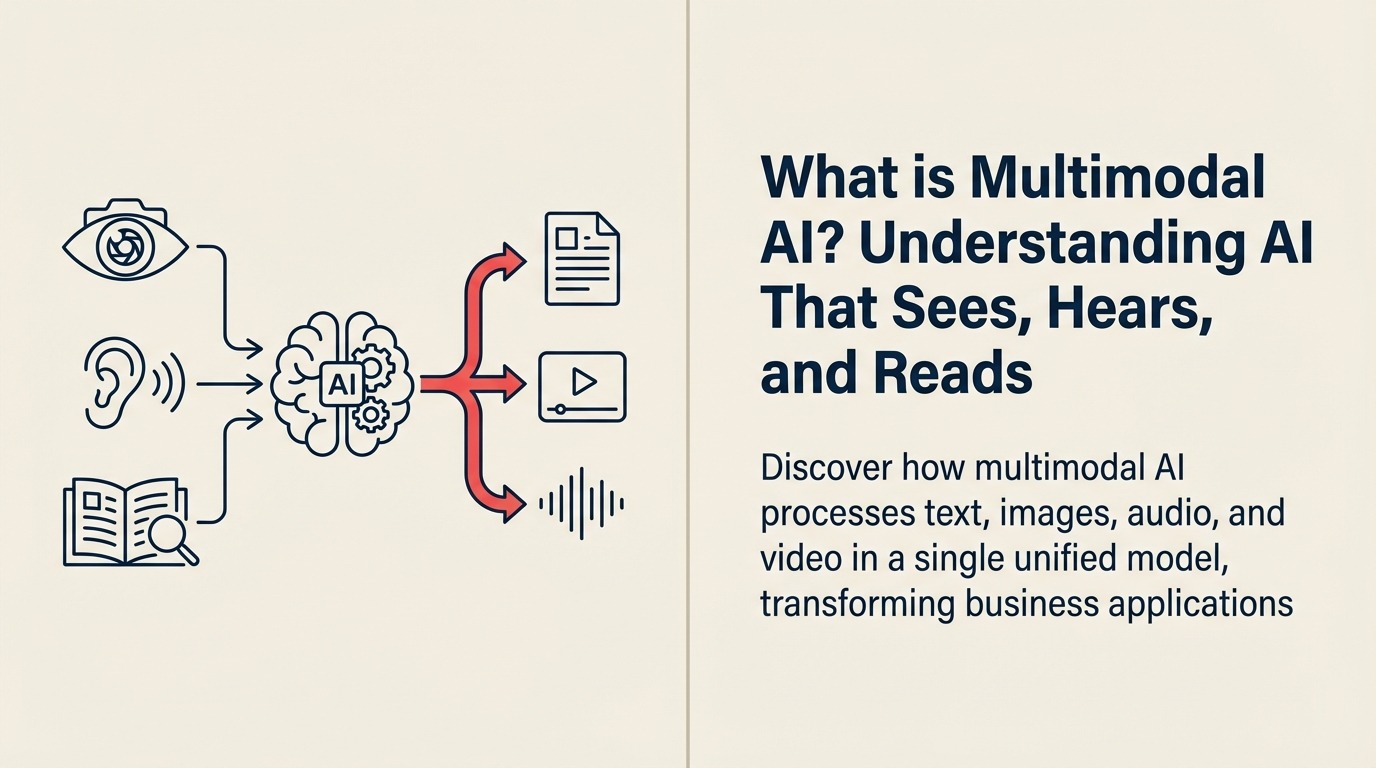

Bayangkan AI yang boleh membaca email anda, menganalisis hamparan dilampirkan, menonton video demo, dan bertindak balas dengan pandangan daripada ketiga-tiganya. Tiada pertukaran antara alat. Tiada ringkasan manual. Hanya satu sistem pintar yang memahami segala yang anda berikan kepadanya. Itulah AI multimodal.

Bayangkan AI yang boleh membaca email anda, menganalisis hamparan dilampirkan, menonton video demo, dan bertindak balas dengan pandangan daripada ketiga-tiganya. Tiada pertukaran antara alat. Tiada ringkasan manual. Hanya satu sistem pintar yang memahami segala yang anda berikan kepadanya. Itulah AI multimodal.

Revolusi AI Bersatu

Multimodal AI muncul apabila penyelidik menyedari batasan sistem input tunggal. Model AI awal hanya boleh memproses teks atau hanya imej. Menjelang 2023, model terobosan seperti GPT-4V dan Gemini Google mengubah segalanya.

Menurut Google Research, multimodal AI mewakili "model yang boleh memproses dan berfikir merentasi berbilang jenis data input—termasuk teks, imej, audio, dan video—dalam satu seni bina bersatu, mencerminkan cara manusia secara semula jadi melihat dan memahami dunia."

Terobosan datang apabila OpenAI melancarkan GPT-4 dengan keupayaan penglihatan pada September 2023, diikuti oleh Gemini Google pada Disember 2023 dan Claude 3 Anthropic pada Mac 2024, setiap satu menunjukkan bahawa AI akhirnya boleh menyamai keupayaan manusia untuk bekerja dengan media campuran.

Multimodal AI untuk Pemimpin Perniagaan

Untuk pemimpin perniagaan, AI multimodal seperti mengupah pakar yang boleh membaca dokumen, mentafsir carta, menonton video, dan mendengar panggilan—semuanya sekaligus—kemudian mensintesis pandangan merentasi setiap format yang dihasilkan perniagaan anda.

Fikirkan perbezaan antara mempunyai pakar berasingan untuk teks, imej, dan audio berbanding satu pakar yang memahami ketiga-tiganya bersama. Pakar multimodal melihat corak, sambungan, dan pandangan yang pakar yang bekerja secara terpisah akan terlepas.

Dalam istilah praktikal, AI multimodal boleh menganalisis panggilan pelanggan (audio), menyemak imej produk, membaca tiket sokongan (teks), dan mengenal pasti trend merentasi semua saluran serentak. Ini mewakili lonjakan besar melampaui model bahasa besar tradisional yang hanya mengendalikan teks.

Komponen Teras Multimodal AI

Sistem AI multimodal terdiri daripada elemen penting ini:

• Unified Encoder: Menukar jenis data berbeza—teks, imej, audio, video—ke dalam perwakilan biasa yang model boleh proses bersama, seperti penterjemah universal untuk format maklumat

• Cross-Modal Attention: Mekanisme yang membolehkan model memahami hubungan antara jenis input yang berbeza, seperti menyambungkan perkataan lisan dalam audio kepada objek dalam imej

• Shared Reasoning Layer: Enjin pemprosesan biasa yang berfikir tentang semua jenis input bersama, membolehkan sintesis sebenar berbanding analisis berasingan

• Modal Adapters: Komponen khusus yang mengendalikan ciri unik setiap jenis input sambil memberi makan kepada sistem bersatu

• Output Generation: Keupayaan untuk bertindak balas dalam berbilang format, daripada teks kepada imej kepada data berstruktur, bergantung pada apa yang paling sesuai untuk kes guna

Bagaimana Multimodal AI Beroperasi

Multimodal AI mengikut kitaran operasi ini:

Simultaneous Ingestion: Model menerima input merentasi berbilang format—katakan, imej produk, ulasan pelanggan teks, dan video demo—semuanya sekaligus

Unified Processing: Menukar semua input ke dalam perwakilan dalaman biasa, membolehkan model memahami hubungan merentasi modaliti, seperti bagaimana imej berkaitan dengan penerangan bertulis

Cross-Modal Reasoning: Menganalisis corak dan pandangan yang merangkumi berbilang jenis data, seperti menyedari bahawa sentimen audio positif berkorelasi dengan ciri produk visual tertentu

Kitaran ini berterusan dengan model belajar daripada maklum balas merentasi semua modaliti, menjadi lebih mahir dalam memahami bagaimana jenis maklumat berbeza bersambung.

Jenis Sistem Multimodal AI

Multimodal AI melayani fungsi perniagaan yang berbeza:

Jenis 1: Vision-Language Models Terbaik untuk: Pemahaman dokumen dan analisis visual Ciri utama: Gabungkan teks dan imej dengan lancar Contoh: GPT-4V menganalisis carta dan laporan

Jenis 2: Audio-Visual Models Terbaik untuk: Analisis video dan kecerdasan mesyuarat Ciri utama: Fahami ucapan dalam konteks kandungan visual Contoh: Ringkasan mesyuarat automatik dengan pengenalan pembicara

Jenis 3: Text-Image-Audio Systems Terbaik untuk: Analisis kandungan komprehensif Ciri utama: Proses semua jenis media utama bersama menggunakan generative AI Contoh: Google Gemini mengendalikan pertanyaan format campuran

Jenis 4: Sensor-Fusion Models Terbaik untuk: Aplikasi IoT dan dunia sebenar Ciri utama: Gabungkan data sensor berstruktur dengan media Contoh: Kawalan kualiti pembuatan dengan kamera dan ukuran

Multimodal AI Menyampaikan Hasil

Begini cara perniagaan mendeploy AI multimodal:

Contoh Penjagaan Kesihatan: Siemens Healthineers menggunakan AI multimodal untuk menganalisis imej perubatan, hasil makmal, dan nota klinikal bersama, mengurangkan masa diagnosis sebanyak 40% sambil menangkap isu yang sistem modaliti tunggal terlepas.

Contoh Runcit: Carian produk Amazon kini menggunakan AI multimodal untuk memahami pertanyaan seperti "tunjukkan saya kasut seperti dalam foto ini tetapi dalam biru," menggabungkan pengecaman imej dengan pemahaman teks untuk menyampaikan hasil 35% lebih tepat.

Contoh Perkhidmatan Kewangan: JPMorgan menganalisis panggilan pendapatan menggunakan AI multimodal yang memproses bahasa lisan, slaid pembentangan, dan dokumen kewangan serentak, mengenal pasti pandangan pelaburan 50% lebih cepat daripada pasukan penganalisis.

Melaksanakan Multimodal AI

Bersedia untuk menyatukan keupayaan AI anda?

- Mulakan dengan asas Large Language Models

- Fahami asas Computer Vision

- Ketahui tentang Natural Language Processing

- Pertimbangkan AI Orchestration untuk aliran kerja kompleks

Soalan Lazim

Soalan Lazim tentang Multimodal AI

Apakah Multimodal AI?

Multimodal AI merujuk kepada model yang boleh memproses dan berfikir merentasi berbilang jenis data input—termasuk teks, imej, audio, dan video—dalam satu seni bina bersatu, serupa dengan cara manusia secara semula jadi memahami dunia.

Apakah perbezaan antara AI multimodal dan AI tradisional?

Model AI tradisional memproses satu jenis data (hanya teks atau hanya imej). AI multimodal memproses berbilang jenis data serentak, memahami hubungan antara mereka dan menjana pandangan merentasi format.

Apakah jenis utama sistem AI multimodal?

Vision-Language Models (teks dan imej), Audio-Visual Models (ucapan dan video), Text-Image-Audio Systems (semua jenis media utama), dan Sensor-Fusion Models (data berstruktur tambah media).

Apakah contoh model AI multimodal?

GPT-4V (OpenAI), Gemini (Google), Claude 3 (Anthropic), dan model khusus seperti CLIP (imej-teks), Whisper (audio), dan ImageBind (semua modaliti).

Sumber Berkaitan

Terokai konsep berkaitan ini untuk memperdalam pemahaman anda tentang AI multimodal:

- Computer Vision - Bagaimana AI memproses dan memahami imej

- Neural Networks - Seni bina asas yang menggerakkan sistem multimodal

- Transformer Architecture - Asas teknikal di sebalik model multimodal moden

- Embeddings - Bagaimana jenis data berbeza ditukar kepada perwakilan biasa

Sumber Luaran

- Google Research - Multimodal AI - Kemajuan terkini dalam model AI bersatu

- Meta AI - Vision and Language - Penyelidikan tentang pemahaman silang modal

- Microsoft Research - Multimodal Systems - Aplikasi multimodal enterprise

Sebahagian daripada Koleksi Istilah AI. Dikemas kini terakhir: 2026-02-09