Bahasa Indonesia

Apa Itu Inference Optimization? Menskalakan AI Tanpa Menguras Anggaran

Melatih model AI sekali menghabiskan jutaan. Tapi menjalankan model itu miliaran kali menghabiskan lebih banyak lagi. Satu large language model yang melayani 100.000 pengguna harian dapat menghabiskan $50.000 per bulan untuk biaya compute. Inference optimization telah menjadi disiplin kritis yang memisahkan pilot AI dari produk AI yang menguntungkan, memungkinkan perusahaan melayani hasil berkualitas sama dengan biaya 10x lebih rendah dan kecepatan 5x lebih cepat.

Melatih model AI sekali menghabiskan jutaan. Tapi menjalankan model itu miliaran kali menghabiskan lebih banyak lagi. Satu large language model yang melayani 100.000 pengguna harian dapat menghabiskan $50.000 per bulan untuk biaya compute. Inference optimization telah menjadi disiplin kritis yang memisahkan pilot AI dari produk AI yang menguntungkan, memungkinkan perusahaan melayani hasil berkualitas sama dengan biaya 10x lebih rendah dan kecepatan 5x lebih cepat.

Dari Prototype ke Realitas Produksi

Inference optimization muncul sebagai bidang yang berbeda sekitar tahun 2019 ketika perusahaan menyadari bahwa akurasi model tidak cukup—sistem AI produksi perlu cepat, murah, dan dapat diskalakan. Yang dimulai sebagai tuning kinerja ad-hoc berkembang menjadi disiplin engineering sistematis.

NVIDIA mendefinisikan inference optimization sebagai "proses memaksimalkan throughput, meminimalkan latensi, dan mengurangi biaya komputasi untuk prediksi model AI di lingkungan produksi melalui optimasi software, akselerasi hardware, dan perbaikan arsitektur."

Bidang ini meledak ketika bisnis menemukan bahwa teknik optimasi sederhana dapat mengurangi biaya sebesar 70-90% sambil meningkatkan waktu respons dari detik ke milidetik—membuat aplikasi AI terasa instan dan layak secara ekonomi.

Memahami untuk Pemimpin Bisnis

Bagi pemimpin bisnis, inference optimization berarti memberikan kemampuan AI yang sama dengan sebagian kecil biaya dan latensi—memungkinkan aplikasi real-time, mengurangi pengeluaran infrastruktur sebesar 60-80%, dan menskalakan layanan AI secara menguntungkan saat penggunaan tumbuh secara eksponensial.

Anggap seperti perbedaan antara restoran yang memasak setiap pesanan secara individual versus menyiapkan bahan di awal, membatch pesanan serupa, dan menggunakan peralatan khusus. Keduanya menghasilkan kualitas makanan yang sama, tetapi yang satu 10x lebih efisien.

Dalam istilah praktis, inference optimization memungkinkan Anda melayani ribuan pengguna secara bersamaan tanpa menghancurkan tagihan cloud Anda, merespons query pelanggan dalam milidetik alih-alih detik, dan skala dari pilot ke produksi tanpa peningkatan biaya linear.

Elemen Kunci Inference Optimization

Inference optimization mencakup teknik penting ini:

• Batching: Memproses beberapa permintaan bersama-sama alih-alih satu per satu, secara dramatis meningkatkan throughput dengan memanfaatkan kemampuan pemrosesan paralel GPU

• Caching: Menyimpan query dan respons umum untuk menghindari komputasi redundan, mengurangi latensi dari detik ke milidetik untuk pertanyaan yang sering diajukan

• Hardware Acceleration: Menggunakan prosesor khusus (GPU, TPU, ASIC kustom) yang dioptimalkan untuk inference AI, menghasilkan speedup 10-100x dibanding CPU tujuan umum

• Model Compression: Mengurangi ukuran model melalui quantization dan pruning sambil mempertahankan akurasi, memungkinkan loading dan eksekusi lebih cepat

• Request Routing: Mengarahkan tipe query berbeda ke model yang sesuai (query sederhana ke model kecil, yang kompleks ke model besar), mengoptimalkan trade-off biaya-akurasi

Proses Inference Optimization

Mengimplementasikan inference optimization mengikuti langkah-langkah ini:

Measure Baseline: Profil kinerja inference saat ini, mengidentifikasi bottleneck dalam preprocessing, eksekusi model, dan postprocessing untuk memahami di mana upaya optimasi akan memiliki dampak maksimum

Apply Optimizations: Implementasikan batching untuk throughput, caching untuk permintaan umum, kompresi model untuk ukuran, dan akselerasi hardware untuk kecepatan—sering menggabungkan beberapa teknik

Benchmark and Iterate: Uji sistem yang dioptimalkan di bawah beban produksi, mengukur latensi, throughput, dan biaya untuk memastikan perbaikan memenuhi persyaratan bisnis tanpa mengorbankan kualitas

Proses ini mengubah proof-of-concept yang menangani 10 permintaan per detik menjadi sistem produksi yang melayani 10.000 permintaan per detik dengan total biaya lebih rendah.

Jenis Inference Optimization

Inference optimization menggunakan beberapa pendekatan:

Tipe 1: Software Optimization Terbaik untuk: Kemenangan cepat tanpa perubahan infrastruktur Fitur utama: Perbaikan tingkat kode dan tuning algoritma Contoh: Mengimplementasikan request batching untuk memproses 50 query secara bersamaan alih-alih sekuensial

Tipe 2: Hardware Acceleration Terbaik untuk: Peningkatan kinerja maksimum Fitur utama: Prosesor inference khusus Contoh: Pindah dari CPU ke NVIDIA T4 GPU untuk speedup 20x

Tipe 3: Model Optimization Terbaik untuk: Mengurangi persyaratan komputasi Fitur utama: Model yang lebih kecil, lebih cepat dengan kemampuan sama Contoh: Menggunakan knowledge distillation untuk menciptakan model 4x lebih kecil dengan akurasi 95% dari aslinya

Tipe 4: Architecture Optimization Terbaik untuk: Sistem produksi skala besar Fitur utama: Pemrosesan terdistribusi dan load balancing Contoh: Deployment multi-region dengan intelligent request routing

Inference Optimization dalam Aksi

Begini cara bisnis benar-benar menggunakan inference optimization:

Contoh E-commerce: Shopify mengoptimalkan mesin rekomendasi produk mereka dengan mengimplementasikan batching, caching, dan quantization model. Waktu respons turun dari 800ms ke 50ms, dan biaya infrastruktur berkurang 73% sambil melayani 10x lebih banyak permintaan.

Contoh Customer Service: Sistem AI routing tiket Zendesk memproses 100.000 tiket harian. Dengan meng-cache pola pertanyaan umum dan menggunakan model khusus yang lebih kecil untuk 80% query, mereka mengurangi biaya sebesar $200.000 per tahun.

Contoh Financial Services: Stripe mengoptimalkan inference deteksi penipuan untuk menganalisis transaksi dalam waktu kurang dari 100ms (dari 2 detik), menggabungkan akselerasi GPU, request batching, dan kompresi model. Ini memungkinkan pencegahan penipuan real-time tanpa dampak pengalaman pelanggan.

Jalur Anda Menuju Penguasaan Inference Optimization

Siap membuat sistem AI Anda cepat dan terjangkau?

- Pahami kompresi model dengan Quantization

- Jelajahi arsitektur efisien via Knowledge Distillation

- Pelajari tentang deployment produksi dengan MLOps

Pelajari Lebih Lanjut

Perluas pemahaman Anda tentang konsep AI terkait:

- Model Serving - Mendeploy model ke produksi

- Edge AI - Menjalankan inference pada perangkat

- Model Compression - Mengurangi ukuran dan kompleksitas model

- Latency - Memahami faktor waktu respons

Sumber Eksternal

- NVIDIA AI Inference Platform - Akselerasi hardware dan teknik optimasi

- Hugging Face Optimization Guide - Tutorial praktis tentang optimasi model

- Google Cloud AI Performance - Pola arsitektur inference yang dapat diskalakan

FAQ Section

Pertanyaan yang Sering Diajukan tentang Inference Optimization

Apa itu Inference Optimization?

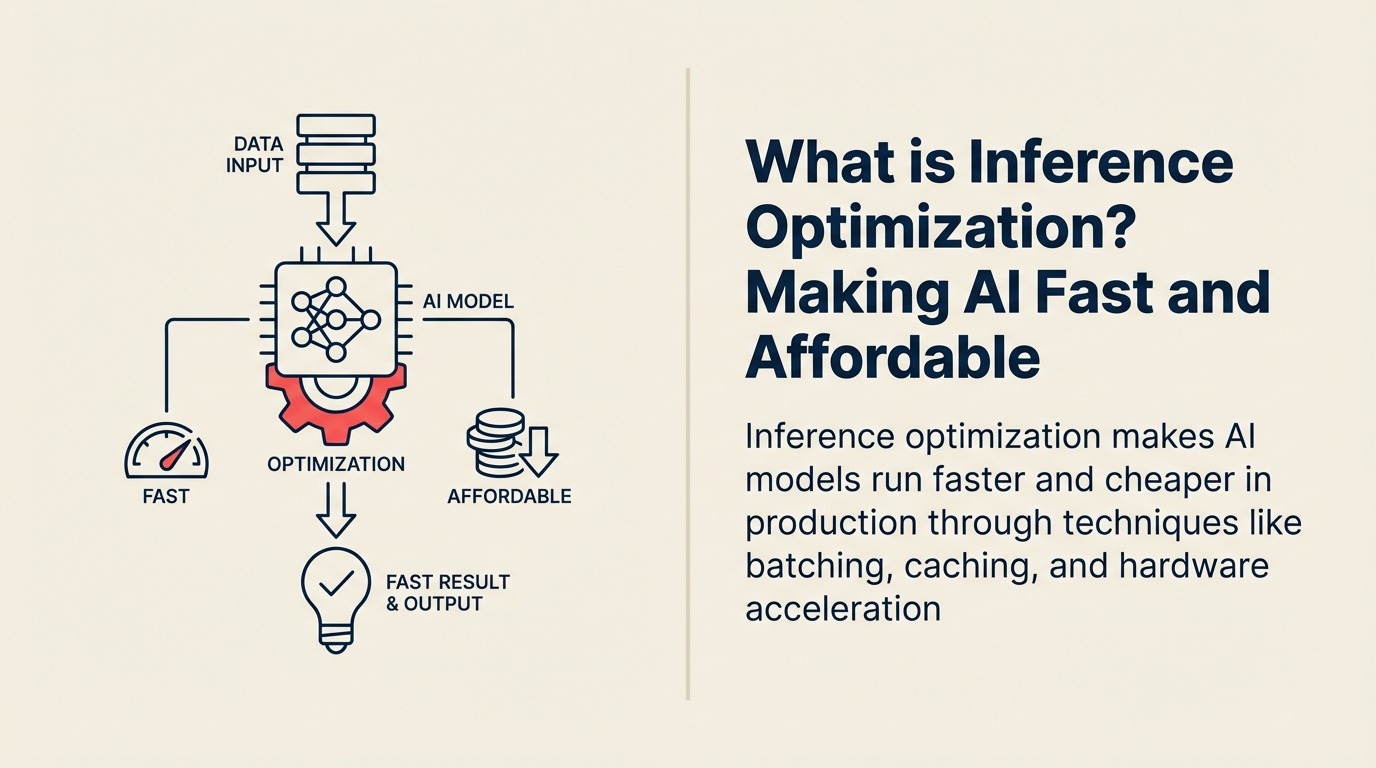

Inference optimization adalah proses membuat prediksi model AI lebih cepat, lebih murah, dan lebih scalable dalam produksi melalui teknik seperti batching, caching, akselerasi hardware, dan kompresi model.

Apa perbedaan antara training optimization dan inference optimization?

Training optimization fokus pada pembelajaran model lebih cepat dan murah (terjadi sekali). Inference optimization fokus pada membuat prediksi lebih cepat dan murah (terjadi jutaan kali dalam produksi). Inference optimization memiliki dampak bisnis lebih besar karena mempengaruhi setiap permintaan pengguna.

Berapa banyak inference optimization dapat mengurangi biaya?

Inference optimization yang diimplementasikan dengan benar biasanya mengurangi biaya sebesar 60-90% sambil meningkatkan kecepatan sebesar 5-50x. Penghematan pasti tergantung pada baseline saat ini, teknik optimasi yang diterapkan, dan karakteristik beban kerja.

Apa saja teknik inference optimization utama?

Teknik inti adalah batching (memproses beberapa permintaan bersama), caching (menyimpan hasil umum), akselerasi hardware (menggunakan prosesor khusus), kompresi model (mengurangi ukuran model), dan request routing (mencocokkan query dengan model yang sesuai).

Kapan saya harus mengoptimalkan inference?

Mulai optimasi saat pindah dari prototype ke produksi, saat biaya skala linear dengan penggunaan, saat latensi mempengaruhi pengalaman pengguna, atau saat melayani ribuan permintaan harian. Optimasi awal mencegah penskalaan infrastruktur yang mahal.

Bagian dari AI Terms Collection. Terakhir diperbarui: 2026-02-09

Founder & CEO