O Que é Otimização de Inferência? Escalando IA Sem Quebrar o Banco

Treinar um modelo de IA uma vez custa milhões. Mas executar esse modelo bilhões de vezes custa ainda mais. Um único large language model atendendo 100.000 usuários diários pode acumular $50.000 mensais em custos de computação. Otimização de inferência se tornou a disciplina crítica que separa pilotos de IA de produtos de IA lucrativos, permitindo que empresas entreguem os mesmos resultados de qualidade com custo 10x menor e velocidade 5x maior.

Treinar um modelo de IA uma vez custa milhões. Mas executar esse modelo bilhões de vezes custa ainda mais. Um único large language model atendendo 100.000 usuários diários pode acumular $50.000 mensais em custos de computação. Otimização de inferência se tornou a disciplina crítica que separa pilotos de IA de produtos de IA lucrativos, permitindo que empresas entreguem os mesmos resultados de qualidade com custo 10x menor e velocidade 5x maior.

De Protótipo à Realidade de Produção

Otimização de inferência emergiu como um campo distinto por volta de 2019 quando empresas perceberam que precisão do modelo não era suficiente—sistemas de IA de produção precisavam ser rápidos, baratos e escaláveis. O que começou como ajuste de desempenho ad-hoc evoluiu para uma disciplina sistemática de engenharia.

A NVIDIA define otimização de inferência como "o processo de maximizar throughput, minimizar latência e reduzir custos computacionais para previsões de modelos de IA em ambientes de produção através de otimização de software, aceleração de hardware e melhorias arquiteturais."

O campo explodiu quando empresas descobriram que técnicas simples de otimização poderiam reduzir custos em 70-90% enquanto melhoram tempos de resposta de segundos para milissegundos—tornando aplicações de IA instantâneas e economicamente viáveis.

Fazendo Sentido para Líderes Empresariais

Para líderes empresariais, otimização de inferência significa entregar as mesmas capacidades de IA a uma fração do custo e latência—possibilitando aplicações em tempo real, reduzindo gastos com infraestrutura em 60-80% e escalando serviços de IA lucrativamente conforme o uso cresce exponencialmente.

Pense nisso como a diferença entre um restaurante cozinhando cada pedido individualmente versus preparando ingredientes com antecedência, agrupando pedidos similares e usando equipamentos especializados. Ambos entregam a mesma qualidade de comida, mas um é 10x mais eficiente.

Em termos práticos, otimização de inferência permite que você sirva milhares de usuários simultaneamente sem esmagar sua conta de nuvem, responda a consultas de clientes em milissegundos em vez de segundos, e escale de piloto para produção sem aumentos lineares de custo.

Elementos-Chave da Otimização de Inferência

Otimização de inferência engloba estas técnicas essenciais:

• Batching: Processar múltiplas solicitações juntas em vez de uma de cada vez, melhorando drasticamente throughput ao aproveitar capacidades de processamento paralelo de GPU

• Caching: Armazenar consultas e respostas comuns para evitar computação redundante, reduzindo latência de segundos para milissegundos para perguntas frequentes

• Aceleração de Hardware: Usar processadores especializados (GPUs, TPUs, ASICs personalizados) otimizados para inferência de IA, entregando acelerações de 10-100x sobre CPUs de propósito geral

• Compressão de Modelo: Reduzir tamanho do modelo através de quantização e poda mantendo precisão, possibilitando carregamento e execução mais rápidos

• Roteamento de Solicitações: Direcionar diferentes tipos de consulta para modelos apropriados (consultas simples para modelos pequenos, complexas para modelos grandes), otimizando trade-offs custo-precisão

O Processo de Otimização de Inferência

Implementar otimização de inferência segue estes passos:

Medir Baseline: Perfilar desempenho atual de inferência, identificando gargalos no pré-processamento, execução do modelo e pós-processamento para entender onde esforços de otimização terão impacto máximo

Aplicar Otimizações: Implementar batching para throughput, caching para solicitações comuns, compressão de modelo para tamanho e aceleração de hardware para velocidade—frequentemente combinando múltiplas técnicas

Benchmarkar e Iterar: Testar sistema otimizado sob carga de produção, medindo latência, throughput e custo para garantir que melhorias atendam requisitos de negócio sem sacrificar qualidade

Este processo transforma uma prova de conceito que lida com 10 solicitações por segundo em um sistema de produção servindo 10.000 solicitações por segundo a custo total menor.

Tipos de Otimização de Inferência

Otimização de inferência emprega várias abordagens:

Tipo 1: Otimização de Software Melhor para: Ganhos rápidos sem mudanças de infraestrutura Característica principal: Melhorias em nível de código e ajuste de algoritmo Exemplo: Implementar batching de solicitações para processar 50 consultas simultaneamente em vez de sequencialmente

Tipo 2: Aceleração de Hardware Melhor para: Melhorias máximas de desempenho Característica principal: Processadores especializados de inferência Exemplo: Migrar de CPU para GPUs NVIDIA T4 para aceleração de 20x

Tipo 3: Otimização de Modelo Melhor para: Reduzir requisitos computacionais Característica principal: Modelos menores e mais rápidos com mesmas capacidades Exemplo: Usar knowledge distillation para criar um modelo 4x menor com 95% da precisão original

Tipo 4: Otimização de Arquitetura Melhor para: Sistemas de produção em larga escala Característica principal: Processamento distribuído e balanceamento de carga Exemplo: Implantação multi-região com roteamento inteligente de solicitações

Otimização de Inferência em Ação

Veja como empresas realmente usam otimização de inferência:

Exemplo E-commerce: Shopify otimizou seu motor de recomendação de produtos implementando batching, caching e quantização de modelo. Tempos de resposta caíram de 800ms para 50ms, e custos de infraestrutura diminuíram 73% enquanto serviam 10x mais solicitações.

Exemplo Atendimento ao Cliente: Sistema de roteamento de tickets de IA do Zendesk usa otimização de inferência para processar 100.000 tickets diários. Ao cachear padrões de perguntas comuns e usar modelos especializados menores para 80% das consultas, eles reduziram custos em $200.000 anualmente.

Exemplo Serviços Financeiros: Stripe otimizou inferência de detecção de fraude para analisar transações em menos de 100ms (de 2 segundos), combinando aceleração de GPU, batching de solicitações e compressão de modelo. Isso permitiu prevenção de fraude em tempo real sem impacto na experiência do cliente.

Seu Caminho para Maestria em Otimização de Inferência

Pronto para tornar seus sistemas de IA rápidos e acessíveis?

- Entenda compressão de modelo com Quantização

- Explore arquiteturas eficientes via Knowledge Distillation

- Aprenda sobre implantação em produção com MLOps

Saiba Mais

Expanda sua compreensão de conceitos relacionados de IA:

- Model Serving - Implantando modelos em produção

- Edge AI - Executando inferência em dispositivos

- Model Compression - Reduzindo tamanho e complexidade do modelo

- Latency - Entendendo fatores de tempo de resposta

Recursos Externos

- NVIDIA AI Inference Platform - Aceleração de hardware e técnicas de otimização

- Hugging Face Optimization Guide - Tutoriais práticos sobre otimização de modelo

- Google Cloud AI Performance - Padrões de arquitetura de inferência escalável

Seção de Perguntas Frequentes

Perguntas Frequentes sobre Otimização de Inferência

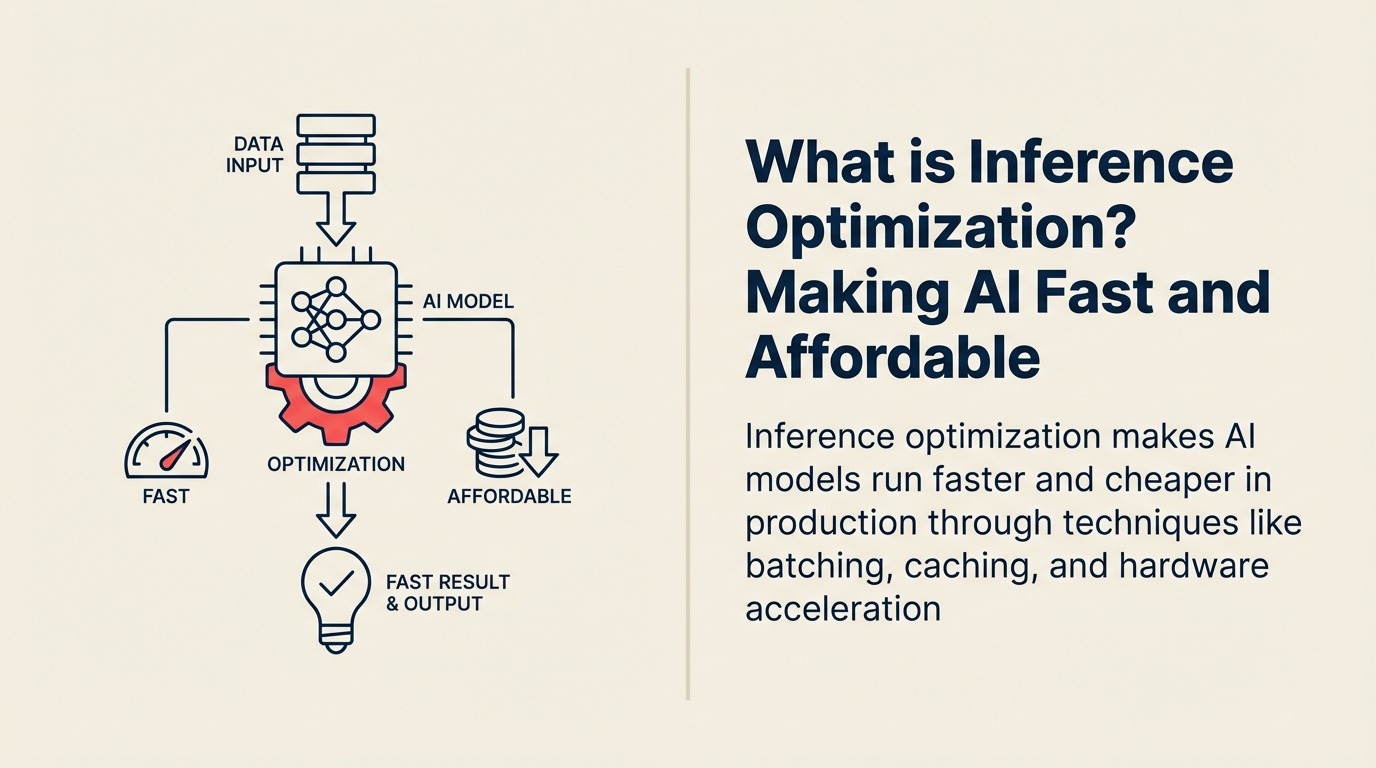

O que é Otimização de Inferência?

Otimização de inferência é o processo de tornar previsões de modelos de IA mais rápidas, baratas e escaláveis em produção através de técnicas como batching, caching, aceleração de hardware e compressão de modelo.

Qual é a diferença entre otimização de treinamento e otimização de inferência?

Otimização de treinamento foca em aprender modelos mais rápido e barato (acontece uma vez). Otimização de inferência foca em fazer previsões mais rápidas e baratas (acontece milhões de vezes em produção). Otimização de inferência tem maior impacto nos negócios porque afeta cada solicitação de usuário.

Quanto a otimização de inferência pode reduzir custos?

Otimização de inferência adequadamente implementada tipicamente reduz custos em 60-90% enquanto melhora velocidade em 5-50x. As economias exatas dependem da baseline atual, técnicas de otimização aplicadas e características da carga de trabalho.

Quais são as principais técnicas de otimização de inferência?

As técnicas principais são batching (processar múltiplas solicitações juntas), caching (armazenar resultados comuns), aceleração de hardware (usar processadores especializados), compressão de modelo (reduzir tamanho do modelo) e roteamento de solicitações (combinar consultas com modelos apropriados).

Quando devo otimizar inferência?

Comece a otimizar ao migrar de protótipo para produção, quando custos escalam linearmente com uso, quando latência afeta experiência do usuário, ou quando serve milhares de solicitações diárias. Otimização precoce previne escalamento de infraestrutura caro.

Parte da Coleção de Termos de IA. Última atualização: 2026-02-09

Founder & CEO

On this page

- De Protótipo à Realidade de Produção

- Fazendo Sentido para Líderes Empresariais

- Elementos-Chave da Otimização de Inferência

- O Processo de Otimização de Inferência

- Tipos de Otimização de Inferência

- Otimização de Inferência em Ação

- Seu Caminho para Maestria em Otimização de Inferência

- Saiba Mais

- Recursos Externos

- Seção de Perguntas Frequentes