Apakah Inference Optimization? Menskalakan AI Tanpa Memecahkan Bank

Melatih model AI sekali berharga berjuta-juta. Tetapi menjalankan model itu berbilion kali berharga lebih banyak lagi. Satu large language model yang melayani 100,000 pengguna harian boleh mengumpul $50,000 sebulan dalam kos pengkomputeran. Inference optimization telah menjadi disiplin kritikal yang memisahkan perintis AI daripada produk AI yang menguntungkan, membolehkan syarikat melayani hasil kualiti yang sama pada kos 10x lebih rendah dan kelajuan 5x lebih pantas.

Melatih model AI sekali berharga berjuta-juta. Tetapi menjalankan model itu berbilion kali berharga lebih banyak lagi. Satu large language model yang melayani 100,000 pengguna harian boleh mengumpul $50,000 sebulan dalam kos pengkomputeran. Inference optimization telah menjadi disiplin kritikal yang memisahkan perintis AI daripada produk AI yang menguntungkan, membolehkan syarikat melayani hasil kualiti yang sama pada kos 10x lebih rendah dan kelajuan 5x lebih pantas.

Daripada Prototaip kepada Realiti Pengeluaran

Inference optimization muncul sebagai bidang yang berbeza sekitar 2019 apabila syarikat menyedari bahawa ketepatan model tidak mencukupi—sistem AI pengeluaran perlu pantas, murah, dan boleh diskalakan. Apa yang bermula sebagai penalaan prestasi ad-hoc berkembang menjadi disiplin kejuruteraan yang sistematik.

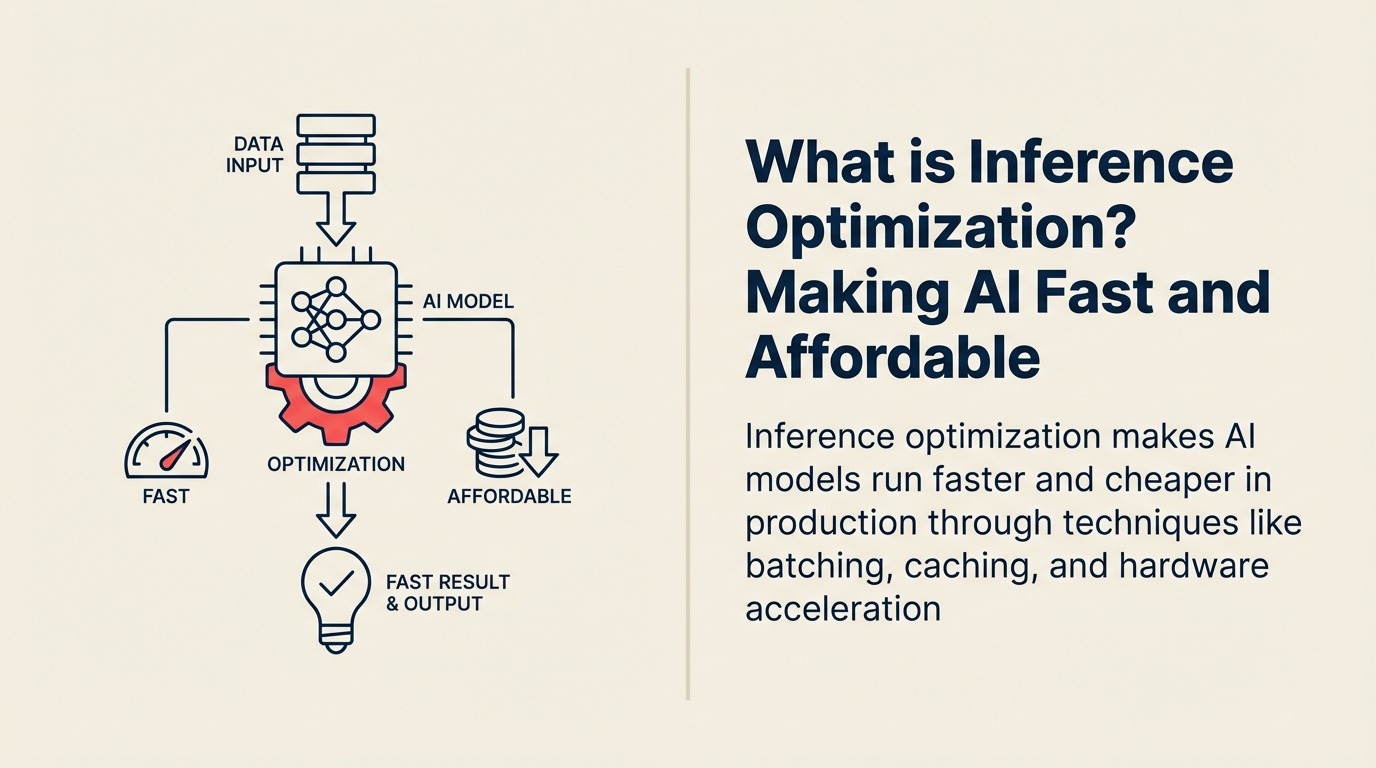

NVIDIA mentakrifkan inference optimization sebagai "proses memaksimumkan throughput, meminimumkan latency, dan mengurangkan kos pengkomputeran untuk ramalan model AI dalam persekitaran pengeluaran melalui pengoptimuman perisian, pecutan perkakasan, dan penambahbaikan seni bina."

Bidang ini meletup apabila perniagaan menemui bahawa teknik pengoptimuman mudah boleh mengurangkan kos sebanyak 70-90% sambil meningkatkan masa respons daripada saat kepada milisaat—menjadikan aplikasi AI terasa serta-merta dan berdaya maju dari segi ekonomi.

Memahami untuk Pemimpin Perniagaan

Bagi pemimpin perniagaan, inference optimization bermaksud menyampaikan keupayaan AI yang sama pada sebahagian kecil daripada kos dan latency—membolehkan aplikasi masa nyata, mengurangkan perbelanjaan infrastruktur sebanyak 60-80%, dan menskalakan perkhidmatan AI dengan menguntungkan apabila penggunaan meningkat secara eksponen.

Fikirkannya sebagai perbezaan antara restoran yang memasak setiap pesanan secara individu berbanding menyediakan bahan terlebih dahulu, membatch pesanan yang serupa, dan menggunakan peralatan khusus. Kedua-duanya menyampaikan kualiti makanan yang sama, tetapi satu adalah 10x lebih cekap.

Secara praktikalnya, inference optimization membolehkan anda melayani beribu-ribu pengguna serentak tanpa menghancurkan bil cloud anda, bertindak balas kepada pertanyaan pelanggan dalam milisaat berbanding saat, dan skala daripada perintis kepada pengeluaran tanpa peningkatan kos linear.

Elemen Utama Inference Optimization

Inference optimization merangkumi teknik penting ini:

• Batching: Memproses pelbagai permintaan bersama berbanding satu pada satu masa, meningkatkan throughput secara dramatik dengan memanfaatkan keupayaan pemprosesan selari GPU

• Caching: Menyimpan pertanyaan dan respons biasa untuk mengelakkan pengkomputeran berlebihan, mengurangkan latency daripada saat kepada milisaat untuk soalan yang kerap ditanya

• Hardware Acceleration: Menggunakan pemproses khusus (GPU, TPU, ASIC tersuai) yang dioptimumkan untuk inference AI, menyampaikan pecutan 10-100x berbanding CPU tujuan umum

• Model Compression: Mengurangkan saiz model melalui quantization dan pemangkasan sambil mengekalkan ketepatan, membolehkan pemuatan dan pelaksanaan lebih pantas

• Request Routing: Mengarahkan jenis pertanyaan yang berbeza kepada model yang sesuai (pertanyaan mudah kepada model kecil, yang kompleks kepada model besar), mengoptimumkan pertukaran kos-ketepatan

Proses Inference Optimization

Melaksanakan inference optimization mengikuti langkah-langkah ini:

Measure Baseline: Profil prestasi inference semasa, mengenal pasti kesesakan dalam pra-pemprosesan, pelaksanaan model, dan pasca-pemprosesan untuk memahami di mana usaha pengoptimuman akan mempunyai impak maksimum

Apply Optimizations: Laksanakan batching untuk throughput, caching untuk permintaan biasa, pemampatan model untuk saiz, dan pecutan perkakasan untuk kelajuan—selalunya menggabungkan pelbagai teknik

Benchmark and Iterate: Uji sistem yang dioptimumkan di bawah beban pengeluaran, mengukur latency, throughput, dan kos untuk memastikan penambahbaikan memenuhi keperluan perniagaan tanpa mengorbankan kualiti

Proses ini mengubah proof-of-concept yang mengendalikan 10 permintaan sesaat menjadi sistem pengeluaran yang melayani 10,000 permintaan sesaat pada kos jumlah yang lebih rendah.

Jenis Inference Optimization

Inference optimization menggunakan beberapa pendekatan:

Jenis 1: Software Optimization Terbaik untuk: Kemenangan cepat tanpa perubahan infrastruktur Ciri utama: Penambahbaikan tahap kod dan penalaan algoritma Contoh: Melaksanakan batching permintaan untuk memproses 50 pertanyaan serentak berbanding berurutan

Jenis 2: Hardware Acceleration Terbaik untuk: Penambahbaikan prestasi maksimum Ciri utama: Pemproses inference khusus Contoh: Beralih daripada CPU kepada GPU NVIDIA T4 untuk pecutan 20x

Jenis 3: Model Optimization Terbaik untuk: Mengurangkan keperluan pengkomputeran Ciri utama: Model yang lebih kecil dan lebih pantas dengan keupayaan yang sama Contoh: Menggunakan knowledge distillation untuk mencipta model 4x lebih kecil dengan ketepatan asal 95%

Jenis 4: Architecture Optimization Terbaik untuk: Sistem pengeluaran berskala besar Ciri utama: Pemprosesan teragih dan pengimbangan beban Contoh: Penggunaan berbilang wilayah dengan routing permintaan pintar

Inference Optimization dalam Tindakan

Begini cara perniagaan sebenarnya menggunakan inference optimization:

Contoh E-dagang: Shopify mengoptimumkan enjin cadangan produk mereka dengan melaksanakan batching, caching, dan kuantisasi model. Masa respons turun daripada 800ms kepada 50ms, dan kos infrastruktur menurun sebanyak 73% sambil melayani 10x lebih banyak permintaan.

Contoh Perkhidmatan Pelanggan: Sistem routing tiket AI Zendesk menggunakan inference optimization untuk memproses 100,000 tiket harian. Dengan caching corak soalan biasa dan menggunakan model khusus yang lebih kecil untuk 80% pertanyaan, mereka mengurangkan kos sebanyak $200,000 setiap tahun.

Contoh Perkhidmatan Kewangan: Stripe mengoptimumkan inference pengesanan penipuan untuk menganalisis transaksi dalam bawah 100ms (daripada 2 saat), menggabungkan pecutan GPU, batching permintaan, dan pemampatan model. Ini membolehkan pencegahan penipuan masa nyata tanpa impak pengalaman pelanggan.

Laluan Anda ke Penguasaan Inference Optimization

Bersedia untuk menjadikan sistem AI anda pantas dan berpatutan?

- Fahami pemampatan model dengan Quantization

- Terokai seni bina cekap melalui Knowledge Distillation

- Ketahui tentang penggunaan pengeluaran dengan MLOps

Ketahui Lebih Lanjut

Luaskan pemahaman anda tentang konsep AI berkaitan:

- Model Serving - Menggunakan model ke pengeluaran

- Edge AI - Menjalankan inference pada peranti

- Model Compression - Mengurangkan saiz dan kerumitan model

- Latency - Memahami faktor masa respons

Sumber Luar

- NVIDIA AI Inference Platform - Pecutan perkakasan dan teknik pengoptimuman

- Hugging Face Optimization Guide - Tutorial praktikal tentang pengoptimuman model

- Google Cloud AI Performance - Corak seni bina inference boleh diskalakan

Soalan Lazim

Sebahagian daripada Koleksi Istilah AI. Dikemas kini terakhir: 2026-02-09

Founder & CEO