¿Qué son los Modelos de Difusión? De Ruido a Arte en Segundos

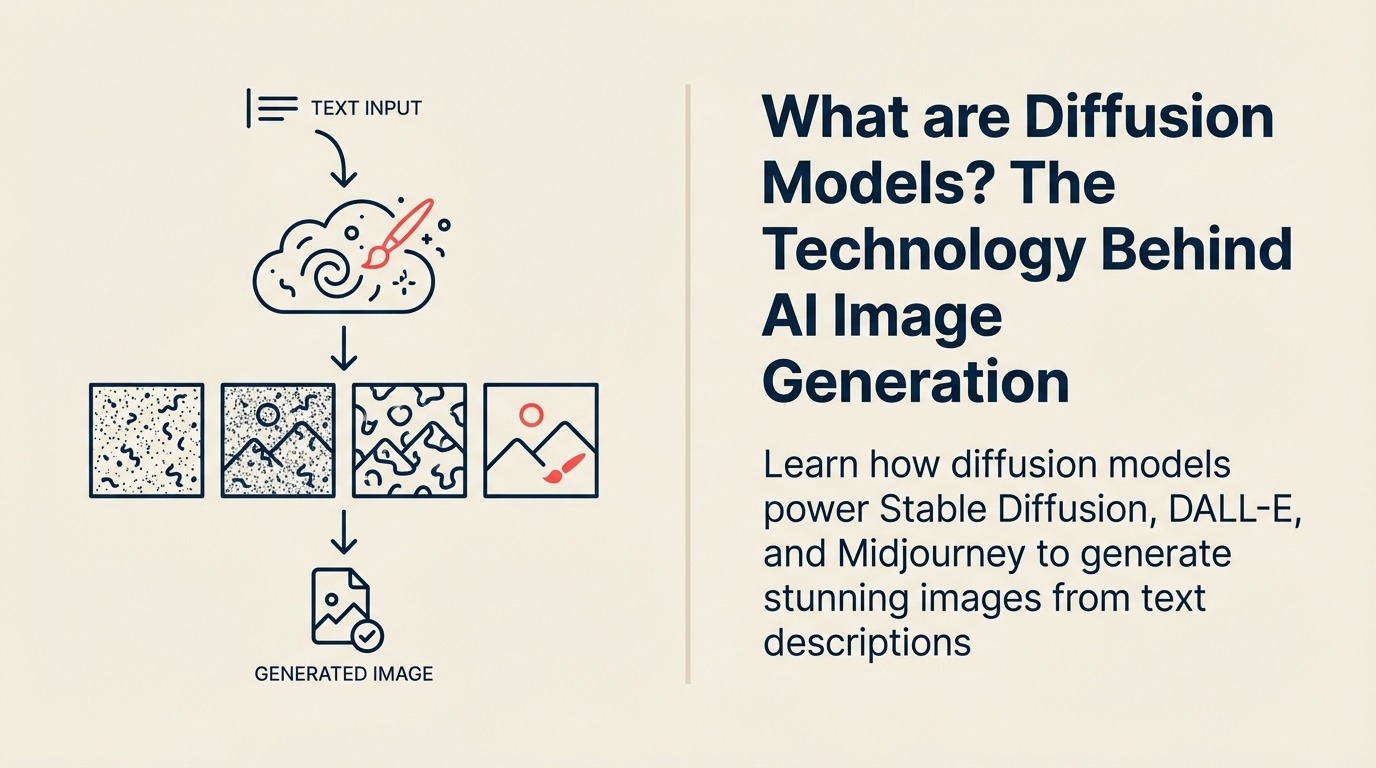

Escribe "una oficina profesional con luz natural" y observa cómo el AI crea esa imagen exacta en segundos. Detrás de esta magia están los modelos de difusión - la tecnología revolucionaria que transformó la creatividad del AI. No dibujan píxeles uno por uno. Comienzan con ruido puro y gradualmente lo refinan en imágenes perfectas.

Escribe "una oficina profesional con luz natural" y observa cómo el AI crea esa imagen exacta en segundos. Detrás de esta magia están los modelos de difusión - la tecnología revolucionaria que transformó la creatividad del AI. No dibujan píxeles uno por uno. Comienzan con ruido puro y gradualmente lo refinan en imágenes perfectas.

La Innovación que Lanzó una Revolución Creativa

Los modelos de difusión surgieron de investigación de Stanford en 2015, pero explotaron en conciencia mainstream en 2022 cuando Stable Diffusion, DALL-E 2 y Midjourney demostraron generación fotorrealista de imágenes. La técnica revirtió enfoques tradicionales a la creación de imágenes.

Según el equipo de investigación de OpenAI, los modelos de difusión son "modelos generativos que aprenden a crear imágenes revirtiendo un proceso gradual de adición de ruido, comenzando desde ruido aleatorio y refinándolo iterativamente en salidas coherentes guiadas por patrones aprendidos de datos de entrenamiento."

El avance llegó cuando los investigadores se dieron cuenta de que enseñar al AI a limpiar ruido de imágenes - reconocer y remover ruido aleatorio - podría ser invertido en una poderosa herramienta de creación de imágenes. Este mismo principio ahora potencia video, audio y generación de modelos 3D.

Modelos de Difusión para Líderes Empresariales

Para líderes empresariales, los modelos de difusión son sistemas de AI que generan imágenes, videos y diseños de calidad profesional desde descripciones de texto, habilitando producción creativa instantánea sin fotógrafos, diseñadores o suscripciones a bancos de imágenes.

Piensa en la diferencia entre describir lo que quieres a un diseñador y que aparezca instantáneamente. Los modelos de difusión son como tener un equipo creativo infinito que trabaja a la velocidad del pensamiento, produciendo exactamente lo que especificas.

En términos prácticos, los modelos de difusión pueden crear maquetas de productos, visuales de marketing, renderizados arquitectónicos y variaciones de diseño en segundos, transformando flujos de trabajo creativos de semanas a minutos. Esto representa un cambio fundamental en cómo los negocios abordan el generative AI para contenido visual.

Componentes Centrales de los Modelos de Difusión

Los modelos de difusión consisten en estos elementos esenciales:

• Proceso Directo (Adición de Ruido): Agrega gradualmente ruido aleatorio a imágenes de entrenamiento a través de muchos pasos hasta que se convierten en estática pura, enseñando al modelo cómo se ve la destrucción de estructura

• Proceso Inverso (Eliminación de Ruido): Aprende a revertir el proceso de ruido, removiendo aleatoriedad paso a paso para recuperar la imagen original desde ruido puro

• Arquitectura U-Net: La red neuronal que predice y remueve ruido en cada paso, entendiendo tanto detalles finos como composición amplia simultáneamente

• Codificador de Texto: Convierte tu descripción de texto en una representación matemática que guía el proceso de eliminación de ruido hacia tu imagen deseada

• Espacio Latente: Representación comprimida donde el proceso de difusión realmente sucede, haciendo la generación más rápida y controlable que trabajar con píxeles crudos

Cómo Operan los Modelos de Difusión

Los modelos de difusión siguen este proceso creativo:

Punto de Partida: Comienza con un lienzo de ruido aleatorio puro, como estática visual sin estructura o significado alguno

Eliminación de Ruido Guiada: A través de 20-50 pasos, el modelo gradualmente remueve ruido mientras es guiado por tu descripción de texto, revelando lentamente estructura y detalle

Refinamiento: Cada paso remueve más aleatoriedad y agrega más detalles coherentes alineados con tu prompt, con pasos tempranos definiendo composición y pasos posteriores agregando detalles finos

Este proceso sucede en segundos, con el modelo esencialmente "imaginando" qué imagen podría existir bajo el ruido que coincide con tu descripción.

Tipos de Modelos de Difusión

Los modelos de difusión sirven diferentes necesidades creativas:

Tipo 1: Modelos Texto-a-Imagen Mejor para: Crear imágenes desde descripciones Característica clave: Generar imágenes originales desde prompts de texto Ejemplo: DALL-E 3, Midjourney, Stable Diffusion

Tipo 2: Modelos Imagen-a-Imagen Mejor para: Transformar imágenes existentes Característica clave: Modificar imágenes preservando estructura Ejemplo: ControlNet para generación guiada

Tipo 3: Modelos de Difusión de Video Mejor para: Creación de imágenes en movimiento Característica clave: Generar secuencias de video coherentes Ejemplo: Runway Gen-2, Stable Video Diffusion

Tipo 4: Modelos de Difusión Especializados Mejor para: Aplicaciones específicas de dominio Característica clave: Optimizados para tipos particulares de contenido Ejemplo: Imagenología médica, objetos 3D, generación de audio

Modelos de Difusión Entregando Resultados

Así es como los negocios aprovechan los modelos de difusión:

Ejemplo de E-commerce: Los comerciantes de Shopify usan modelos de difusión para generar imágenes de productos en múltiples escenarios y ángulos, reduciendo costos de fotografía en 80% mientras aumentan tasas de conversión 25% a través de visualización de productos más diversa.

Ejemplo de Marketing: Heinz usó DALL-E para generar cientos de variaciones de anuncios, descubriendo a través de iteración rápida que ciertos estilos visuales impulsaron 40% mayor engagement, probando en días lo que previamente tomaba meses.

Ejemplo de Arquitectura: Foster + Partners genera docenas de variaciones de diseño de edificios usando modelos de difusión, acelerando el diseño conceptual en 10x mientras exploran opciones que el renderizado manual hacía impráctico.

Implementando Modelos de Difusión

¿Listo para generar tu contenido visual?

- Entiende los fundamentos de Generative AI

- Aprende sobre los básicos de Neural Networks

- Explora Prompt Engineering para mejores resultados

- Considera Fine-Tuning para estilos específicos de marca

Sección de Preguntas Frecuentes

Preguntas Frecuentes sobre Modelos de Difusión

¿Qué son los Modelos de Difusión?

Los modelos de difusión son sistemas de AI generativos que crean imágenes revirtiendo un proceso gradual de adición de ruido, comenzando desde ruido aleatorio y refinándolo iterativamente en salidas coherentes guiadas por descripciones de texto u otras entradas.

¿Cuál es la diferencia entre modelos de difusión y GANs?

Los GANs (Redes Generativas Adversarias) usan redes neuronales competidoras. Los modelos de difusión usan eliminación de ruido iterativa, que produce salidas más diversas, mejor estabilidad de entrenamiento y control más fácil a través de prompts de texto.

¿Cuáles son los principales tipos de modelos de difusión?

Modelos Texto-a-Imagen (crear desde descripciones), Modelos Imagen-a-Imagen (transformar imágenes existentes), Modelos de Difusión de Video (generar movimiento), y Modelos de Difusión Especializados (aplicaciones específicas de dominio).

¿Cuáles son ejemplos de aplicaciones de modelos de difusión?

DALL-E 3 y Midjourney (generación de imágenes), Stable Diffusion (creación de imágenes open-source), Runway Gen-2 (generación de video), y modelos especializados para imagenología médica, modelos 3D y síntesis de audio.

Recursos Relacionados

Explora estos conceptos relacionados para profundizar tu comprensión de los modelos de difusión:

- Generative AI - La categoría más amplia de AI que crea contenido

- Neural Networks - La arquitectura fundamental detrás de los modelos de difusión

- Prompt Engineering - Técnicas para generación efectiva de imágenes

- Computer Vision - Entendiendo cómo el AI procesa información visual

Recursos Externos

- Stability AI Research - Desarrollo de modelos de difusión open-source

- OpenAI DALL-E Documentation - Detalles técnicos sobre generación de imágenes

- Hugging Face Diffusers - Guía práctica para modelos de difusión

Parte de la Colección de Términos de AI. Última actualización: 2026-02-09

Founder & CEO

On this page

- La Innovación que Lanzó una Revolución Creativa

- Modelos de Difusión para Líderes Empresariales

- Componentes Centrales de los Modelos de Difusión

- Cómo Operan los Modelos de Difusión

- Tipos de Modelos de Difusión

- Modelos de Difusión Entregando Resultados

- Implementando Modelos de Difusión

- Sección de Preguntas Frecuentes

- Recursos Relacionados

- Recursos Externos