Was sind Diffusion Models? Von Rauschen zu Kunst in Sekunden

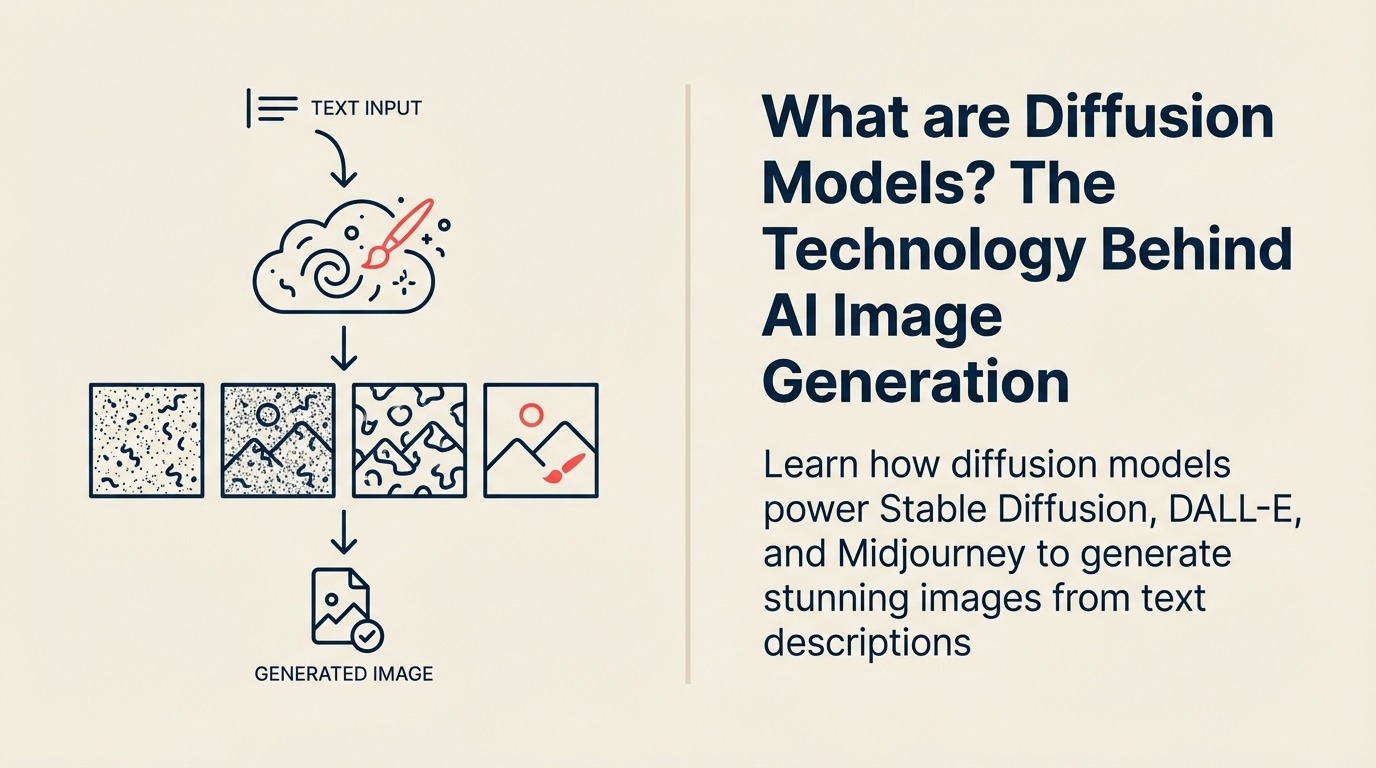

Tippen Sie "ein professionelles Büro mit natürlichem Licht" und sehen Sie zu, wie KI genau dieses Bild in Sekunden erstellt. Hinter dieser Magie stehen Diffusion Models - die bahnbrechende Technologie, die KI-Kreativität revolutionierte. Sie zeichnen nicht Pixel für Pixel. Sie beginnen mit reinem Rauschen und verfeinern es schrittweise zu perfekten Bildern.

Tippen Sie "ein professionelles Büro mit natürlichem Licht" und sehen Sie zu, wie KI genau dieses Bild in Sekunden erstellt. Hinter dieser Magie stehen Diffusion Models - die bahnbrechende Technologie, die KI-Kreativität revolutionierte. Sie zeichnen nicht Pixel für Pixel. Sie beginnen mit reinem Rauschen und verfeinern es schrittweise zu perfekten Bildern.

Die Innovation, die eine kreative Revolution startete

Diffusion Models entstanden aus Stanford-Forschung im Jahr 2015, explodierten aber 2022 ins Mainstream-Bewusstsein, als Stable Diffusion, DALL-E 2 und Midjourney fotorealistische Bildgenerierung demonstrierten. Die Technik kehrte traditionelle Ansätze zur Bilderstellung um.

Laut OpenAIs Forschungsteam sind Diffusion Models "generative Modelle, die lernen, Bilder zu erstellen, indem sie einen graduellen Rauschprozess umkehren, von zufälligem Rauschen ausgehend und es iterativ zu kohärenten Outputs verfeinern, geleitet von gelernten Mustern aus Trainingsdaten."

Der Durchbruch kam, als Forscher erkannten, dass das Trainieren von KI zum Entrauschen von Bildern - zum Erkennen und Entfernen von zufälligem Rauschen - in ein mächtiges Bilderstellungswerkzeug umgekehrt werden konnte. Dieses Prinzip treibt jetzt Video-, Audio- und 3D-Modellgenerierung an.

Diffusion Models für Führungskräfte

Für Führungskräfte sind Diffusion Models KI-Systeme, die professionelle Bilder, Videos und Designs aus Textbeschreibungen generieren und sofortige kreative Produktion ohne Fotografen, Designer oder Stock-Foto-Abonnements ermöglichen.

Denken Sie an den Unterschied zwischen der Beschreibung dessen, was Sie einem Designer wollen, und dass es sofort erscheint. Diffusion Models sind wie ein unendliches Kreativteam, das mit Gedankengeschwindigkeit arbeitet und genau das produziert, was Sie spezifizieren.

In praktischer Hinsicht können Diffusion Models Produktmodelle, Marketingvisualisierungen, Architekturrenderings und Designvarianten in Sekunden erstellen und kreative Workflows von Wochen auf Minuten transformieren. Dies stellt einen fundamentalen Wandel dar, wie Unternehmen Generative AI für visuelle Inhalte nutzen.

Kernkomponenten von Diffusion Models

Diffusion Models bestehen aus diesen wesentlichen Elementen:

• Forward Process (Noising): Fügt schrittweise zufälliges Rauschen zu Trainingsbildern über viele Schritte hinzu, bis sie zu reiner Statik werden, und lehrt das Modell, wie die Zerstörung von Struktur aussieht

• Reverse Process (Denoising): Lernt, den Rauschprozess umzukehren, Schritt für Schritt Zufälligkeit zu entfernen, um das Originalbild aus reinem Rauschen wiederherzustellen

• U-Net-Architektur: Das neuronale Netzwerk, das Rauschen bei jedem Schritt vorhersagt und entfernt, sowohl feine Details als auch breite Komposition gleichzeitig versteht

• Text Encoder: Konvertiert Ihre Textbeschreibung in eine mathematische Repräsentation, die den Entrauschungsprozess zu Ihrem beabsichtigten Bild leitet

• Latent Space: Komprimierte Repräsentation, wo der Diffusionsprozess tatsächlich stattfindet, was die Generierung schneller und kontrollierbarer macht als die Arbeit mit Rohpixeln

Wie Diffusion Models arbeiten

Diffusion Models folgen diesem kreativen Prozess:

Startpunkt: Beginnen Sie mit einer Leinwand aus reinem zufälligem Rauschen, wie visuelle Statik ohne Struktur oder Bedeutung

Gesteuertes Entrauschen: Über 20-50 Schritte entfernt das Modell schrittweise Rauschen, während es von Ihrer Textbeschreibung geleitet wird und langsam Struktur und Details offenbart

Verfeinerung: Jeder Schritt entfernt mehr Zufälligkeit und fügt kohärentere Details hinzu, die mit Ihrem Prompt übereinstimmen - frühe Schritte definieren die Komposition, spätere Schritte fügen feine Details hinzu

Dieser Prozess geschieht in Sekunden, wobei das Modell im Wesentlichen "sich vorstellt", welches Bild unter dem Rauschen existieren könnte, das Ihrer Beschreibung entspricht.

Typen von Diffusion Models

Diffusion Models bedienen unterschiedliche kreative Bedürfnisse:

Typ 1: Text-to-Image Models Am besten für: Bilder aus Beschreibungen erstellen Hauptmerkmal: Originale Bilder aus Text-Prompts generieren Beispiel: DALL-E 3, Midjourney, Stable Diffusion

Typ 2: Image-to-Image Models Am besten für: Bestehende Bilder transformieren Hauptmerkmal: Bilder modifizieren, während die Struktur erhalten bleibt Beispiel: ControlNet für gesteuerte Generierung

Typ 3: Video Diffusion Models Am besten für: Bewegtbilderstellung Hauptmerkmal: Kohärente Videosequenzen generieren Beispiel: Runway Gen-2, Stable Video Diffusion

Typ 4: Specialized Diffusion Models Am besten für: Domänenspezifische Anwendungen Hauptmerkmal: Optimiert für bestimmte Inhaltstypen Beispiel: Medizinische Bildgebung, 3D-Objekte, Audiogenerierung

Diffusion Models liefern Ergebnisse

So nutzen Unternehmen Diffusion Models:

E-Commerce-Beispiel: Shopify-Händler verwenden Diffusion Models, um Produktbilder in mehreren Settings und Winkeln zu generieren, reduzieren Fotografiekosten um 80%, während sie Konversionsraten um 25% durch vielfältigere Produktvisualisierung steigern.

Marketing-Beispiel: Heinz nutzte DALL-E, um Hunderte von Anzeigenvarianten zu generieren, und entdeckte durch schnelle Iteration, dass bestimmte visuelle Stile 40% höheres Engagement brachten - Tests in Tagen statt Monaten.

Architektur-Beispiel: Foster + Partners generiert Dutzende Gebäudedesignvarianten mit Diffusion Models, beschleunigt konzeptionelles Design um das 10-fache und erkundet Optionen, die manuelles Rendering unpraktisch machte.

Diffusion Models implementieren

Bereit, Ihre visuellen Inhalte zu generieren?

- Verstehen Sie Generative AI-Grundlagen

- Lernen Sie über Neural Networks-Basics

- Erkunden Sie Prompt Engineering für bessere Ergebnisse

- Erwägen Sie Fine-Tuning für markenspezifische Stile

FAQ

Häufig gestellte Fragen zu Diffusion Models

Was sind Diffusion Models?

Diffusion Models sind generative KI-Systeme, die Bilder erstellen, indem sie einen graduellen Rauschprozess umkehren, von zufälligem Rauschen ausgehend und es iterativ zu kohärenten Outputs verfeinern, geleitet von Textbeschreibungen oder anderen Inputs.

Was ist der Unterschied zwischen Diffusion Models und GANs?

GANs (Generative Adversarial Networks) verwenden konkurrierende neuronale Netzwerke. Diffusion Models verwenden iteratives Entrauschen, was vielfältigere Outputs, bessere Trainingsstabilität und einfachere Kontrolle durch Text-Prompts produziert.

Was sind die Haupttypen von Diffusion Models?

Text-to-Image Models (Erstellen aus Beschreibungen), Image-to-Image Models (Transformieren bestehender Bilder), Video Diffusion Models (Bewegung generieren) und Specialized Diffusion Models (domänenspezifische Anwendungen).

Was sind Beispiele für Diffusion-Model-Anwendungen?

DALL-E 3 und Midjourney (Bildgenerierung), Stable Diffusion (Open-Source-Bilderstellung), Runway Gen-2 (Videogenerierung) und spezialisierte Modelle für medizinische Bildgebung, 3D-Modelle und Audiosynthese.

Verwandte Ressourcen

Erkunden Sie diese verwandten Konzepte, um Ihr Verständnis von Diffusion Models zu vertiefen:

- Generative AI - Die breitere Kategorie von KI, die Inhalte erstellt

- Neural Networks - Die grundlegende Architektur hinter Diffusion Models

- Prompt Engineering - Techniken für effektive Bildgenerierung

- Computer Vision - Verstehen, wie KI visuelle Informationen verarbeitet

Externe Ressourcen

- Stability AI Research - Open-Source-Diffusion-Model-Entwicklung

- OpenAI DALL-E Documentation - Technische Details zur Bildgenerierung

- Hugging Face Diffusers - Praktischer Leitfaden zu Diffusion Models

Teil der AI Terms Collection. Zuletzt aktualisiert: 2026-02-09

Founder & CEO