Apakah Diffusion Models? Daripada Noise kepada Seni dalam Beberapa Saat

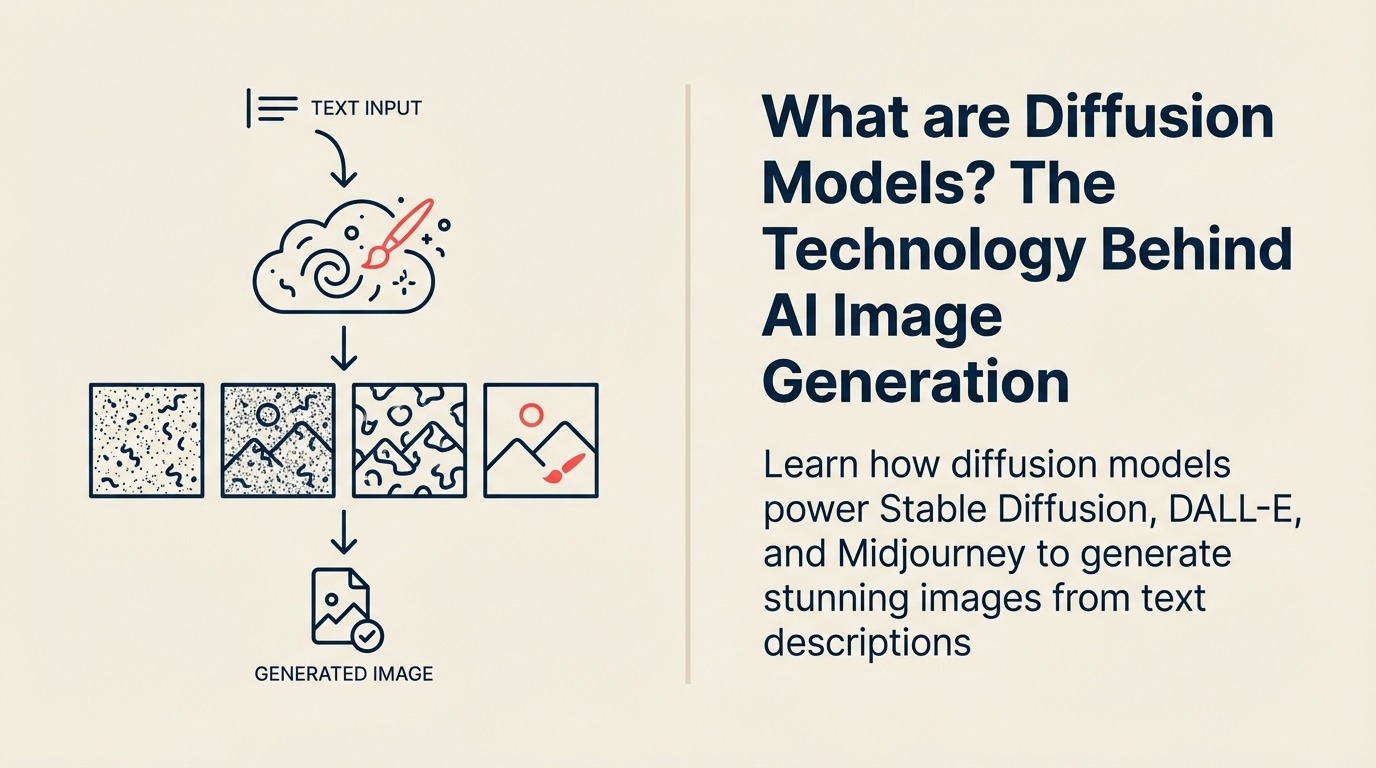

Taip "pejabat profesional dengan pencahayaan semula jadi" dan tonton bagaimana AI mencipta imej tepat itu dalam beberapa saat. Di sebalik keajaiban ini adalah diffusion model—teknologi kejayaan yang merevolusikan kreativiti AI. Ia tidak melukis piksel satu persatu. Ia bermula dengan noise tulen dan secara beransur-ansur memperhalusinya menjadi imej sempurna.

Taip "pejabat profesional dengan pencahayaan semula jadi" dan tonton bagaimana AI mencipta imej tepat itu dalam beberapa saat. Di sebalik keajaiban ini adalah diffusion model—teknologi kejayaan yang merevolusikan kreativiti AI. Ia tidak melukis piksel satu persatu. Ia bermula dengan noise tulen dan secara beransur-ansur memperhalusinya menjadi imej sempurna.

Inovasi yang Melancarkan Revolusi Kreatif

Diffusion model muncul daripada penyelidikan Stanford pada 2015, tetapi meletup ke dalam kesedaran arus perdana pada 2022 apabila Stable Diffusion, DALL-E 2, dan Midjourney menunjukkan penjanaan imej fotorealistik. Teknik ini membalikkan pendekatan tradisional kepada penciptaan imej.

Menurut pasukan penyelidikan OpenAI, diffusion model adalah "model generatif yang belajar mencipta imej dengan membalikkan proses penambahan noise secara beransur-ansur, bermula daripada noise rawak dan secara berulang memperhalusinya menjadi output koheren yang dipandu oleh corak yang dipelajari daripada data latihan."

Kejayaan datang apabila penyelidik menyedari bahawa mengajar AI untuk membuang noise imej—untuk mengenali dan membuang noise rawak—boleh diterbalikkan menjadi alat penciptaan imej yang berkuasa. Prinsip yang sama kini menggerakkan video, audio, dan penjanaan model 3D.

Diffusion Models untuk Pemimpin Perniagaan

Untuk pemimpin perniagaan, diffusion model adalah sistem AI yang menghasilkan imej, video, dan reka bentuk berkualiti profesional daripada huraian teks, membolehkan pengeluaran kreatif segera tanpa jurugambar, pereka bentuk, atau langganan foto stok.

Fikirkan perbezaan antara menerangkan apa yang anda mahu kepada pereka bentuk dan melihatnya muncul serta-merta. Diffusion model adalah seperti mempunyai pasukan kreatif tanpa had yang bekerja pada kelajuan pemikiran, menghasilkan tepat apa yang anda nyatakan.

Dari segi praktikal, diffusion model boleh mencipta mockup produk, visual pemasaran, rendering seni bina, dan variasi reka bentuk dalam beberapa saat, mengubah aliran kerja kreatif daripada minggu kepada minit. Ini mewakili anjakan asas dalam bagaimana perniagaan mendekati generative AI untuk kandungan visual.

Komponen Teras Diffusion Models

Diffusion model terdiri daripada elemen penting ini:

• Forward Process (Noising): Secara beransur-ansur menambah noise rawak kepada imej latihan melalui banyak langkah sehingga ia menjadi statik tulen, mengajar model bagaimana rupa kemusnahan struktur

• Reverse Process (Denoising): Belajar membalikkan proses penambahan noise, membuang rawak langkah demi langkah untuk memulihkan imej asal daripada noise tulen

• U-Net Architecture: Neural network yang meramalkan dan membuang noise pada setiap langkah, memahami kedua-dua butiran halus dan komposisi luas serentak

• Text Encoder: Menukar huraian teks anda menjadi perwakilan matematik yang membimbing proses denoising ke arah imej yang anda inginkan

• Latent Space: Perwakilan dimampatkan di mana proses diffusion sebenarnya berlaku, menjadikan penjanaan lebih pantas dan lebih terkawal daripada bekerja dengan piksel mentah

Bagaimana Diffusion Models Beroperasi

Diffusion model mengikut proses kreatif ini:

Starting Point: Bermula dengan kanvas noise rawak tulen, seperti statik visual tanpa struktur atau makna sama sekali

Guided Denoising: Melalui 20-50 langkah, model secara beransur-ansur membuang noise sambil dipandu oleh huraian teks anda, perlahan-lahan mendedahkan struktur dan perincian

Refinement: Setiap langkah membuang lebih banyak rawak dan menambah lebih banyak butiran koheren yang sejajar dengan prompt anda, dengan langkah awal mentakrifkan komposisi dan langkah kemudian menambah butiran halus

Proses ini berlaku dalam beberapa saat, dengan model pada dasarnya "membayangkan" imej apa yang boleh wujud di bawah noise yang sepadan dengan huraian anda.

Jenis Diffusion Models

Diffusion model memenuhi keperluan kreatif yang berbeza:

Type 1: Text-to-Image Models Terbaik untuk: Mencipta imej daripada huraian Ciri utama: Hasilkan imej asal daripada prompt teks Contoh: DALL-E 3, Midjourney, Stable Diffusion

Type 2: Image-to-Image Models Terbaik untuk: Mengubah imej sedia ada Ciri utama: Ubah suai imej sambil mengekalkan struktur Contoh: ControlNet untuk penjanaan terpandu

Type 3: Video Diffusion Models Terbaik untuk: Penciptaan imej bergerak Ciri utama: Hasilkan urutan video yang koheren Contoh: Runway Gen-2, Stable Video Diffusion

Type 4: Specialized Diffusion Models Terbaik untuk: Aplikasi khusus domain Ciri utama: Dioptimumkan untuk jenis kandungan tertentu Contoh: Pengimejan perubatan, objek 3D, penjanaan audio

Diffusion Models Memberikan Hasil

Begini bagaimana perniagaan memanfaatkan diffusion model:

Contoh E-dagang: Peniaga Shopify menggunakan diffusion model untuk menghasilkan imej produk dalam berbilang tetapan dan sudut, mengurangkan kos fotografi sebanyak 80% sambil meningkatkan kadar penukaran 25% melalui visualisasi produk yang lebih pelbagai.

Contoh Pemasaran: Heinz menggunakan DALL-E untuk menghasilkan ratusan variasi iklan, menemui melalui iterasi pantas bahawa gaya visual tertentu mendorong penglibatan 40% lebih tinggi, menguji dalam hari apa yang sebelumnya mengambil masa berbulan-bulan.

Contoh Seni Bina: Foster + Partners menghasilkan berpuluh-puluh variasi reka bentuk bangunan menggunakan diffusion model, mempercepatkan reka bentuk konseptual sebanyak 10x sambil meneroka pilihan yang rendering manual jadikan tidak praktikal.

Melaksanakan Diffusion Models

Bersedia untuk menghasilkan kandungan visual anda?

- Fahami asas Generative AI

- Ketahui tentang asas Neural Networks

- Terokai Prompt Engineering untuk hasil lebih baik

- Pertimbangkan Fine-Tuning untuk gaya khusus jenama

Soalan Lazim

Soalan Lazim tentang Diffusion Models

Apakah Diffusion Models?

Diffusion model adalah sistem AI generatif yang mencipta imej dengan membalikkan proses penambahan noise secara beransur-ansur, bermula daripada noise rawak dan secara berulang memperhalusinya menjadi output koheren yang dipandu oleh huraian teks atau input lain.

Apakah perbezaan antara diffusion model dan GAN?

GAN (Generative Adversarial Networks) menggunakan neural network yang bersaing. Diffusion model menggunakan denoising berulang, yang menghasilkan output lebih pelbagai, kestabilan latihan lebih baik, dan kawalan lebih mudah melalui prompt teks.

Apakah jenis utama diffusion model?

Text-to-Image Models (mencipta daripada huraian), Image-to-Image Models (mengubah imej sedia ada), Video Diffusion Models (menghasilkan pergerakan), dan Specialized Diffusion Models (aplikasi khusus domain).

Apakah contoh aplikasi diffusion model?

DALL-E 3 dan Midjourney (penjanaan imej), Stable Diffusion (penciptaan imej sumber terbuka), Runway Gen-2 (penjanaan video), dan model khusus untuk pengimejan perubatan, model 3D, dan sintesis audio.

Sumber Berkaitan

Terokai konsep berkaitan ini untuk memperdalam pemahaman anda tentang diffusion model:

- Generative AI - Kategori AI yang lebih luas yang mencipta kandungan

- Neural Networks - Seni bina asas di sebalik diffusion model

- Prompt Engineering - Teknik untuk penjanaan imej yang berkesan

- Computer Vision - Memahami bagaimana AI memproses maklumat visual

Sumber Luaran

- Stability AI Research - Pembangunan diffusion model sumber terbuka

- OpenAI DALL-E Documentation - Butiran teknikal tentang penjanaan imej

- Hugging Face Diffusers - Panduan praktikal untuk diffusion model

Sebahagian daripada Koleksi AI Terms. Kemaskini terakhir: 2026-02-09

Founder & CEO