¿Qué son los Embeddings? Enseñando al AI el Significado Detrás de las Palabras

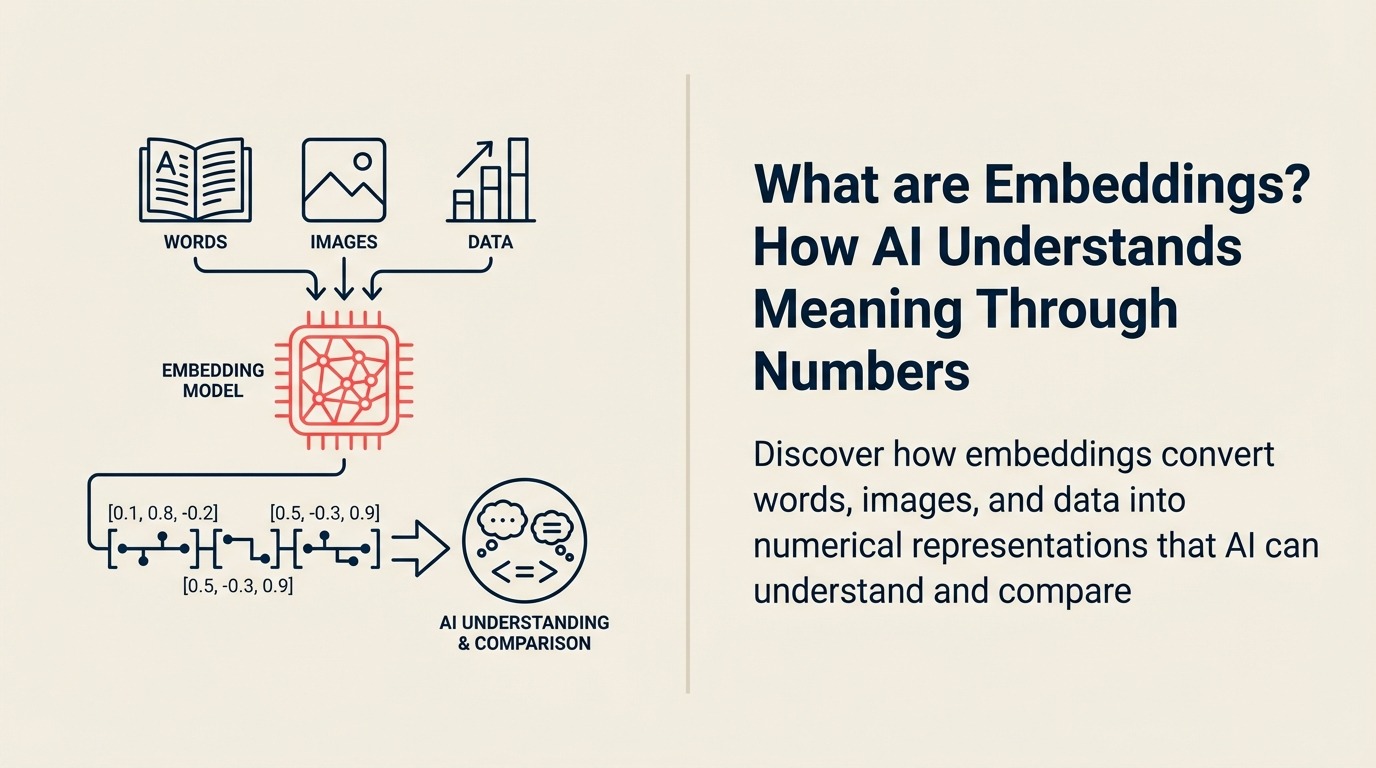

¿Cómo sabe el AI que "car" y "automobile" significan lo mismo? ¿O que "king" se relaciona con "queen" como "man" con "woman"? La respuesta son los embeddings - la magia matemática que transforma palabras en números que capturan significado, habilitando al AI a entender el lenguaje como los humanos.

¿Cómo sabe el AI que "car" y "automobile" significan lo mismo? ¿O que "king" se relaciona con "queen" como "man" con "woman"? La respuesta son los embeddings - la magia matemática que transforma palabras en números que capturan significado, habilitando al AI a entender el lenguaje como los humanos.

Definición Técnica

Los embeddings son representaciones numéricas densas de objetos discretos (como palabras, oraciones o imágenes) en un espacio vectorial continuo, donde elementos similares se mapean a puntos cercanos. Estos vectores de alta dimensión (típicamente 256-1536 números) codifican significado semántico y relaciones.

Según Google Research, "Los embeddings son uno de los conceptos más importantes en el Procesamiento de Lenguaje Natural moderno, permitiéndonos usar herramientas matemáticas para operar sobre palabras y entender relaciones entre ellas." El avance llegó cuando los investigadores descubrieron que las relaciones semánticas podían ser capturadas a través de aritmética vectorial.

El famoso ejemplo: vector("King") - vector("Man") + vector("Woman") ≈ vector("Queen") demuestra cómo los embeddings capturan relaciones conceptuales matemáticamente.

Traducción de Negocio

Para líderes empresariales, los embeddings son como coordenadas GPS para el significado - le dicen al AI qué tan cerca o lejos están los conceptos, habilitando búsqueda semántica, recomendaciones personalizadas y categorización inteligente a escala.

Imagina organizar tu catálogo de productos no alfabéticamente sino por similitud real. Los embeddings hacen esto automáticamente, entendiendo que "laptop" está más cerca de "notebook computer" que de "notebook paper" sin programación explícita.

En términos prácticos, los embeddings potencian el AI que encuentra tickets de soporte al cliente similares, recomienda productos relacionados, detecta contenido duplicado y entiende que una búsqueda de "abogados económicos" también debería mostrar "lawyers baratos."

Cómo Funcionan los Embeddings

El proceso de embedding:

• Procesamiento de Entrada: Texto, imágenes u otros datos convertidos a formato estándar (como tokens para texto)

• Codificación de Red Neuronal: Modelos de deep learning transforman entradas en vectores densos, aprendiendo patrones de datasets masivos

• Representación Vectorial: Cada entrada se convierte en una lista de números (ej., [0.2, -0.5, 0.8...]) representando su posición en "espacio de significado"

• Cálculo de Similitud: La distancia matemática entre vectores indica similitud semántica - vectores más cercanos significan conceptos más similares

• Aplicaciones Posteriores: Estos vectores alimentan búsqueda, clasificación, clustering y otras tareas de AI

Tipos de Embeddings

Diferentes embeddings para diferentes datos:

Tipo 1: Embeddings de Palabras Ejemplos: Word2Vec, GloVe Caso de uso: Entender palabras individuales Aplicación: Corrección ortográfica, autocompletado

Tipo 2: Embeddings de Oraciones/Documentos Ejemplos: BERT, Sentence-BERT Caso de uso: Capturar contexto completo Aplicación: Búsqueda de documentos, resumen

Tipo 3: Embeddings de Imágenes Ejemplos: ResNet, CLIP Caso de uso: Comprensión de computer vision Aplicación: Búsqueda de imágenes, coincidencia de productos

Tipo 4: Embeddings Multimodales Ejemplos: CLIP, ALIGN Caso de uso: Comprensión entre medios Aplicación: Búsqueda de texto a imagen

Aplicaciones de Negocio

Embeddings potenciando soluciones reales:

Ejemplo de E-commerce: Los embeddings de productos de Amazon entienden que los clientes buscando "zapatillas para correr" también podrían querer "calcetines deportivos" y "rastreadores de fitness," impulsando el 35% de las compras a través de recomendaciones basadas en embeddings.

Ejemplo de Servicio al Cliente: Zendesk usa embeddings para enrutar automáticamente tickets al departamento correcto, entendiendo que "no puedo iniciar sesión" y "contraseña no funciona" son problemas similares, reduciendo tiempo de respuesta en 40%.

Ejemplo de Gestión de Contenido: Los embeddings de Netflix entienden preferencias de visualización más allá de géneros, reconociendo que los fans de "Stranger Things" podrían disfrutar "Dark" basándose en similitudes temáticas, aumentando engagement en 25%.

El Poder de la Búsqueda Semántica

Los embeddings revolucionan la búsqueda:

Búsqueda Tradicional:

- Coincide palabras clave exactas

- Pierde sinónimos y contexto

- Devuelve resultados irrelevantes con palabras coincidentes

Búsqueda Basada en Embeddings:

- Entiende significado e intención

- Encuentra contenido conceptualmente similar

- Funciona a través de idiomas naturalmente

Ejemplo: Buscar "hotel económico París" también encuentra "alojamiento asequible en capital francesa" sin coincidencia de palabras clave.

Bases de Datos de Embeddings

Almacenando y buscando embeddings a escala:

• Vector Databases: Sistemas especializados (Pinecone, Weaviate, Qdrant) optimizados para búsqueda de similitud a través de millones de embeddings

• Métodos de Indexación: Técnicas como HNSW e IVF habilitan búsqueda casi instantánea a través de miles de millones de vectores

• Búsqueda Híbrida: Combinando embeddings con búsqueda tradicional para lo mejor de ambos mundos

• Actualizaciones en Tiempo Real: Los sistemas modernos actualizan embeddings a medida que llega nuevo contenido

Consideraciones de Implementación

Factores clave para el éxito:

Factores de Calidad:

- Elección del modelo de embedding

- Fine-tuning específico de dominio

- Trade-offs de dimensión de embedding

- Necesidades de frecuencia de actualización

Requisitos Técnicos:

- Almacenamiento para vectores de alta dimensión

- Recursos computacionales para codificación

- Infraestructura de búsqueda de similitud rápida

- Integración con sistemas existentes

Métricas de Negocio:

- Mejora de relevancia de búsqueda

- Tasas de clic de recomendaciones

- Precisión de enrutamiento de tickets de soporte

- Puntajes de satisfacción del cliente

Desafíos Comunes de Embeddings

Obstáculos y soluciones:

• Desajuste de Dominio: Los embeddings genéricos fallan en contenido especializado → Solución: Fine-tune en datos de tu industria

• Barreras de Idioma: Los embeddings entrenados en inglés luchan con otros idiomas → Solución: Modelos multilingües

• Desviación de Conceptos: Los significados cambian con el tiempo → Solución: Reentrenamiento regular y monitoreo

• Problemas de Escala: Miles de millones de embeddings ralentizan búsqueda → Solución: Algoritmos de vecino más cercano aproximado

Aprovechando Embeddings

Tu camino hacia AI semántico:

- Comienza con Tokenization para entender entradas

- Explora Vector Databases para almacenamiento

- Aprende sobre aplicaciones de Semantic Search

- Entiende cómo Retrieval-Augmented Generation (RAG) usa embeddings

- Ve cómo Large Language Models aprovechan embeddings

Recursos Externos

- OpenAI Embeddings Guide - Creando y usando embeddings de texto

- Hugging Face Sentence Transformers - Modelos de embedding pre-entrenados

- Pinecone Vector Database - Infraestructura de búsqueda de embeddings en producción

Sección de Preguntas Frecuentes

Preguntas Frecuentes sobre Embeddings

¿Qué son los Embeddings?

Los embeddings son representaciones numéricas (vectores) de datos como palabras o imágenes que capturan significado semántico, donde elementos similares tienen vectores similares en espacio matemático.

¿Cuál es la diferencia entre embeddings y codificación tradicional?

La codificación tradicional usa números arbitrarios sin relaciones de significado. Los embeddings posicionan conceptos similares cerca uno del otro en espacio vectorial, habilitando operaciones semánticas como búsqueda de similitud.

¿Cuáles son los principales tipos de embeddings?

Embeddings de Palabras (palabras individuales), Embeddings de Oraciones/Documentos (contexto completo), Embeddings de Imágenes (comprensión visual), y Embeddings Multimodales (entre medios como texto-imagen).

¿Qué es una base de datos vectorial?

Una base de datos vectorial es un sistema especializado optimizado para almacenar y buscar embeddings, habilitando búsquedas de similitud rápidas a través de millones o miles de millones de vectores de alta dimensión.

Parte de la Colección de Términos de AI. Última actualización: 2026-01-11

Founder & CEO

On this page

- Definición Técnica

- Traducción de Negocio

- Cómo Funcionan los Embeddings

- Tipos de Embeddings

- Aplicaciones de Negocio

- El Poder de la Búsqueda Semántica

- Bases de Datos de Embeddings

- Consideraciones de Implementación

- Desafíos Comunes de Embeddings

- Aprovechando Embeddings

- Recursos Externos

- Sección de Preguntas Frecuentes