O que são Embeddings? Ensinando IA o Significado por Trás das Palavras

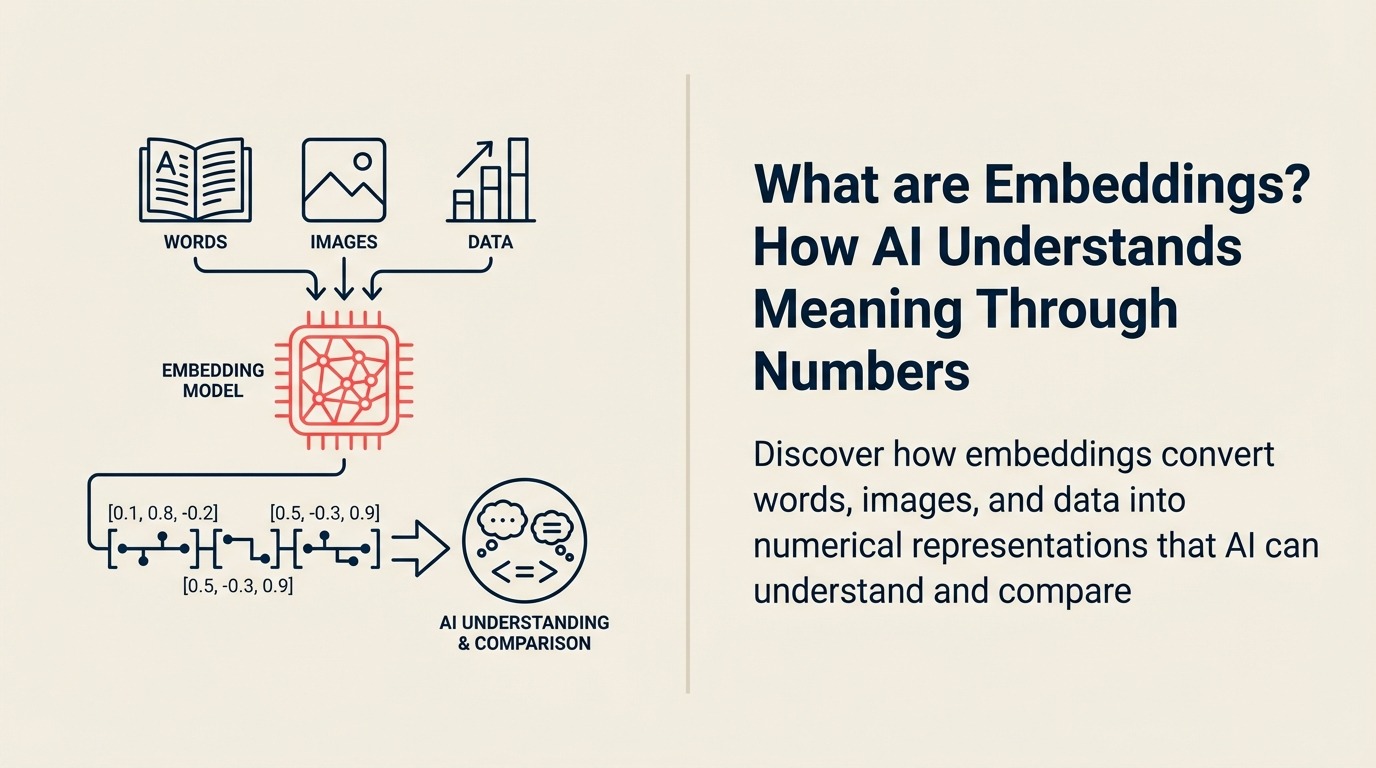

Como a IA sabe que "car" e "automobile" significam a mesma coisa? Ou que "king" se relaciona com "queen" como "man" com "woman"? A resposta são embeddings – a mágica matemática que transforma palavras em números que capturam significado, possibilitando que IA entenda linguagem como humanos fazem.

Como a IA sabe que "car" e "automobile" significam a mesma coisa? Ou que "king" se relaciona com "queen" como "man" com "woman"? A resposta são embeddings – a mágica matemática que transforma palavras em números que capturam significado, possibilitando que IA entenda linguagem como humanos fazem.

Definição Técnica

Embeddings são representações numéricas densas de objetos discretos (como palavras, frases ou imagens) em um espaço vetorial contínuo, onde itens similares são mapeados para pontos próximos. Estes vetores de alta dimensão (tipicamente 256-1536 números) codificam significado semântico e relacionamentos.

De acordo com Google Research, "Embeddings são um dos conceitos mais importantes em Processamento de Linguagem Natural moderno, permitindo-nos usar ferramentas matemáticas para operar em palavras e entender relacionamentos entre elas." O avanço veio quando pesquisadores descobriram que relacionamentos semânticos poderiam ser capturados através de aritmética vetorial.

O exemplo famoso: vetor("King") - vetor("Man") + vetor("Woman") ≈ vetor("Queen") demonstra como embeddings capturam relacionamentos conceituais matematicamente.

Tradução Empresarial

Para líderes empresariais, embeddings são como coordenadas GPS para significado – eles dizem à IA quão próximos ou distantes conceitos estão, possibilitando busca semântica, recomendações personalizadas e categorização inteligente em escala.

Imagine organizar seu catálogo de produtos não alfabeticamente mas por similaridade real. Embeddings fazem isto automaticamente, entendendo que "laptop" está mais próximo de "notebook computer" do que de "notebook paper" sem programação explícita.

Em termos práticos, embeddings impulsionam a IA que encontra tickets de suporte ao cliente similares, recomenda produtos relacionados, detecta conteúdo duplicado e entende que uma busca por "affordable attorneys" também deve mostrar "cheap lawyers".

Como Embeddings Funcionam

O processo de embedding:

• Processamento de Entrada: Texto, imagens ou outros dados convertidos para formato padrão (como tokens para texto)

• Codificação de Rede Neural: Modelos de deep learning transformam entradas em vetores densos, aprendendo padrões de conjuntos de dados massivos

• Representação Vetorial: Cada entrada se torna uma lista de números (ex., [0.2, -0.5, 0.8...]) representando sua posição no "espaço de significado"

• Computação de Similaridade: Distância matemática entre vetores indica similaridade semântica – vetores mais próximos significam conceitos mais similares

• Aplicações Downstream: Estes vetores alimentam busca, classificação, clustering e outras tarefas de IA

Tipos de Embeddings

Diferentes embeddings para diferentes dados:

Tipo 1: Word Embeddings Exemplos: Word2Vec, GloVe Caso de uso: Entender palavras individuais Aplicação: Corretor ortográfico, autocompletar

Tipo 2: Embeddings de Frase/Documento Exemplos: BERT, Sentence-BERT Caso de uso: Capturar contexto completo Aplicação: Busca de documentos, sumarização

Tipo 3: Embeddings de Imagem Exemplos: ResNet, CLIP Caso de uso: Compreensão de computer vision Aplicação: Busca de imagens, correspondência de produtos

Tipo 4: Embeddings Multimodais Exemplos: CLIP, ALIGN Caso de uso: Compreensão cross-media Aplicação: Busca texto-para-imagem

Aplicações Empresariais

Embeddings impulsionando soluções reais:

Exemplo de E-commerce: Embeddings de produtos da Amazon entendem que clientes buscando por "running shoes" também podem querer "athletic socks" e "fitness trackers", gerando 35% das compras através de recomendações baseadas em embeddings.

Exemplo de Atendimento ao Cliente: O Zendesk usa embeddings para rotear automaticamente tickets para o departamento certo, entendendo que "can't log in" e "password not working" são problemas similares, reduzindo tempo de resposta em 40%.

Exemplo de Gestão de Conteúdo: Embeddings da Netflix entendem preferências de visualização além de gêneros, reconhecendo que fãs de "Stranger Things" podem gostar de "Dark" baseado em similaridades temáticas, aumentando engajamento em 25%.

O Poder da Busca Semântica

Embeddings revolucionam busca:

Busca Tradicional:

- Corresponde palavras-chave exatas

- Perde sinônimos e contexto

- Retorna resultados irrelevantes com palavras correspondentes

Busca Baseada em Embeddings:

- Entende significado e intenção

- Encontra conteúdo conceitualmente similar

- Funciona naturalmente através de idiomas

Exemplo: Buscar "budget hotel Paris" também encontra "affordable accommodation in French capital" sem correspondência de palavras-chave.

Bancos de Dados de Embeddings

Armazenando e buscando embeddings em escala:

• Vector Databases: Sistemas especializados (Pinecone, Weaviate, Qdrant) otimizados para busca de similaridade através de milhões de embeddings

• Métodos de Indexação: Técnicas como HNSW e IVF possibilitam busca quase instantânea através de bilhões de vetores

• Busca Híbrida: Combinando embeddings com busca tradicional para o melhor dos dois mundos

• Atualizações em Tempo Real: Sistemas modernos atualizam embeddings conforme novo conteúdo chega

Considerações de Implementação

Fatores-chave para sucesso:

Fatores de Qualidade:

- Escolha do modelo de embedding

- Fine-tuning específico de domínio

- Tradeoffs de dimensão de embedding

- Necessidades de frequência de atualização

Requisitos Técnicos:

- Armazenamento para vetores de alta dimensão

- Recursos computacionais para codificação

- Infraestrutura de busca de similaridade rápida

- Integração com sistemas existentes

Métricas Empresariais:

- Melhoria de relevância de busca

- Taxas de clique de recomendação

- Precisão de roteamento de tickets de suporte

- Pontuações de satisfação do cliente

Desafios Comuns de Embeddings

Armadilhas e soluções:

• Incompatibilidade de Domínio: Embeddings genéricos falham em conteúdo especializado → Solução: Fine-tune em dados da sua indústria

• Barreiras Linguísticas: Embeddings treinados em inglês têm dificuldade com outros idiomas → Solução: Modelos multilíngues

• Concept Drift: Significados mudam ao longo do tempo → Solução: Retreinamento regular e monitoramento

• Problemas de Escala: Bilhões de embeddings deixam busca lenta → Solução: Algoritmos de vizinho mais próximo aproximado

Aproveitando Embeddings

Seu caminho para IA semântica:

- Comece com Tokenization para entender entradas

- Explore Vector Databases para armazenamento

- Aprenda sobre aplicações de Semantic Search

- Entenda como Retrieval-Augmented Generation (RAG) usa embeddings

- Veja como Large Language Models aproveitam embeddings

Recursos Externos

- OpenAI Embeddings Guide - Criando e usando embeddings de texto

- Hugging Face Sentence Transformers - Modelos de embedding pré-treinados

- Pinecone Vector Database - Infraestrutura de busca de embeddings em produção

Perguntas Frequentes

Perguntas Frequentes sobre Embeddings

O que são Embeddings?

Embeddings são representações numéricas (vetores) de dados como palavras ou imagens que capturam significado semântico, onde itens similares têm vetores similares no espaço matemático.

Qual a diferença entre embeddings e codificação tradicional?

Codificação tradicional usa números arbitrários sem relacionamentos de significado. Embeddings posicionam conceitos similares próximos uns dos outros no espaço vetorial, possibilitando operações semânticas como busca de similaridade.

Quais são os principais tipos de embeddings?

Word Embeddings (palavras individuais), Embeddings de Frase/Documento (contexto completo), Embeddings de Imagem (compreensão visual), e Embeddings Multimodais (cross-media como texto-imagem).

O que é um banco de dados vetorial?

Um banco de dados vetorial é um sistema especializado otimizado para armazenar e buscar embeddings, possibilitando buscas de similaridade rápidas através de milhões ou bilhões de vetores de alta dimensão.

Parte da Coleção de Termos de IA. Última atualização: 2026-01-11

Founder & CEO