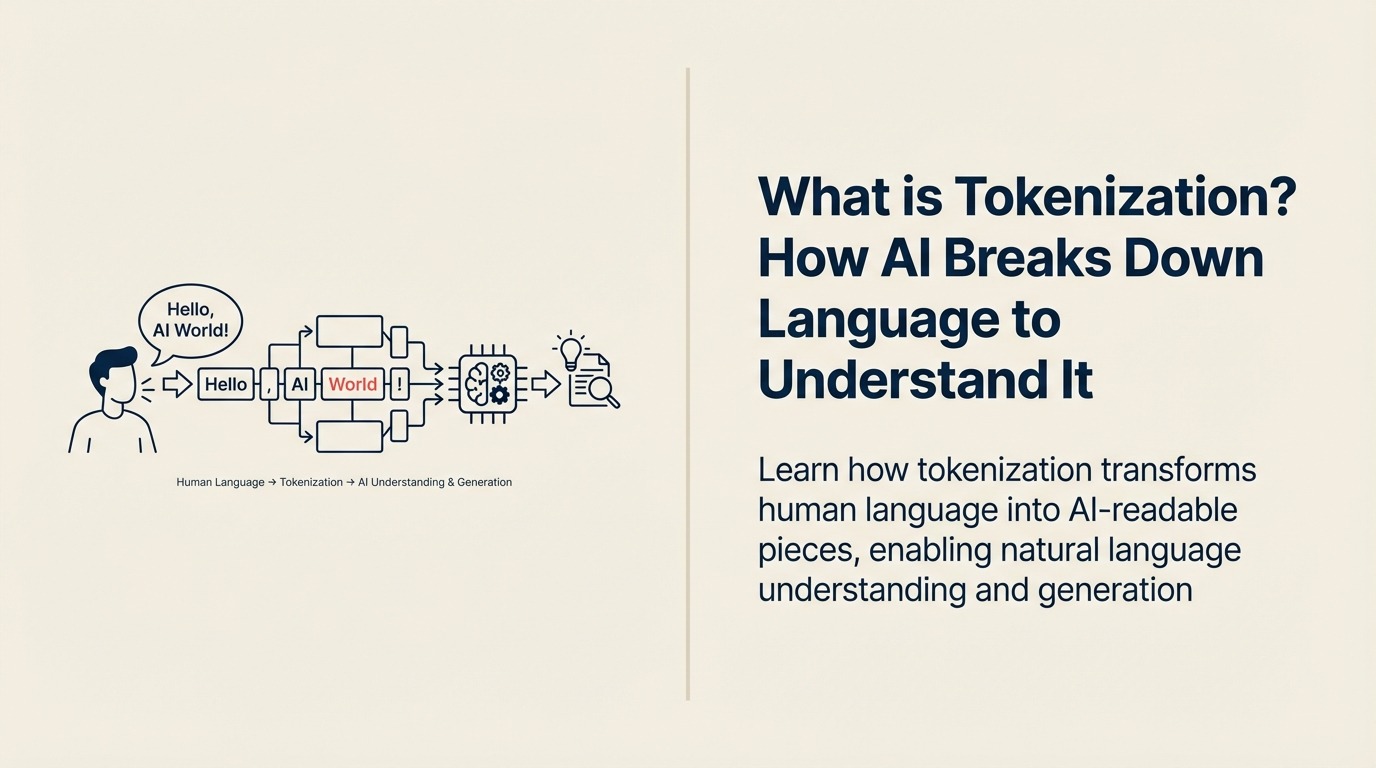

O que é Tokenização? Dividindo a Linguagem em Blocos de Construção de IA

Cada palavra que você digita no ChatGPT é cortada em pedaços. Aquele e-mail que sua IA lê? Fatiado e picado. Este processo – tokenização – é por que a IA pode entender linguagem e por que suas contas de API dependem do comprimento da mensagem. Entendê-lo ajuda você a otimizar desempenho e custos de IA.

Cada palavra que você digita no ChatGPT é cortada em pedaços. Aquele e-mail que sua IA lê? Fatiado e picado. Este processo – tokenização – é por que a IA pode entender linguagem e por que suas contas de API dependem do comprimento da mensagem. Entendê-lo ajuda você a otimizar desempenho e custos de IA.

Fundação Técnica

Tokenização é o processo de dividir texto em unidades menores chamadas tokens, que servem como as unidades fundamentais de significado que modelos de linguagem IA podem processar. Esses tokens podem ser palavras, subpalavras, caracteres ou até pedaços de palavras, dependendo da estratégia de tokenização.

De acordo com pesquisas da OpenAI, "Tokenização é uma etapa de pré-processamento necessária que mapeia de texto bruto para sequências de inteiros que redes neurais podem processar". Tokenizadores modernos usam algoritmos como Byte-Pair Encoding (BPE) ou WordPiece para equilibrar tamanho do vocabulário com cobertura.

A inovação da tokenização de subpalavras resolveu o problema de explosão de vocabulário, permitindo que modelos manipulem qualquer palavra quebrando desconhecidas em pedaços conhecidos.

Impacto nos Negócios

Para líderes empresariais, a tokenização afeta diretamente seus custos de IA, desempenho e capacidades – ela determina quanto você paga por chamadas de API, quão bem a IA entende terminologia especializada e se pode lidar com múltiplos idiomas.

Pense na tokenização como enviar pacotes. Você não pode enviar um armazém inteiro de uma vez – você divide entregas em contêineres padrão. Da mesma forma, a IA não pode processar documentos inteiros de uma vez; ela precisa de texto dividido em pedaços padrão.

Em termos práticos, a tokenização afeta quantas chamadas de API seu chatbot precisa, se a IA entende seu jargão da indústria e quão precisamente processa nomes de clientes ou códigos de produtos. Isso é especialmente crítico para aplicações de IA conversacional onde eficiência impacta diretamente a experiência do usuário.

Como a Tokenização Funciona

O processo de tokenização segue estas etapas:

• Normalização de Texto: Padronização do texto de entrada manipulando maiúsculas/minúsculas, caracteres especiais e formatação consistentemente

• Divisão de Tokens: Quebra de texto em tokens usando padrões aprendidos – "infeliz" pode se tornar ["in", "feliz"] ou permanecer inteiro

• Mapeamento de Vocabulário: Conversão de cada token em um número único (ID do token) que a rede neural processa

• Adição de Tokens Especiais: Adição de marcadores para limites de frases, preenchimento ou funções especiais como [INÍCIO] ou [FIM]

• Criação de Sequência: Organização de tokens em sequências que preservam significado enquanto se ajustam às restrições do modelo

Tipos de Tokenização

Diferentes abordagens para diferentes necessidades:

Tipo 1: Tokenização de Palavras Unidade: Palavras completas Exemplo: "IA melhora eficiência" → ["IA", "melhora", "eficiência"] Melhor para: Análise simples, NLP tradicional

Tipo 2: Tokenização de Subpalavras Unidade: Pedaços de palavras Exemplo: "inacreditável" → ["in", "acredit", "ável"] Melhor para: Modelos de linguagem modernos, manipulação de palavras raras em processamento de linguagem natural

Tipo 3: Tokenização de Caracteres Unidade: Caracteres individuais Exemplo: "IA" → ["I", "A"] Melhor para: Aplicações resistentes a erros de digitação, processamento de código

Tipo 4: Byte-Pair Encoding (BPE) Unidade: Sequências frequentes aprendidas Exemplo: Complexo, aprendido dos dados Melhor para: Modelos GPT, processamento multilíngue em arquitetura transformer

Tokenização na Prática

Impactos reais em aplicações empresariais:

Exemplo de Custo: A OpenAI cobra por token. "Olá mundo" = 2 tokens ($0,0004), mas "Anticonstitucionalissimamente" = 7 tokens ($0,0014). Respostas de atendimento ao cliente com média de 500 tokens custam $0,10 cada, então prompts eficientes em tokens economizam dinheiro.

Exemplo de Desempenho: IA médica tokenizando "acetaminofeno" como ["acet", "amino", "feno"] pode entender termos relacionados como "acetilsalicílico" melhor que tokenização em nível de palavra, melhorando precisão de diagnóstico.

Exemplo Multilíngue: O mBERT do Google usa tokenização wordpiece para lidar com 104 idiomas em um modelo, possibilitando suporte ao cliente global sem modelos separados por idioma.

Limites de Tokens e Janelas de Contexto

Entendendo restrições:

• Janelas de Contexto: Modelos têm limites máximos de tokens (LLMs modernos tipicamente suportam 100 mil-200 mil tokens) afetando quanto informação você pode processar de uma vez

• Orçamento de Tokens: Deve balancear instruções de prompt, contexto e espaço de resposta dentro dos limites

• Estratégias de Fragmentação: Documentos longos precisam de divisão inteligente para manter coerência entre fragmentos

• Otimização de Custos: Menos tokens = custos menores, mas simplificação excessiva prejudica qualidade

Considerações Empresariais

Fatores-chave para implementação:

Terminologia da Indústria:

- Tokenizadores personalizados para vocabulário especializado

- Fine-tuning para reconhecer termos do domínio

- Integração de glossário para consistência

Privacidade de Dados:

- Tokenização pode expor ou ocultar dados sensíveis

- Considere onde a tokenização acontece

- Audite vocabulários de tokens para vazamentos

Otimização de Desempenho:

- Engenharia de prompt eficiente em tokens

- Cache de sequências de tokens comuns

- Estratégias de lote para throughput

Desafios Comuns de Tokenização

Problemas e soluções:

• Novos Termos: IA luta com nomes de marcas ou novos produtos → Solução: Fine-tuning ou engenharia de prompt com definições

• Números e Códigos: SKUs de produtos tokenizam mal → Solução: Pré-processamento ou manipulação especial para dados estruturados

• Mistura de Idiomas: Alternância de códigos confunde tokenizadores → Solução: Modelos multilíngues ou detecção de idioma

• Desperdício de Tokens: Formatação consumindo tokens valiosos → Solução: Pré-processamento e design de prompt eficiente

Otimizando para Tokenização

Melhores práticas para eficiência:

- Entenda o tokenizador do seu modelo usando ferramentas online

- Projete prompts considerando limites de tokens

- Pré-processe dados para reduzir uso de tokens

- Monitore consumo de tokens em produção

- Considere tokenização personalizada para domínios especializados

Saiba Mais

Pronto para aprofundar sua compreensão do processamento de linguagem IA?

- Embeddings - Veja como tokens se tornam vetores significativos

- Modelos de Linguagem Grandes - Entenda como LLMs usam tokens

- IA Generativa - Explore como tokenização possibilita geração de conteúdo

- API AI - Aprenda sobre custos de API e preços de tokens

Recursos Externos

- Hugging Face Blog - Aprenda sobre métodos de tokenização e implementações em LLMs modernos

- Jay Alammar's Blog - Explicações visuais de como tokenização e transformers funcionam juntos

- Google AI Research - Descubra avanços em tokenização multilíngue e eficiência

Seção de FAQ

Perguntas Frequentes sobre Tokenização

O que é Tokenização em IA?

Tokenização é o processo de dividir texto em unidades menores (tokens) que modelos de IA podem processar, como palavras, subpalavras ou caracteres.

Qual é a diferença entre tokenização de palavras e subpalavras?

Tokenização de palavras divide texto em limites de palavras. Tokenização de subpalavras quebra palavras em pedaços menores, permitindo que modelos manipulem palavras desconhecidas e reduzam tamanho de vocabulário.

Quais são os principais tipos de tokenização?

Tokenização de Palavras (palavras completas), Tokenização de Subpalavras (pedaços de palavras), Tokenização de Caracteres (letras individuais) e Byte-Pair Encoding/BPE (sequências frequentes aprendidas).

O que é limite de tokens ou janela de contexto?

Limite de tokens é o número máximo de tokens que um modelo pode processar de uma vez. Por exemplo, LLMs modernos podem tipicamente manipular 100.000-200.000 tokens, afetando quanto texto você pode inserir e receber.

Parte da [Coleção de Termos de AI]. Última atualização: 2026-01-11

Founder & CEO