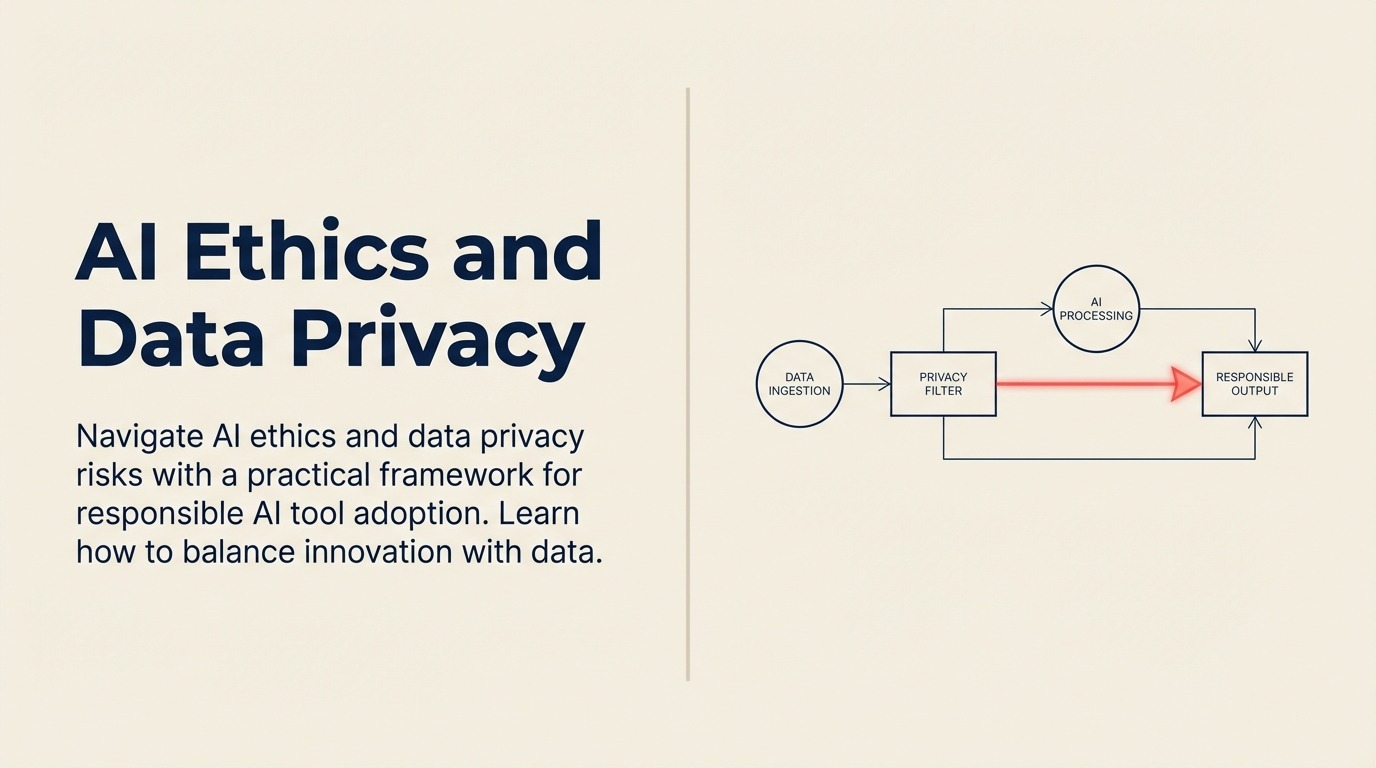

Ética em AI e Privacidade de Dados: Adoção Responsável de Ferramentas de Produtividade AI

O custo médio de uma violação de dados relacionada a AI atingiu $4,3 milhões em 2026. Isso é 15% maior do que violações tradicionais porque ferramentas AI frequentemente acessam dados mais sensíveis e criam novos pontos de exposição que a segurança tradicional não aborda. De acordo com o IBM's Cost of a Data Breach Report, organizações com práticas maduras de segurança AI experimentam custos de violação significativamente menores e tempos de contenção mais rápidos.

A maioria das empresas aborda a adoção de ferramentas AI focada inteiramente em capacidades e ROI. Elas avaliam o que as ferramentas podem fazer e quanto tempo economizarão. Segurança e privacidade se tornam pensamentos posteriores - caixas a marcar com jurídico e TI antes da aprovação final.

Isso está errado. Para ferramentas AI especificamente, privacidade e ética não são apenas requisitos de conformidade. Eles são fundamentais para determinar se as ferramentas funcionarão em seu ambiente e se criarão riscos que superam seu valor. Essas considerações devem ser centrais ao seu framework de seleção de ferramentas AI desde o primeiro dia.

As empresas que acertam constroem programas de AI responsável antes de escalar a adoção de AI. Elas estabelecem princípios claros, estruturas de governança e políticas que permitem mover rápido enquanto permanecem seguras.

Princípios Éticos Fundamentais para AI Empresarial

Antes de mergulhar em riscos específicos e controles, entenda os quatro princípios éticos que devem guiar todas as decisões sobre ferramentas AI. Estes não são filosofia abstrata - são guias práticos que previnem problemas.

Princípio 1: Transparência e Explicabilidade

Os usuários devem entender quando estão interagindo com AI e o que a AI está fazendo com seus dados. Executivos devem entender como as ferramentas AI tomam decisões que afetam resultados de negócio.

Isso não significa explicar cada algoritmo. Significa:

- Divulgar quando o conteúdo é gerado por AI

- Explicar quais dados a AI usa

- Fornecer raciocínio para recomendações da AI

- Reconhecer incerteza nos outputs da AI

Por Que Isso Importa: Uma equipe de marketing usou ferramentas de geração de conteúdo AI para criar emails de clientes sem divulgação. Os destinatários se sentiram enganados quando perceberam que as mensagens aparentemente pessoais eram automatizadas. O backlash resultante custou mais do que a ferramenta economizou.

Princípio 2: Justiça e Mitigação de Viés

Ferramentas AI aprendem com dados, e dados refletem vieses históricos. Ferramentas podem perpetuar ou amplificar discriminação em contratação, empréstimos, atendimento ao cliente e outros processos de negócio.

O Que a Justiça Requer:

- Auditar outputs de AI para disparidades demográficas

- Testar ferramentas com conjuntos de dados diversos

- Monitorar drift no comportamento da AI ao longo do tempo

- Ter humanos revisando decisões de alto impacto

Exemplo Real: Uma ferramenta de recrutamento treinada em dados históricos de contratação dava pontuações mais baixas a candidatos de certas universidades porque contratações anteriores dessas escolas tinham maior atrito. A ferramenta não era tendenciosa contra essas escolas - estava aprendendo uma correlação que não era causal. Mas o efeito era discriminatório independentemente da intenção.

Princípio 3: Privacidade e Proteção de Dados

Ferramentas AI frequentemente precisam de acesso a dados sensíveis de negócio e clientes para funcionar efetivamente. Esse acesso cria risco que deve ser gerenciado deliberadamente.

Requisitos de Privacidade:

- Minimizar coleta de dados ao que é realmente necessário

- Proteger dados em trânsito e em repouso

- Controlar quem pode acessar quais dados

- Habilitar exclusão quando retenção de dados não é necessária

- Obter consentimento apropriado para uso de dados

Princípio 4: Responsabilidade e Governança

Alguém deve ser responsável por como ferramentas AI são usadas e quais resultados elas produzem. A responsabilidade não pode ser difundida para "o algoritmo."

Essenciais de Governança:

- Propriedade clara para decisões de ferramentas AI

- Processos de aprovação para novas ferramentas e casos de uso

- Auditorias regulares de uso e resultados de ferramentas AI

- Planos de resposta a incidentes para quando as coisas dão errado

- Documentação de decisões e justificativa

Riscos de Privacidade de Dados Específicos de Ferramentas AI

Ferramentas AI criam riscos de privacidade que software tradicional não cria. Entender esses riscos ajuda a avaliá-los e mitigá-los antes que se tornem violações.

Risco 1: Exposição de Dados de Treinamento

Alguns modelos AI lembram exemplos específicos de seus dados de treinamento. Se informação sensível estava nesses dados de treinamento, ela pode ser exposta através de consultas cuidadosamente elaboradas.

O Problema: Uma equipe jurídica usou um assistente de pesquisa AI treinado em milhões de documentos. Uma parte externa descobriu que podia extrair informações confidenciais de clientes de documentos de casos que faziam parte do conjunto de treinamento.

Mitigação:

- Usar ferramentas AI que garantem segregação de dados

- Preferir ferramentas treinadas apenas em dados públicos ou licenciados

- Nunca inserir dados altamente sensíveis em ferramentas AI públicas

- Auditar quais dados os fornecedores usam para treinamento

Risco 2: Vazamento de Prompts e Retenção de Dados

Quando você envia um prompt para uma ferramenta AI, para onde esses dados vão? Por quanto tempo são armazenados? Quem pode acessá-los? Muitos usuários não percebem que seus prompts são registrados e retidos.

O Problema: Representantes de vendas usaram uma ferramenta AI pública para rascunhar propostas de clientes, incluindo estratégia de precificação e informações confidenciais de clientes. O fornecedor retinha todos os prompts para melhoria do modelo. Concorrentes usando a mesma ferramenta potencialmente poderiam acessar padrões desses prompts.

Mitigação:

- Revisar políticas de retenção de dados antes da adoção

- Usar versões empresariais com privacidade de dados garantida

- Implementar ferramentas DLP para detectar dados sensíveis em prompts

- Treinar usuários sobre quais dados são seguros para compartilhar com ferramentas AI

Risco 3: Riscos de Modelos de Terceiros

Muitas ferramentas AI usam modelos subjacentes de terceiros (OpenAI, Anthropic, Google). Seus dados passam por múltiplos sistemas, cada um com sua própria postura de segurança.

O Problema: Uma empresa de serviços financeiros usou um assistente de escrita AI que dependia de uma API de terceiros. O provedor da API teve um incidente de segurança. Mesmo que o fornecedor do assistente de escrita tivesse segurança forte, dados de clientes foram expostos através do provedor do modelo.

Mitigação:

- Mapear fluxo completo de dados incluindo todos os terceiros

- Avaliar segurança de toda a cadeia, não apenas fornecedor direto

- Usar acordos empresariais com proteções contratuais

- Considerar implantações on-premise ou cloud privada para casos de uso sensíveis

Risco 4: Transferência de Dados Transfronteiriça

O processamento de modelos AI frequentemente acontece em data centers centralizados, frequentemente nos EUA. Isso cria problemas de conformidade para empresas operando sob GDPR, CCPA ou regulamentações específicas do setor.

O Problema: Uma empresa europeia usou uma ferramenta de atendimento ao cliente AI. Dados pessoais de clientes foram processados em servidores dos EUA. Isso violou requisitos de residência de dados do GDPR, resultando em ação regulatória e multas.

Mitigação:

- Verificar onde os dados são processados, não apenas onde são armazenados

- Usar ferramentas com data centers regionais quando necessário

- Implementar Cláusulas Contratuais Padrão ou proteções equivalentes

- Conduzir Avaliações de Impacto de Proteção de Dados para processamento de alto risco

Framework de Conformidade Regulatória

A adoção de ferramentas AI não é opcional - é competitivamente necessária. Mas deve acontecer dentro de limites regulatórios que estão evoluindo rapidamente.

Requisitos do GDPR para Operações na UE

O Regulamento Geral de Proteção de Dados (GDPR) aplica-se a qualquer empresa processando dados pessoais de residentes da UE. Requisitos-chave para ferramentas AI:

Base Legal para Processamento: Você precisa de uma base legal para processar dados pessoais com ferramentas AI. Interesse legítimo frequentemente funciona para ferramentas de produtividade de funcionários. AI voltada para clientes geralmente requer consentimento ou necessidade contratual.

Minimização de Dados: Processar apenas dados necessários para o propósito específico. Não alimente bancos de dados inteiros de clientes em ferramentas AI quando você só precisa de campos específicos.

Direito à Explicação: Quando AI toma decisões que afetam significativamente indivíduos (contratação, crédito, saúde), você deve ser capaz de explicar como a decisão foi tomada.

Direitos dos Titulares de Dados: Indivíduos podem solicitar cópias de seus dados, correções ou exclusão. Suas ferramentas AI devem suportar esses direitos - o que pode ser difícil se dados estão incorporados em conjuntos de treinamento.

CCPA e Leis Estaduais de Privacidade dos EUA

A Lei de Privacidade do Consumidor da Califórnia e leis similares em outros estados criam requisitos para empresas que lidam com dados de residentes da Califórnia:

Requisitos de Divulgação: Você deve divulgar quais informações pessoais coleta e como são usadas. Isso inclui propósitos de processamento AI.

Direitos de Opt-Out: Consumidores podem optar por não ter seus dados vendidos ou compartilhados. Algumas interpretações consideram treinamento de modelos AI como "compartilhamento" de dados.

Tomada de Decisão Automatizada: Residentes da Califórnia têm o direito de optar por não participar de perfis automatizados que produzem efeitos legais ou similarmente significativos.

Regulamentações Específicas do Setor

Certos setores enfrentam requisitos adicionais relacionados a AI:

HIPAA (Saúde): Informações de saúde protegidas só podem ser processadas por Associados de Negócio com acordos apropriados. A maioria das ferramentas AI públicas não se qualifica. Ferramentas de saúde AI devem ser especificamente compatíveis com HIPAA.

FINRA e Regulamentações Bancárias: AI de serviços financeiros deve atender requisitos de manutenção de registros e supervisão. Todas as comunicações geradas por AI devem ser registradas e revisáveis.

SOX (Empresas Públicas): Ferramentas AI que afetam relatórios financeiros devem ter controles apropriados. Trilhas de auditoria devem existir para dados financeiros gerados por AI.

Regulamentações Emergentes Específicas de AI

Governos mundialmente estão desenvolvendo regulamentações específicas de AI:

Lei de AI da UE: Cria categorias de risco para sistemas AI com requisitos mais rígidos para aplicações de alto risco (contratação, decisões de crédito, aplicação da lei). A maioria da AI de produtividade se enquadra em categorias de risco menor, mas ainda enfrenta requisitos de transparência. Saiba mais na página da Lei de AI da Comissão Europeia.

Ordem Executiva dos EUA sobre AI: Estabelece padrões de segurança para sistemas AI, particularmente em torno de técnicas de preservação de privacidade e resultados discriminatórios.

Leis Estaduais de AI: Vários estados dos EUA aprovaram ou estão considerando leis específicas de AI abordando discriminação algorítmica, transparência e responsabilidade.

O Que Isso Significa: O cenário regulatório está mudando ativamente. Construa programas de conformidade que possam se adaptar em vez de atender apenas requisitos atuais. Garanta que sua abordagem de segurança e conformidade AI permaneça atual com regulamentações em evolução.

Avaliação de Segurança de Fornecedores

Nem todos os fornecedores de ferramentas AI têm posturas de segurança equivalentes. Avaliação sistemática de fornecedores previne escolher ferramentas que criam risco inaceitável.

Perguntas Críticas de Segurança para Cada Fornecedor

Práticas de Manuseio de Dados:

- Dados de clientes são segregados de outros clientes?

- Dados de clientes são usados para treinar modelos?

- Podemos optar por não usar dados além da provisão direta de serviço?

- Por quanto tempo os dados são retidos?

- Qual é o processo para exclusão de dados?

Criptografia e Controles de Acesso:

- Dados são criptografados em trânsito (TLS 1.3 ou melhor)?

- Dados são criptografados em repouso?

- Quem tem acesso a dados de clientes internamente?

- Como são gerenciados acesso privilegiado e credenciais?

- Autenticação multifator é obrigatória para todo acesso?

Certificações de Conformidade:

- SOC 2 Type II (controles de segurança auditados anualmente)

- ISO 27001 (gestão de segurança da informação)

- ISO 27701 (gestão de privacidade)

- Certificações específicas do setor (HITRUST para saúde, PCI DSS para dados de pagamento)

Práticas de Segurança:

- Frequência de testes de segurança (testes de penetração, varreduras de vulnerabilidade)

- Divulgação de vulnerabilidades e cronograma de correção

- Auditorias de segurança de terceiros

- Treinamento de segurança para funcionários

- Histórico de incidentes e resposta

Opções de Residência de Dados:

- Quais regiões geográficas podem processar e armazenar dados?

- Podemos especificar requisitos de residência de dados?

- O fornecedor usa subprocessadores em outras regiões?

- Como são tratadas transferências transfronteiriças?

Sinais de Alerta Que Devem Parar a Aquisição

Algumas respostas de fornecedores devem encerrar a avaliação imediatamente:

- Recusar fornecer documentação de segurança

- Sem certificação SOC 2 ou equivalente

- Histórico de incidentes de segurança não divulgados

- Respostas vagas sobre direitos de uso de dados

- Sem opção para controles de residência de dados

- Usar dados de clientes para treinamento sem opt-out

Estrutura de Governança Interna

Segurança externa de fornecedores é necessária mas insuficiente. Governança interna forte previne mau uso mesmo de ferramentas seguras.

Políticas de Uso de AI

Toda organização precisa de políticas claras cobrindo:

Casos de Uso Aprovados: Para que ferramentas AI podem ser usadas? Categorias podem incluir:

- Aprovado: Documentação interna, criação de rascunhos de conteúdo, análise de dados

- Requer Aprovação: Conteúdo voltado para clientes, suporte a decisões

- Proibido: Processar dados confidenciais, tomar decisões de contratação sem revisão humana

Classificação de Dados:

- Quais dados podem ser usados com ferramentas AI?

- Como os usuários identificam dados sensíveis?

- O que acontece se dados inapropriados forem acidentalmente inseridos?

Validação de Output:

- Todos os outputs de AI devem ser revisados antes do uso

- Decisões de alto impacto requerem aprovação humana

- Conteúdo gerado por AI deve ser divulgado quando apropriado

Diretrizes de Uso Aceitável

Políticas estabelecem limites. Diretrizes ajudam usuários a trabalhar efetivamente dentro deles.

Bons Exemplos:

- Use AI para brainstorming e primeiros rascunhos

- Cite quando usar AI para gerar conteúdo

- Revise outputs de AI para precisão e viés

- Reporte preocupações sobre comportamento de ferramentas AI

Maus Exemplos:

- Não cole contratos de clientes em ferramentas AI públicas

- Não trate recomendações de AI como autoritativas sem verificação

- Não use AI para tomar decisões finais sobre contratação ou avaliações de desempenho

- Não compartilhe credenciais ou outputs de ferramentas AI com partes não autorizadas

Fluxos de Aprovação

Nem toda adoção de ferramenta AI deve requerer o mesmo nível de aprovação:

Baixo Risco (Aprovação de Gerente):

- Ferramentas usadas apenas para trabalho interno

- Processando dados não sensíveis

- Fornecedores bem estabelecidos com segurança forte

Risco Médio (Aprovação TI + Jurídico):

- Ferramentas processando dados de clientes

- Integração com sistemas de negócio principais

- Novos fornecedores sem histórico extenso

Alto Risco (Aprovação Executiva + Comitê):

- Ferramentas tomando ou influenciando decisões sobre pessoas

- Processando dados altamente sensíveis ou regulamentados

- Casos de uso novos sem precedente na indústria

Monitoramento e Auditoria

Políticas não se aplicam sozinhas. Monitoramento regular detecta problemas cedo:

O Que Monitorar:

- Quais ferramentas AI estão sendo usadas (detecção de shadow IT)

- Quais dados estão sendo enviados para ferramentas AI (alertas DLP)

- Quão frequentemente ferramentas são usadas e por quem

- Tickets de suporte e relatórios de incidentes relacionados a ferramentas AI

Acompanhe essas métricas junto com suas métricas de ROI de produtividade AI mais amplas para garantir que a governança não impeça a entrega de valor.

Atividades de Auditoria:

- Revisões trimestrais de inventário de ferramentas AI

- Reavaliação anual de segurança de fornecedores

- Amostragem aleatória de outputs gerados por AI para qualidade e conformidade

- Pesquisas com usuários sobre entendimento de políticas

Construindo Cultura de AI Responsável Através de Treinamento

As melhores políticas falham se os funcionários não as entendem ou por que elas importam. Treinamento transforma conformidade de caixa de seleção em capacidade.

Essenciais do Programa de Treinamento

Para Todos os Funcionários:

- Quais ferramentas AI são aprovadas e como usá-las

- Quais dados podem e não podem ser usados com AI

- Como reconhecer e reportar problemas

- Por que ética e privacidade AI importam

Para Usuários Avançados:

- Engenharia de prompts avançada dentro de limites de política

- Avaliação de qualidade de output

- Detecção e mitigação de viés

- Quando escalar preocupações

Para Gerentes:

- Aprovar solicitações apropriadas de ferramentas AI

- Monitorar uso da equipe para conformidade

- Apoiar funcionários no uso responsável

- Modelar bons comportamentos de uso de AI

Para Executivos:

- Cenário de risco AI e estratégias de mitigação

- Requisitos de governança e responsabilidade

- Decisões estratégicas de AI equilibrando oportunidade e risco

- Relatórios e supervisão de AI a nível de conselho

Entrega de Treinamento

Treinamento único não funciona. Treinamento eficaz de ética AI é contínuo:

- Módulo inicial de onboarding (30-45 minutos)

- Atualizações trimestrais sobre novas políticas ou ferramentas (15 minutos)

- Orientação just-in-time ao adotar novas ferramentas

- Exemplos e estudos de caso de sua própria organização

- Materiais de referência e árvores de decisão de fácil acesso

Resposta a Incidentes: Quando Ferramentas AI Expõem Dados Sensíveis

Apesar dos melhores esforços, incidentes acontecerão. A qualidade da resposta determina se um incidente se torna uma crise.

Resposta Imediata (0-24 Horas)

Conter a Exposição:

- Desabilitar acesso a ferramenta AI afetada se necessário

- Identificar quais dados foram expostos

- Determinar escopo da exposição (quem viu, para onde foi)

Notificar Stakeholders:

- Informar equipes jurídicas e de conformidade internas

- Alertar unidades de negócio afetadas

- Preparar comunicação para indivíduos afetados se necessário

Preservar Evidências:

- Arquivos de log e trilhas de auditoria

- Capturas de tela de outputs problemáticos

- Linha do tempo de eventos e ações tomadas

Investigação (24-72 Horas)

Análise de Causa Raiz:

- Como o incidente ocorreu?

- Quais controles falharam ou foram contornados?

- Políticas foram violadas ou políticas eram insuficientes?

Avaliação de Impacto:

- Quantos indivíduos afetados?

- Qual nível de sensibilidade dos dados foi exposto?

- Quais são os danos potenciais para indivíduos afetados?

- Quais são as obrigações regulatórias?

Coordenação com Fornecedor:

- Notificar fornecedor da ferramenta AI

- Solicitar investigação e remediação deles

- Determinar se incidente afetou outros clientes

Remediação (72 Horas - 30 Dias)

Correções Imediatas:

- Implementar controles para prevenir recorrência

- Atualizar políticas se lacunas foram identificadas

- Retreinar usuários se violações de política ocorreram

Resposta Regulatória:

- Arquivar notificações de violação necessárias (frequentemente 72 horas sob GDPR)

- Responder a inquéritos regulatórios

- Documentar passos de remediação

Melhorias de Longo Prazo:

- Atualizar requisitos de segurança de fornecedores

- Aprimorar monitoramento e detecção

- Revisar programas de treinamento

- Considerar se a ferramenta deve permanecer aprovada

Equilibrando Inovação com Risco

O objetivo não é risco zero. É assumir riscos inteligentes que capturam valor de AI enquanto protegem o que importa.

Comece com Casos de Uso de Baixo Risco: Comece com ferramentas AI para produtividade interna onde o impacto da exposição de dados é limitado. Construa confiança e capacidade antes de expandir para casos de uso voltados para clientes ou alta sensibilidade.

Camadas de Defesa: Não confie apenas na política. Combine controles técnicos (DLP, gestão de acesso), segurança de fornecedor, treinamento de usuário e monitoramento para defesa em profundidade.

Revisar e Adaptar: Trate seu programa de governança AI como um produto que melhora ao longo do tempo. Revisões regulares capturam riscos emergentes e oportunidades de otimizar sem comprometer proteção.

Comunicar o Porquê: As pessoas seguem políticas que entendem e concordam. Explique as razões de negócio e éticas por trás da governança AI, não apenas as regras.

Recursos Relacionados

Continue construindo seu programa de AI responsável:

- Framework de Seleção de Ferramentas AI - Incorporando segurança na seleção de ferramentas

- Segurança e Conformidade AI - Mergulho profundo em controles técnicos

- Treinamento e Onboarding AI - Construindo capacidade do usuário

- Construindo uma Cultura AI-First - Abordagem de transformação cultural

As empresas líderes em AI não são as adotantes mais agressivas. São aquelas que descobriram como mover rápido enquanto permanecem seguras. Isso não é um problema de tecnologia - é um problema de governança. Acerte a governança, e você pode adotar AI com confiança.

Senior Operations & Growth Strategist

On this page

- Princípios Éticos Fundamentais para AI Empresarial

- Princípio 1: Transparência e Explicabilidade

- Princípio 2: Justiça e Mitigação de Viés

- Princípio 3: Privacidade e Proteção de Dados

- Princípio 4: Responsabilidade e Governança

- Riscos de Privacidade de Dados Específicos de Ferramentas AI

- Risco 1: Exposição de Dados de Treinamento

- Risco 2: Vazamento de Prompts e Retenção de Dados

- Risco 3: Riscos de Modelos de Terceiros

- Risco 4: Transferência de Dados Transfronteiriça

- Framework de Conformidade Regulatória

- Requisitos do GDPR para Operações na UE

- CCPA e Leis Estaduais de Privacidade dos EUA

- Regulamentações Específicas do Setor

- Regulamentações Emergentes Específicas de AI

- Avaliação de Segurança de Fornecedores

- Perguntas Críticas de Segurança para Cada Fornecedor

- Sinais de Alerta Que Devem Parar a Aquisição

- Estrutura de Governança Interna

- Políticas de Uso de AI

- Diretrizes de Uso Aceitável

- Fluxos de Aprovação

- Monitoramento e Auditoria

- Construindo Cultura de AI Responsável Através de Treinamento

- Essenciais do Programa de Treinamento

- Entrega de Treinamento

- Resposta a Incidentes: Quando Ferramentas AI Expõem Dados Sensíveis

- Resposta Imediata (0-24 Horas)

- Investigação (24-72 Horas)

- Remediação (72 Horas - 30 Dias)

- Equilibrando Inovação com Risco

- Recursos Relacionados