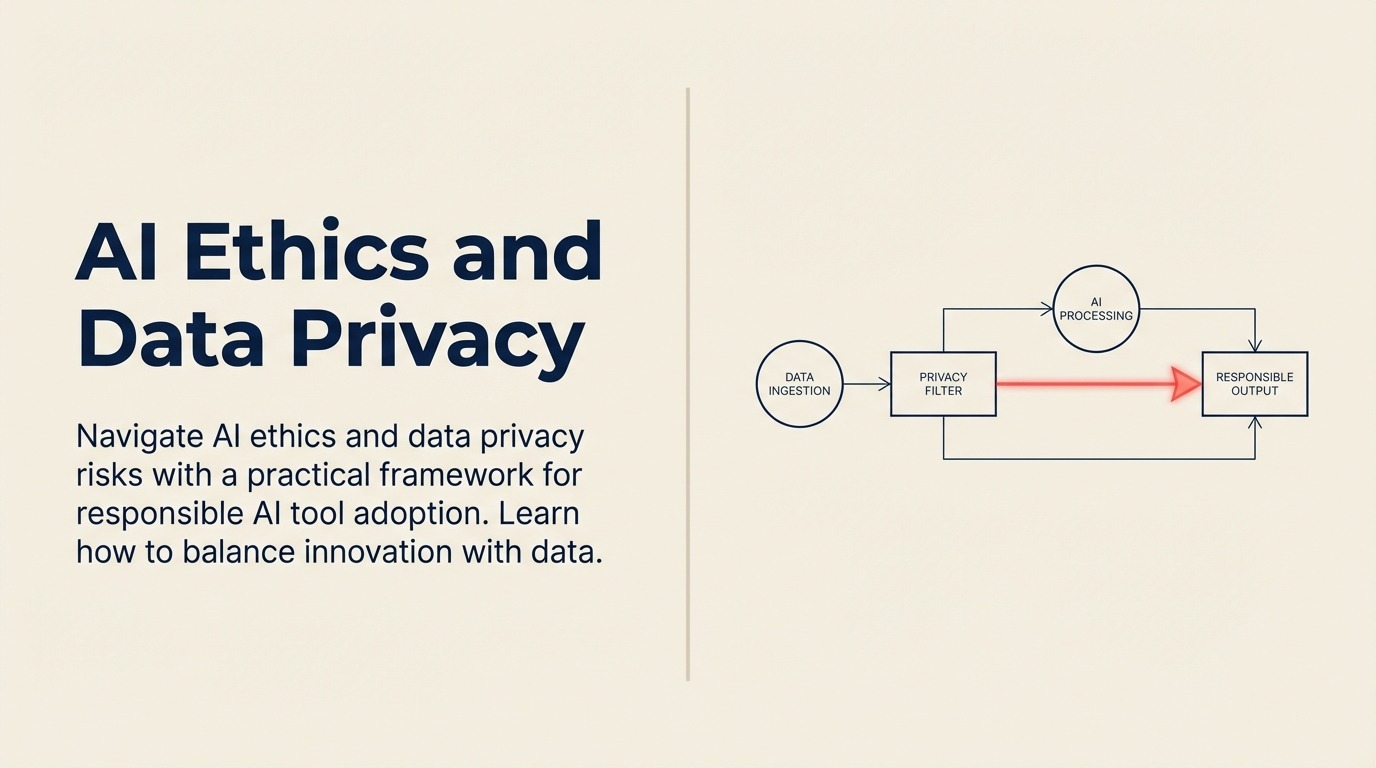

Etika AI dan Privacy Data: Adopsi Tool Produktivitas AI yang Bertanggung Jawab

Rata-rata biaya data breach terkait AI mencapai $4,3 juta pada tahun 2026. Itu 15% lebih tinggi dari breach tradisional karena tool AI sering menyentuh data lebih sensitif dan menciptakan titik eksposur baru yang tidak ditangani keamanan tradisional. Menurut IBM's Cost of a Data Breach Report, organisasi dengan praktik keamanan AI yang mature mengalami biaya breach yang jauh lebih rendah dan waktu containment yang lebih cepat.

Sebagian besar perusahaan mendekati adopsi tool AI fokus sepenuhnya pada kemampuan dan ROI. Mereka mengevaluasi apa yang dapat dilakukan tool dan waktu apa yang akan dihemat. Keamanan dan privacy menjadi pertimbangan setelahnya - kotak untuk dicentang dengan legal dan IT sebelum persetujuan final.

Itu mundur. Untuk tool AI secara khusus, privacy dan etika bukan hanya persyaratan compliance. Mereka fundamental untuk apakah tool akan bekerja di environment Anda dan apakah mereka akan menciptakan risiko yang melampaui value mereka. Pertimbangan ini harus menjadi pusat framework seleksi tool AI Anda sejak hari pertama.

Perusahaan yang melakukan ini dengan benar membangun program AI yang bertanggung jawab sebelum mereka menskalakan adopsi AI. Mereka menetapkan prinsip yang jelas, struktur governance, dan kebijakan yang memungkinkan mereka bergerak cepat sambil tetap aman.

Prinsip Etika Inti untuk Business AI

Sebelum menyelami risiko dan kontrol spesifik, pahami empat prinsip etika yang harus memandu semua keputusan tool AI. Ini bukan filosofi abstrak - ini adalah pedoman praktis yang mencegah masalah.

Prinsip 1: Transparansi dan Explainability

Pengguna harus memahami kapan mereka berinteraksi dengan AI dan apa yang AI lakukan dengan data mereka. Eksekutif harus memahami bagaimana tool AI membuat keputusan yang memengaruhi hasil bisnis.

Ini tidak berarti menjelaskan setiap algoritma. Ini berarti:

- Mengungkapkan kapan konten dihasilkan AI

- Menjelaskan data apa yang digunakan AI

- Menyediakan reasoning untuk rekomendasi AI

- Mengakui ketidakpastian dalam output AI

Mengapa Penting: Tim marketing menggunakan tool generasi konten AI untuk membuat email customer tanpa pengungkapan. Penerima merasa tertipu ketika mereka menyadari pesan yang tampak personal adalah otomatis. Backlash yang dihasilkan menelan biaya lebih dari yang dihemat tool.

Prinsip 2: Keadilan dan Mitigasi Bias

Tool AI belajar dari data, dan data mencerminkan bias historis. Tool dapat melanggengkan atau memperkuat diskriminasi dalam hiring, lending, customer service, dan proses bisnis lainnya.

Apa yang Keadilan Memerlukan:

- Audit output AI untuk disparitas demografis

- Menguji tool dengan data set yang beragam

- Memantau drift dalam perilaku AI dari waktu ke waktu

- Memiliki manusia meninjau keputusan high-stakes

Contoh Nyata: Tool rekrutmen yang dilatih pada data hiring historis memberikan skor lebih rendah kepada kandidat dari universitas tertentu karena hire masa lalu dari sekolah tersebut memiliki attrition lebih tinggi. Tool tidak bias terhadap sekolah tersebut - itu belajar korelasi yang bukan kausal. Tetapi efeknya diskriminatif terlepas dari niat.

Prinsip 3: Privacy dan Perlindungan Data

Tool AI sering membutuhkan akses ke data bisnis dan customer sensitif untuk berfungsi secara efektif. Akses itu menciptakan risiko yang harus dikelola secara deliberate.

Persyaratan Privacy:

- Minimalkan pengumpulan data untuk apa yang benar-benar dibutuhkan

- Lindungi data in transit dan at rest

- Kontrol siapa yang dapat mengakses data apa

- Aktifkan penghapusan ketika retensi data tidak diperlukan

- Dapatkan consent yang sesuai untuk penggunaan data

Prinsip 4: Akuntabilitas dan Governance

Seseorang harus bertanggung jawab untuk bagaimana tool AI digunakan dan hasil apa yang mereka hasilkan. Akuntabilitas tidak dapat didifusikan ke "algoritma."

Essensial Governance:

- Kepemilikan jelas untuk keputusan tool AI

- Proses persetujuan untuk tool dan use case baru

- Audit reguler dari penggunaan tool AI dan hasil

- Rencana respons insiden untuk ketika hal-hal salah

- Dokumentasi keputusan dan reasoning

Risiko Privacy Data Spesifik untuk Tool AI

Tool AI menciptakan risiko privacy yang tidak dimiliki software tradisional. Memahami risiko ini membantu Anda mengevaluasi dan memitigasinya sebelum menjadi breach.

Risiko 1: Eksposur Training Data

Beberapa model AI mengingat contoh spesifik dari training data mereka. Jika informasi sensitif ada dalam training data itu, itu dapat diekspos melalui query yang dibuat dengan hati-hati.

Masalahnya: Tim legal menggunakan asisten riset AI yang dilatih pada jutaan dokumen. Pihak eksternal menemukan mereka dapat mengekstrak informasi client confidential dari dokumen kasus yang merupakan bagian dari training set.

Mitigasi:

- Gunakan tool AI yang menjamin segregasi data

- Lebih suka tool yang dilatih hanya pada data public atau licensed

- Jangan pernah input data highly sensitive ke tool AI public

- Audit data apa yang digunakan vendor untuk training

Risiko 2: Prompt Leakage dan Retensi Data

Ketika Anda mengirim prompt ke tool AI, ke mana data itu pergi? Berapa lama disimpan? Siapa yang dapat mengaksesnya? Banyak pengguna tidak menyadari prompt mereka dicatat dan disimpan.

Masalahnya: Sales rep menggunakan tool AI public untuk menyusun proposal customer, termasuk strategi pricing dan informasi customer confidential. Vendor menyimpan semua prompt untuk perbaikan model. Kompetitor yang menggunakan tool yang sama berpotensi dapat mengakses pola dari prompt tersebut.

Mitigasi:

- Tinjau kebijakan retensi data sebelum adopsi

- Gunakan versi bisnis dengan privacy data terjamin

- Implementasikan tool DLP untuk mendeteksi data sensitif dalam prompt

- Latih pengguna tentang data apa yang aman dibagikan dengan tool AI

Risiko 3: Risiko Model Third-Party

Banyak tool AI menggunakan model underlying dari third party (OpenAI, Anthropic, Google). Data Anda melewati beberapa sistem, masing-masing dengan postur keamanannya sendiri.

Masalahnya: Perusahaan financial service menggunakan asisten penulisan AI yang mengandalkan API third-party. Provider API mengalami insiden keamanan. Meskipun vendor asisten penulisan memiliki keamanan kuat, data customer diekspos melalui provider model.

Mitigasi:

- Petakan aliran data lengkap termasuk semua third party

- Evaluasi keamanan seluruh chain, bukan hanya vendor langsung

- Gunakan enterprise agreement dengan perlindungan kontraktual

- Pertimbangkan deployment on-premise atau private cloud untuk use case sensitif

Risiko 4: Transfer Data Cross-Border

Pemrosesan model AI sering terjadi di data center terpusat, sering di AS. Ini menciptakan masalah compliance untuk perusahaan yang beroperasi di bawah GDPR, CCPA, atau regulasi spesifik industri.

Masalahnya: Perusahaan Eropa menggunakan tool customer service AI. Data personal customer diproses di server AS. Ini melanggar persyaratan data residency GDPR, menghasilkan tindakan regulasi dan denda.

Mitigasi:

- Verifikasi di mana data diproses, bukan hanya di mana disimpan

- Gunakan tool dengan data center regional ketika diperlukan

- Implementasikan Standard Contractual Clause atau perlindungan setara

- Lakukan Data Protection Impact Assessment untuk pemrosesan high-risk

Framework Compliance Regulasi

Adopsi tool AI bukan opsional - itu competitively necessary. Tetapi harus terjadi dalam batas regulasi yang berkembang pesat.

Persyaratan GDPR untuk Operasi EU

General Data Protection Regulation (GDPR) berlaku untuk perusahaan apa pun yang memproses data personal penduduk EU. Persyaratan kunci untuk tool AI:

Basis Hukum untuk Pemrosesan: Anda membutuhkan basis legal untuk memproses data personal dengan tool AI. Legitimate interest sering bekerja untuk tool produktivitas karyawan. AI customer-facing biasanya memerlukan consent atau contractual necessity.

Minimisasi Data: Hanya proses data yang diperlukan untuk tujuan spesifik. Jangan feed seluruh database customer ke tool AI ketika Anda hanya membutuhkan field spesifik.

Hak untuk Penjelasan: Ketika AI membuat keputusan yang secara signifikan memengaruhi individu (hiring, credit, healthcare), Anda harus dapat menjelaskan bagaimana keputusan dibuat.

Hak Data Subject: Individu dapat meminta salinan data mereka, koreksi, atau penghapusan. Tool AI Anda harus mendukung hak-hak ini - yang dapat sulit jika data tertanam dalam training set.

CCPA dan US State Privacy Law

California Consumer Privacy Act dan law serupa di state lain menciptakan persyaratan untuk bisnis yang menangani data penduduk California:

Persyaratan Disclosure: Anda harus mengungkapkan informasi personal apa yang Anda kumpulkan dan bagaimana digunakan. Ini termasuk tujuan pemrosesan AI.

Hak Opt-Out: Konsumen dapat opt out dari memiliki data mereka dijual atau dibagikan. Beberapa interpretasi menganggap training model AI sebagai "sharing" data.

Automated Decision-Making: Penduduk California memiliki hak untuk opt out dari profiling otomatis yang menghasilkan efek legal atau similarly significant.

Regulasi Spesifik Industri

Industri tertentu menghadapi persyaratan tambahan terkait AI:

HIPAA (Healthcare): Protected health information hanya dapat diproses oleh Business Associate dengan agreement yang sesuai. Sebagian besar tool AI public tidak memenuhi syarat. Tool AI healthcare harus secara khusus HIPAA-compliant.

FINRA dan Banking Regulation: AI financial service harus memenuhi persyaratan recordkeeping dan supervision. Semua komunikasi yang dihasilkan AI harus dicatat dan dapat ditinjau.

SOX (Public Companies): Tool AI yang memengaruhi financial reporting harus memiliki kontrol yang sesuai. Audit trail harus ada untuk data financial yang dihasilkan AI.

Regulasi Spesifik AI yang Muncul

Pemerintah di seluruh dunia mengembangkan regulasi spesifik AI:

EU AI Act: Menciptakan kategori risiko untuk sistem AI dengan persyaratan lebih ketat untuk aplikasi high-risk (hiring, credit decision, law enforcement). Sebagian besar produktivitas AI jatuh ke dalam kategori risiko lebih rendah tetapi masih menghadapi persyaratan transparansi. Pelajari lebih lanjut di European Commission's AI Act page.

US Executive Order on AI: Menetapkan standar keamanan dan security untuk sistem AI, khususnya seputar teknik privacy-preserving dan hasil diskriminatif.

State-Level AI Law: Beberapa state AS telah meloloskan atau sedang mempertimbangkan law spesifik AI yang menangani discriminasi algoritmik, transparansi, dan akuntabilitas.

Apa Artinya Ini: Landscape regulasi aktif berubah. Bangun program compliance yang dapat beradaptasi daripada hanya memenuhi persyaratan saat ini. Pastikan pendekatan keamanan dan compliance AI Anda tetap current dengan regulasi yang berkembang.

Penilaian Keamanan Vendor

Tidak semua vendor tool AI memiliki postur keamanan setara. Penilaian vendor sistematis mencegah memilih tool yang menciptakan risiko tidak dapat diterima.

Pertanyaan Keamanan Critical untuk Setiap Vendor

Praktik Penanganan Data:

- Apakah data customer disegregasi dari customer lain?

- Apakah data customer pernah digunakan untuk train model?

- Bisakah kita opt out dari penggunaan data apa pun di luar penyediaan layanan langsung?

- Berapa lama data disimpan?

- Apa prosesnya untuk penghapusan data?

Encryption dan Access Control:

- Apakah data dienkripsi in transit (TLS 1.3 atau lebih baik)?

- Apakah data dienkripsi at rest?

- Siapa yang memiliki akses ke data customer secara internal?

- Bagaimana privileged access dan credential dikelola?

- Apakah multi-factor authentication diperlukan untuk semua akses?

Sertifikasi Compliance:

- SOC 2 Type II (kontrol keamanan diaudit setiap tahun)

- ISO 27001 (manajemen keamanan informasi)

- ISO 27701 (manajemen privacy)

- Sertifikasi spesifik industri (HITRUST untuk healthcare, PCI DSS untuk data pembayaran)

Praktik Keamanan:

- Frekuensi pengujian keamanan (penetration test, vulnerability scan)

- Timeline disclosure dan patching vulnerability

- Audit keamanan third-party

- Training keamanan untuk karyawan

- Riwayat insiden dan respons

Opsi Data Residency:

- Wilayah geografis mana yang dapat memproses dan menyimpan data?

- Bisakah kita menentukan persyaratan data residency?

- Apakah vendor menggunakan sub-processor di region lain?

- Bagaimana transfer cross-border ditangani?

Red Flag yang Harus Menghentikan Procurement

Beberapa respons vendor harus mengakhiri evaluasi segera:

- Menolak untuk menyediakan dokumentasi keamanan

- Tidak ada SOC 2 atau sertifikasi setara

- Riwayat insiden keamanan yang tidak diungkapkan

- Jawaban samar tentang hak penggunaan data

- Tidak ada opsi untuk kontrol data residency

- Menggunakan data customer untuk training tanpa opt-out

Struktur Governance Internal

Keamanan vendor eksternal diperlukan tetapi tidak cukup. Governance internal yang kuat mencegah penyalahgunaan bahkan tool yang aman.

Kebijakan Penggunaan AI

Setiap organisasi membutuhkan kebijakan jelas yang mencakup:

Use Case yang Disetujui: Untuk apa tool AI dapat digunakan? Kategori mungkin termasuk:

- Disetujui: Dokumentasi internal, pembuatan draft konten, analisis data

- Memerlukan Persetujuan: Konten customer-facing, dukungan keputusan

- Dilarang: Memproses data confidential, membuat keputusan hiring tanpa review manusia

Klasifikasi Data:

- Data apa yang dapat digunakan dengan tool AI?

- Bagaimana pengguna mengidentifikasi data sensitif?

- Apa yang terjadi jika data sensitif secara tidak sengaja dimasukkan?

Validasi Output:

- Semua output AI harus ditinjau sebelum digunakan

- Keputusan high-stakes memerlukan persetujuan manusia

- Konten yang dihasilkan AI harus diungkapkan ketika sesuai

Panduan Acceptable Use

Kebijakan menetapkan batas. Panduan membantu pengguna bekerja secara efektif dalam batas tersebut.

Contoh Baik:

- Gunakan AI untuk brainstorming dan draft pertama

- Kutip ketika menggunakan AI untuk menghasilkan konten

- Tinjau output AI untuk akurasi dan bias

- Laporkan kekhawatiran tentang perilaku tool AI

Contoh Buruk:

- Jangan paste contract customer ke tool AI public

- Jangan perlakukan rekomendasi AI sebagai otoritatif tanpa verifikasi

- Jangan gunakan AI untuk membuat keputusan final tentang hiring atau performance review

- Jangan bagikan credential tool AI atau output dengan pihak tidak berwenang

Approval Workflow

Tidak semua adopsi tool AI harus memerlukan level persetujuan yang sama:

Low Risk (Manager Approval):

- Tool yang digunakan hanya untuk pekerjaan internal

- Memproses data non-sensitif

- Vendor well-established dengan keamanan kuat

Medium Risk (IT + Legal Approval):

- Tool yang memproses data customer

- Integrasi dengan sistem bisnis core

- Vendor baru tanpa track record ekstensif

High Risk (Executive + Committee Approval):

- Tool yang membuat atau mempengaruhi keputusan tentang orang

- Memproses data highly sensitive atau regulated

- Use case novel tanpa preseden industri

Monitoring dan Auditing

Kebijakan tidak menegakkan diri mereka sendiri. Monitoring reguler menangkap masalah lebih awal:

Yang Harus Dimonitor:

- Tool AI mana yang digunakan (deteksi shadow IT)

- Data apa yang dikirim ke tool AI (alert DLP)

- Seberapa sering tool digunakan dan oleh siapa

- Ticket support dan laporan insiden terkait tool AI

Lacak metrik ini di samping metrik ROI produktivitas AI Anda yang lebih luas untuk memastikan governance tidak menghalangi delivery value.

Aktivitas Audit:

- Review kuartalan dari inventori tool AI

- Penilaian ulang keamanan vendor tahunan

- Sampling acak dari output yang dihasilkan AI untuk kualitas dan compliance

- Survey pengguna tentang pemahaman kebijakan

Membangun Budaya AI yang Bertanggung Jawab Melalui Training

Kebijakan terbaik gagal jika karyawan tidak memahami mereka atau mengapa mereka penting. Training mengubah compliance dari checkbox menjadi capability.

Essensial Program Training

Untuk Semua Karyawan:

- Tool AI apa yang disetujui dan cara menggunakannya

- Data apa yang dapat dan tidak dapat digunakan dengan AI

- Cara mengenali dan melaporkan masalah

- Mengapa etika dan privacy AI penting

Untuk Power User:

- Prompt engineering lanjutan dalam batas kebijakan

- Evaluasi kualitas output

- Deteksi dan mitigasi bias

- Kapan harus meningkatkan kekhawatiran

Untuk Manager:

- Menyetujui permintaan tool AI yang sesuai

- Memantau penggunaan tim untuk compliance

- Mendukung karyawan dalam penggunaan yang bertanggung jawab

- Memodelkan perilaku penggunaan AI yang baik

Untuk Eksekutif:

- Landscape risiko AI dan strategi mitigasi

- Persyaratan governance dan akuntabilitas

- Keputusan AI strategis yang menyeimbangkan peluang dan risiko

- Pelaporan dan oversight AI level board

Delivery Training

Training satu kali tidak berhasil. Training etika AI yang efektif berkelanjutan:

- Modul onboarding awal (30-45 menit)

- Refresher kuartalan tentang kebijakan atau tool baru (15 menit)

- Panduan just-in-time ketika mengadopsi tool baru

- Contoh dan case study dari organisasi Anda sendiri

- Materi referensi yang mudah diakses dan decision tree

Respons Insiden: Ketika Tool AI Mengekspos Data Sensitif

Meskipun upaya terbaik, insiden akan terjadi. Kualitas respons menentukan apakah insiden menjadi krisis.

Respons Segera (0-24 Jam)

Contain Eksposur:

- Nonaktifkan akses tool AI yang terpengaruh jika perlu

- Identifikasi data apa yang diekspos

- Tentukan cakupan eksposur (siapa yang melihatnya, ke mana perginya)

Notify Stakeholder:

- Informasikan tim legal dan compliance internal

- Alert unit bisnis yang terpengaruh

- Siapkan komunikasi untuk individu yang terpengaruh jika diperlukan

Preserve Evidence:

- Log file dan audit trail

- Screenshot output bermasalah

- Timeline peristiwa dan tindakan yang diambil

Investigasi (24-72 Jam)

Root Cause Analysis:

- Bagaimana insiden terjadi?

- Kontrol apa yang gagal atau di-bypass?

- Apakah kebijakan dilanggar atau kebijakan tidak cukup?

Impact Assessment:

- Berapa banyak individu yang terpengaruh?

- Apa level sensitivitas data yang diekspos?

- Apa potensi kerugian bagi individu yang terpengaruh?

- Apa kewajiban regulasi?

Koordinasi Vendor:

- Notify vendor tool AI

- Minta investigasi dan remediasi mereka

- Tentukan apakah insiden memengaruhi customer lain

Remediasi (72 Jam - 30 Hari)

Fix Segera:

- Implementasikan kontrol untuk mencegah recurrence

- Update kebijakan jika gap diidentifikasi

- Retrain pengguna jika pelanggaran kebijakan terjadi

Respons Regulasi:

- File notifikasi breach yang diperlukan (sering 72 jam di bawah GDPR)

- Respons ke inquiry regulasi

- Dokumentasikan langkah remediasi

Perbaikan Jangka Panjang:

- Update persyaratan keamanan vendor

- Tingkatkan monitoring dan deteksi

- Revisi program training

- Pertimbangkan apakah tool harus tetap disetujui

Menyeimbangkan Inovasi dengan Risiko

Tujuannya bukan zero risk. Ini pengambilan risiko cerdas yang menangkap value AI sambil melindungi apa yang penting.

Mulai dengan Use Case Low-Risk: Mulai dengan tool AI untuk produktivitas internal di mana dampak eksposur data terbatas. Bangun kepercayaan dan capability sebelum memperluas ke customer-facing atau use case high-sensitivity.

Layer Defense: Jangan andalkan kebijakan saja. Kombinasikan kontrol teknis (DLP, manajemen akses), keamanan vendor, training pengguna, dan monitoring untuk defense in depth.

Review dan Adapt: Perlakukan program governance AI Anda sebagai produk yang meningkat dari waktu ke waktu. Review reguler menangkap risiko yang muncul dan peluang untuk streamline tanpa mengorbankan perlindungan.

Komunikasikan Why: Orang mengikuti kebijakan yang mereka pahami dan setujui. Jelaskan alasan bisnis dan etika di balik governance AI, bukan hanya rule.

Resource Terkait

Lanjutkan membangun program AI yang bertanggung jawab Anda:

- Framework Seleksi Tool AI - Memasukkan keamanan ke dalam seleksi tool

- Keamanan dan Compliance AI - Deep dive ke dalam kontrol teknis

- Training dan Onboarding AI - Membangun capability pengguna

- Membangun Budaya AI-First - Pendekatan transformasi budaya

Perusahaan yang memimpin dalam AI bukan adopter paling agresif. Mereka adalah yang menemukan cara bergerak cepat sambil tetap aman. Itu bukan masalah teknologi - itu masalah governance. Dapatkan governance yang benar, dan Anda dapat mengadopsi AI dengan percaya diri.

Senior Operations & Growth Strategist

On this page

- Prinsip Etika Inti untuk Business AI

- Prinsip 1: Transparansi dan Explainability

- Prinsip 2: Keadilan dan Mitigasi Bias

- Prinsip 3: Privacy dan Perlindungan Data

- Prinsip 4: Akuntabilitas dan Governance

- Risiko Privacy Data Spesifik untuk Tool AI

- Risiko 1: Eksposur Training Data

- Risiko 2: Prompt Leakage dan Retensi Data

- Risiko 3: Risiko Model Third-Party

- Risiko 4: Transfer Data Cross-Border

- Framework Compliance Regulasi

- Persyaratan GDPR untuk Operasi EU

- CCPA dan US State Privacy Law

- Regulasi Spesifik Industri

- Regulasi Spesifik AI yang Muncul

- Penilaian Keamanan Vendor

- Pertanyaan Keamanan Critical untuk Setiap Vendor

- Red Flag yang Harus Menghentikan Procurement

- Struktur Governance Internal

- Kebijakan Penggunaan AI

- Panduan Acceptable Use

- Approval Workflow

- Monitoring dan Auditing

- Membangun Budaya AI yang Bertanggung Jawab Melalui Training

- Essensial Program Training

- Delivery Training

- Respons Insiden: Ketika Tool AI Mengekspos Data Sensitif

- Respons Segera (0-24 Jam)

- Investigasi (24-72 Jam)

- Remediasi (72 Jam - 30 Hari)

- Menyeimbangkan Inovasi dengan Risiko

- Resource Terkait