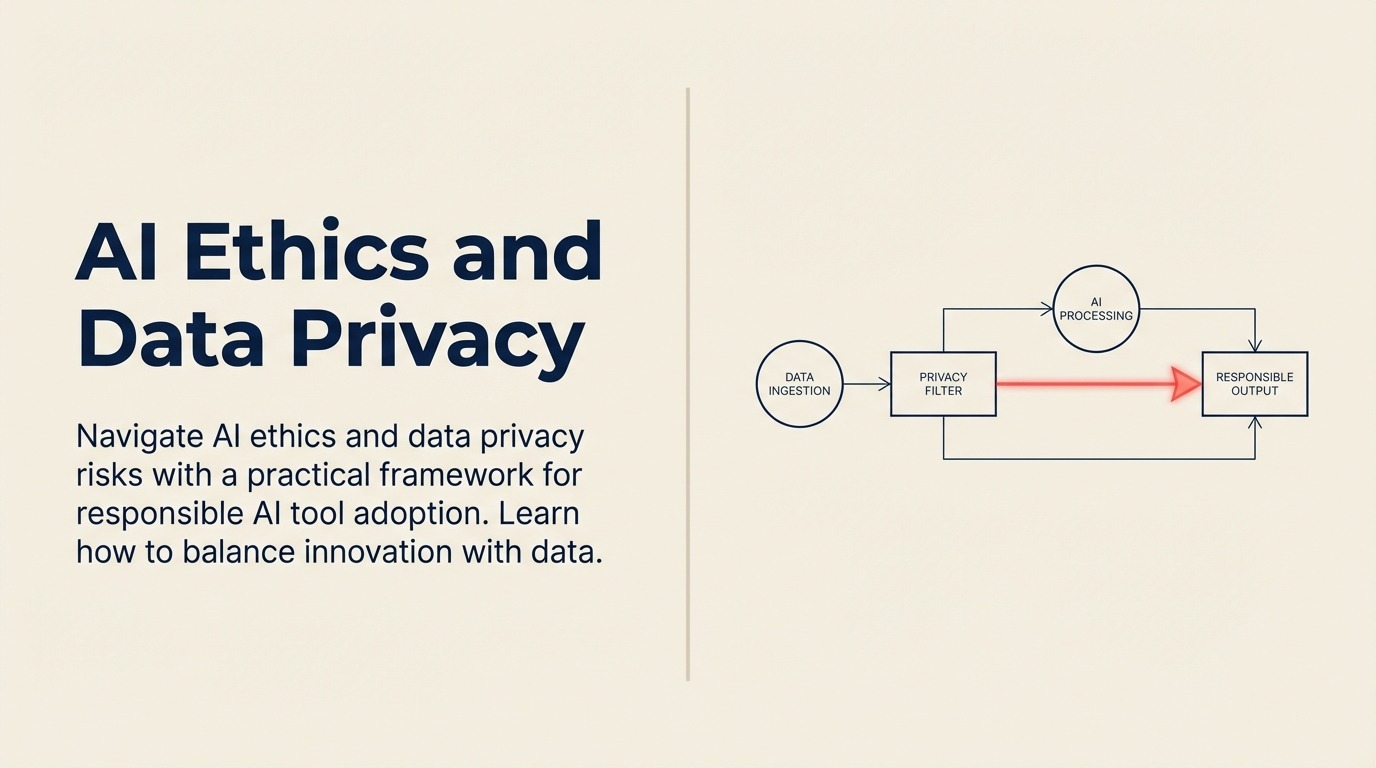

AI Ethics and Data Privacy: Adopción Responsable de AI Productivity Tools

El costo promedio de una brecha de datos relacionada con AI alcanzó $4.3 millones en 2026. Eso es 15% más alto que brechas tradicionales porque las herramientas de AI a menudo tocan datos más sensibles y crean nuevos puntos de exposición que la seguridad tradicional no aborda. Según el IBM's Cost of a Data Breach Report, las organizaciones con prácticas maduras de seguridad de AI experimentan costos de brecha significativamente menores y tiempos de contención más rápidos.

La mayoría de las empresas abordan la adopción de herramientas de AI enfocadas completamente en capacidades y ROI. Evalúan qué pueden hacer las herramientas y qué tiempo ahorrarán. Seguridad y privacidad se convierten en reflexiones posteriores, casillas para marcar con legal e IT antes de aprobación final.

Eso está al revés. Para herramientas de AI específicamente, privacidad y ética no son solo requisitos de cumplimiento. Son fundamentales para si las herramientas funcionarán en su entorno y si crearán riesgos que superen su valor. Estas consideraciones deberían ser centrales para su AI tool selection framework desde el primer día.

Las empresas que hacen esto bien construyen programas responsables de AI antes de escalar la adopción de AI. Establecen principios claros, estructuras de gobernanza y políticas que les permiten moverse rápido mientras se mantienen seguras.

Principios Éticos Centrales para Business AI

Antes de sumergirse en riesgos y controles específicos, entienda los cuatro principios éticos que deberían guiar todas las decisiones de herramientas de AI. Estos no son filosofía abstracta, son guías prácticas que previenen problemas.

Principio 1: Transparency and Explainability

Los usuarios deben entender cuándo están interactuando con AI y qué está haciendo la AI con sus datos. Los ejecutivos deben entender cómo las herramientas de AI toman decisiones que afectan resultados empresariales.

Esto no significa explicar cada algoritmo. Significa:

- Divulgar cuándo el contenido es generado por AI

- Explicar qué datos usa la AI

- Proporcionar razonamiento para recomendaciones de AI

- Reconocer incertidumbre en outputs de AI

Por qué importa: Un equipo de marketing usó AI content generation tools para crear emails de cliente sin divulgación. Los destinatarios se sintieron engañados cuando se dieron cuenta de que los mensajes de apariencia personal eran automatizados. La reacción resultante costó más de lo que la herramienta ahorró.

Principio 2: Fairness and Bias Mitigation

Las herramientas de AI aprenden de datos, y los datos reflejan sesgos históricos. Las herramientas pueden perpetuar o amplificar discriminación en contratación, préstamos, servicio al cliente y otros procesos empresariales.

Lo que requiere Fairness:

- Auditar outputs de AI para disparidades demográficas

- Probar herramientas con conjuntos de datos diversos

- Monitorear drift en comportamiento de AI con el tiempo

- Tener humanos revisando decisiones de alto riesgo

Ejemplo real: Una herramienta de reclutamiento entrenada con datos históricos de contratación dio puntajes más bajos a candidatos de ciertas universidades porque contrataciones pasadas de esas escuelas tenían mayor desgaste. La herramienta no estaba sesgada contra esas escuelas, estaba aprendiendo una correlación que no era causal. Pero el efecto fue discriminatorio independientemente de la intención.

Principio 3: Privacy and Data Protection

Las herramientas de AI a menudo necesitan acceso a datos empresariales y de clientes sensibles para funcionar efectivamente. Ese acceso crea riesgo que debe gestionarse deliberadamente.

Requisitos de privacidad:

- Minimizar recolección de datos a lo que realmente se necesita

- Proteger datos en tránsito y en reposo

- Controlar quién puede acceder a qué datos

- Permitir eliminación cuando retención de datos no es requerida

- Obtener consentimiento apropiado para uso de datos

Principio 4: Accountability and Governance

Alguien debe ser responsable de cómo se usan las herramientas de AI y qué resultados producen. La accountability no puede difundirse al "algoritmo."

Governance essentials:

- Ownership claro para decisiones de herramientas de AI

- Procesos de aprobación para nuevas herramientas y casos de uso

- Auditorías regulares de uso de herramientas de AI y resultados

- Planes de respuesta a incidentes para cuando las cosas van mal

- Documentación de decisiones y fundamento

Riesgos de Data Privacy Específicos a Herramientas de AI

Las herramientas de AI crean riesgos de privacidad que el software tradicional no. Entender estos riesgos le ayuda a evaluarlos y mitigarlos antes de que se conviertan en brechas.

Riesgo 1: Training Data Exposure

Algunos modelos de AI recuerdan ejemplos específicos de sus datos de entrenamiento. Si información sensible estaba en esos datos de entrenamiento, podría exponerse a través de consultas cuidadosamente elaboradas.

El problema: Un equipo legal usó un asistente de investigación de AI entrenado con millones de documentos. Una parte externa descubrió que podían extraer información confidencial de cliente de documentos de caso que eran parte del conjunto de entrenamiento.

Mitigación:

- Usar herramientas de AI que garanticen segregación de datos

- Preferir herramientas entrenadas solo con datos públicos o licenciados

- Nunca ingresar datos altamente sensibles en herramientas de AI públicas

- Auditar qué datos usan vendors para entrenamiento

Riesgo 2: Prompt Leakage and Data Retention

Cuando envía un prompt a una herramienta de AI, ¿adónde van esos datos? ¿Cuánto tiempo se almacenan? ¿Quién puede acceder a ellos? Muchos usuarios no se dan cuenta de que sus prompts se registran y retienen.

El problema: Los sales reps usaron una herramienta de AI pública para redactar propuestas de cliente, incluyendo estrategia de precios e información confidencial de cliente. El vendor retuvo todos los prompts para mejora de modelo. Los competidores usando la misma herramienta potencialmente podrían acceder a patrones de esos prompts.

Mitigación:

- Revisar políticas de retención de datos antes de adopción

- Usar versiones empresariales con privacidad de datos garantizada

- Implementar herramientas DLP para detectar datos sensibles en prompts

- Entrenar usuarios sobre qué datos es seguro compartir con herramientas de AI

Riesgo 3: Third-Party Model Risks

Muchas herramientas de AI usan modelos subyacentes de terceros (OpenAI, Anthropic, Google). Sus datos pasan por múltiples sistemas, cada uno con su propia postura de seguridad.

El problema: Una firma de servicios financieros usó un asistente de escritura de AI que dependía de una API de terceros. El proveedor de API tuvo un incidente de seguridad. Aunque el vendor del asistente de escritura tenía seguridad fuerte, los datos de cliente se expusieron a través del proveedor de modelo.

Mitigación:

- Mapear flujo completo de datos incluyendo todos los terceros

- Evaluar seguridad de cadena completa, no solo vendor directo

- Usar acuerdos empresariales con protecciones contractuales

- Considerar deployments on-premise o private cloud para casos de uso sensibles

Riesgo 4: Cross-Border Data Transfer

El procesamiento de modelos de AI a menudo ocurre en centros de datos centralizados, frecuentemente en Estados Unidos. Esto crea problemas de cumplimiento para empresas operando bajo GDPR, CCPA o regulaciones específicas de industria.

El problema: Una empresa europea usó una herramienta de servicio al cliente de AI. Los datos personales de cliente se procesaron en servidores de Estados Unidos. Esto violó requisitos de residencia de datos de GDPR, resultando en acción regulatoria y multas.

Mitigación:

- Verificar dónde se procesan datos, no solo dónde se almacenan

- Usar herramientas con centros de datos regionales cuando se requiere

- Implementar Standard Contractual Clauses o protecciones equivalentes

- Realizar Data Protection Impact Assessments para procesamiento de alto riesgo

Marco de Cumplimiento Regulatorio

La adopción de herramientas de AI no es opcional, es competitivamente necesaria. Pero debe ocurrir dentro de límites regulatorios que están evolucionando rápidamente.

GDPR Requirements for EU Operations

El General Data Protection Regulation (GDPR) se aplica a cualquier empresa que procese datos personales de residentes de la UE. Requisitos clave para herramientas de AI:

Lawful Basis for Processing: Necesita una base legal para procesar datos personales con herramientas de AI. El interés legítimo a menudo funciona para herramientas de productividad de empleados. La AI orientada al cliente usualmente requiere consentimiento o necesidad contractual.

Data Minimization: Solo procese datos que sean necesarios para el propósito específico. No alimente bases de datos completas de cliente en herramientas de AI cuando solo necesita campos específicos.

Right to Explanation: Cuando la AI toma decisiones que afectan significativamente a individuos (contratación, crédito, healthcare), debe poder explicar cómo se tomó la decisión.

Data Subject Rights: Los individuos pueden solicitar copias de sus datos, correcciones o eliminación. Sus herramientas de AI deben soportar estos derechos, lo cual puede ser difícil si los datos están incrustados en conjuntos de entrenamiento.

CCPA and US State Privacy Laws

El California Consumer Privacy Act y leyes similares en otros estados crean requisitos para negocios manejando datos de residentes de California:

Disclosure Requirements: Debe divulgar qué información personal recolecta y cómo se usa. Esto incluye propósitos de procesamiento de AI.

Opt-Out Rights: Los consumidores pueden optar por no tener sus datos vendidos o compartidos. Algunas interpretaciones consideran el entrenamiento de modelos de AI como "compartir" datos.

Automated Decision-Making: Los residentes de California tienen derecho a optar por no participar en perfiles automatizados que produzcan efectos legales o similarmente significativos.

Industry-Specific Regulations

Ciertas industrias enfrentan requisitos adicionales relacionados con AI:

HIPAA (Healthcare): La información de salud protegida solo puede ser procesada por Business Associates con acuerdos apropiados. La mayoría de las herramientas de AI públicas no califican. Las herramientas de AI para healthcare deben ser específicamente conformes con HIPAA.

FINRA and Banking Regulations: La AI de servicios financieros debe cumplir requisitos de recordkeeping y supervisión. Todas las comunicaciones generadas por AI deben registrarse y ser revisables.

SOX (Public Companies): Las herramientas de AI que afectan reportes financieros deben tener controles apropiados. Deben existir audit trails para datos financieros generados por AI.

Emerging AI-Specific Regulations

Los gobiernos a nivel mundial están desarrollando regulaciones específicas de AI:

EU AI Act: Crea categorías de riesgo para sistemas de AI con requisitos más estrictos para aplicaciones de alto riesgo (contratación, decisiones de crédito, aplicación de la ley). La mayoría de la AI de productividad cae en categorías de menor riesgo pero aún enfrenta requisitos de transparencia. Aprenda más en la European Commission's AI Act page.

US Executive Order on AI: Establece estándares de seguridad para sistemas de AI, particularmente alrededor de técnicas de preservación de privacidad y resultados discriminatorios.

State-Level AI Laws: Varios estados de Estados Unidos han aprobado o están considerando leyes específicas de AI que abordan discriminación algorítmica, transparencia y accountability.

Qué significa esto: El panorama regulatorio está cambiando activamente. Construya programas de cumplimiento que puedan adaptarse en lugar de cumplir solo requisitos actuales. Asegure que su enfoque de AI security and compliance se mantenga actualizado con regulaciones en evolución.

Evaluación de Seguridad de Vendor

No todos los vendors de herramientas de AI tienen posturas de seguridad equivalentes. La evaluación sistemática de vendors previene elegir herramientas que crean riesgo inaceptable.

Preguntas Críticas de Seguridad para Cada Vendor

Data Handling Practices:

- ¿Los datos de cliente están segregados de otros clientes?

- ¿Los datos de cliente alguna vez se usan para entrenar modelos?

- ¿Podemos optar por no usar datos más allá de provisión directa de servicio?

- ¿Cuánto tiempo se retienen los datos?

- ¿Cuál es el proceso para eliminación de datos?

Encryption and Access Controls:

- ¿Los datos están encriptados en tránsito (TLS 1.3 o mejor)?

- ¿Los datos están encriptados en reposo?

- ¿Quién tiene acceso a datos de cliente internamente?

- ¿Cómo se gestionan acceso privilegiado y credenciales?

- ¿Se requiere autenticación multifactor para todo acceso?

Compliance Certifications:

- SOC 2 Type II (controles de seguridad auditados anualmente)

- ISO 27001 (gestión de seguridad de información)

- ISO 27701 (gestión de privacidad)

- Certificaciones específicas de industria (HITRUST para healthcare, PCI DSS para datos de pago)

Security Practices:

- Frecuencia de pruebas de seguridad (penetration tests, vulnerability scans)

- Divulgación de vulnerabilidades y timeline de parcheo

- Auditorías de seguridad de terceros

- Entrenamiento de seguridad para empleados

- Historial de incidentes y respuesta

Data Residency Options:

- ¿Qué regiones geográficas pueden procesar y almacenar datos?

- ¿Podemos especificar requisitos de residencia de datos?

- ¿El vendor usa sub-procesadores en otras regiones?

- ¿Cómo se manejan transferencias cross-border?

Red Flags que Deberían Detener Procurement

Algunas respuestas de vendor deberían terminar la evaluación inmediatamente:

- Negarse a proporcionar documentación de seguridad

- Sin certificación SOC 2 o equivalente

- Historial de incidentes de seguridad no divulgados

- Respuestas vagas sobre derechos de uso de datos

- Sin opción para controles de residencia de datos

- Usar datos de cliente para entrenamiento sin opt-out

Estructura de Gobernanza Interna

La seguridad externa de vendor es necesaria pero insuficiente. La gobernanza interna fuerte previene mal uso incluso de herramientas seguras.

AI Usage Policies

Cada organización necesita políticas claras que cubran:

Approved Use Cases: ¿Para qué pueden usarse herramientas de AI? Las categorías podrían incluir:

- Aprobado: Documentación interna, creación de contenido borrador, análisis de datos

- Requiere aprobación: Contenido orientado al cliente, soporte de decisiones

- Prohibido: Procesamiento de datos confidenciales, tomar decisiones de contratación sin revisión humana

Data Classification:

- ¿Qué datos pueden usarse con herramientas de AI?

- ¿Cómo identifican los usuarios datos sensibles?

- ¿Qué pasa si datos sensibles se ingresan accidentalmente?

Output Validation:

- Todos los outputs de AI deben revisarse antes de uso

- Las decisiones de alto riesgo requieren aprobación humana

- El contenido generado por AI debe divulgarse cuando sea apropiado

Acceptable Use Guidelines

Las políticas establecen límites. Las guidelines ayudan a los usuarios a trabajar efectivamente dentro de ellos.

Buenos ejemplos:

- Use AI para brainstorming y primeros borradores

- Cite cuando use AI para generar contenido

- Revise outputs de AI para precisión y sesgo

- Reporte preocupaciones sobre comportamiento de herramientas de AI

Malos ejemplos:

- No pegue contratos de cliente en herramientas de AI públicas

- No trate recomendaciones de AI como autoritarias sin verificación

- No use AI para tomar decisiones finales sobre contratación o evaluaciones de desempeño

- No comparta credenciales de herramientas de AI o outputs con partes no autorizadas

Approval Workflows

No toda adopción de herramientas de AI debería requerir el mismo nivel de aprobación:

Low Risk (Manager Approval):

- Herramientas usadas solo para trabajo interno

- Procesamiento de datos no sensibles

- Vendors bien establecidos con seguridad fuerte

Medium Risk (IT + Legal Approval):

- Herramientas procesando datos de cliente

- Integración con sistemas core del negocio

- Vendors nuevos sin historiales extensos

High Risk (Executive + Committee Approval):

- Herramientas haciendo o influyendo decisiones sobre personas

- Procesamiento de datos altamente sensibles o regulados

- Casos de uso novedosos sin precedente de industria

Monitoring and Auditing

Las políticas no se hacen cumplir solas. El monitoreo regular detecta problemas temprano:

Qué monitorear:

- Qué herramientas de AI se están usando (detección de shadow IT)

- Qué datos se están enviando a herramientas de AI (alertas DLP)

- Qué tan frecuentemente se usan herramientas y por quién

- Tickets de soporte y reportes de incidentes relacionados con herramientas de AI

Rastree estas métricas junto con sus AI productivity ROI metrics más amplias para asegurar que la gobernanza no obstaculice la entrega de valor.

Audit Activities:

- Revisiones trimestrales de inventario de herramientas de AI

- Reevaluación anual de seguridad de vendor

- Muestreo aleatorio de outputs generados por AI para calidad y cumplimiento

- Encuestas de usuario sobre comprensión de políticas

Construir Cultura Responsable de AI a Través de Entrenamiento

Las mejores políticas fallan si los empleados no las entienden o por qué importan. El entrenamiento convierte el cumplimiento de una casilla en una capacidad.

Training Program Essentials

Para todos los empleados:

- Qué herramientas de AI están aprobadas y cómo usarlas

- Qué datos pueden y no pueden usarse con AI

- Cómo reconocer y reportar problemas

- Por qué la ética y privacidad de AI importan

Para Power Users:

- Prompt engineering avanzado dentro de límites de política

- Evaluación de calidad de output

- Detección y mitigación de sesgo

- Cuándo escalar preocupaciones

Para Managers:

- Aprobar solicitudes apropiadas de herramientas de AI

- Monitorear uso de equipo para cumplimiento

- Apoyar empleados en uso responsable

- Modelar buenos comportamientos de uso de AI

Para Executives:

- Panorama de riesgo de AI y estrategias de mitigación

- Requisitos de gobernanza y accountability

- Decisiones estratégicas de AI equilibrando oportunidad y riesgo

- Reportes y supervisión de AI a nivel de junta

Training Delivery

El entrenamiento único no funciona. El entrenamiento efectivo de ética de AI es continuo:

- Módulo inicial de onboarding (30-45 minutos)

- Refreshers trimestrales sobre nuevas políticas o herramientas (15 minutos)

- Orientación just-in-time al adoptar nuevas herramientas

- Ejemplos y casos de estudio de su propia organización

- Materiales de referencia de fácil acceso y árboles de decisión

Respuesta a Incidentes: Cuando las Herramientas de AI Exponen Datos Sensibles

A pesar de mejores esfuerzos, ocurrirán incidentes. La calidad de respuesta determina si un incidente se convierte en crisis.

Respuesta Inmediata (0-24 Horas)

Contener la exposición:

- Deshabilitar acceso a herramienta de AI afectada si es necesario

- Identificar qué datos fueron expuestos

- Determinar alcance de exposición (quién lo vio, adónde fue)

Notificar stakeholders:

- Informar equipos internos legales y de cumplimiento

- Alertar unidades de negocio afectadas

- Preparar comunicación para individuos afectados si se requiere

Preservar evidencia:

- Archivos de registro y audit trails

- Capturas de pantalla de outputs problemáticos

- Timeline de eventos y acciones tomadas

Investigación (24-72 Horas)

Root Cause Analysis:

- ¿Cómo ocurrió el incidente?

- ¿Qué controles fallaron o fueron evadidos?

- ¿Se violaron políticas o las políticas fueron insuficientes?

Impact Assessment:

- ¿Cuántos individuos afectados?

- ¿Qué nivel de sensibilidad de datos fue expuesto?

- ¿Cuáles son daños potenciales a individuos afectados?

- ¿Cuáles son obligaciones regulatorias?

Vendor Coordination:

- Notificar vendor de herramienta de AI

- Solicitar su investigación y remediación

- Determinar si el incidente afectó a otros clientes

Remediación (72 Horas - 30 Días)

Correcciones inmediatas:

- Implementar controles para prevenir recurrencia

- Actualizar políticas si se identificaron gaps

- Reentrenar usuarios si ocurrieron violaciones de política

Respuesta regulatoria:

- Presentar notificaciones de brecha requeridas (a menudo 72 horas bajo GDPR)

- Responder a consultas regulatorias

- Documentar pasos de remediación

Mejoras a largo plazo:

- Actualizar requisitos de seguridad de vendor

- Mejorar monitoreo y detección

- Revisar programas de entrenamiento

- Considerar si la herramienta debería permanecer aprobada

Equilibrar Innovación con Riesgo

El objetivo no es cero riesgo. Es toma de riesgo inteligente que captura valor de AI mientras protege lo que importa.

Comience con casos de uso de bajo riesgo: Comience con herramientas de AI para productividad interna donde el impacto de exposición de datos es limitado. Construya confianza y capacidad antes de expandir a casos de uso orientados al cliente o de alta sensibilidad.

Layer Defenses: No confíe solo en política. Combine controles técnicos (DLP, gestión de acceso), seguridad de vendor, entrenamiento de usuario y monitoreo para defensa en profundidad.

Review and Adapt: Trate su programa de gobernanza de AI como un producto que mejora con el tiempo. Las revisiones regulares detectan riesgos emergentes y oportunidades para optimizar sin comprometer protección.

Communicate the Why: Las personas siguen políticas que entienden y con las que están de acuerdo. Explique las razones empresariales y éticas detrás de la gobernanza de AI, no solo las reglas.

Recursos Relacionados

Continúe construyendo su programa responsable de AI:

- AI Tool Selection Framework - Incorporar seguridad en selección de herramientas

- AI Security and Compliance - Deep dive en controles técnicos

- AI Training and Onboarding - Construir capacidad de usuario

- Building an AI-First Culture - Enfoque de transformación cultural

Las empresas liderando en AI no son las adoptantes más agresivas. Son las que descubrieron cómo moverse rápido mientras se mantienen seguras. Eso no es un problema tecnológico, es un problema de gobernanza. Haga bien la gobernanza, y puede adoptar AI con confianza.

Senior Operations & Growth Strategist

On this page

- Principios Éticos Centrales para Business AI

- Principio 1: Transparency and Explainability

- Principio 2: Fairness and Bias Mitigation

- Principio 3: Privacy and Data Protection

- Principio 4: Accountability and Governance

- Riesgos de Data Privacy Específicos a Herramientas de AI

- Riesgo 1: Training Data Exposure

- Riesgo 2: Prompt Leakage and Data Retention

- Riesgo 3: Third-Party Model Risks

- Riesgo 4: Cross-Border Data Transfer

- Marco de Cumplimiento Regulatorio

- GDPR Requirements for EU Operations

- CCPA and US State Privacy Laws

- Industry-Specific Regulations

- Emerging AI-Specific Regulations

- Evaluación de Seguridad de Vendor

- Preguntas Críticas de Seguridad para Cada Vendor

- Red Flags que Deberían Detener Procurement

- Estructura de Gobernanza Interna

- AI Usage Policies

- Acceptable Use Guidelines

- Approval Workflows

- Monitoring and Auditing

- Construir Cultura Responsable de AI a Través de Entrenamiento

- Training Program Essentials

- Training Delivery

- Respuesta a Incidentes: Cuando las Herramientas de AI Exponen Datos Sensibles

- Respuesta Inmediata (0-24 Horas)

- Investigación (24-72 Horas)

- Remediación (72 Horas - 30 Días)

- Equilibrar Innovación con Riesgo

- Recursos Relacionados