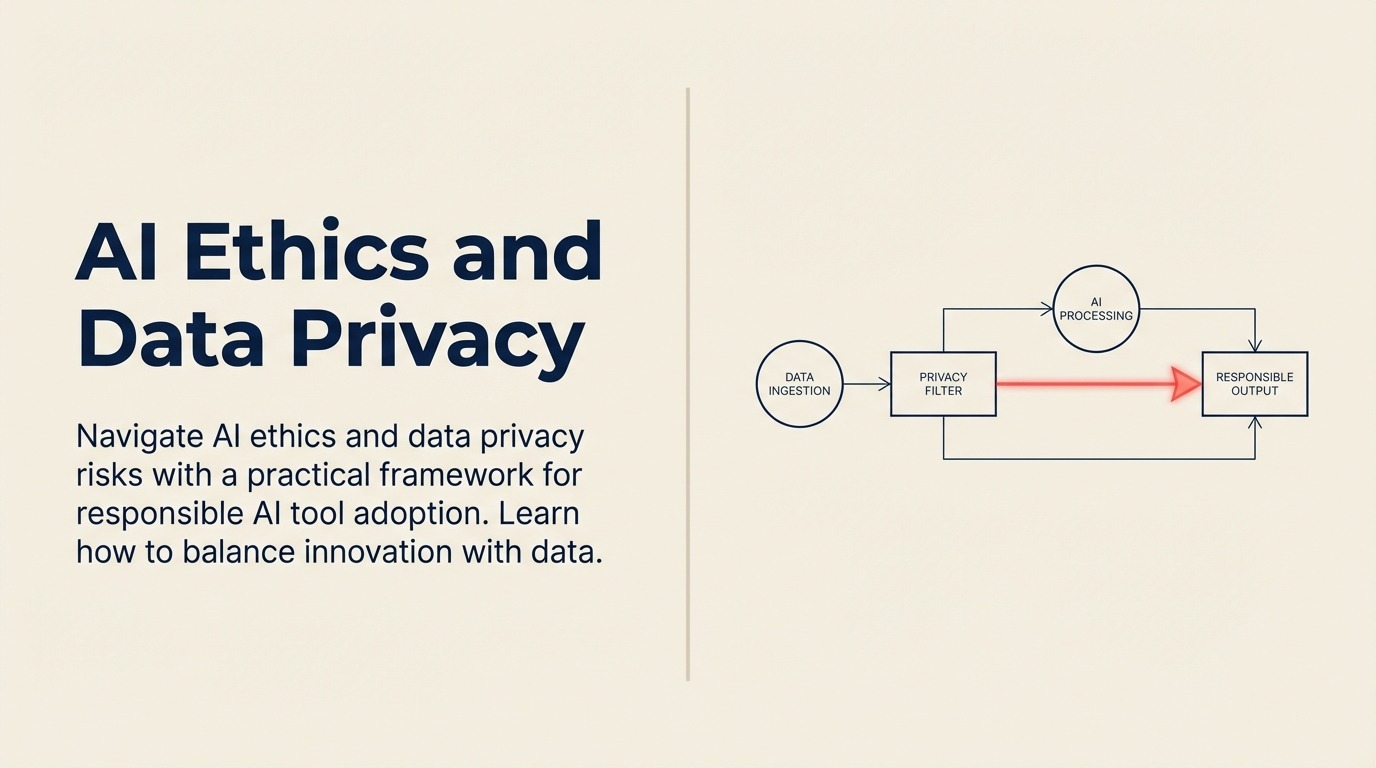

AIの倫理とデータプライバシー:責任あるAI生産性ツールの導入

2026年におけるAI関連のデータ侵害の平均コストは430万ドルに達しました。これは従来の侵害より15%高く、AIツールがより機密性の高いデータに触れ、従来のセキュリティが対処できない新しい露出ポイントを生み出すためです。IBMのデータ侵害コストレポートによると、成熟したAIセキュリティ実践を持つ組織は、侵害コストが大幅に低く、封じ込め時間も短くなっています。

ほとんどの企業は、機能とROIに完全に焦点を当ててAIツールの導入にアプローチします。ツールができることと、どれだけの時間を節約できるかを評価します。セキュリティとプライバシーは後回しになり、最終承認前に法務部門とIT部門でチェックする項目になります。

これは逆です。特にAIツールの場合、プライバシーと倫理は単なるコンプライアンス要件ではありません。ツールがあなたの環境で機能するかどうか、そしてツールがその価値を上回るリスクを生み出すかどうかの基本です。これらの考慮事項は、最初からAIツール選択フレームワークの中心に置かれるべきです。

これを正しく理解している企業は、AI導入を拡大する前に責任あるAIプログラムを構築します。彼らは明確な原則、ガバナンス構造、およびポリシーを確立し、安全を維持しながら迅速に動けるようにします。

ビジネスAIの核となる倫理原則

特定のリスクとコントロールに入る前に、すべてのAIツールの決定を導くべき4つの倫理原則を理解してください。これらは抽象的な哲学ではありません。問題を防ぐ実用的な指針です。

原則1:透明性と説明可能性

ユーザーはAIと対話していることと、AIがデータで何をしているかを理解する必要があります。経営幹部は、AIツールがビジネス成果に影響を与える決定をどのように行うかを理解する必要があります。

これはすべてのアルゴリズムを説明することを意味しません。次のことを意味します:

- コンテンツがAI生成であることを開示する

- AIが使用するデータを説明する

- AI推奨の理由を提供する

- AI出力の不確実性を認める

なぜ重要か: マーケティングチームが開示なしに顧客メールを作成するためにAIコンテンツ生成ツールを使用しました。受信者は、個人的に見えるメッセージが自動化されていることに気付いたとき、だまされたと感じました。その結果生じた反発は、ツールが節約した以上のコストがかかりました。

原則2:公平性とバイアス軽減

AIツールはデータから学習し、データは歴史的なバイアスを反映します。ツールは、採用、融資、カスタマーサービス、その他のビジネスプロセスにおける差別を永続化または増幅させる可能性があります。

公平性が要求すること:

- AI出力の人口統計的格差を監査する

- 多様なデータセットでツールをテストする

- 時間の経過に伴うAI動作のドリフトを監視する

- 重要な決定を人間がレビューする

実例: 歴史的な採用データで訓練された採用ツールが、特定の大学出身の候補者に低いスコアを与えました。それらの学校出身の過去の採用者がより高い離職率を持っていたためです。ツールはそれらの学校に対して偏見を持っていたわけではありません。因果関係のない相関関係を学習していました。しかし、意図に関係なく、効果は差別的でした。

原則3:プライバシーとデータ保護

AIツールは効果的に機能するために、機密性の高いビジネスおよび顧客データへのアクセスを必要とすることがよくあります。そのアクセスは意図的に管理されなければならないリスクを生み出します。

プライバシー要件:

- データ収集を実際に必要なものに最小限に抑える

- 転送中および保存中のデータを保護する

- 誰が何のデータにアクセスできるかを制御する

- データ保持が必要でない場合は削除を可能にする

- データ使用のための適切な同意を得る

原則4:説明責任とガバナンス

AIツールの使用方法とそれが生み出す結果に対して、誰かが責任を負わなければなりません。説明責任は「アルゴリズム」に分散できません。

ガバナンスの本質:

- AIツール決定の明確な所有権

- 新しいツールとユースケースの承認プロセス

- AIツールの使用と結果の定期的な監査

- 問題が発生した場合のインシデント対応計画

- 決定と根拠の文書化

AIツール特有のデータプライバシーリスク

AIツールは従来のソフトウェアにはないプライバシーリスクを生み出します。これらのリスクを理解することで、それらが侵害になる前に評価し軽減することができます。

リスク1:トレーニングデータの露出

一部のAIモデルは、トレーニングデータからの特定の例を記憶します。機密情報がそのトレーニングデータに含まれていた場合、注意深く作成されたクエリを通じて露出される可能性があります。

問題: 法務チームが数百万の文書で訓練されたAIリサーチアシスタントを使用しました。外部関係者が、トレーニングセットの一部であったケース文書から機密の顧客情報を抽出できることを発見しました。

軽減策:

- データ分離を保証するAIツールを使用する

- 公開またはライセンスデータのみで訓練されたツールを優先する

- 高度に機密性の高いデータを公開AIツールに入力しない

- ベンダーがトレーニングに使用するデータを監査する

リスク2:プロンプト漏洩とデータ保持

AIツールにプロンプトを送信すると、そのデータはどこに行きますか?どのくらい保存されますか?誰がアクセスできますか?多くのユーザーは、プロンプトがログに記録され保持されていることに気付いていません。

問題: 営業担当者が公開AIツールを使用して顧客提案を作成し、価格戦略と機密の顧客情報を含めました。ベンダーはモデル改善のためにすべてのプロンプトを保持しました。同じツールを使用する競合他社がそれらのプロンプトからパターンにアクセスする可能性がありました。

軽減策:

- 導入前にデータ保持ポリシーをレビューする

- データプライバシーが保証されたビジネスバージョンを使用する

- プロンプト内の機密データを検出するためにDLPツールを実装する

- AIツールと共有しても安全なデータについてユーザーをトレーニングする

リスク3:サードパーティモデルのリスク

多くのAIツールは、サードパーティ(OpenAI、Anthropic、Google)の基礎モデルを使用します。データは複数のシステムを通過し、それぞれが独自のセキュリティ体制を持っています。

問題: 金融サービス会社がサードパーティAPIに依存するAIライティングアシスタントを使用しました。APIプロバイダーがセキュリティインシデントを起こしました。ライティングアシスタントベンダーが強力なセキュリティを持っていたにもかかわらず、顧客データがモデルプロバイダーを通じて露出されました。

軽減策:

- サードパーティを含む完全なデータフローをマッピングする

- 直接ベンダーだけでなく、チェーン全体のセキュリティを評価する

- 契約上の保護を伴うエンタープライズ契約を使用する

- 機密性の高いユースケースにはオンプレミスまたはプライベートクラウドデプロイメントを検討する

リスク4:国境を越えたデータ転送

AIモデル処理は、多くの場合、集中型データセンター、頻繁に米国で行われます。これは、GDPR、CCPA、または業界固有の規制の下で運営される企業にコンプライアンス問題を引き起こします。

問題: 欧州の企業がAIカスタマーサービスツールを使用しました。顧客の個人データは米国のサーバーで処理されました。これはGDPRのデータ居住要件に違反し、規制措置と罰金を招きました。

軽減策:

- データが保存される場所だけでなく、処理される場所を確認する

- 必要に応じて地域データセンターを持つツールを使用する

- 標準契約条項または同等の保護を実装する

- 高リスク処理のためのデータ保護影響評価を実施する

規制コンプライアンスフレームワーク

AIツールの導入はオプションではありません。競争上必要です。しかし、急速に進化している規制の境界内で行われなければなりません。

EU運営のためのGDPR要件

一般データ保護規則(GDPR)は、EU居住者の個人データを処理するすべての企業に適用されます。AIツールの主要な要件:

処理の合法的根拠: AIツールで個人データを処理するための法的根拠が必要です。従業員生産性ツールには正当な利益がしばしば機能します。顧客向けAIには通常、同意または契約上の必要性が必要です。

データ最小化: 特定の目的に必要なデータのみを処理します。特定のフィールドのみが必要な場合、顧客データベース全体をAIツールにフィードしないでください。

説明する権利: AIが個人に大きな影響を与える決定(採用、信用、医療)を行う場合、決定がどのように行われたかを説明できなければなりません。

データ主体の権利: 個人は、自分のデータのコピー、訂正、または削除を要求できます。AIツールはこれらの権利をサポートしなければなりません。これは、データがトレーニングセットに埋め込まれている場合、困難な場合があります。

CCPAと米国州のプライバシー法

カリフォルニア消費者プライバシー法および他の州の同様の法律は、カリフォルニア居住者のデータを処理する企業に要件を作成します:

開示要件: 収集する個人情報とその使用方法を開示する必要があります。これにはAI処理目的が含まれます。

オプトアウト権: 消費者は、自分のデータが販売または共有されることをオプトアウトできます。一部の解釈では、AIモデルトレーニングをデータの「共有」と見なします。

自動意思決定: カリフォルニア居住者は、法的または同様に重大な影響を生み出す自動プロファイリングをオプトアウトする権利があります。

業界固有の規制

特定の業界はAI関連の追加要件に直面します:

HIPAA(医療): 保護された健康情報は、適切な契約を持つビジネスアソシエイトによってのみ処理できます。ほとんどの公開AIツールは資格がありません。医療AIツールは特にHIPAAに準拠している必要があります。

FINRAと銀行規制: 金融サービスAIは記録管理と監督要件を満たさなければなりません。すべてのAI生成通信はログに記録され、レビュー可能でなければなりません。

SOX(上場企業): 財務報告に影響を与えるAIツールには適切な管理が必要です。AI生成の財務データの監査証跡が存在しなければなりません。

新興AI特有の規制

世界中の政府がAI特有の規制を開発しています:

EU AI法: AIシステムのリスクカテゴリを作成し、高リスクアプリケーション(採用、信用決定、法執行)に厳格な要件を設けます。ほとんどの生産性AIは低リスクカテゴリに該当しますが、依然として透明性要件に直面します。詳細は欧州委員会のAI法ページをご覧ください。

米国AIに関する大統領令: 特にプライバシー保護技術と差別的結果に関して、AIシステムの安全性とセキュリティ基準を確立します。

州レベルのAI法: いくつかの米国の州が、アルゴリズムの差別、透明性、説明責任に対処するAI特有の法律を可決したか、検討しています。

これが意味すること: 規制の状況は積極的に変化しています。現在の要件のみを満たすのではなく、適応できるコンプライアンスプログラムを構築してください。AIセキュリティとコンプライアンスアプローチが進化する規制に対応し続けることを確認してください。

ベンダーセキュリティ評価

すべてのAIツールベンダーが同等のセキュリティ体制を持っているわけではありません。体系的なベンダー評価により、受け入れられないリスクを生み出すツールを選択することを防ぎます。

すべてのベンダーへの重要なセキュリティ質問

データ処理プラクティス:

- 顧客データは他の顧客から分離されていますか?

- 顧客データはモデルのトレーニングに使用されますか?

- 直接サービス提供を超えたデータ使用をオプトアウトできますか?

- データはどのくらい保持されますか?

- データ削除のプロセスは何ですか?

暗号化とアクセス制御:

- 転送中のデータは暗号化されていますか(TLS 1.3以上)?

- 保存中のデータは暗号化されていますか?

- 社内で誰が顧客データにアクセスできますか?

- 特権アクセスと認証情報はどのように管理されていますか?

- すべてのアクセスに多要素認証が必要ですか?

コンプライアンス認証:

- SOC 2 Type II(セキュリティ制御が毎年監査される)

- ISO 27001(情報セキュリティ管理)

- ISO 27701(プライバシー管理)

- 業界固有の認証(医療のHITRUST、支払いデータのPCI DSS)

セキュリティプラクティス:

- セキュリティテストの頻度(侵入テスト、脆弱性スキャン)

- 脆弱性開示とパッチ適用のタイムライン

- サードパーティのセキュリティ監査

- 従業員のセキュリティトレーニング

- インシデント履歴と対応

データ居住オプション:

- どの地理的地域がデータを処理および保存できますか?

- データ居住要件を指定できますか?

- ベンダーは他の地域でサブプロセッサを使用していますか?

- 国境を越えた転送はどのように処理されますか?

調達を停止すべき危険信号

一部のベンダー対応は直ちに評価を終了すべきです:

- セキュリティ文書の提供を拒否する

- SOC 2または同等の認証がない

- 未開示のセキュリティインシデントの履歴

- データ使用権に関する曖昧な回答

- データ居住制御のオプションがない

- オプトアウトなしにトレーニングに顧客データを使用する

内部ガバナンス構造

外部ベンダーのセキュリティは必要ですが不十分です。強力な内部ガバナンスは、安全なツールであっても誤用を防ぎます。

AI使用ポリシー

すべての組織には以下をカバーする明確なポリシーが必要です:

承認されたユースケース: AIツールは何に使用できますか?カテゴリには以下が含まれる場合があります:

- 承認済み:内部文書、ドラフトコンテンツ作成、データ分析

- 承認が必要:顧客向けコンテンツ、意思決定サポート

- 禁止:機密データの処理、人間のレビューなしでの採用決定

データ分類:

- AIツールでどのデータを使用できますか?

- ユーザーは機密データをどのように識別しますか?

- 機密データが誤って入力された場合はどうなりますか?

出力検証:

- すべてのAI出力は使用前にレビューされなければなりません

- 重要な決定には人間の承認が必要です

- AI生成コンテンツは適切な場合に開示されなければなりません

許容される使用ガイドライン

ポリシーは境界を設定します。ガイドラインは、ユーザーがそれらの中で効果的に作業するのを助けます。

良い例:

- ブレインストーミングと最初のドラフトにAIを使用する

- コンテンツを生成するためにAIを使用する場合は引用する

- 正確性とバイアスについてAI出力をレビューする

- AIツールの動作に関する懸念を報告する

悪い例:

- 顧客契約を公開AIツールに貼り付けない

- 検証なしでAI推奨を権威あるものとして扱わない

- 採用や業績評価の最終決定にAIを使用しない

- AIツールの認証情報や出力を未承認の関係者と共有しない

承認ワークフロー

すべてのAIツール導入が同じ承認レベルを必要とするわけではありません:

低リスク(マネージャー承認):

- 内部作業にのみ使用されるツール

- 非機密データの処理

- 強力なセキュリティを持つ確立されたベンダー

中リスク(IT+法務承認):

- 顧客データを処理するツール

- コアビジネスシステムとの統合

- 広範な実績のない新しいベンダー

高リスク(エグゼクティブ+委員会承認):

- 人々に関する決定を行うまたは影響を与えるツール

- 高度に機密性の高いまたは規制されたデータの処理

- 業界の前例のない新しいユースケース

監視と監査

ポリシーは自己実施しません。定期的な監視により問題を早期に発見します:

監視すべきもの:

- どのAIツールが使用されているか(シャドウIT検出)

- どのデータがAIツールに送信されているか(DLPアラート)

- ツールがどのくらいの頻度で誰によって使用されているか

- AIツールに関連するサポートチケットとインシデントレポート

これらのメトリクスを、ガバナンスが価値提供を妨げないことを確保するために、より広範なAI生産性ROIメトリクスと一緒に追跡します。

監査活動:

- AIツールインベントリの四半期レビュー

- ベンダーセキュリティの年次再評価

- 品質とコンプライアンスのためのAI生成出力のランダムサンプリング

- ポリシーの理解に関するユーザー調査

トレーニングを通じた責任あるAI文化の構築

従業員がポリシーを理解しないか、なぜ重要かを理解しない場合、最良のポリシーは失敗します。トレーニングはコンプライアンスをチェックボックスから能力に変えます。

トレーニングプログラムの必需品

すべての従業員向け:

- 承認されたAIツールとその使用方法

- AIで使用できる、できないデータ

- 問題を認識して報告する方法

- AIの倫理とプライバシーが重要な理由

パワーユーザー向け:

- ポリシー境界内での高度なプロンプトエンジニアリング

- 出力品質評価

- バイアス検出と軽減

- 懸念をエスカレートするタイミング

マネージャー向け:

- 適切なAIツールリクエストの承認

- コンプライアンスのためのチーム使用の監視

- 責任ある使用における従業員のサポート

- 良いAI使用行動のモデル化

エグゼクティブ向け:

- AIリスクの状況と軽減戦略

- ガバナンス要件と説明責任

- 機会とリスクのバランスを取る戦略的AI決定

- 取締役会レベルのAI報告と監督

トレーニング提供

一度限りのトレーニングは機能しません。効果的なAI倫理トレーニングは継続的です:

- 初期オンボーディングモジュール(30-45分)

- 新しいポリシーまたはツールに関する四半期ごとの更新(15分)

- 新しいツールを採用する際のジャストインタイムガイダンス

- 自分の組織からの例とケーススタディ

- アクセスしやすい参考資料と決定ツリー

インシデント対応:AIツールが機密データを露出したとき

最善の努力にもかかわらず、インシデントは発生します。対応の質が、インシデントが危機になるかどうかを決定します。

即座の対応(0-24時間)

露出を封じ込める:

- 必要に応じて影響を受けたAIツールアクセスを無効にする

- どのデータが露出されたかを特定する

- 露出の範囲を決定する(誰がそれを見たか、どこに行ったか)

ステークホルダーに通知:

- 内部の法務およびコンプライアンスチームに通知する

- 影響を受けたビジネスユニットに警告する

- 必要に応じて影響を受けた個人への通信を準備する

証拠を保存:

- ログファイルと監査証跡

- 問題のある出力のスクリーンショット

- イベントと取られた行動のタイムライン

調査(24-72時間)

根本原因分析:

- インシデントはどのように発生しましたか?

- どの制御が失敗したか、または回避されましたか?

- ポリシーが違反されたか、またはポリシーが不十分でしたか?

影響評価:

- 何人の個人が影響を受けましたか?

- どの感度レベルのデータが露出されましたか?

- 影響を受けた個人への潜在的な害は何ですか?

- 規制上の義務は何ですか?

ベンダー調整:

- AIツールベンダーに通知する

- 彼らの調査と修復を要求する

- インシデントが他の顧客に影響を与えたかどうかを判断する

修復(72時間 - 30日)

即座の修正:

- 再発を防ぐための制御を実装する

- ギャップが特定された場合はポリシーを更新する

- ポリシー違反が発生した場合はユーザーを再トレーニングする

規制対応:

- 必要な侵害通知を提出する(GDPRの下では多くの場合72時間)

- 規制上の照会に対応する

- 修復ステップを文書化する

長期的改善:

- ベンダーセキュリティ要件を更新する

- 監視と検出を強化する

- トレーニングプログラムを改訂する

- ツールが承認されたままであるべきかどうかを検討する

イノベーションとリスクのバランス

目標はゼロリスクではありません。重要なものを保護しながらAIの価値を獲得するインテリジェントなリスクテイキングです。

低リスクのユースケースから始める: データ露出の影響が限定的な内部生産性のためのAIツールから始めます。顧客向けまたは高感度のユースケースに拡大する前に、信頼と能力を構築します。

防御を重ねる: ポリシーだけに依存しないでください。技術的制御(DLP、アクセス管理)、ベンダーセキュリティ、ユーザートレーニング、および監視を組み合わせて、深層防御を行います。

レビューと適応: AIガバナンスプログラムを、時間の経過とともに改善される製品として扱います。定期的なレビューにより、新たなリスクと保護を損なうことなく合理化する機会を捉えます。

理由を伝える: 人々は理解し同意するポリシーに従います。ルールだけでなく、AIガバナンスの背後にあるビジネス上および倫理的な理由を説明します。

関連リソース

責任あるAIプログラムの構築を続けます:

- AIツール選択フレームワーク - ツール選択にセキュリティを組み込む

- AIセキュリティとコンプライアンス - 技術的制御の詳細

- AIトレーニングとオンボーディング - ユーザー能力の構築

- AI優先文化の構築 - 文化的変革アプローチ

AIでリードしている企業は、最も積極的な採用者ではありません。安全を維持しながら迅速に動く方法を理解した企業です。それはテクノロジーの問題ではありません。ガバナンスの問題です。ガバナンスを正しく行えば、自信を持ってAIを採用できます。

Senior Operations & Growth Strategist

On this page

- ビジネスAIの核となる倫理原則

- 原則1:透明性と説明可能性

- 原則2:公平性とバイアス軽減

- 原則3:プライバシーとデータ保護

- 原則4:説明責任とガバナンス

- AIツール特有のデータプライバシーリスク

- リスク1:トレーニングデータの露出

- リスク2:プロンプト漏洩とデータ保持

- リスク3:サードパーティモデルのリスク

- リスク4:国境を越えたデータ転送

- 規制コンプライアンスフレームワーク

- EU運営のためのGDPR要件

- CCPAと米国州のプライバシー法

- 業界固有の規制

- 新興AI特有の規制

- ベンダーセキュリティ評価

- すべてのベンダーへの重要なセキュリティ質問

- 調達を停止すべき危険信号

- 内部ガバナンス構造

- AI使用ポリシー

- 許容される使用ガイドライン

- 承認ワークフロー

- 監視と監査

- トレーニングを通じた責任あるAI文化の構築

- トレーニングプログラムの必需品

- トレーニング提供

- インシデント対応:AIツールが機密データを露出したとき

- 即座の対応(0-24時間)

- 調査(24-72時間)

- 修復(72時間 - 30日)

- イノベーションとリスクのバランス

- 関連リソース