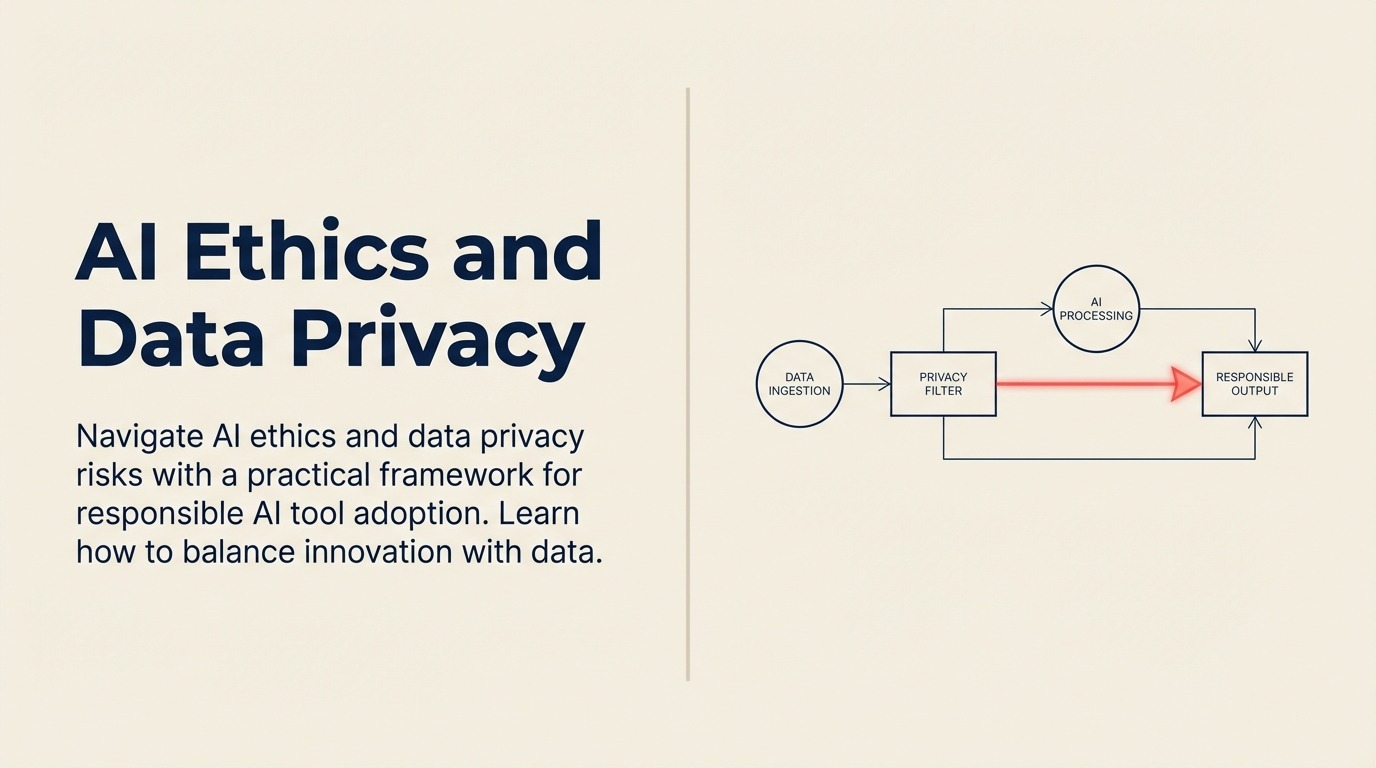

AI Ethics dan Data Privacy: Penggunaan Tool AI Productivity yang Bertanggungjawab

Purata kos AI-related data breach mencecah $4.3 juta pada tahun 2026. Itu 15% lebih tinggi daripada breach tradisional kerana tool AI sering menyentuh data yang lebih sensitif dan mencipta titik pendedahan baru yang security tradisional tidak tangani. Menurut IBM's Cost of a Data Breach Report, organisasi dengan amalan AI security yang matang mengalami kos breach yang jauh lebih rendah dan masa containment yang lebih pantas.

Kebanyakan syarikat mendekati penggunaan tool AI fokus sepenuhnya pada keupayaan dan ROI. Mereka menilai apa yang tool boleh lakukan dan masa yang akan mereka jimat. Security dan privacy menjadi afterthought - kotak untuk ditanda dengan legal dan IT sebelum kelulusan akhir.

Itu terbalik. Untuk tool AI khususnya, privacy dan ethics bukan sekadar compliance requirement. Ia adalah fundamental kepada sama ada tool akan berfungsi dalam persekitaran anda dan sama ada ia akan mencipta risiko yang mengatasi valuenya. Pertimbangan ini sepatutnya menjadi pusat kepada AI tool selection framework anda dari hari pertama.

Syarikat yang melakukan ini dengan betul membina program AI yang bertanggungjawab sebelum mereka scale penggunaan AI. Mereka menubuhkan prinsip yang jelas, struktur governance, dan policy yang membolehkan mereka bergerak pantas sambil kekal selamat.

Prinsip Ethical Teras untuk Business AI

Sebelum menyelami risiko dan kawalan khusus, fahami empat prinsip ethical yang sepatutnya membimbing semua keputusan tool AI. Ini bukan falsafah abstrak - ia adalah panduan praktikal yang menghalang masalah.

Prinsip 1: Transparency dan Explainability

Pengguna sepatutnya faham bila mereka berinteraksi dengan AI dan apa yang AI lakukan dengan data mereka. Eksekutif sepatutnya faham bagaimana tool AI membuat keputusan yang mempengaruhi hasil business.

Ini tidak bermakna menjelaskan setiap algorithm. Ia bermakna:

- Mendedahkan bila kandungan adalah AI-generated

- Menjelaskan data apa yang AI gunakan

- Menyediakan reasoning untuk AI recommendation

- Mengakui ketidakpastian dalam AI output

Mengapa Ia Penting: Satu team marketing menggunakan AI content generation tool untuk mencipta customer email tanpa pendedahan. Penerima berasa tertipu apabila mereka sedar mesej yang kelihatan peribadi adalah automated. Backlash yang terhasil kos lebih daripada yang tool jimatkan.

Prinsip 2: Fairness dan Bias Mitigation

Tool AI belajar dari data, dan data mencerminkan bias sejarah. Tool boleh mengekalkan atau menguatkan diskriminasi dalam pengambilan pekerja, pinjaman, customer service, dan proses business lain.

Apa yang Fairness Perlukan:

- Mengaudit AI output untuk perbezaan demografi

- Menguji tool dengan set data yang pelbagai

- Memantau drift dalam tingkah laku AI dari masa ke masa

- Meminta manusia review keputusan high-stake

Contoh Sebenar: Satu recruiting tool yang dilatih dengan historical hiring data memberikan skor lebih rendah kepada calon dari universiti tertentu kerana pengambilan lalu dari sekolah tersebut mempunyai attrition yang lebih tinggi. Tool tidak bias terhadap sekolah tersebut - ia belajar korelasi yang bukan kausal. Tetapi kesannya adalah diskriminasi tanpa mengira niat.

Prinsip 3: Privacy dan Data Protection

Tool AI sering memerlukan akses kepada business dan customer data yang sensitif untuk berfungsi dengan berkesan. Akses itu mencipta risiko yang mesti diurus dengan sengaja.

Privacy Requirement:

- Minimumkan pengumpulan data kepada apa yang sebenarnya diperlukan

- Lindungi data dalam transit dan at rest

- Kawal siapa yang boleh akses data apa

- Enable deletion apabila data retention tidak diperlukan

- Dapatkan consent yang sesuai untuk penggunaan data

Prinsip 4: Accountability dan Governance

Seseorang mesti bertanggungjawab untuk bagaimana tool AI digunakan dan hasil apa yang mereka hasilkan. Accountability tidak boleh dibahagikan kepada "algorithm."

Governance Essential:

- Ownership yang jelas untuk keputusan tool AI

- Proses kelulusan untuk tool dan use case baru

- Audit berkala penggunaan tool AI dan hasil

- Pelan tindak balas insiden apabila perkara tidak kena

- Dokumentasi keputusan dan rationale

Risiko Data Privacy Khusus untuk Tool AI

Tool AI mencipta risiko privacy yang software tradisional tidak. Memahami risiko ini membantu anda menilai dan mengurangkannya sebelum ia menjadi breach.

Risiko 1: Training Data Exposure

Sesetengah model AI mengingati contoh khusus dari training data mereka. Jika maklumat sensitif ada dalam training data itu, ia boleh didedahkan melalui query yang direka dengan teliti.

Masalahnya: Satu legal team menggunakan AI research assistant yang dilatih dengan jutaan dokumen. Pihak luar menemui mereka boleh extract maklumat client confidential dari dokumen kes yang merupakan sebahagian daripada training set.

Mitigation:

- Gunakan tool AI yang jaminkan data segregation

- Utamakan tool yang dilatih hanya dengan public atau licensed data

- Jangan sekali-kali input data yang sangat sensitif ke dalam public AI tool

- Audit data apa yang vendor gunakan untuk training

Risiko 2: Prompt Leakage dan Data Retention

Apabila anda hantar prompt kepada tool AI, ke mana data itu pergi? Berapa lama ia disimpan? Siapa boleh akses ia? Ramai pengguna tidak sedar prompt mereka dilog dan disimpan.

Masalahnya: Sales rep menggunakan public AI tool untuk draft customer proposal, termasuk pricing strategy dan customer information confidential. Vendor menyimpan semua prompt untuk model improvement. Pesaing yang menggunakan tool yang sama berpotensi boleh akses corak dari prompt tersebut.

Mitigation:

- Review data retention policy sebelum penggunaan

- Gunakan business version dengan data privacy yang dijamin

- Implement DLP tool untuk mengesan sensitive data dalam prompt

- Latih pengguna tentang data apa yang selamat untuk dikongsi dengan tool AI

Risiko 3: Third-Party Model Risk

Banyak tool AI menggunakan underlying model dari third party (OpenAI, Anthropic, Google). Data anda melalui pelbagai sistem, setiap satu dengan security posture sendiri.

Masalahnya: Satu firma perkhidmatan kewangan menggunakan AI writing assistant yang bergantung pada third-party API. API provider mengalami security incident. Walaupun vendor writing assistant mempunyai security yang kuat, customer data didedahkan melalui model provider.

Mitigation:

- Petakan complete data flow termasuk semua third party

- Nilai security keseluruhan chain, bukan hanya direct vendor

- Gunakan enterprise agreement dengan contractual protection

- Pertimbangkan deployment on-premise atau private cloud untuk use case sensitif

Risiko 4: Cross-Border Data Transfer

Pemprosesan model AI sering berlaku di data center yang berpusat, kerap di US. Ini mencipta isu compliance untuk syarikat yang beroperasi di bawah GDPR, CCPA, atau peraturan khusus industri.

Masalahnya: Satu syarikat Eropah menggunakan AI customer service tool. Customer personal data diproses di US server. Ini melanggar GDPR data residency requirement, mengakibatkan tindakan regulatory dan denda.

Mitigation:

- Sahkan di mana data diproses, bukan sahaja di mana ia disimpan

- Gunakan tool dengan regional data center apabila diperlukan

- Implement Standard Contractual Clause atau perlindungan setara

- Jalankan Data Protection Impact Assessment untuk pemprosesan high-risk

Framework Regulatory Compliance

Penggunaan tool AI bukan pilihan - ia keperluan kompetitif. Tetapi ia mesti berlaku dalam sempadan regulatory yang berkembang pesat.

Keperluan GDPR untuk Operasi EU

General Data Protection Regulation (GDPR) terpakai kepada mana-mana syarikat yang memproses personal data penduduk EU. Keperluan utama untuk tool AI:

Lawful Basis untuk Processing: Anda memerlukan asas undang-undang untuk memproses personal data dengan tool AI. Legitimate interest sering berfungsi untuk employee productivity tool. AI customer-facing biasanya memerlukan consent atau contractual necessity.

Data Minimization: Hanya proses data yang perlu untuk tujuan khusus. Jangan feed keseluruhan customer database ke dalam tool AI apabila anda hanya perlukan field khusus.

Right to Explanation: Apabila AI membuat keputusan yang mempengaruhi individu secara signifikan (hiring, credit, healthcare), anda mesti boleh menjelaskan bagaimana keputusan dibuat.

Data Subject Right: Individu boleh meminta salinan data mereka, pembetulan, atau deletion. Tool AI anda mesti menyokong hak ini - yang boleh menjadi sukar jika data tertanam dalam training set.

CCPA dan US State Privacy Law

California Consumer Privacy Act dan undang-undang serupa di negeri lain mencipta keperluan untuk business yang mengendalikan data penduduk California:

Disclosure Requirement: Anda mesti dedahkan personal information apa yang anda kumpul dan bagaimana ia digunakan. Ini termasuk tujuan pemprosesan AI.

Opt-Out Right: Pengguna boleh opt out daripada data mereka dijual atau dikongsi. Sesetengah tafsiran menganggap AI model training sebagai "sharing" data.

Automated Decision-Making: Penduduk California mempunyai hak untuk opt out daripada automated profiling yang menghasilkan kesan legal atau signifikan yang serupa.

Industry-Specific Regulation

Industri tertentu menghadapi keperluan AI-related tambahan:

HIPAA (Healthcare): Protected health information hanya boleh diproses oleh Business Associate dengan perjanjian yang sesuai. Kebanyakan public AI tool tidak layak. Healthcare AI tool mesti HIPAA-compliant secara khusus.

FINRA dan Banking Regulation: Financial services AI mesti memenuhi recordkeeping dan supervision requirement. Semua AI-generated communication mesti dilog dan boleh disemak.

SOX (Public Company): Tool AI yang mempengaruhi financial reporting mesti mempunyai kawalan yang sesuai. Audit trail mesti wujud untuk AI-generated financial data.

Emerging AI-Specific Regulation

Kerajaan di seluruh dunia sedang membangunkan peraturan khusus AI:

EU AI Act: Mencipta kategori risiko untuk sistem AI dengan keperluan yang lebih ketat untuk aplikasi high-risk (hiring, credit decision, law enforcement). Kebanyakan productivity AI jatuh ke dalam kategori lower-risk tetapi masih menghadapi transparency requirement. Ketahui lebih lanjut di European Commission's AI Act page.

US Executive Order on AI: Menubuhkan safety dan security standard untuk sistem AI, terutamanya sekitar privacy-preserving technique dan discriminatory outcome.

State-Level AI Law: Beberapa negeri US telah meluluskan atau sedang mempertimbangkan undang-undang khusus AI yang menangani algorithmic discrimination, transparency, dan accountability.

Apa Maksudnya: Landskap regulatory sedang aktif berubah. Bina program compliance yang boleh menyesuaikan diri berbanding hanya memenuhi keperluan semasa. Pastikan pendekatan AI security dan compliance anda kekal terkini dengan peraturan yang berkembang.

Vendor Security Assessment

Tidak semua vendor tool AI mempunyai security posture yang setara. Vendor assessment yang sistematik menghalang memilih tool yang mencipta risiko yang tidak boleh diterima.

Soalan Security Kritikal untuk Setiap Vendor

Data Handling Practice:

- Adakah customer data diasingkan dari customer lain?

- Adakah customer data pernah digunakan untuk train model?

- Bolehkah kami opt out dari sebarang penggunaan data melampaui provision perkhidmatan langsung?

- Berapa lama data disimpan?

- Apa proses untuk data deletion?

Encryption dan Access Control:

- Adakah data encrypted dalam transit (TLS 1.3 atau lebih baik)?

- Adakah data encrypted at rest?

- Siapa yang mempunyai akses kepada customer data secara internal?

- Bagaimana privileged access dan credential diurus?

- Adakah multi-factor authentication diperlukan untuk semua akses?

Compliance Certification:

- SOC 2 Type II (security control diaudit setiap tahun)

- ISO 27001 (information security management)

- ISO 27701 (privacy management)

- Industry-specific certification (HITRUST untuk healthcare, PCI DSS untuk payment data)

Security Practice:

- Kekerapan security testing (penetration test, vulnerability scan)

- Vulnerability disclosure dan patching timeline

- Third-party security audit

- Security training untuk pekerja

- Incident history dan respons

Data Residency Option:

- Region geografi mana yang boleh proses dan simpan data?

- Bolehkah kami tentukan data residency requirement?

- Adakah vendor menggunakan sub-processor di region lain?

- Bagaimana cross-border transfer dikendalikan?

Red Flag yang Sepatutnya Hentikan Procurement

Sesetengah vendor response sepatutnya hentikan evaluation segera:

- Enggan menyediakan dokumentasi security

- Tiada SOC 2 atau certification setara

- Sejarah security incident yang tidak didedahkan

- Jawapan kabur tentang hak penggunaan data

- Tiada pilihan untuk data residency control

- Menggunakan customer data untuk training tanpa opt-out

Struktur Internal Governance

Vendor security external adalah perlu tetapi tidak mencukupi. Internal governance yang kuat menghalang penyalahgunaan walaupun tool selamat.

AI Usage Policy

Setiap organisasi memerlukan policy yang jelas meliputi:

Approved Use Case: Apa yang tool AI boleh digunakan? Kategori mungkin termasuk:

- Approved: Internal documentation, draft content creation, data analysis

- Require Approval: Customer-facing content, decision support

- Prohibited: Processing confidential data, membuat hiring decision tanpa human review

Data Classification:

- Data apa yang boleh digunakan dengan tool AI?

- Bagaimana pengguna mengenal pasti sensitive data?

- Apa yang berlaku jika sensitive data secara tidak sengaja dimasukkan?

Output Validation:

- Semua AI output mesti disemak sebelum penggunaan

- Keputusan high-stake memerlukan human approval

- AI-generated content mesti didedahkan apabila sesuai

Acceptable Use Guideline

Policy menetapkan sempadan. Guideline membantu pengguna bekerja dengan berkesan di dalamnya.

Contoh Baik:

- Gunakan AI untuk brainstorming dan first draft

- Cite apabila menggunakan AI untuk generate content

- Review AI output untuk accuracy dan bias

- Laporkan kebimbangan tentang tingkah laku tool AI

Contoh Buruk:

- Jangan paste customer contract ke dalam public AI tool

- Jangan anggap AI recommendation sebagai authoritative tanpa verification

- Jangan gunakan AI untuk membuat keputusan akhir tentang hiring atau performance review

- Jangan kongsi AI tool credential atau output dengan pihak yang tidak dibenarkan

Approval Workflow

Tidak semua penggunaan tool AI sepatutnya memerlukan tahap kelulusan yang sama:

Low Risk (Manager Approval):

- Tool yang digunakan hanya untuk internal work

- Memproses non-sensitive data

- Vendor yang well-established dengan security yang kuat

Medium Risk (IT + Legal Approval):

- Tool yang memproses customer data

- Integration dengan core business system

- Vendor baru tanpa track record yang meluas

High Risk (Executive + Committee Approval):

- Tool yang membuat atau mempengaruhi keputusan tentang orang

- Memproses data yang sangat sensitif atau dikawal selia

- Novel use case tanpa preseden industri

Monitoring dan Auditing

Policy tidak enforce sendiri. Monitoring berkala menangkap masalah awal:

Apa yang Perlu Dipantau:

- Tool AI mana yang digunakan (shadow IT detection)

- Data apa yang dihantar ke tool AI (DLP alert)

- Berapa kerap tool digunakan dan oleh siapa

- Support ticket dan incident report berkaitan tool AI

Jejaki metric ini bersama AI productivity ROI metric anda yang lebih luas untuk memastikan governance tidak menghalang value delivery.

Audit Activity:

- Quarterly review inventori tool AI

- Annual vendor security reassessment

- Random sampling AI-generated output untuk kualiti dan compliance

- User survey tentang pemahaman policy

Membina Budaya AI yang Bertanggungjawab Melalui Training

Policy terbaik gagal jika pekerja tidak faham atau mengapa ia penting. Training mengubah compliance daripada checkbox menjadi keupayaan.

Training Program Essential

Untuk Semua Pekerja:

- Tool AI apa yang diluluskan dan cara menggunakannya

- Data apa yang boleh dan tidak boleh digunakan dengan AI

- Cara mengenali dan melaporkan masalah

- Mengapa AI ethics dan privacy penting

Untuk Power User:

- Advanced prompt engineering dalam sempadan policy

- Output quality evaluation

- Bias detection dan mitigation

- Bila perlu escalate kebimbangan

Untuk Manager:

- Meluluskan AI tool request yang sesuai

- Memantau team usage untuk compliance

- Menyokong pekerja dalam penggunaan yang bertanggungjawab

- Memodelkan tingkah laku penggunaan AI yang baik

Untuk Eksekutif:

- AI risk landscape dan mitigation strategy

- Governance requirement dan accountability

- Strategic AI decision mengimbangi peluang dan risiko

- Board-level AI reporting dan oversight

Training Delivery

One-time training tidak berfungsi. AI ethics training yang berkesan adalah berterusan:

- Initial onboarding module (30-45 minit)

- Quarterly refresher tentang policy atau tool baru (15 minit)

- Just-in-time guidance apabila menggunakan tool baru

- Contoh dan case study dari organisasi anda sendiri

- Bahan rujukan yang mudah diakses dan decision tree

Incident Response: Apabila Tool AI Mendedahkan Sensitive Data

Walaupun dengan usaha terbaik, insiden akan berlaku. Kualiti respons menentukan sama ada insiden menjadi krisis.

Immediate Response (0-24 Jam)

Contain Exposure:

- Disable affected AI tool access jika perlu

- Kenal pasti data apa yang didedahkan

- Tentukan scope exposure (siapa yang melihat, ke mana ia pergi)

Notify Stakeholder:

- Maklumkan internal legal dan compliance team

- Maklumkan affected business unit

- Sediakan komunikasi untuk affected individual jika diperlukan

Preserve Evidence:

- Log file dan audit trail

- Screenshot problematic output

- Timeline event dan tindakan yang diambil

Investigation (24-72 Jam)

Root Cause Analysis:

- Bagaimana insiden berlaku?

- Kawalan apa yang gagal atau dipintas?

- Adakah policy dilanggar atau policy tidak mencukupi?

Impact Assessment:

- Berapa ramai individu terjejas?

- Apakah tahap sensitiviti data yang didedahkan?

- Apakah potensi bahaya kepada individu yang terjejas?

- Apakah kewajipan regulatory?

Vendor Coordination:

- Notify AI tool vendor

- Minta investigation dan remediation mereka

- Tentukan jika insiden mempengaruhi customer lain

Remediation (72 Jam - 30 Hari)

Immediate Fix:

- Implement kawalan untuk mencegah berulang

- Update policy jika jurang dikenal pasti

- Retrain pengguna jika policy violation berlaku

Regulatory Response:

- Failkan breach notification yang diperlukan (selalunya 72 jam di bawah GDPR)

- Respons kepada regulatory inquiry

- Dokumentasikan remediation step

Long-Term Improvement:

- Update vendor security requirement

- Tingkatkan monitoring dan detection

- Semak semula program training

- Pertimbangkan sama ada tool sepatutnya kekal diluluskan

Mengimbangi Inovasi dengan Risiko

Matlamatnya bukan zero risk. Ia adalah pengambilan risiko yang pintar yang menangkap value AI sambil melindungi apa yang penting.

Mulakan dengan Low-Risk Use Case: Mulakan dengan tool AI untuk internal productivity di mana impak data exposure terhad. Bina keyakinan dan keupayaan sebelum berkembang kepada customer-facing atau high-sensitivity use case.

Layer Defense: Jangan bergantung pada policy sahaja. Gabungkan technical control (DLP, access management), vendor security, user training, dan monitoring untuk defense in depth.

Review dan Adapt: Anggap program AI governance anda sebagai produk yang bertambah baik dari masa ke masa. Regular review menangkap risiko yang muncul dan peluang untuk streamline tanpa menjejaskan perlindungan.

Communicate the Why: Orang mengikuti policy yang mereka faham dan bersetuju. Jelaskan sebab business dan ethical di sebalik AI governance, bukan hanya rule.

Sumber Berkaitan

Teruskan membina program AI yang bertanggungjawab anda:

- AI Tool Selection Framework - Incorporating security ke dalam tool selection

- AI Security dan Compliance - Deep dive ke dalam technical control

- AI Training dan Onboarding - Membina user capability

- Building an AI-First Culture - Cultural transformation approach

Syarikat yang memimpin dalam AI bukan adopter yang paling agresif. Mereka adalah yang memikirkan cara untuk bergerak pantas sambil kekal selamat. Itu bukan masalah teknologi - ia masalah governance. Dapatkan governance yang betul, dan anda boleh menggunakan AI dengan yakin.

Senior Operations & Growth Strategist

On this page

- Prinsip Ethical Teras untuk Business AI

- Prinsip 1: Transparency dan Explainability

- Prinsip 2: Fairness dan Bias Mitigation

- Prinsip 3: Privacy dan Data Protection

- Prinsip 4: Accountability dan Governance

- Risiko Data Privacy Khusus untuk Tool AI

- Risiko 1: Training Data Exposure

- Risiko 2: Prompt Leakage dan Data Retention

- Risiko 3: Third-Party Model Risk

- Risiko 4: Cross-Border Data Transfer

- Framework Regulatory Compliance

- Keperluan GDPR untuk Operasi EU

- CCPA dan US State Privacy Law

- Industry-Specific Regulation

- Emerging AI-Specific Regulation

- Vendor Security Assessment

- Soalan Security Kritikal untuk Setiap Vendor

- Red Flag yang Sepatutnya Hentikan Procurement

- Struktur Internal Governance

- AI Usage Policy

- Acceptable Use Guideline

- Approval Workflow

- Monitoring dan Auditing

- Membina Budaya AI yang Bertanggungjawab Melalui Training

- Training Program Essential

- Training Delivery

- Incident Response: Apabila Tool AI Mendedahkan Sensitive Data

- Immediate Response (0-24 Jam)

- Investigation (24-72 Jam)

- Remediation (72 Jam - 30 Hari)

- Mengimbangi Inovasi dengan Risiko

- Sumber Berkaitan