Bahasa Indonesia

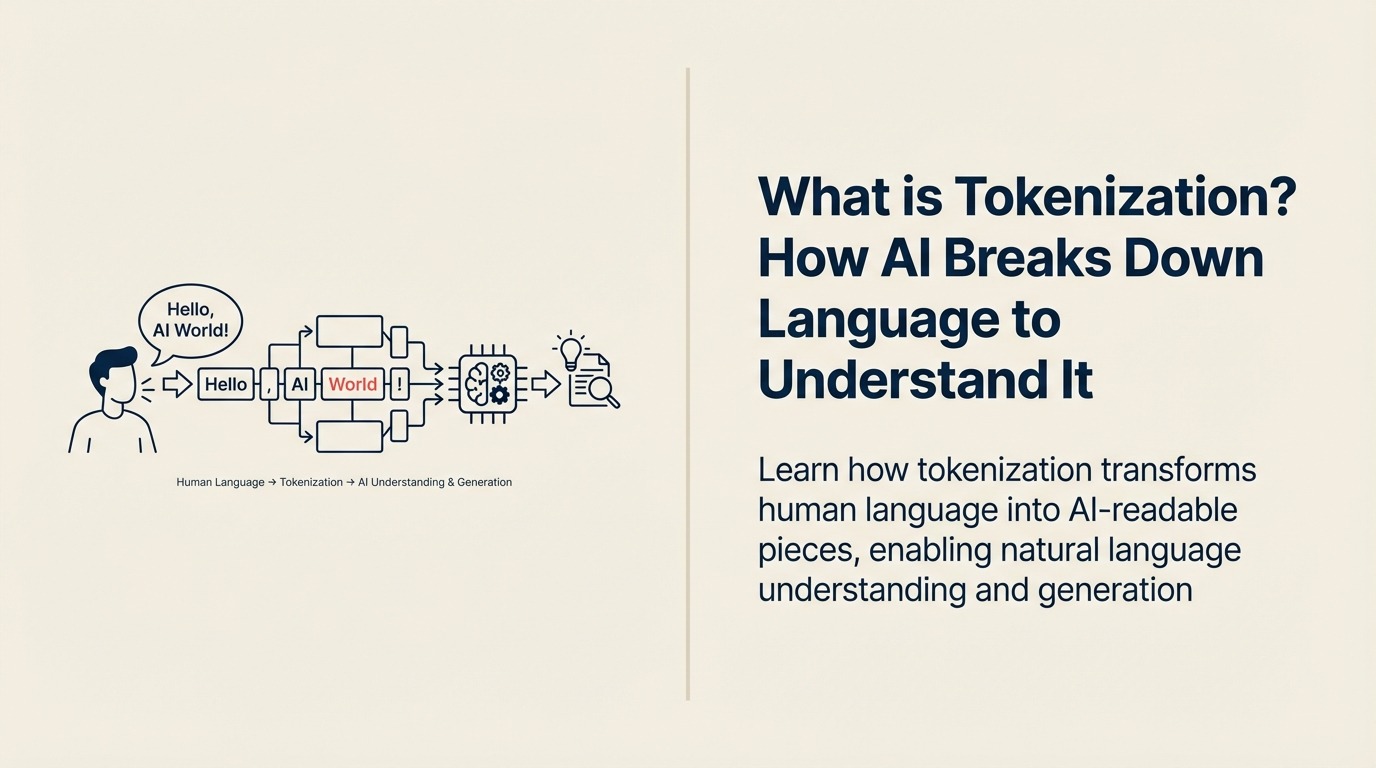

Apa itu Tokenization? Memecah Bahasa menjadi Blok Bangunan AI

Setiap kata yang Anda ketik ke ChatGPT dipotong menjadi potongan-potongan. Email yang dibaca AI Anda? Diiris dan dipotong. Proses ini—tokenization—adalah mengapa AI dapat memahami bahasa dan mengapa tagihan API Anda bergantung pada panjang pesan. Memahaminya membantu Anda mengoptimalkan kinerja dan biaya AI.

Setiap kata yang Anda ketik ke ChatGPT dipotong menjadi potongan-potongan. Email yang dibaca AI Anda? Diiris dan dipotong. Proses ini—tokenization—adalah mengapa AI dapat memahami bahasa dan mengapa tagihan API Anda bergantung pada panjang pesan. Memahaminya membantu Anda mengoptimalkan kinerja dan biaya AI.

Fondasi Teknis

Tokenization adalah proses memecah teks menjadi unit yang lebih kecil yang disebut tokens, yang berfungsi sebagai unit makna fundamental yang dapat diproses oleh model bahasa AI. Token ini mungkin berupa kata, subkata, karakter, atau bahkan potongan kata, tergantung pada strategi tokenization.

Menurut riset OpenAI, "Tokenization adalah langkah preprocessing yang diperlukan yang memetakan dari teks mentah ke urutan integer yang dapat diproses oleh neural networks." Tokenizer modern menggunakan algoritma seperti Byte-Pair Encoding (BPE) atau WordPiece untuk menyeimbangkan ukuran vocabulary dengan coverage.

Inovasi subword tokenization menyelesaikan masalah ledakan vocabulary, memungkinkan model menangani kata apa pun dengan memecah yang tidak dikenal menjadi potongan yang dikenal.

Dampak Bisnis

Bagi pemimpin bisnis, tokenization secara langsung mempengaruhi biaya, kinerja, dan kemampuan AI Anda—menentukan berapa banyak yang Anda bayar untuk panggilan API, seberapa baik AI memahami terminologi khusus, dan apakah dapat menangani berbagai bahasa.

Anggap tokenization seperti pengiriman paket. Anda tidak bisa mengirim seluruh gudang sekaligus—Anda memecah kiriman menjadi kontainer standar. Demikian pula, AI tidak dapat memproses seluruh dokumen sekaligus; ia memerlukan teks yang dipecah menjadi potongan standar.

Dalam praktiknya, tokenization mempengaruhi berapa banyak panggilan API yang dibutuhkan chatbot Anda, apakah AI memahami jargon industri Anda, dan seberapa akurat memproses nama pelanggan atau kode produk. Ini sangat kritis untuk aplikasi conversational AI di mana efisiensi secara langsung mempengaruhi pengalaman pengguna.

Cara Kerja Tokenization

Proses tokenization mengikuti langkah-langkah ini:

• Text Normalization: Menstandardisasi teks input dengan menangani kasus, karakter khusus, dan formatting secara konsisten

• Token Splitting: Memecah teks menjadi token menggunakan pola yang dipelajari—"unhappy" mungkin menjadi ["un", "happy"] atau tetap utuh

• Vocabulary Mapping: Mengonversi setiap token ke nomor unik (token ID) yang diproses oleh neural network

• Special Token Addition: Menambahkan marker untuk batas kalimat, padding, atau fungsi khusus seperti [START] atau [END]

• Sequence Creation: Mengatur token menjadi urutan yang mempertahankan makna sambil sesuai dengan batasan model

Tipe Tokenization

Pendekatan berbeda untuk kebutuhan berbeda:

Tipe 1: Word Tokenization Unit: Kata lengkap Contoh: "AI improves efficiency" → ["AI", "improves", "efficiency"] Terbaik untuk: Analisis sederhana, NLP tradisional

Tipe 2: Subword Tokenization Unit: Potongan kata Contoh: "unbelievable" → ["un", "believ", "able"] Terbaik untuk: Model bahasa modern, menangani kata langka dalam natural language processing

Tipe 3: Character Tokenization Unit: Karakter individual Contoh: "AI" → ["A", "I"] Terbaik untuk: Aplikasi tahan typo, pemrosesan kode

Tipe 4: Byte-Pair Encoding (BPE) Unit: Urutan frekuensi yang dipelajari Contoh: Kompleks, dipelajari dari data Terbaik untuk: Model GPT, pemrosesan multibahasa dalam transformer architecture

Tokenization dalam Praktik

Dampak nyata pada aplikasi bisnis:

Contoh Biaya: OpenAI mengenakan biaya per token. "Hello world" = 2 token ($0.0004), tetapi "Antidisestablishmentarianism" = 7 token ($0.0014). Respons customer service rata-rata 500 token berharga $0.10 masing-masing, jadi prompt yang efisien-token menghemat uang.

Contoh Kinerja: AI medis yang mem-tokenize "acetaminophen" sebagai ["acet", "amino", "phen"] dapat memahami istilah terkait seperti "acetylsalicylic" lebih baik daripada tokenization tingkat kata, meningkatkan akurasi diagnosis.

Contoh Multibahasa: mBERT Google menggunakan wordpiece tokenization untuk menangani 104 bahasa dalam satu model, memungkinkan customer support global tanpa model terpisah per bahasa.

Token Limits dan Context Windows

Memahami batasan:

• Context Windows: Model memiliki batas token maksimum (LLM modern biasanya mendukung 100k-200k token) yang mempengaruhi berapa banyak informasi yang dapat Anda proses sekaligus

• Token Budgeting: Harus menyeimbangkan instruksi prompt, konteks, dan ruang respons dalam batas

• Chunking Strategies: Dokumen panjang memerlukan pemisahan cerdas untuk menjaga koherensi di seluruh chunk

• Cost Optimization: Lebih sedikit token = biaya lebih rendah, tetapi penyederhanaan berlebihan merusak kualitas

Pertimbangan Bisnis

Faktor kunci untuk implementasi:

Industry Terminology:

- Tokenizer khusus untuk vocabulary khusus

- Fine-tuning untuk mengenali istilah domain

- Integrasi glosarium untuk konsistensi

Data Privacy:

- Tokenization dapat mengekspos atau menyembunyikan data sensitif

- Pertimbangkan di mana tokenization terjadi

- Audit vocabulary token untuk kebocoran

Performance Optimization:

- Prompt engineering yang efisien-token

- Caching urutan token umum

- Strategi batching untuk throughput

Tantangan Tokenization Umum

Masalah dan solusi:

• New Terms: AI kesulitan dengan nama brand atau produk baru → Solusi: Fine-tuning atau prompt engineering dengan definisi

• Numbers and Codes: SKU produk ter-tokenize dengan buruk → Solusi: Preprocessing atau penanganan khusus untuk data terstruktur

• Languages Mixing: Code-switching membingungkan tokenizer → Solusi: Model multibahasa atau deteksi bahasa

• Token Waste: Formatting mengkonsumsi token berharga → Solusi: Preprocessing dan desain prompt yang efisien

Mengoptimalkan untuk Tokenization

Best practices untuk efisiensi:

- Pahami tokenizer model Anda menggunakan online tools

- Desain prompt dengan mempertimbangkan batas token

- Preprocess data untuk mengurangi penggunaan token

- Monitor konsumsi token dalam produksi

- Pertimbangkan tokenization khusus untuk domain khusus

Learn More

Siap memperdalam pemahaman Anda tentang pemrosesan bahasa AI?

- Embeddings - Lihat bagaimana token menjadi vektor bermakna

- Large Language Models - Pahami bagaimana LLM menggunakan token

- Generative AI - Jelajahi bagaimana tokenization memungkinkan generasi konten

- API AI - Pelajari tentang biaya API dan harga token

External Resources

- Hugging Face Blog - Pelajari tentang metode tokenization dan implementasi dalam LLM modern

- Jay Alammar's Blog - Penjelasan visual bagaimana tokenization dan transformer bekerja bersama

- Google AI Research - Temukan kemajuan dalam tokenization multibahasa dan efisiensi

FAQ Section

Pertanyaan yang Sering Diajukan tentang Tokenization

Apa itu Tokenization dalam AI?

Tokenization adalah proses memecah teks menjadi unit yang lebih kecil (token) yang dapat diproses oleh model AI, seperti kata, subkata, atau karakter.

Apa perbedaan antara word dan subword tokenization?

Word tokenization membagi teks pada batas kata. Subword tokenization memecah kata menjadi potongan yang lebih kecil, memungkinkan model menangani kata yang tidak dikenal dan mengurangi ukuran vocabulary.

Apa tipe utama tokenization?

Word Tokenization (kata lengkap), Subword Tokenization (potongan kata), Character Tokenization (huruf individual), dan Byte-Pair Encoding/BPE (urutan frekuensi yang dipelajari).

Apa itu token limit atau context window?

Token limit adalah jumlah maksimum token yang dapat diproses model sekaligus. Misalnya, LLM modern biasanya dapat menangani 100.000-200.000 token, mempengaruhi berapa banyak teks yang dapat Anda input dan terima.

Bagian dari [AI Terms Collection]. Terakhir diperbarui: 2026-01-11