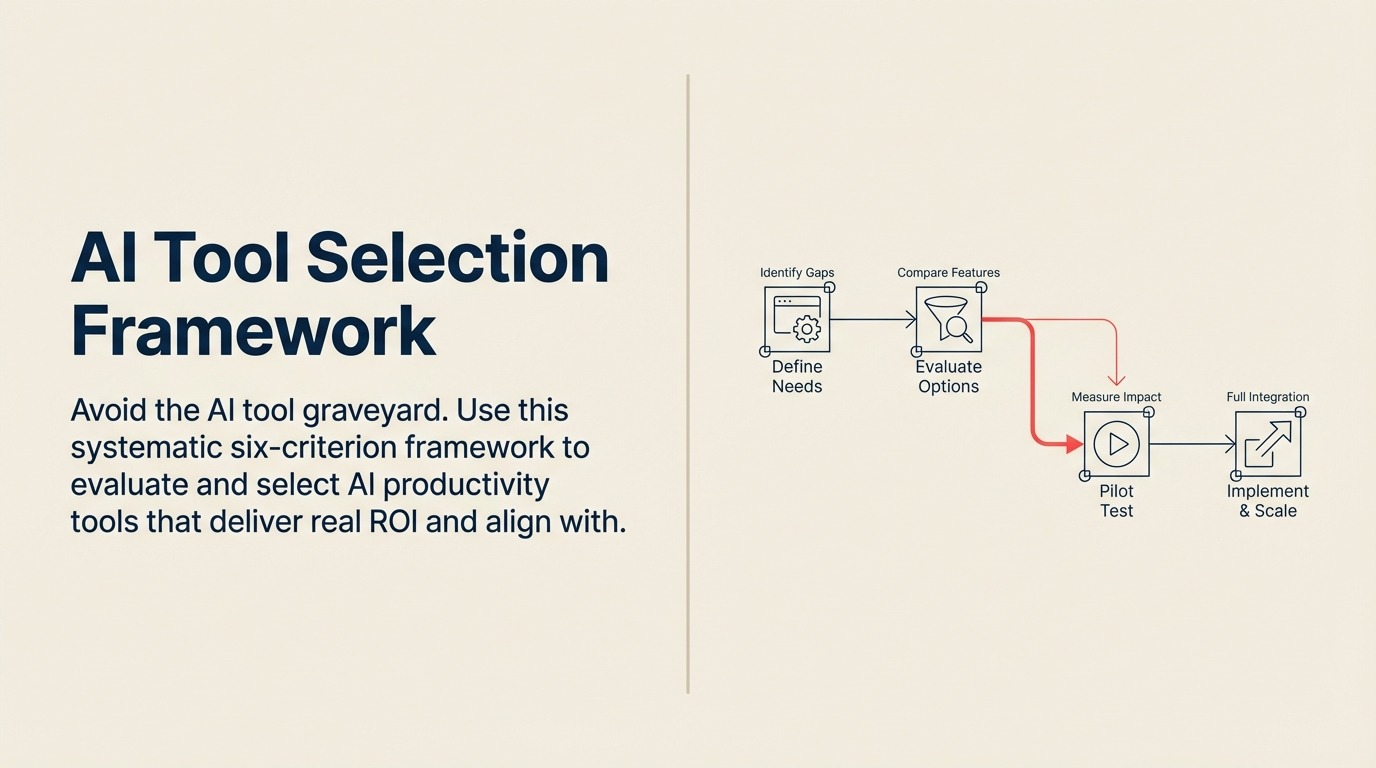

AI Tool Selection Framework: Ein strategischer Ansatz zur Auswahl der richtigen AI-Lösungen

Siebenundsechzig Prozent der AI-Initiativen liefern keinen ROI. Nicht weil die Technologie nicht funktioniert, sondern weil Unternehmen die falschen Tools für ihre Anforderungen auswählen.

Der Friedhof ist voll von AI Tools, die in Demos beeindruckend aussahen, aber nie genutzt wurden. Tools, die Transformation versprachen, aber sich nicht in bestehende Systeme integrieren ließen. Tools, die Probleme lösten, die niemand tatsächlich hatte.

Das Muster ist konsistent: Unternehmen evaluieren AI Tools auf die gleiche Weise wie traditionelle Software. Sie betrachten Features, vergleichen Preise, führen vielleicht einen kleinen Pilot durch. Dann sind sie überrascht, wenn das Tool sechs Monate nach dem Kauf ungenutzt bleibt. Das Verstehen der grundlegenden Unterschiede zwischen AI und traditioneller Produktivitätssoftware ist entscheidend, bevor Sie mit Ihrer Evaluierung beginnen.

AI Tools erfordern ein anderes Evaluierungsframework. Eines, das Lernkurven, Datenanforderungen, Integrationskomplexität und Adoptionsherausforderungen berücksichtigt, die traditionelle Software nicht aufweist.

Hier ist das Framework, das tatsächlich funktioniert.

Das Framework mit sechs Kriterien

Die meisten Fehlschläge bei der AI Tool-Auswahl geschehen, weil die Evaluierung entweder zu einfach ist (nur Preis und Features) oder zu komplex (Lähmung durch Analyse). Sechs Kriterien bieten die richtige Balance - umfassend genug, um größere Probleme zu erfassen, und dennoch straff genug, um die Evaluierung tatsächlich abzuschließen.

Kriterium 1: Ausrichtung auf Geschäftsprobleme

Beginnen Sie hier, nicht mit der Technologie. Welches spezifische Problem versuchen Sie zu lösen? Wie würde Erfolg in geschäftlichen Ergebnissen aussehen? Wie werden Sie ihn messen?

Der Problem-First-Ansatz: Zu viele AI Tool-Auswahlen beginnen mit "Wir sollten AI für etwas nutzen." Das ist verkehrt herum. Beginnen Sie mit Ihren Geschäftsproblemen, sortiert nach Impact und Schmerzlevel. Evaluieren Sie dann, ob AI Tools diese besser lösen können als Alternativen.

Ein Fertigungsunternehmen, das mit Qualitätsproblemen kämpft, sollte nicht nach AI-Qualitätskontrolltools suchen. Sie sollten analysieren, wo Defekte auftreten, warum bestehende Prozesse sie übersehen, und welche Informationen helfen würden, sie zu verhindern. Dann - und erst dann - evaluieren, ob AI Tools diese Informationen besser bereitstellen können als traditionelle Ansätze.

ROI-Potenzial-Assessment: Bevor Sie Tools evaluieren, schätzen Sie den Wert der Problemlösung. Was kostet Sie dieses Problem jährlich an Zeit, Fehlern, verpassten Chancen oder Kundenunzufriedenheit?

Wenn Email-Management 5 Stunden pro Woche bei 50 Wissensarbeitern verschwendet, sind das 250 Stunden wöchentlich oder 750.000 € jährlich (bei angenommenen 60 € pro Stunde Vollkosten). Ein AI Email-Tool, das 50% dieser Zeit spart, muss weniger als 375.000 € jährlich kosten, um die Gewinnschwelle zu erreichen - und das ist vor Berücksichtigung der Implementierungszeit und Lernkurve.

Diese Rechnung erzwingt ehrliche Gespräche darüber, ob das Problem es wert ist, gelöst zu werden, und was Sie sich leisten können auszugeben. Für detaillierte Anleitungen zum Aufbau von Business Cases, siehe unseren umfassenden Leitfaden zu AI Productivity ROI Metrics.

Definition von Erfolgsmetriken: Definieren Sie genau, wie Sie Erfolg messen werden, bevor die Evaluierung beginnt. Keine diffusen Metriken wie "verbesserte Produktivität", sondern spezifische Messgrößen wie "Email-Bearbeitungszeit um 40% reduzieren" oder "Dokumenterstellungszeit von 3 Stunden auf 45 Minuten verringern."

Diese Metriken werden zu Ihren Evaluierungskriterien. Wenn ein Tool während des Pilotings keinen Impact auf Ihre Erfolgsmetriken demonstrieren kann, ist es egal, wie beeindruckend seine Feature-Liste ist.

Kriterium 2: Integrationsfähigkeiten

AI Tools funktionieren nicht isoliert. Sie benötigen Daten aus Ihren bestehenden Systemen und müssen Insights zurück in Ihre Workflows schieben. Integrationskomplexität ist der Hauptprädiktor für Implementierungsfehler.

Kompatibilität mit bestehendem Tech Stack: Listen Sie jedes System auf, das sich mit dem AI Tool verbinden müsste. Ihr CRM, ERP, Kommunikationsplattformen, Data Warehouse, Authentifizierungssysteme. Evaluieren Sie dann:

- Hat das Tool native Integrationen mit diesen Systemen?

- Sind die Integrationen bidirektional (Lesen und Schreiben)?

- Wie oft brechen Integrationen laut User Reviews zusammen?

- Was passiert, wenn integrierte Systeme aktualisiert werden?

Ein Tool mit begrenzten Integrationen kann trotzdem funktionieren, wenn Sie starke Middleware (wie Zapier oder Workato) oder Entwicklungsressourcen zum Bau individueller Verbindungen haben. Aber rechnen Sie diese Kosten und Komplexität in Ihre Total Ownership-Kalkulation ein.

Datenfluss-Anforderungen: Kartieren Sie die komplette Datenreise. Wo entstehen Daten? Wie müssen sie transformiert werden? Wo müssen Insights erscheinen? Wer muss auf sie reagieren?

Ein AI Sales-Tool könnte Daten aus Ihrem CRM, Email-System und Kalender ziehen. Es generiert Insights, die im CRM erscheinen müssen, wo Reps tatsächlich arbeiten, Benachrichtigungen in Slack auslösen und in Reports in Ihrem BI-Tool einfließen. Jeder dieser Touchpoints ist eine Integrationsanforderung.

Verpassen Sie irgendeinen Link in dieser Kette, und das Tool wird zu einem Dashboard, das Leute gelegentlich prüfen, anstatt einem System, das tägliches Verhalten steuert.

API- und Webhook-Verfügbarkeit: Auch mit nativen Integrationen evaluieren Sie die zugrunde liegende API. Robuste APIs erlauben Ihnen, individuelle Workflows zu bauen und sich anzupassen, wenn sich Anforderungen ändern. Achten Sie auf:

- RESTful APIs mit umfassender Dokumentation

- Webhook-Support für Echtzeit-Updates

- Rate Limits, die Ihr Datenvolumen bewältigen

- Versionierungsrichtlinien, die bestehende Integrationen nicht brechen

Kriterium 3: Datenanforderungen und Datenschutz

AI Tools sind hungrig nach Daten. Zu verstehen, was sie benötigen und wie sie es nutzen, verhindert sowohl Implementierungsfehler als auch Compliance-Alpträume.

Trainingsdaten-Bedarf: Manche AI Tools funktionieren out of the box. Andere benötigen Training mit Ihren spezifischen Daten, bevor sie nützlich sind. Verstehen Sie, mit welcher Kategorie Sie es zu tun haben und ob Sie die erforderlichen Trainingsdaten haben.

Ein AI-Dokumentenklassifizierer benötigt Hunderte oder Tausende gelabelte Beispiele, um Ihr Kategorisierungsschema zu lernen. Wenn Sie diese Trainingsdaten nicht haben, müssen Sie sie erstellen - was Monate dauern kann. Traditionelles regelbasiertes Dokumenten-Routing könnte tatsächlich schneller zu implementieren sein.

Sicherheit und Compliance: Wohin gehen Ihre Daten, wenn die AI sie verarbeitet? Werden sie verwendet, um Modelle zu trainieren, von denen andere Kunden profitieren? Wie lange werden sie aufbewahrt? Können Sie Löschung beantragen?

Diese Fragen sind nicht theoretisch. Ein Finanzdienstleistungsunternehmen nutzte einen AI Writing Assistant für Kundenkommunikation, ohne zu realisieren, dass Kundendaten zur Modellverbesserung verwendet wurden. Ihr Compliance-Team entdeckte es während eines Audits. Die resultierende Untersuchung und Behebung kostete siebenstellige Beträge.

Kritische Fragen für jedes AI Tool:

- Werden Daten lokal oder in der Cloud verarbeitet?

- In welchen Ländern befinden sich die Verarbeitungsserver?

- Sind Ihre Daten von anderen Kundendaten getrennt?

- Nutzt der Vendor Ihre Daten für Modelltraining?

- Welche Zertifizierungen halten sie (SOC 2, ISO 27001, etc.)?

- Können Sie Ihre Daten auf Anfrage exportieren oder löschen?

Diese Fragen sind direkt verbunden mit breiteren Bedenken zu AI Ethics und Data Privacy, die Ihren gesamten Auswahlprozess informieren sollten.

Anforderungen an Datenresidenz: Für globale Unternehmen ist Datenresidenz wichtig. Europäische Operationen könnten erfordern, dass Daten in EU-Rechenzentren bleiben. Manche Branchen haben spezifische Anforderungen darüber, wo sensible Daten verarbeitet werden können.

Viele AI Tools laufen auf großen Cloud-Plattformen (AWS, Azure, Google Cloud) und können regionale Datenresidenz anbieten. Andere sind rein US-basiert. Kennen Sie Ihre Anforderungen, bevor die Evaluierung beginnt.

Kriterium 4: User Adoption-Faktoren

Das beste AI Tool bedeutet nichts, wenn Leute es nicht nutzen. Adoptionsherausforderungen töten mehr AI-Initiativen als technische Limitierungen.

Lernkurve: AI Tools führen neue Paradigmen ein. Anstatt durch Menüs zu klicken, beschreiben Sie, was Sie wollen. Anstatt exakter Ergebnisse erhalten Sie probabilistische Empfehlungen. User müssen nicht nur lernen, wie man das Tool bedient, sondern wie man über die Arbeit damit denkt.

Evaluieren Sie dies ehrlich. Wie technisch versiert sind Ihre User? Wie viel Zeit wird Training erfordern? Welche fortlaufende Unterstützung werden User benötigen?

Ein Entwicklungsteam könnte ein Code-Generierungstool mit minimalem Training annehmen. Ein Vertriebsteam mit gemischten technischen Komfortniveaus könnte mit allem außer den intuitivsten Interfaces kämpfen.

Change Management-Bedarf: AI Tools ändern oft Workflows, automatisieren sie nicht nur. Wenn Ihr aktueller Prozess "Analyst erstellt Report, Manager prüft, Executive sieht Ergebnisse" ist, könnte ein AI Analytics-Tool Executives ermöglichen, Daten direkt abzufragen. Das ist mächtig, bedroht aber auch etablierte Rollen und Prozesse.

Kartieren Sie, wie sich Arbeit ändern wird, wenn das Tool adoptiert wird. Wer gewinnt Verantwortlichkeiten? Wer verliert sie? Wessen Expertise wird weniger kritisch? Diese Insights sagen Ihnen, woher Widerstand kommen wird und welches Change Management Sie benötigen.

User Interface-Qualität: Verbringen Sie ernsthafte Zeit im Interface bei echten Arbeitsszenarien. Nicht nur den Happy Path, den der Vendor demonstriert, sondern chaotische reale Situationen.

Können Sie Features finden, ohne zu suchen? Handhabt das System Fehler elegant? Sind Outputs leicht zu verstehen und darauf zu reagieren? Würde Ihr am wenigsten technischer User grundlegende Aufgaben erledigen können?

Interface-Qualität ist bei AI Tools wichtiger als bei traditioneller Software, weil User sich nicht auf memorierte Menüpfade verlassen können. Jede Interaktion erfordert zu verstehen, was die AI tat und zu evaluieren, ob es korrekt ist.

Kriterium 5: Vendor-Viabilität und Support

Der AI Tool-Markt ist volatil. Gut finanzierte Startups scheitern. Etablierte Vendors ziehen Produkte zurück. Akquisitionen ändern Roadmaps über Nacht.

Unternehmensstabilität: Evaluieren Sie die Langlebigkeit und finanzielle Gesundheit des Vendors. Nicht weil Sie eine jahrzehntelange Verpflichtung eingehen, sondern weil der Wechsel von AI Tools teuer ist, sobald sie in Workflows eingebettet sind.

Achten Sie auf:

- Jahre im Geschäft und Wachstumstrajektorie

- Kundenzahl und Retention Rates

- Finanzierungs- oder Profitabilitätsstatus

- Wichtige Kundenreferenzen

Ein venture-backed Startup mit beeindruckender Technologie, aber 18 Monaten Runway, birgt Risiken. Ebenso ein akquiriertes Produkt, bei dem der Käufer überlappende Lösungen hat.

Produkt-Roadmap: Wohin entwickelt sich das Produkt? Welche Fähigkeiten sind im Entwicklungsplan? Wie passen diese zu Ihren zukünftigen Anforderungen?

Aber auch: Wie oft hat der Vendor vergangene Roadmap-Verpflichtungen eingehalten? Ambitionierte Roadmaps bedeuten nichts, wenn die Ausführung schlecht ist.

Support-Qualität: Wenn etwas bricht oder Sie Hilfe benötigen, was passiert? Evaluieren Sie:

- Response Time-Verpflichtungen im SLA

- Qualität von Dokumentation und Self-Service-Ressourcen

- Verfügbarkeit von technischem Support vs. nur Account Management

- Community-Größe und -Aktivität

- Professional Services-Verfügbarkeit für komplexe Implementierungen

AI Tools können sich unvorhersehbar verhalten. Sie benötigen Support, der sowohl die Technologie als auch Ihren Use Case versteht.

Kriterium 6: Total Cost of Ownership

Der Listenpreis ist nur der Anfang. AI Tools tragen Kosten während ihres gesamten Lebenszyklus, die während der initialen Evaluierung nicht offensichtlich sind.

Lizenzmodelle: AI Tools nutzen typischerweise eines von drei Modellen:

- Per-User-Subscriptions (vorhersehbar, aber können bei Skalierung teuer werden)

- Usage-based Pricing (richtet Kosten nach Wert aus, macht Budgetierung aber schwieriger)

- Hybridmodelle (Basis-Subscription plus Usage Fees)

Verstehen Sie, welches Modell gilt und wie es skaliert. Ein Tool, das 50 € pro User pro Monat kostet, scheint vernünftig, bis Sie realisieren, dass Sie 500 User lizenzieren müssen. Usage-based Pricing sieht bei aktuellen Volumina erschwinglich aus, könnte aber explodieren, wenn Adoption erfolgreich ist.

Implementierungskosten: Was braucht es, um das Tool betriebsbereit zu machen? Diese Kosten übersteigen oft die Lizenzierung des ersten Jahres:

- Technische Implementierung (Integrationen, Konfiguration, Testing)

- Datenaufbereitung und Qualitätsverbesserung

- Entwicklung von Trainingsinhalten

- User Training und Onboarding

- Change Management-Aktivitäten

- Pilotprogramm-Betrieb

Holen Sie spezifische Schätzungen für Ihre Umgebung ein. Akzeptieren Sie keine Vendor-Zusicherungen, dass "Implementierung unkompliziert ist", ohne zu verstehen, was das für Ihre spezifische Situation bedeutet.

Laufende operative Ausgaben: Nach Go-live, was kostet der Betrieb?

- Systemadministrationszeit

- Integrationswartung

- User Support

- Modell-Retraining oder Fine-Tuning

- Zusätzliche Datenspeicher- oder Verarbeitungsgebühren

- Fortlaufendes Training für neue User

Das Scoring-Modell: Objektive Vergleiche anstellen

Sobald Sie Tools gegen alle sechs Kriterien evaluiert haben, benötigen Sie einen Weg, sie objektiv zu vergleichen. Ein gewichtetes Scoring-Modell verhindert Bias zugunsten auffälliger Features oder charmanter Vertriebsteams.

So erstellen Sie Ihre Scorecard:

- Gewichten Sie die Kriterien: Weisen Sie Wichtigkeitsgewichte jedem Kriterium basierend auf Ihrer Situation zu. Eine regulierte Branche könnte Data Privacy mit 25% der Gesamtpunktzahl gewichten. Ein schnell bewegendes Startup könnte das mit 10% gewichten und Vendor Stability mit 15%.

Es gibt keine universell richtige Antwort - die Gewichte sollten Ihren spezifischen Kontext und Prioritäten widerspiegeln.

- Definieren Sie Scoring-Rubriken: Für jedes Kriterium erstellen Sie eine 1-5-Skala mit spezifischen Definitionen. Zum Beispiel:

Business Problem Alignment:

- 5: Löst direkt das genannte Problem mit messbarem Impact

- 4: Löst das Problem, aber Impact ist schwerer zu quantifizieren

- 3: Adressiert Problem teilweise

- 2: Indirekte Beziehung zum Problem

- 1: Adressiert das genannte Problem nicht

Bewerten Sie jedes Tool: Lassen Sie mehrere Evaluatoren unabhängig bewerten, vergleichen und diskutieren Sie dann Diskrepanzen. Dies verhindert, dass individueller Bias die Auswahl dominiert.

Berechnen Sie gewichtete Gesamtsummen: Multiplizieren Sie jeden Kriterium-Score mit seinem Gewicht und summieren Sie für einen Gesamtscore. Dies gibt Ihnen ein objektives Ranking zur Informierung Ihrer Entscheidung.

Beispiel-Scorecard:

| Kriterium | Gewicht | Tool A | Tool B | Tool C |

|---|---|---|---|---|

| Business Alignment | 25% | 5 | 4 | 3 |

| Integration | 20% | 3 | 5 | 4 |

| Data/Privacy | 15% | 4 | 4 | 5 |

| User Adoption | 20% | 4 | 3 | 4 |

| Vendor Stability | 10% | 5 | 4 | 3 |

| Total Cost | 10% | 3 | 4 | 4 |

| Gewichtete Summe | 4,15 | 4,15 | 3,85 |

Wenn Tools ähnlich punkten, ist das nützliche Information. Es bedeutet, dass beide wahrscheinlich funktionieren würden, sodass Sie sekundäre Faktoren wie Beziehungsqualität oder Roadmap-Ausrichtung nutzen können, um die Entscheidung zu treffen.

Pilotprogramm-Design: Testen vor voller Verpflichtung

Scorecards informieren Entscheidungen, aber Pilots validieren sie. Ein gut designter Pilot fängt Probleme ab, die Papierevaluierung übersieht.

Pilot-Struktur:

- Dauer: 60-90 Tage (kürzer zeigt keine Adoptionsmuster, länger verzögert Entscheidungen)

- User: 15-25 Personen, die verschiedene Skill-Level und Use Cases repräsentieren

- Umfang: Echte Arbeit, nicht konstruierte Szenarien

- Support: Vendor-Unterstützung bei technischen Problemen, aber User arbeiten unabhängig für tägliche Nutzung

Was zu messen ist:

- Tatsächliche Nutzungshäufigkeit (nicht Umfragedaten über Nutzungsabsicht)

- Aufgabenerledigungszeit vor und nach Tool-Adoption

- Output-Qualitätsmetriken spezifisch für Ihren Use Case

- Anzahl und Art der Support-Tickets

- User Satisfaction Scores bei 30, 60 und 90 Tagen

Red Flags, auf die zu achten ist:

- Nutzung sinkt nach initialer Begeisterung

- User kehren zu alten Tools für wichtige Arbeit zurück

- Support-Tickets nehmen über Zeit nicht ab

- Qualitätsprobleme tauchen nach initialem Erfolg auf

- Integrationsprobleme erscheinen nur bei echten Datenvolumen

Ein Pilot, der erfolgreich aussieht, aber eines dieser Muster zeigt, wird wahrscheinlich bei voller Skalierung scheitern.

Alles zusammenbringen

AI Tool-Auswahl geht nicht darum, die fortschrittlichste Technologie oder die beste Demo zu finden. Es geht darum, Tools zu Problemen zu matchen, sicherzustellen, dass sie in Ihrer Umgebung funktionieren, und zu bestätigen, dass Leute sie tatsächlich nutzen werden.

Das Framework gibt Ihnen einen systematischen Weg, diese Faktoren zu evaluieren, ohne sich in Feature-Vergleichs-Spreadsheets zu verlieren oder von Vendor-Präsentationen beeinflusst zu werden.

Beginnen Sie mit klaren Problemen und Erfolgsmetriken. Evaluieren Sie systematisch über alle sechs Kriterien. Bewerten Sie objektiv. Pilotieren Sie gründlich. Treffen Sie dann Ihre Entscheidung mit Zuversicht.

Verwandte Ressourcen

Bauen Sie Ihre AI Tool-Auswahl-Expertise weiter aus:

- Was sind AI Productivity Tools - Grundlegende Konzepte

- Typen von AI Productivity Tools - Kategorieübersicht

- AI Tool Implementation Roadmap - Post-Selection-Ausführung

- AI Security and Compliance - Deep Dive in Kriterium 3

- AI Tool Cost Management - Deep Dive in Kriterium 6

Die meisten AI Tool-Fehler sind Auswahlfehler. Machen Sie die Auswahl richtig, und Implementierung wird dramatisch einfacher. Nach der Auswahl bewegen Sie sich vorwärts mit einer strukturierten AI Tool Implementation Roadmap und umfassendem AI Training und Onboarding, um Adoption zu maximieren.

Senior Operations & Growth Strategist

On this page

- Das Framework mit sechs Kriterien

- Kriterium 1: Ausrichtung auf Geschäftsprobleme

- Kriterium 2: Integrationsfähigkeiten

- Kriterium 3: Datenanforderungen und Datenschutz

- Kriterium 4: User Adoption-Faktoren

- Kriterium 5: Vendor-Viabilität und Support

- Kriterium 6: Total Cost of Ownership

- Das Scoring-Modell: Objektive Vergleiche anstellen

- Pilotprogramm-Design: Testen vor voller Verpflichtung

- Alles zusammenbringen

- Verwandte Ressourcen